热门标签

热门文章

- 1数据结构C语言版 —— 顺序表增删改查实现_增删改查c

- 2Nginx Linux系统make指令gcc-c++依赖下载_gcc-c++依赖包下载

- 3MySql实现类似Oracle的rownum列_mysql 查询结果输出类似于oracle 的rownum

- 4ubuntu16.04安装wordpress

- 5Micro-ros系列教程(1) 在STM32上部署micro-ros包括自定义消息类型_micro ros静态库编译

- 6数据结构-总结_数据结构 讲解

- 7Springboot2.x整合Activiti7入门案例_alfresco activiti 基础springboot

- 8遇到并发就发怵?这份GitHub标星180k的JAVA并发编程合集有奇效,还不赶紧来学!_github高并发项目推荐

- 9ADOP告诉您 2024年人工智能是什么?它的类型、趋势和未来?上篇

- 10使用Jenkins+docker 部署springboot项目_jenkins 运行在docker容器 部署 springboot

当前位置: article > 正文

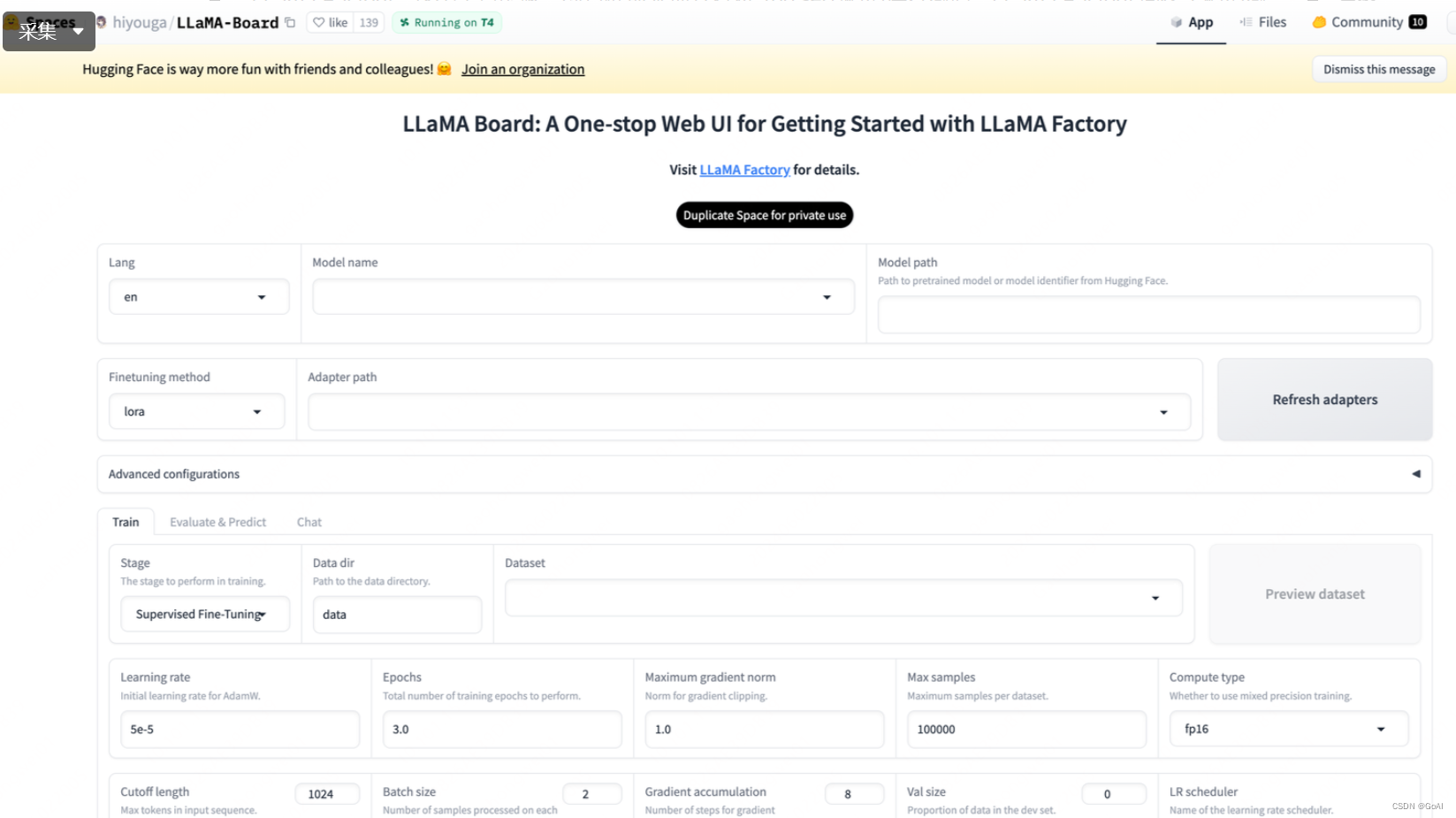

LLaMA-Factory实战推理_llama factory identify.json

作者:小蓝xlanll | 2024-06-07 15:26:31

赞

踩

llama factory identify.json

LLaMA-Factory官网:https://github.com/hiyouga/LLaMA-Factory

安装环境

git clone https://github.com/hiyouga/LLaMA-Factory.git

cd LLaMA-Factory/

conda create -n py310 python=3.10

conda activate py310

- 1

- 2

- 3

- 4

按照llama-factory要求的标准格式组织数据集,保存成一个文件,比如下面这种.json文件:

[

{

"instruction": "user instruction (required)",

"input": "user input (optional)",

"output": "model response (required)",

"system": "system prompt (optional)",

"history": [

["user instruction in the first round (optional)", "model response in the first round (optional)"],

["user instruction in the second round (optional)", "model response in the second round (optional)"]

]

}

]

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

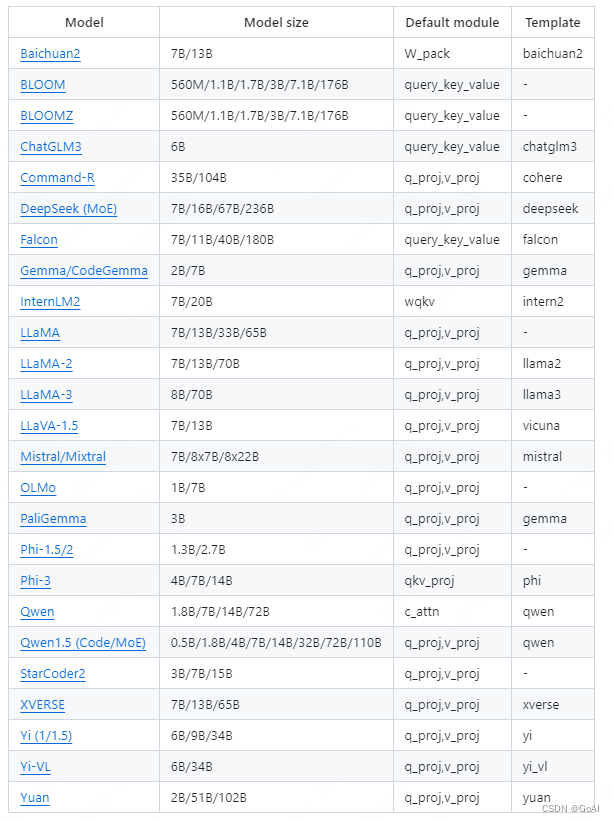

大模型选择:

LLaMA、Mistral、Mixtral-MoE、Qwen、Yi、Gemmha、Baichuan、ChatGLM、Phi

推理模型

CUDA_VISIBLE_DEVICES=0 python cli_demo.py \--model_name_or_path path_to_llama_model \--adapter_name_or_path path_to_checkpoint \--template default \--finetuning_type lora

- 1

总结:

有效的微调已成为大型语言模型适应特定任务的必要条件之一。随着 Llama-Factory 的引入,这一全面的框架让训练更加高效,用户无需编写代码即可轻松为超过 100 个 LLMs 定制微调。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/小蓝xlanll/article/detail/685928

推荐阅读

相关标签