热门标签

热门文章

- 1pip安装出现Fatal error in launcher: Unable to create process using '"'的解决办法

- 2前端面经(面试准备+面试题)_店小秘erp 前端面试

- 3算法-买卖股票问题_股票买卖问题算法

- 4Linux 系统应用编程——网络编程(I/O模型)_<

> - 5【图解数据结构】栈全面总结

- 6MyBatis中的复杂映射_对象包含集合字段的对应数据库表

- 7iptables详解_iptables destination

- 8mysql的分区和索引详解_Mysql分区和索引记录

- 9DCMM评估体系

- 10网络工程师面试经验分享_深信服笔试面试问答总结-有一定深度!完整版「建议收藏」_深信服技术服务工程师面试题

当前位置: article > 正文

机器学习-6-对随机梯度下降算法SGD的理解

作者:知新_RL | 2024-05-29 19:41:46

赞

踩

机器学习-6-对随机梯度下降算法SGD的理解

参考一文带您了解随机梯度下降(Stochastic Gradient Descent):python代码示例

参考sklearn-SGDClassifier

1 梯度下降

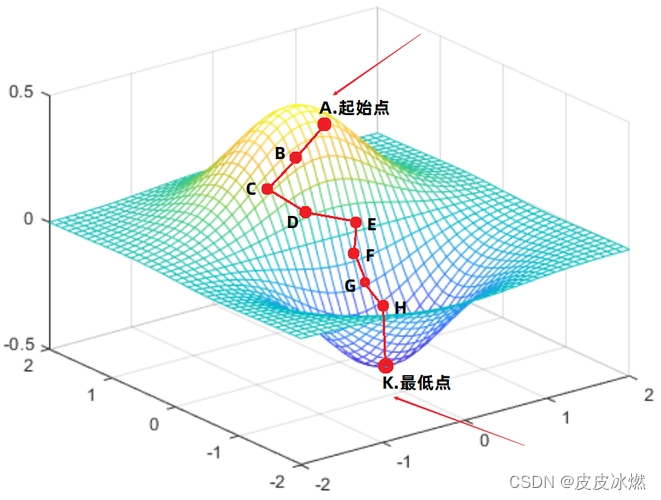

在机器学习领域,梯度下降扮演着至关重要的角色。梯度下降是一种优化算法,通过迭代沿着由梯度定义的最陡下降方向,以最小化函数。类似于图中的场景,可以将其比喻为站在山巅,希望找到通往山谷最低点的最佳路径。梯度下降就如同引导您寻找下山的最优路线一样。

梯度下降算法之所以美妙,是因为它的简洁和优雅。其工作原理简述如下:从函数上的一个随机点开始,比如山巅的随机起点。接着,计算该点处函数的梯度(斜率),类似于在山上四处寻找最陡的坡度。一旦确定了方向,就向该方向迈进一步,然后重新计算坡度。反复进行这个过程直至到达底部。

每一步的大小由学习率(the learning rate)来决定。然而,如果学习率太小,可能需要很长时间才能到达底部;反之,如果太大,可能会越过最低点。找到正确的平衡是算法成功的关键。

梯度下降另一个优点是其通用性。它几乎可以应用于任何函数,尤其是那些无法通过解析方法求解的函数。这使得梯度下降在解决各类机器学习问题时(从简单的线性回归到复杂的神

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/知新_RL/article/detail/643718

推荐阅读

相关标签