- 1解决k8s helm安装tiller出现ImagePullBackOff,ErrImagePull错误_tiller is already installed in the cluster

- 2第一章——一个简单的iOS应用程序_ios简易程序

- 3应用 Python PyAutoGUI 打造专属按键精灵脚本工具!

- 4ddmlib-25.3.0.jar AndroidDebugBridge类_ddmlib androiddebugbridge 私钥

- 5STM32开发板+机智云AIoT+家庭监测控制系统_软硬件交互家庭数据监测系统程序

- 6c++ 实现学生类设计_c++设计一个学生类,包括学号,姓名,性别

- 7Android 常用的intent Action整理

- 8Pygame实战:Python做一款超好玩的滑雪大冒险小游戏,超会玩【附源码】_python开发滑雪小游戏实验报告

- 9高低版本Gradle区别_gradle-5.5.1-all.zip和gradle-5.5.1-bin.zip的区别

- 10全新升级的鸿蒙开发套件,你想知道的都在这里_组件开发套件

手把手教你如何部署ChatGLM-6B大模型_chartgml-6b llm 模型部署

赞

踩

最近咸鱼时间学习了大模型的知识,正好不上班,趁着这时间写一下自己的实践供大家参考

云服务器环境搭建

目前阿里云服务器有免费的使用机会,大家可以申请用来学习和实验,账号的话:支付宝啥的都可以直接注册。

具体操作步骤:进入阿里云服务器网站,找到“产品”,然后找到“机器学习平台PAI”,点击后就会下面的图,这边点击免费试用即可。

服务器的环境我是根据b站up主学习的,这里我们选择第一个交互式建模,点击立即试用

然后我们点击交互式建模,点击“创建实例”,

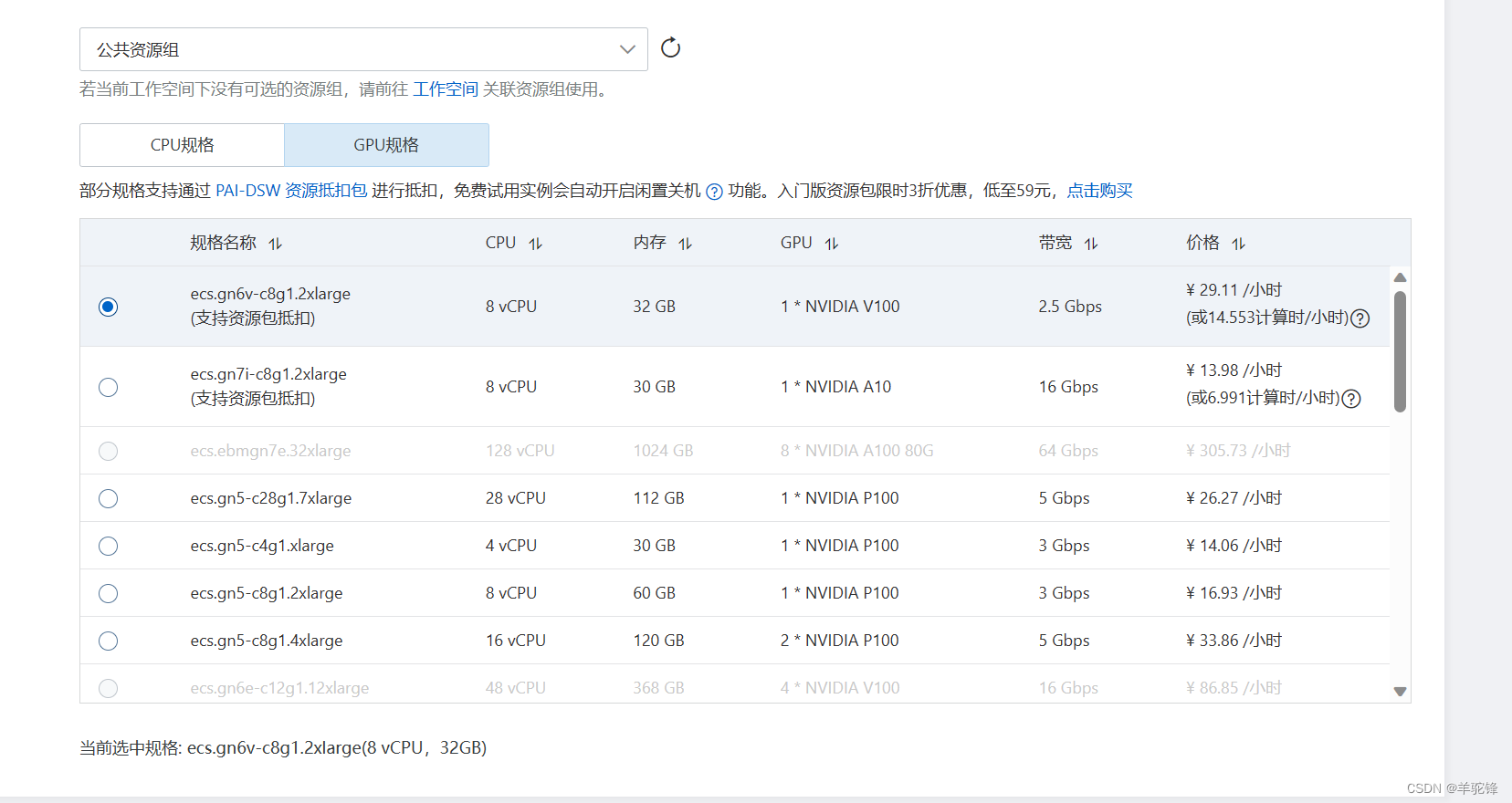

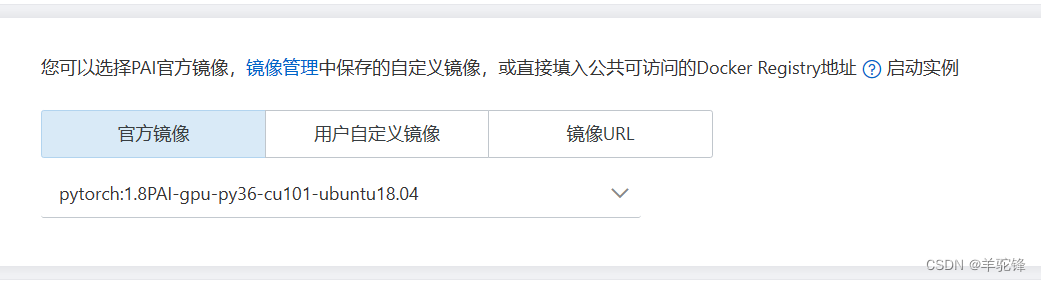

实例的地域、工作空间、名称这些任意,重点是GPU和环境,GPU可以选择V100的卡,应该是够用了,然后镜像选择,都在下面图列出来了,按照这个走就行。数据集和网络配置先不要选择!!!

模型的下载

这边需要下载两个东西,分别是chatGLM-6B的github地址和模型地址,分别列出来了:

chatGLM-6B的Github地址:https://github.com/THUDM/ChatGLM-6B

chatGLM-6B的模型地址:https://huggingface.co/THUDM/chatglm-6b

模型下载我这边用的两个方法:一个是下载到本地,然后上传到服务器上;另一个是直接git clone的方式。

下载到本地:

大家都懂得,直接在github的界面,下载压缩包就行,然后放到服务器中解压就会有chatGLM-6B文件夹。但是模型的话,需要把相关文件都要下载下来,部分文件比较小,下载也比较慢!如图所示,把所有文件下载然后上传到服务器就行

Git:

在这之前,有些操作需要执行,我列出来了

更新git-lfs:

apt-get update

apt-get install git-lfs

初始化git:

git init

git lfs install

然后我们就可以下载chatGLM-6B源码了

git clone https://github.com/THUDM/ChatGLM-6B.git

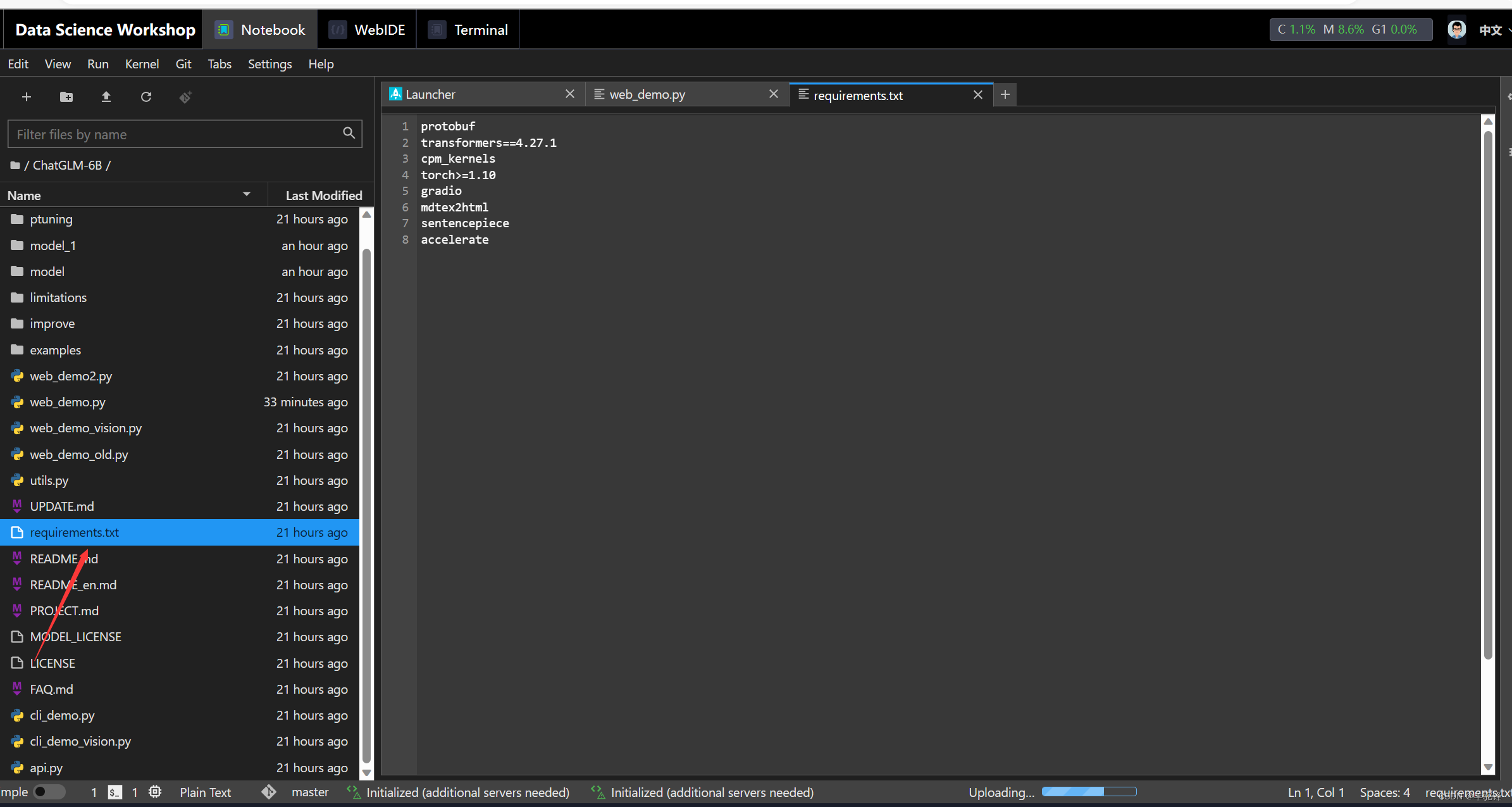

进入到chatGLM-6B文件夹,可以看到有一个requirements文件夹,所以我们需要搭建相关的环境

直接pip install -r requirements就行

创建mymodel文件夹,这里是存放模型和相关文件的,后面demo测试的模型路径是要指向这个文件夹的

mkdir model

cd model

然后进入文件夹后,就是下载模型文件了,我用git的方法一直都不行,容易出问题,推荐大家自己本地下好,然后传到这个文件夹里面去就可以

模型部署测试

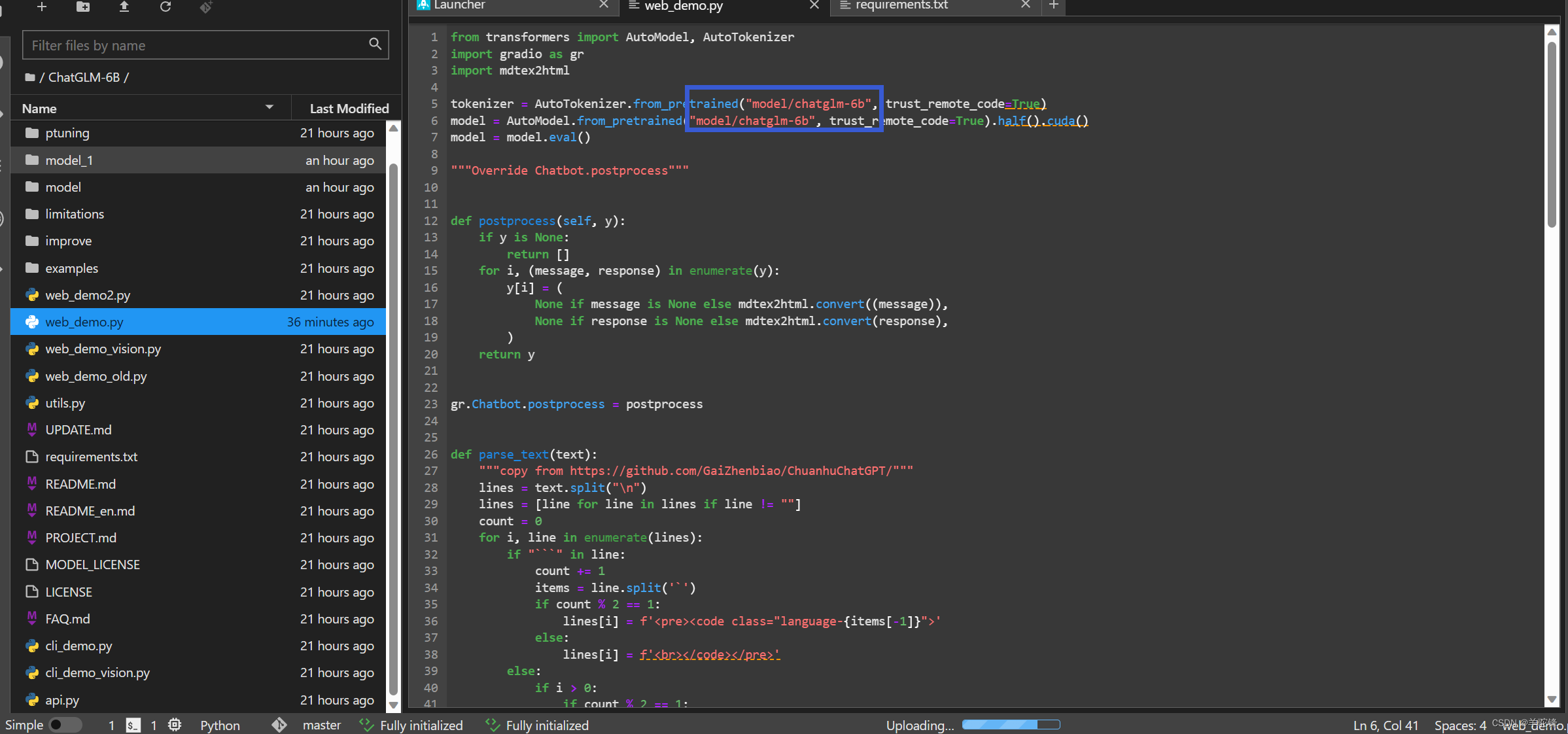

当我们把相关文件都传到服务器,找到chatGLM-6B文件夹中web_demo.py文件,直接点击该文件,把路径改为服务器中你存储的模型的路径,要改的路径就是下图中我用蓝色框框圈出来的,我这里是model/chatglm-6b,记得保存哦!

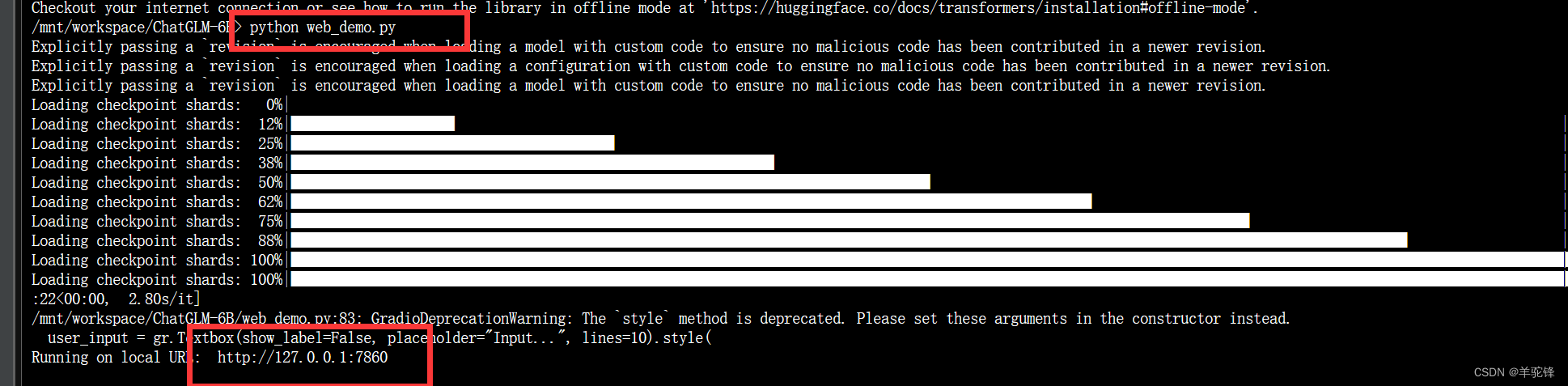

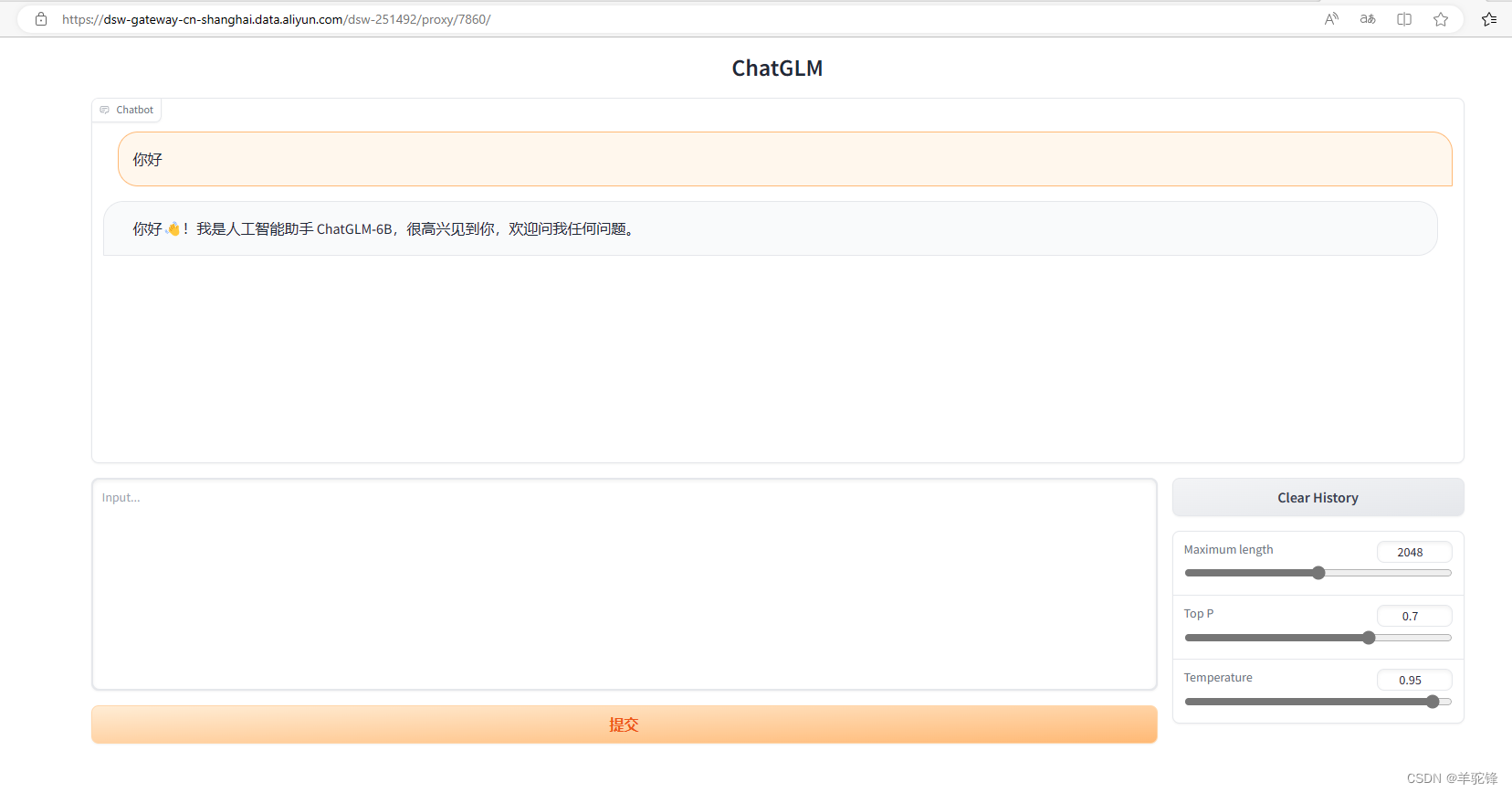

然后服务器终端就可以运行模型啦,运行命令:python web_demo.py后,命令行中会出现一个网址,直接点击就会跳转到chatGLM-6B的界面了,然后就可以对话了,话不多说,看图!