热门标签

热门文章

- 1部署github上的代码到本地pycharm_如何把开源代码导入pycharm

- 2GB2312编码表_、一-…‘、∴n:r一,金,"乓:γ小兵.j‘:。斥,。.。.当事。.??pcpcy小.。白一

- 3斐波那契数列——C语言_斐波那契数列c语言

- 4和硅谷AI专家一起走进美团,探索美团外卖背后的AI大脑

- 5Python 技术篇-百度语音合成SDK接口调用演示

- 6VCSA 和ESXi 6.7.0版本升级_esxi6.5升级7.0后vcsa怎么升级

- 7YOLOv8 测试 5-2:Linux 中 Dockerfile 部署 YOLOv8 项目一键运行,Python 封装 API 接口测试

- 8CTF练习平台_南邮ctf网络攻防训练平台

- 9CSS3 立体 3D 变换

- 10linux各种软件安装平台,linux安装软件的几种方式(kali平台)和一些实用的软件(持续更新)...

当前位置: article > 正文

LangChain+ChatGLM整合LLaMa模型(二)_langchain-chatchat集成 llama-7b

作者:羊村懒王 | 2024-04-11 16:21:47

赞

踩

langchain-chatchat集成 llama-7b

LangChain+ChatGLM大模型应用落地实践(一)

LLaMa模型GitHub地址

git lfs clone https://huggingface.co/huggyllama/llama-7b

- 1

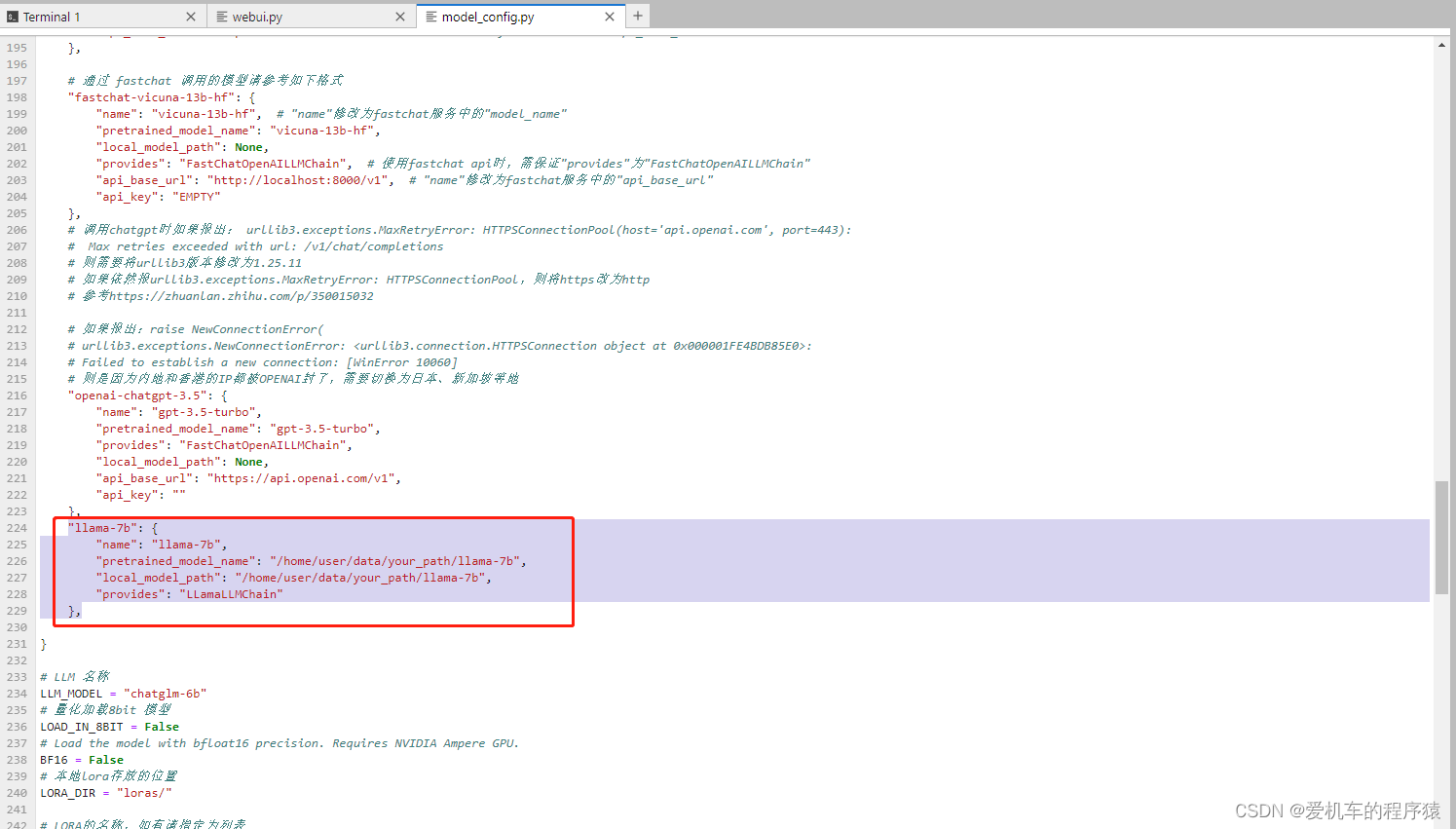

添加LLaMa模型配置

在Langchain-ChatGLM/configs/model_config.py中llm_model_dict添加

"llama-7b": {

"name": "llama-7b",

"pretrained_model_name": "/home/user/data/your_path/llama-7b",

"local_model_path": "/home/user/data/your_path/llama-7b",

"provides": "LLamaLLMChain"

}

- 1

- 2

- 3

- 4

- 5

- 6

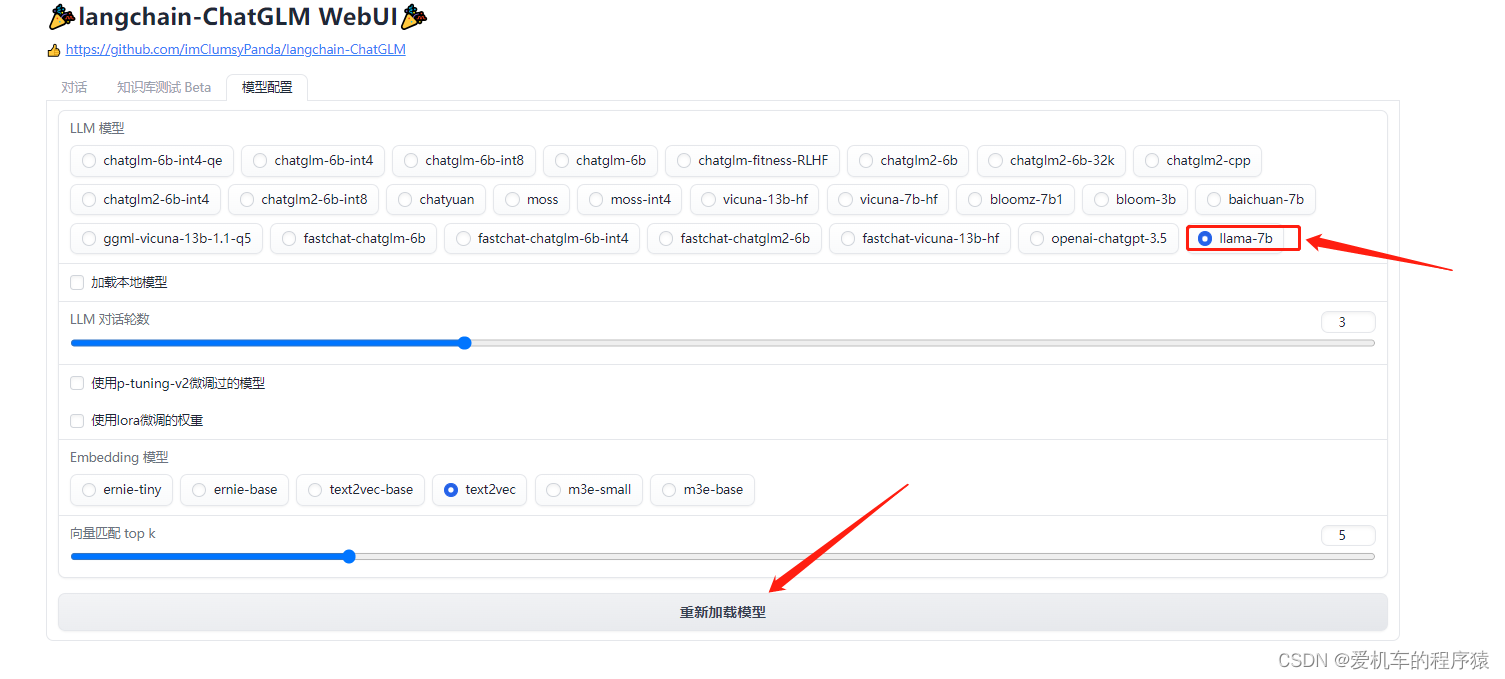

启用LLaMa模型

进入Web UI选择LLaMa模型

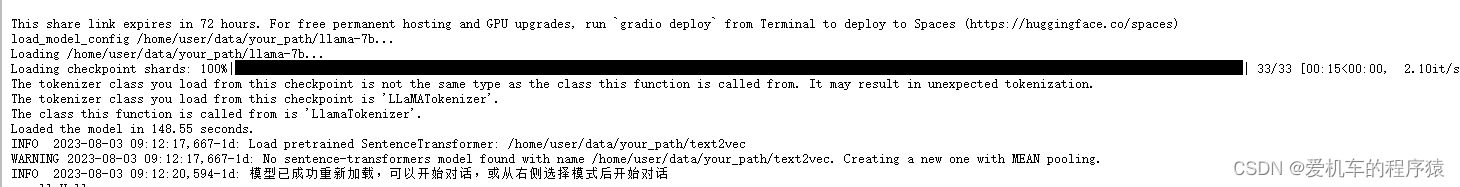

LLAMA-7B(中文提问当作翻译回答了…看来训练的中文语料不太行,但是英文也算是答对了)

具体为什么LLaMa为什么这样回答,等待后续。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/羊村懒王/article/detail/406070

推荐阅读

相关标签