热门标签

热门文章

- 1数据中台-数据分层管理系统_数据中台数据分层

- 2数据结构(C语言版)严蔚敏 习题详解(持续更新!)_cnblogs 数据结构习题 严蔚敏

- 3@OneToOne等注解的使用

- 4HIVE-SQL经典面试题_要求使用hql统计出每个用户每月的访问次数及累积访问次数

- 5UI 自动化测试框架:PO 模式+数据驱动 (全)_ui自动化po模式

- 6如何使用远程桌面连接?

- 7软件测试自学怎么学?【史上最详细学习路线】(附全套资料)_如何自学软件测试

- 8数字逻辑电路复习资料_数字逻辑电路空翻和反转的区别

- 9用Python从零开始创建区块链_基于python做区块链

- 10Java数据结构-哈希表的实现(hash)_java哈希表的实现

当前位置: article > 正文

2024年大数据最新【史上最全】Hadoop精选18道面试题(附回答思路)_hadoop面试题(2),总结到位

作者:知新_RL | 2024-05-06 20:26:30

赞

踩

2024年大数据最新【史上最全】Hadoop精选18道面试题(附回答思路)_hadoop面试题(2),总结到位

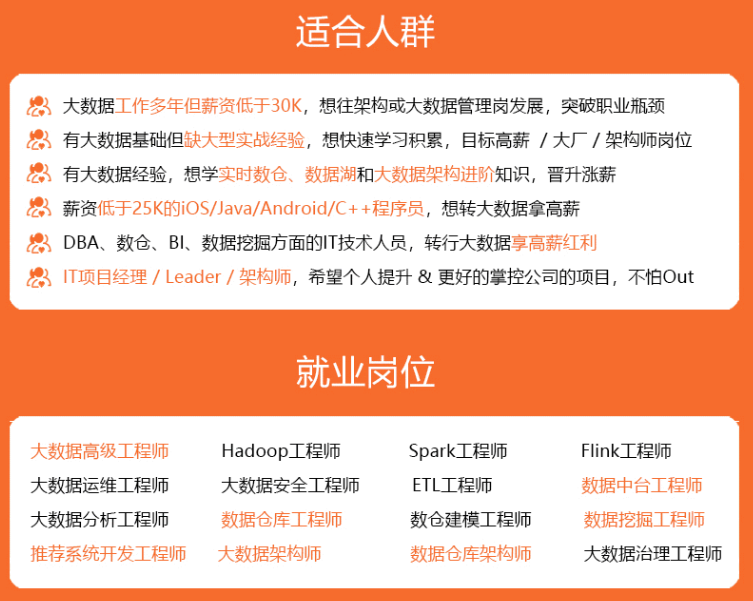

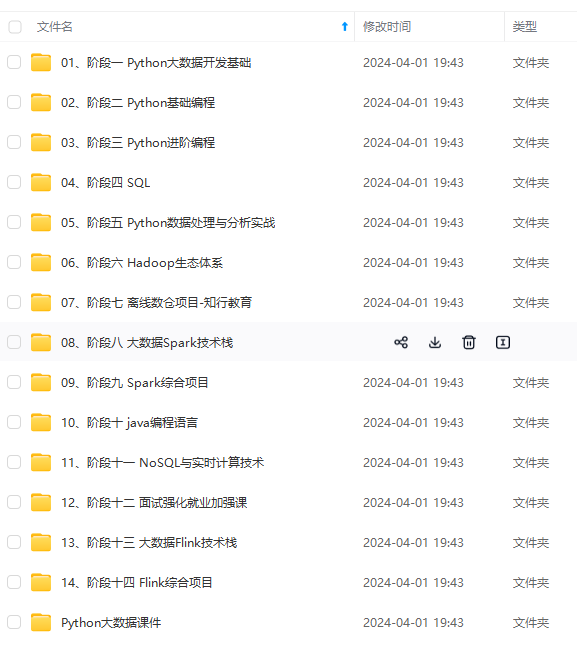

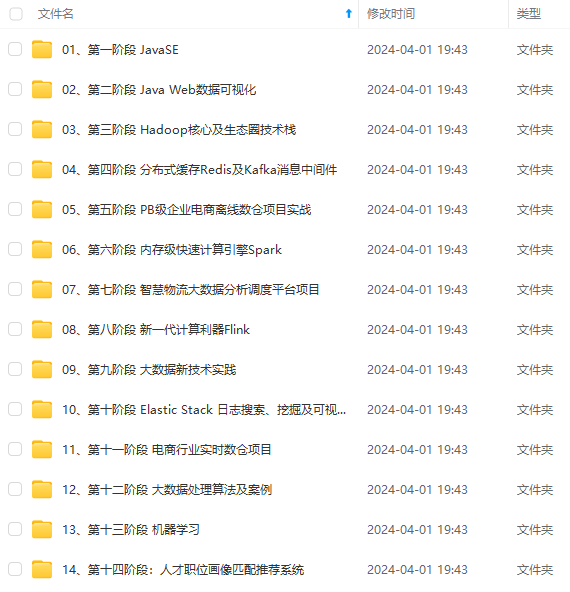

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

副本机制,一式三份

均衡

- 1

- 2

### 3.Hadoop生态系统与Hadoop框架

Hadoop生态系统除Hadoop之外,还包含zookeeper、Flume、Hbase、Hive、Sqoop等辅助框架

### 4.Hadoop核心组件(定义+组成+优点(思想))

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

HDFS 分布式文件系统 提供高吞吐量的数据访问和存储,特别适合大数据集的分布式存储。

NameNode2(Active|Standby)+DataNodeN

具有高容错性 支持流式访问

MapReduce 分布式计算框架 用于大规模数据集的并行处理

Map+Shuffle+Reduce

分而治之 构造抽象模型

YARN 分布式资源管理系统 负责任务调度和集群资源管理

ResourceManager & ApplicationManager

NodeManager

##### HDFS角色

- 1

- 2

- 3

- 4

- 5

NameNode,DataNode,SecondaryNameNode

- 1

##### Hadoop架构

- 1

- 2

- 3

- 4

- 5

HDFS——分布式文件系统

MapReduce——分布式计算框架

YARN——分布式资源管理系统

Commons

- 1

- 2

- 3

- 4

### 5.Block大小 如果一个文件小于128M,它只占用文件本身大小的空间,其它空间别的文件也能用。 Block大小设置主要取决于磁盘传输速率。 (把文件分为N块,读取文件时就要寻址N次) ### 6.NameNode与SecondaryNameNode的区别与联系 区别 1)NameNode存储了文件系统下所有目录和文件的访问,修改,执行时间,块大小,执行权限等 2)SecondaryNameNode并非NameNode的热备(≠ StandBy NameNode)。定期触发CheckPoint(服务),代替NameNode合并EditLog和fsimage文件。 联系 1)SecondaryNameNode中保存了一份和NameNode一致的fsimage和edits文件。但是,NameNode还有一份正在使用的编辑日志edit\_inporgress,这是SecondaryNameNode没有的。 2)在主namenode发生故障时(假设没有及时备份数据),可以从SecondaryNameNode恢复历史的数据。 ### 7.SecondaryNameNode的目的是什么 SecondaryNameNode定期触发CheckPoint,代表NameNode合并编辑日志EditLog和镜像文件Fsimage,从而减小EditLog的大小,减少NN启动时间。 同时在合并期间,NameNode也可以对外提供写操作。 ### 8.HDFS的读/写数据流程 HDFS的写(上传)数据流程  1)HDFS client创建DFS对象,通过该对象向NameNode请求上传文件,NameNode检查权限,并判断该目标文件是否已存在。 2)如果权限许可,目标文件也存在,NameNode响应请求。 3)客户端请求第一个Block上传到哪几台DataNode服务器上。 4)NameNode返回3个DataNode结点 5)HDFS client创建FS DataOutputStream数据流对象,请求dn1建立传输通道,dn1接收到请求之后会继续调用dn2建立通道… 6)传输通道建立完成之后,dn1,dn2,dn3逐级应答客户端。 7)客户端开始往dn1上传第一个Block,dn1利用通道传向dn2,dn2利用通道传向dn3…(直到传到Block副本应在的位置停止) 8)当一个Block传输完成之后,客户端再次请求NameNode上传第二个Block到服务器。(重复3-7步) HDFS的读数据流程  1)HDFS client创建DFS对象,该对象向NameNode请求下载文件,NameNode通过查询元数据,找到文件块所在的DataNode地址。 2)挑选一台DataNode(要考虑结点距离最近选择原则,DataNode负载均衡)服务器,请求读取数据。 3)数据从DataNode传到客户端,如果在传输过程中出现宕机,才会考虑向含有该副本的其他节点获取数据。 4)客户端接收,写在本地缓存,然后写入目标文件。 ### 9.请简述DataNode的工作机制 1)一个数据块在DataNode上以文件的形式存储在磁盘上,包括两个文件,一个是数据本身,一个是元数据的校验信息。 2)DataNode 启动后向 NameNode 注册,之后周期性(默认 6 小时)的向 NameNode 上报所有的块信息。同时,DN 扫描自己节点块信息列表的时间,检查DN中的块是否完好,如果某块磁盘损坏,就将该块磁盘上存储的所有 BlockID报告给NameNode。 3)心跳是每 3 秒一次,心跳返回结果带有 NameNode 给该 DataNode 的命令如复制块数据到另一台机器,或删除某个数据块。 如果超过 10 分钟 + 30s 没有收到某个 DataNode 的心跳,则认为该节点不可用。 ### 10.如果数据误删,如何抢救? 1.立即关闭Hadoop服务 2.打开edit\_log文件,删除未发送的心跳包的命令 ### 11.如何理解Hadoop中的数据倾斜现象? A.可能因为HDFS的存储不均衡:可能的原因是后扩展了集群的几台机器 B.使用默认的HashPartitoner C.输入数据中不均匀的键分布 解决方法:执行 /opt/software/hadoop-3.1.3/sbin/start-balancer.sh ### 12.Namenode和Datanode的心跳机制: 心跳是datanode向namenode发送的小数据包,表明它是活跃的。默认情况下, 每3秒datanode就会向namenode发送一次心跳信号。如果namenode在10分钟内 没有收到任何datanode的心跳,它会将该datanode标记为“死亡”,并开始数据 的复制过程,将其复制到其他datanode,以保持数据的冗余和可靠性。 ### 13.Safe Mode Safe Mode是HDFS的一种状态,在此状态下,系统处于只读模式,不会进行数据块的复制或删除。 这通常用于系统维护或故障恢复。 管理员可以使用命令"hdfs dfsadmin -safemode enter"进入安全模式,"hdfs dfsadmin -safemode leave"退出安全模式,而"hdfs dfsadmin -safemode get"则用来查询系统是否处于安全模式。 ### 14.Hadoop启动流程 首先,启动HDFS,通常包括启动namenodes,datanodes和secondary namenodes。 其次,启动YARN的资源管理器和节点管理器。    **既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!** **由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新** **[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)** 深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!** **由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新** **[需要这份系统化资料的朋友,可以戳这里获取](https://bbs.csdn.net/topics/618545628)**

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

- 97

- 98

- 99

- 100

- 101

- 102

- 103

- 104

- 105

- 106

- 107

- 108

- 109

- 110

- 111

- 112

- 113

- 114

- 115

- 116

- 117

- 118

- 119

- 120

- 121

- 122

- 123

- 124

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/知新_RL/article/detail/545796

推荐阅读

相关标签