- 1linux下实现简单的进度条_linux系统界面用图片实现进度条

- 2FPGA仿真类型详解_寄存器传输级

- 3如何更改conda环境位置_更改conda环境安装目录

- 4PyTorch中torch、torchvision、torchaudio版本对应关系_windows torchaudio torch对应关系

- 5vue项目中实现elementui多语言切换_element ui 多语言

- 6Centos7安装elasticsearch-常见问题-yoguo_启动elastic 不能返回json

- 7GPT如何快速写论文_gpt3.5如何写论文

- 8macOS Big Sur 11.6.5 (20G527) Boot ISO 原版可引导镜像

- 9JSON parse error: Illegal unquoted character ((CTRL-CHAR, code 10)): has to be escaped using backsla

- 10LeetCode1047:删除字符串中的所有相邻重复项

如何跑ChatGLM2-6B模型呢_ubuntu chatglm2-6b web_demo.py显示无滚屏

赞

踩

随着今年ChatGPT的爆火,出现了一系列大模型,现在听到最多的是ChatGLM2-6B,今天用趋动云AI训练平台跑个ChatGLM2-6B模型;这个平台现在注册可以领取168元算力金,可以注册领取下,电脑端登录后跟着我一起跑下。

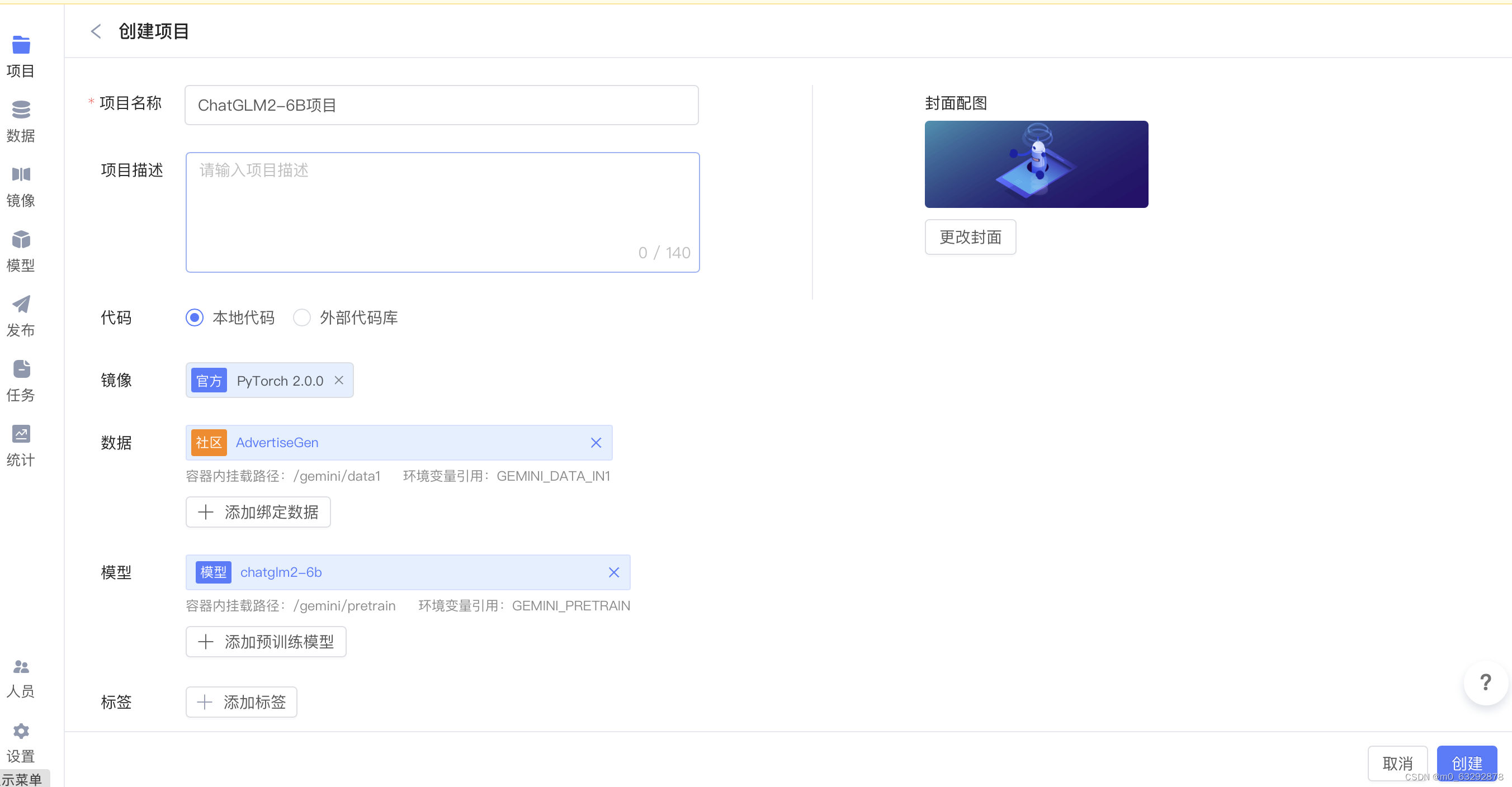

- 新建项目

项目名称:可自定义,如 “ChatGLM2-6B项目

代码:选择 本地代码。

镜像:选择 官方 镜像 PyTorch 2.0.0。

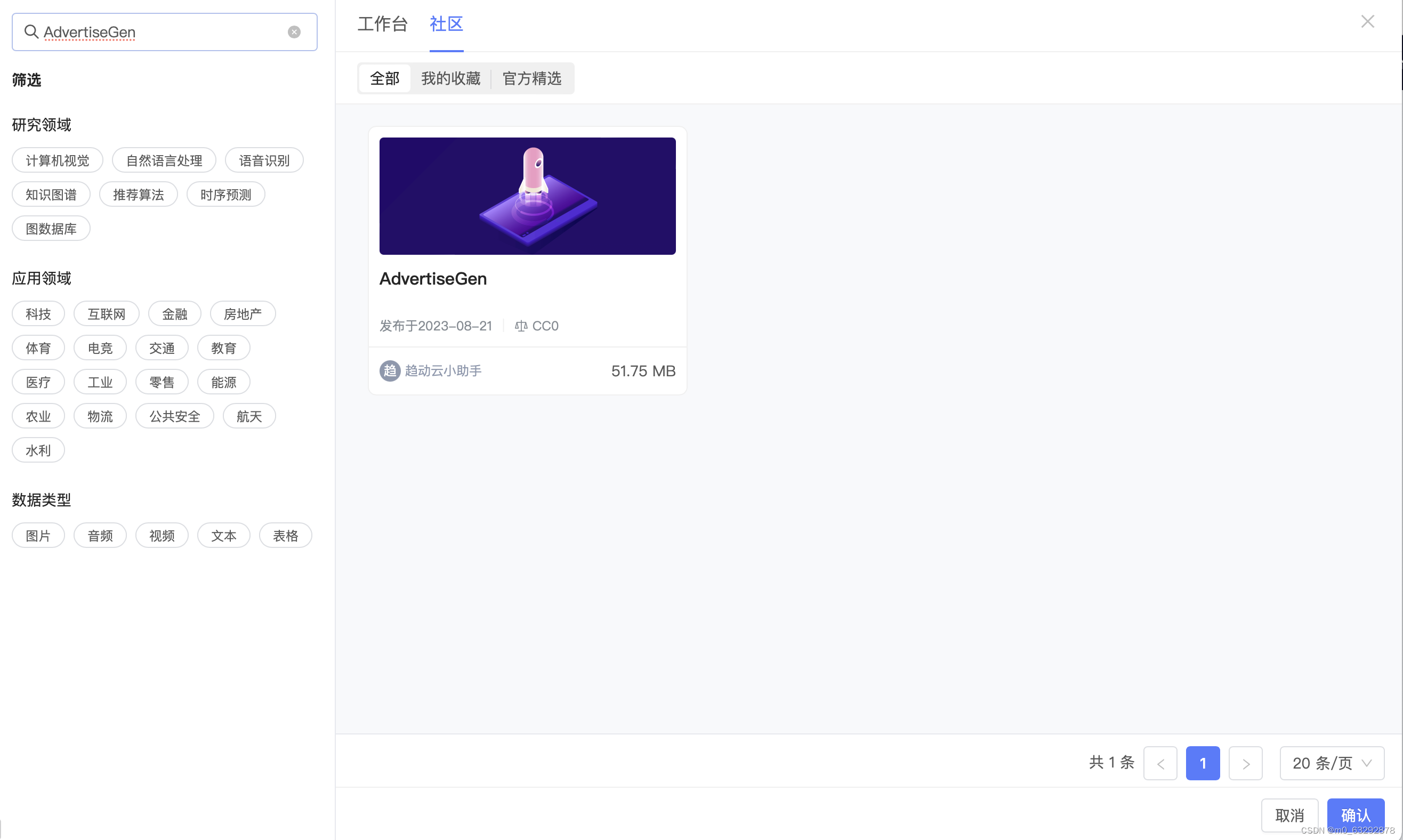

数据:选择 社区 > 全部 下的 AdvertiseGen 数据集。

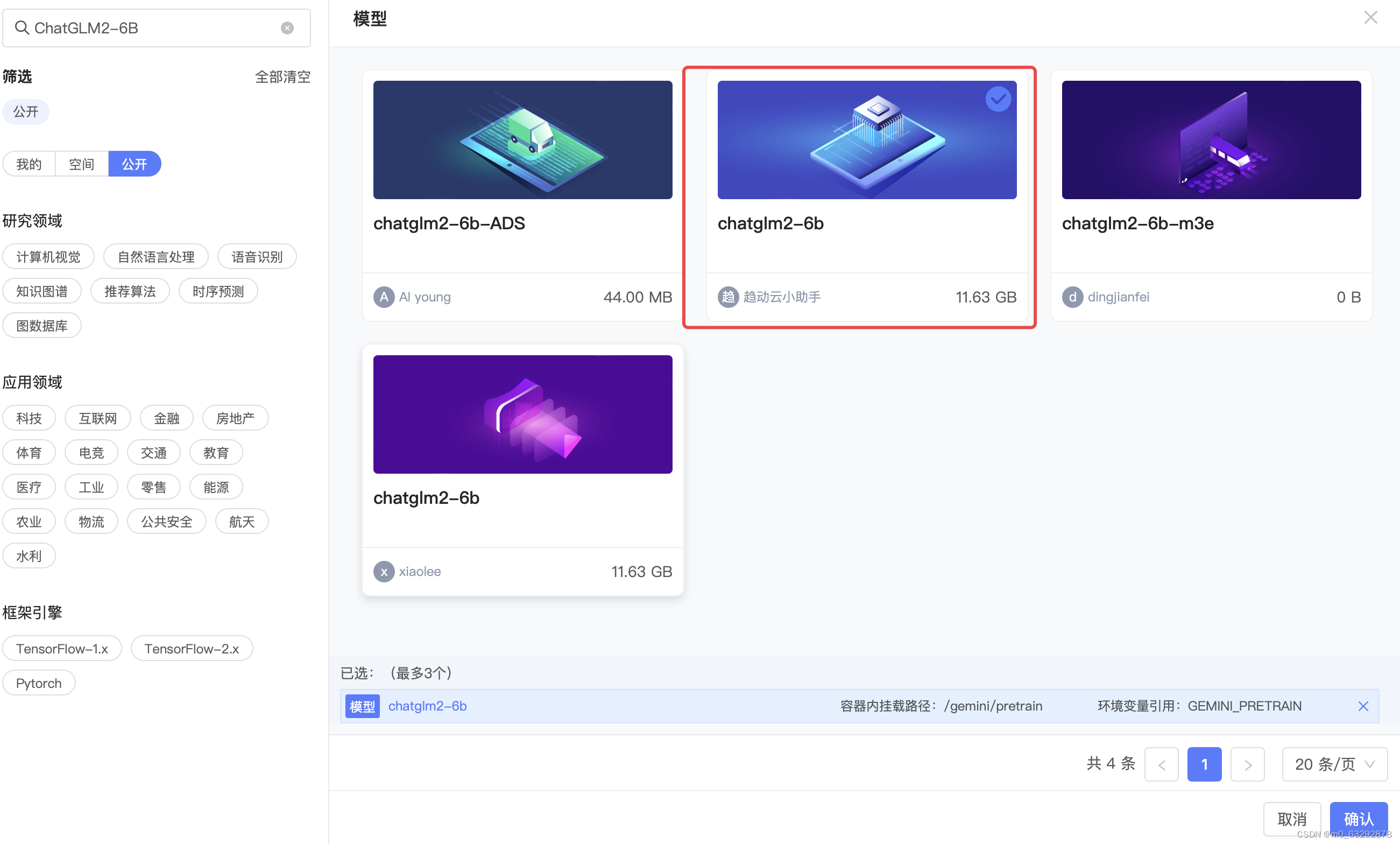

模型:选择 公开 下的 chatglm2-6b(作者为 “趋动云小助手”)

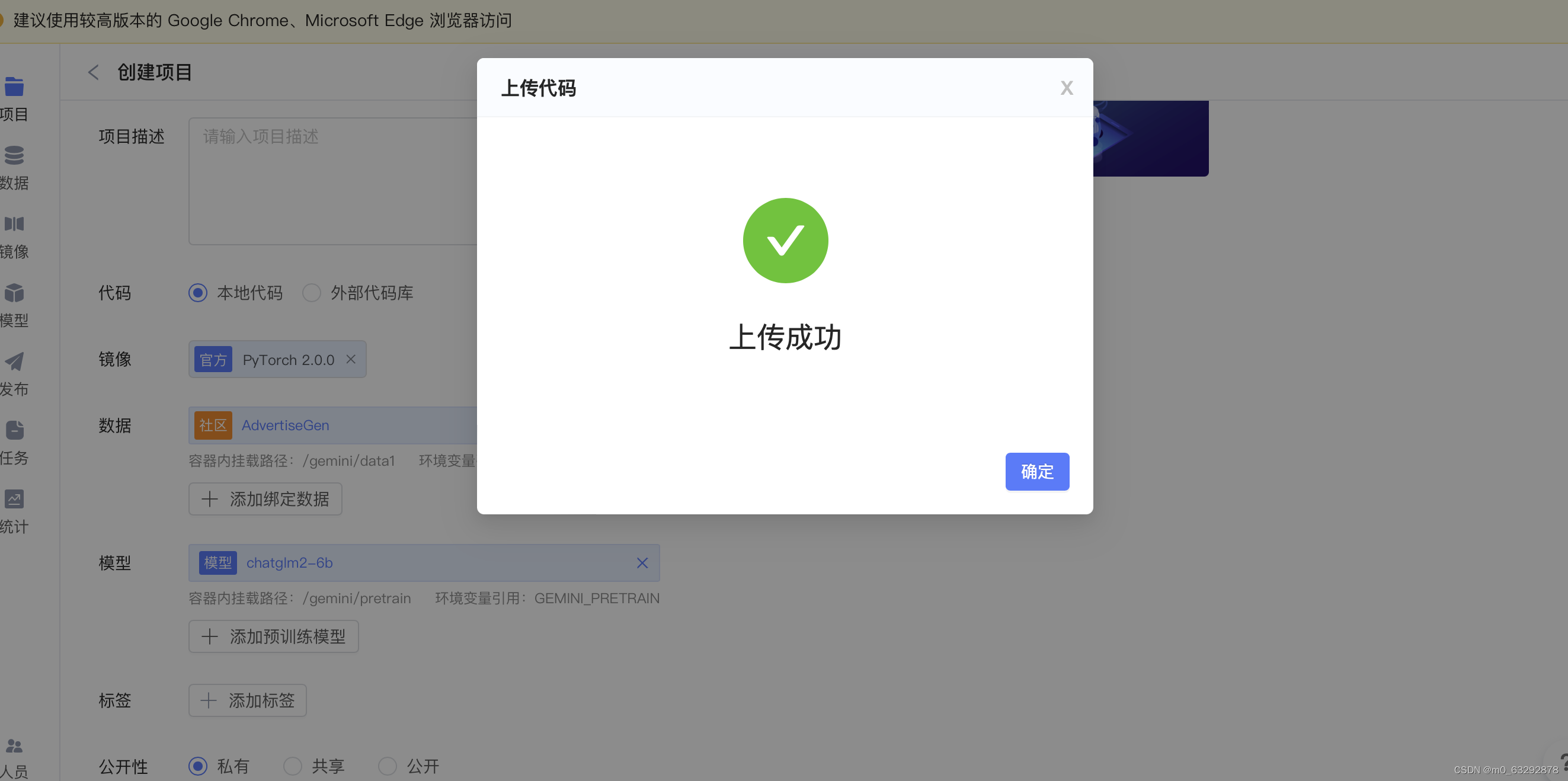

单击 创建,创建成功,同时弹出 上传代码 框。

通过趋动云文档中心获取代码,压缩包直接拖拽至 上传代码 框中,随后单击 确定。也可通过 git clone https://github.com/THUDM/ChatGLM2-6B 获取

上传成功

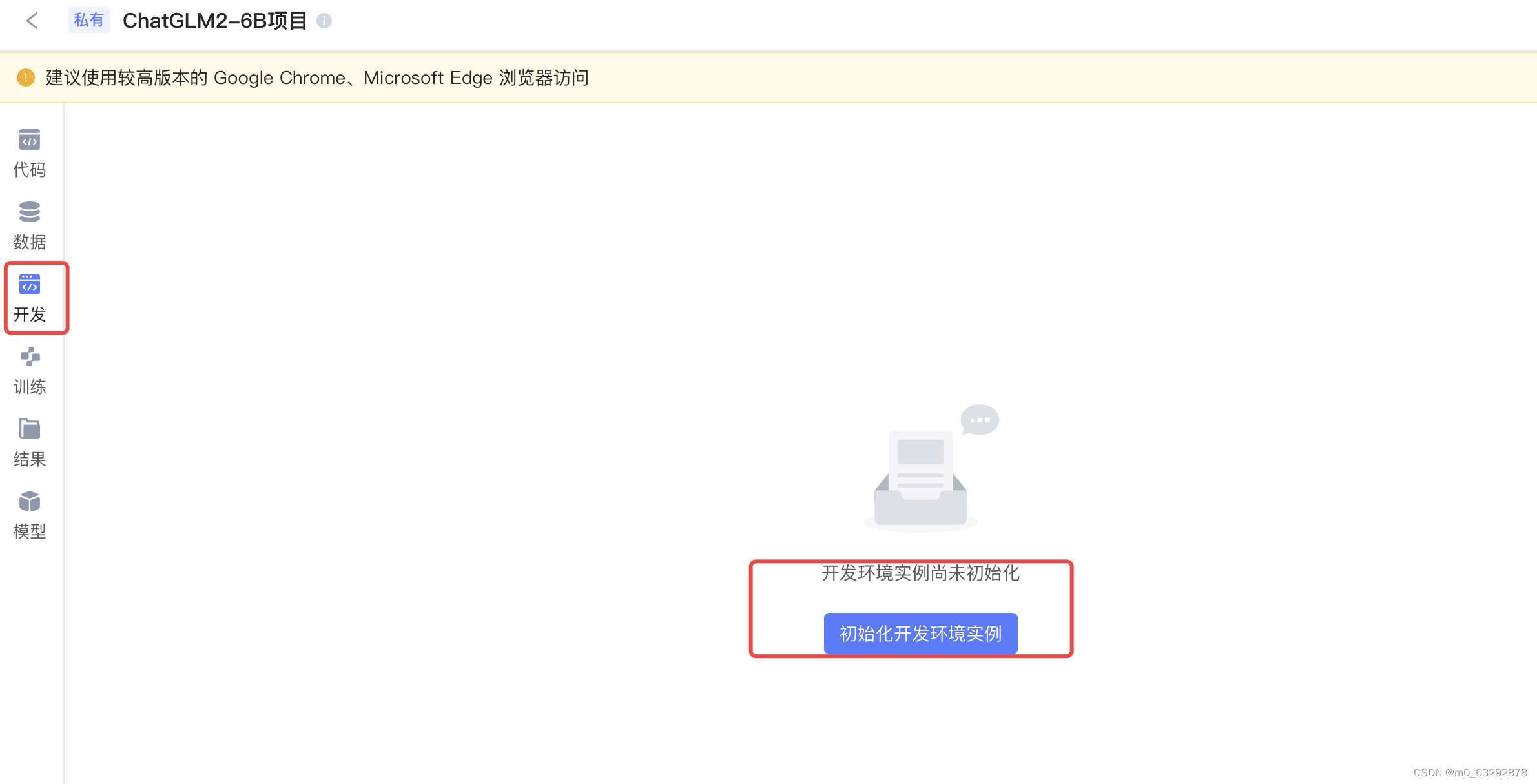

点击开发功能,选择初始化开发环境实例

选择B1.large;删除默认的2.0镜像,更改为ChatGLM2-6B_PyTorch2.0.1(作者为“趋动云小助手”);开放端口填写77,填写用途

开发环境实例 页单击 进入开发环境。

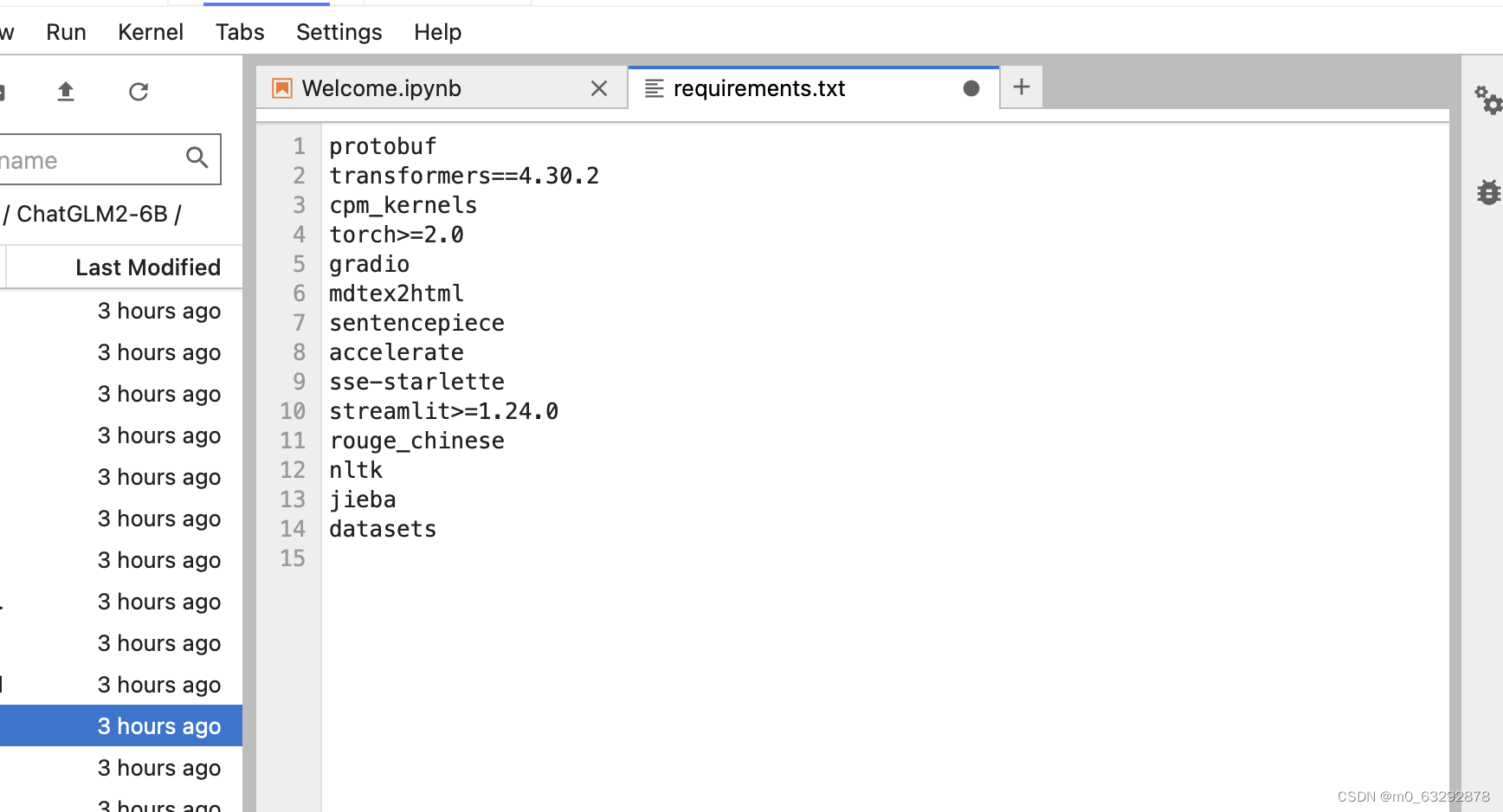

左侧目录进入 ChatGLM2-6B/requirements.txt,增加如下内容并保存,可参考下图

rouge_chinese

nltk

jieba

datasets

切换至网页终端

进入代码目录 ChatGLM2-6B,执行安装

cd ChatGLM2-6B/

pip install -r requirements.txt -i https://pypi.virtaicloud.com/repository/pypi/simple

等待约 1-2 分钟执行完,执行过程中无 error 报错,则安装成功

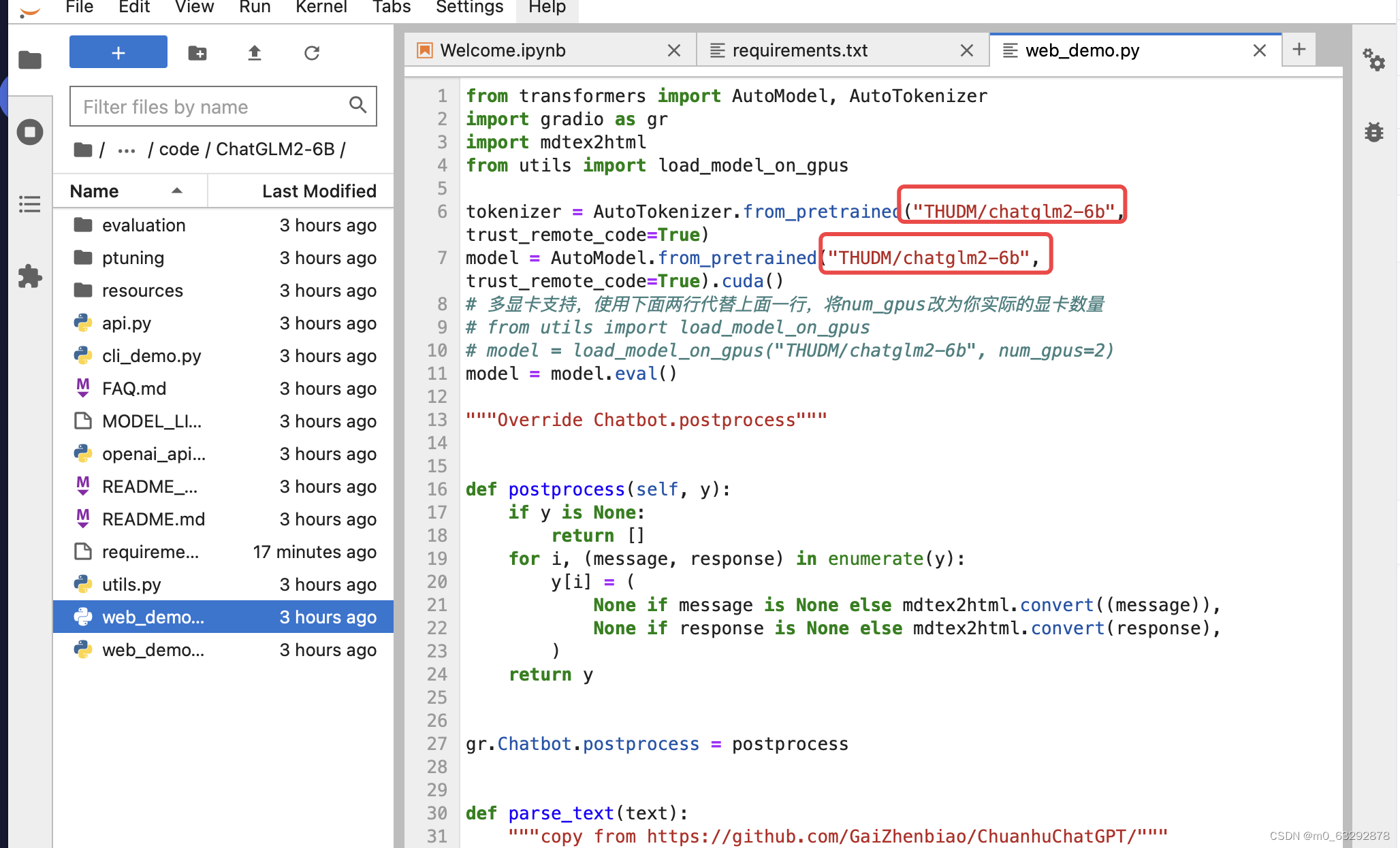

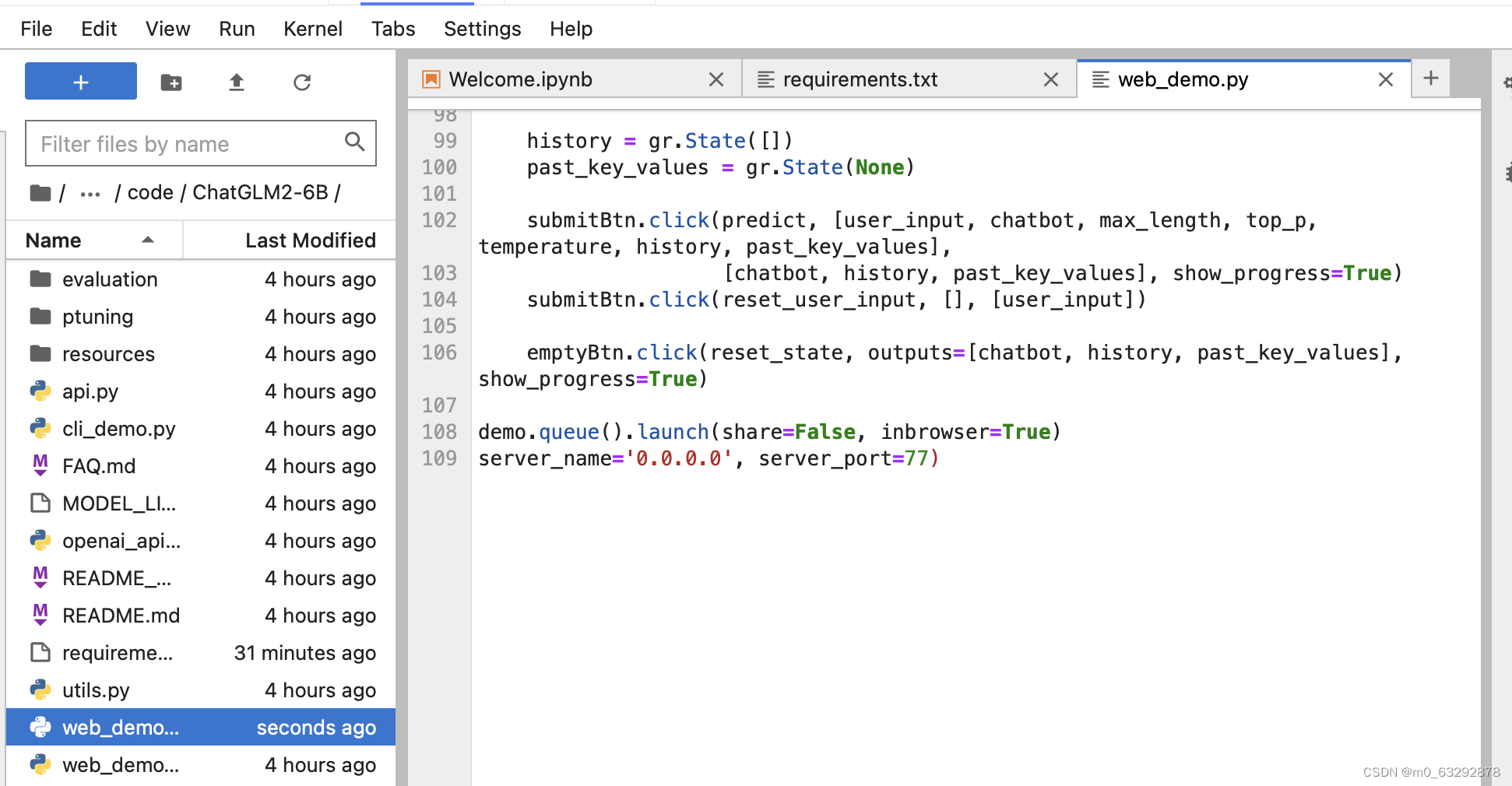

切换至 JupyterLab,并修改 web_demo.py 中模型的地址。

修改模型地址,即替换 THUDM/chatglm2-6b 为 /gemini/pretrain (模型实际挂载到环境的地址)。

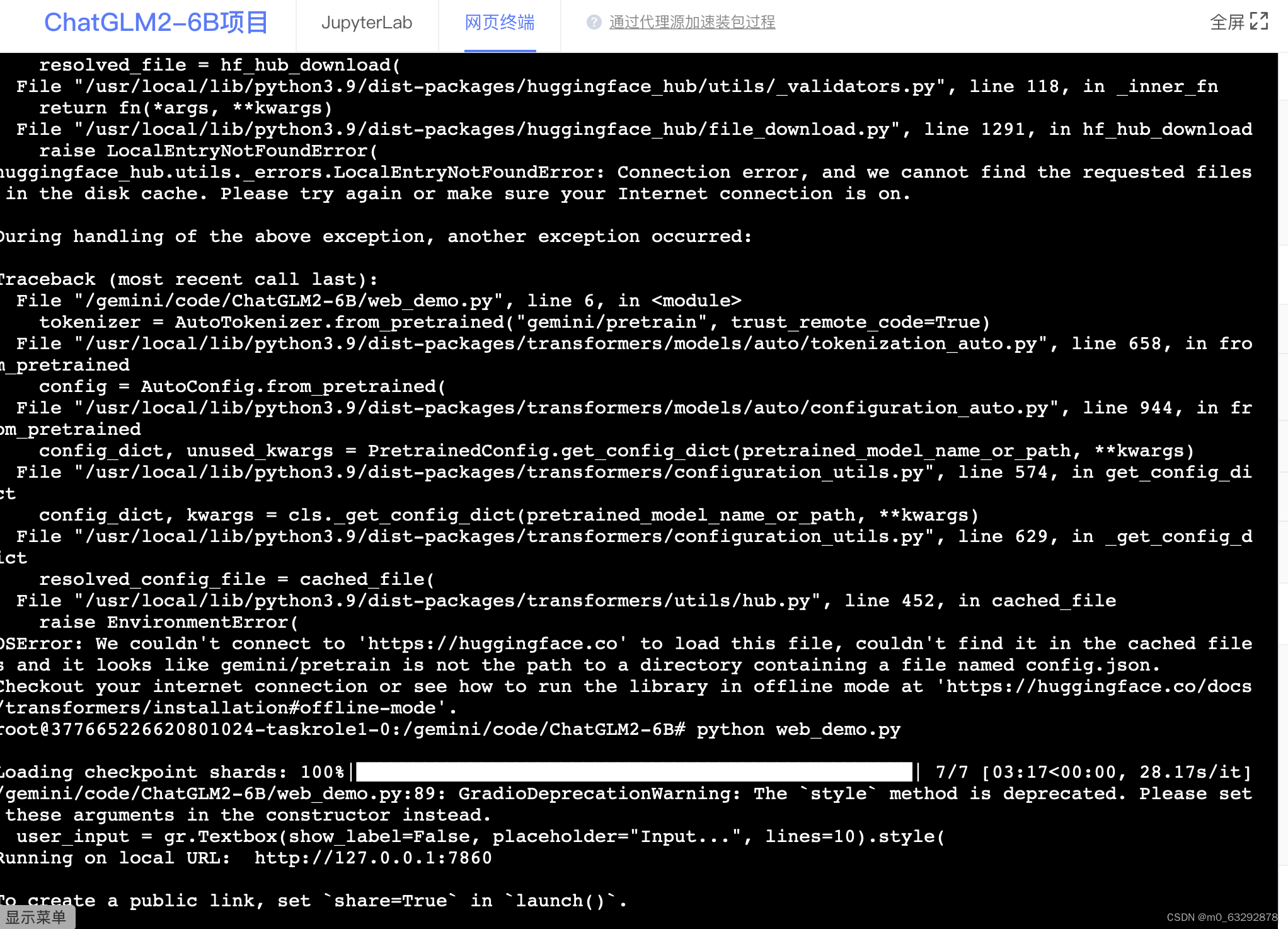

切换至 网页终端,在 ChatGLM2-6B 目录下执行如下命令将模型加载为网页形式。

运行python web_demo.py

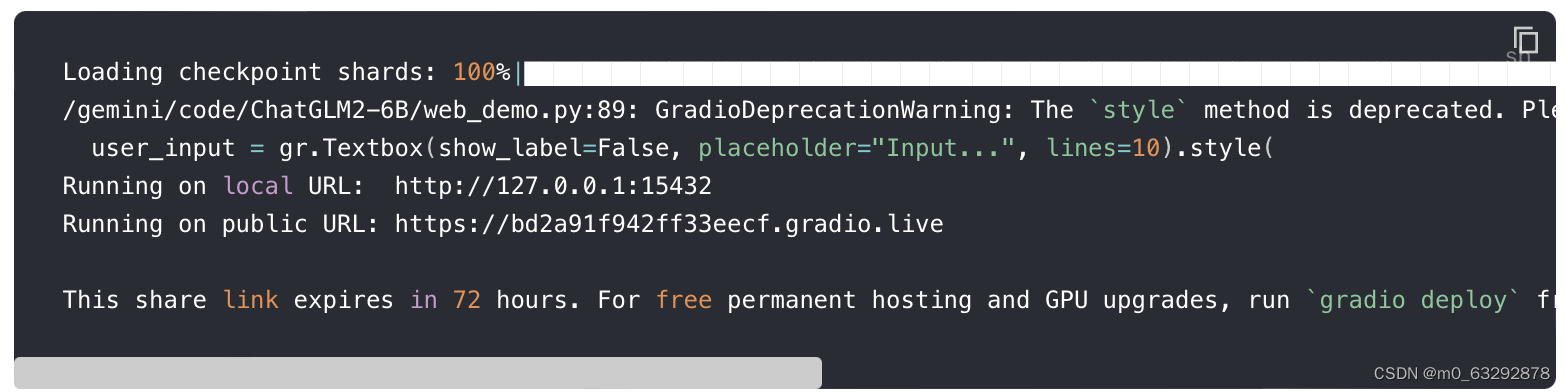

等待系统最终返回如下信息,则加载成功。

如果返回 “To create a public link, set share=True in launch().”,可能是 frpc 下载与安装失败,可在代码中设置程序本地运行以规避。

在 web_demo.py 最后一行增加 server_name='0.0.0.0', server_port=xx 设置为本地运行该程序。形如:其中 77 为您添加的端口,请根据实际情况填写。

保存后,再重新执行模型加载指令。

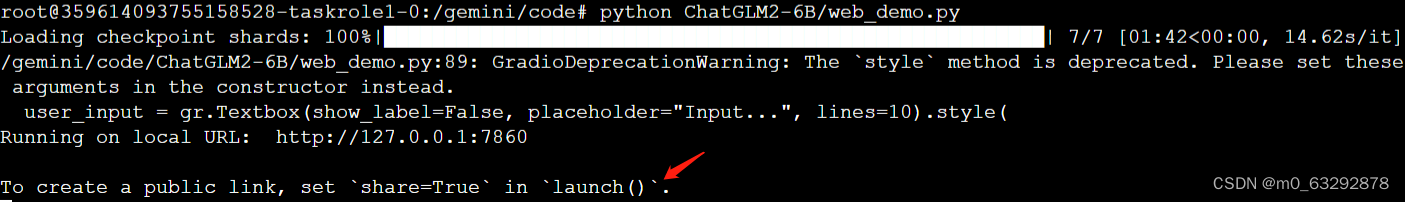

python web_demo.py

等待返回如下信息

复制外部访问信息,并以 http协议在浏览器中访问。

欢迎小伙伴们跟着一起跑哦,如果有不清楚的地方欢迎私信联系。