- 1【多传感融合】优达学城多传感融合学习笔记(三)——将激光雷达3D点云映射到相机图像(上)_激光雷达投影到图像

- 2自定义注解实现复杂情况的幂等校验(接口防重提交)_注解方式 实现幂等

- 3【数据库表的快照】如何优雅的做postgresql快照表

- 4AI大模型引领未来智慧科研暨ChatGPT自然科学高级应用

- 5基于springboot+vue的在线作业管理考试系统 elementui_基于springboot+vue的智能在线考试系统的设计与实现

- 62020年“金九银十”的面试宝典:腾讯,字节等大厂面试真题汇总_“金九银十”一线大厂面试专题

- 7Java面试题总结汇总_js中俩种主要的对象模型及功能

- 8oracle11g千万条数据分区_恩墨学院 | 详述Oracle11g因JDBC bug引发异常Library Cache Lock等待处理事件...

- 9Es中bool 查询中的四个(must must_not should filter)_es bool should

- 10各种排序算法的比较_各种排序算法的最好最坏情况

Tensorflow2.0—FaceNet网络原理及代码解析(一)--- 模型原理及骨干网络_tensorflow2 加载facenet模型

赞

踩

Tensorflow2.0—FaceNet网络原理及代码解析(一)— 模型原理及骨干网络

FaceNet其实就是一个前言所诉的通用人脸识别系统:采用深度卷积神经网络(CNN)学习将图像映射到欧式空间。空间距离直接和图片相似度相关:同一个人的不同图像在空间距离很小,不同人的图像在空间中有较大的距离,可以用于人脸验证、识别和聚类。在800万人,2亿多张样本集训练后,FaceNet在LFW数据集上测试的准确率达到了99.63%,在YouTube Faces DB数据集上,准确率为95.12%。

代码:FaceNet

一、算法原理

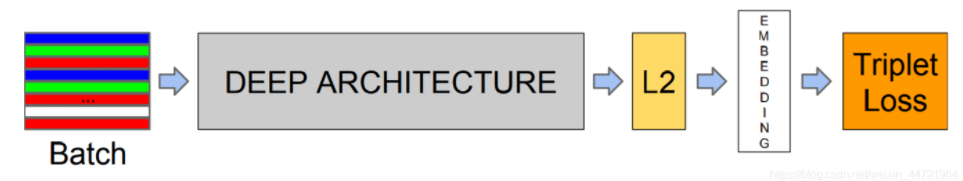

上图是facenet的大体框架示意图,可以看到,一个batch的训练图片经过一个黑盒子进行特征提取。其中,DEEP ARCHITECTURE这个部分一般是一个比较成熟的backbone,最早的FaceNet采用两种深度卷积网络:经典Zeiler&Fergus架构和Google的Inception v1。最新的FaceNet进行了改进,主体模型采用一个极深度网络Inception ResNet -v2,由3个带有残差连接的Inception模块和1个Inception v4模块组成。在代码实现中通常使用mobilenet或者inception_resnetv1作为骨干网络。

经过了特征提取之后进行L2标准化,然后得到一个128维的向量。

最后,进行Triplet loss计算。

下面,按照每个模块进行介绍~

二、骨干网络

在这里,我们选取mobilenet作为骨干网络。

在代码中,backbone = "mobilenet",然后代入model = facenet(input_shape, num_classes, backbone=backbone, mode="train"),mobilenet实现的代码全部在nets/mobilenet.py中。

def _conv_block(inputs, filters, kernel=(3, 3), strides=(1, 1)):

x = Conv2D(filters, kernel,

padding='same',

use_bias=False,

strides=strides,

name='conv1')(inputs)

x = BatchNormalization(name='conv1_bn')(x)

return Activation(relu6, name='conv1_relu')(x)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

这是典型的卷积-BN-激活模块,没啥好说的~

def _depthwise_conv_block(inputs, pointwise_conv_filters, depth_multiplier=1, strides=(1, 1), block_id=1): x = DepthwiseConv2D((3, 3), padding='same', depth_multiplier=depth_multiplier, strides=strides, use_bias=False, name='conv_dw_%d' % block_id)(inputs) x = BatchNormalization(name='conv_dw_%d_bn' % block_id)(x) x = Activation(relu6, name='conv_dw_%d_relu' % block_id)(x) x = Conv2D(pointwise_conv_filters, (1, 1), padding='same', use_bias=False, strides=(1, 1), name='conv_pw_%d' % block_id)(x) x = BatchNormalization(name='conv_pw_%d_bn' % block_id)(x) return Activation(relu6, name='conv_pw_%d_relu' % block_id)(x)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

该模块不同于上述模块,是因为其中包含了一个DepthwiseConv2D,他与普通的Conv2D的区别就是:conv2d在每一深度上卷积,然后求和,depthwise_conv2d卷积,不求和。

具体的可以参考:https://blog.csdn.net/u010879745/article/details/108043183

def MobileNet(inputs, embedding_size=128, dropout_keep_prob=0.4, alpha=1.0, depth_multiplier=1): # 160,160,3 -> 80,80,32 x = _conv_block(inputs, 32, strides=(2, 2)) # 80,80,32 -> 80,80,64 x = _depthwise_conv_block(x, 64, depth_multiplier, block_id=1) # 80,80,64 -> 40,40,128 x = _depthwise_conv_block(x, 128, depth_multiplier, strides=(2, 2), block_id=2) x = _depthwise_conv_block(x, 128, depth_multiplier, block_id=3) # 40,40,128 -> 20,20,256 x = _depthwise_conv_block(x, 256, depth_multiplier, strides=(2, 2), block_id=4) x = _depthwise_conv_block(x, 256, depth_multiplier, block_id=5) # 20,20,256 -> 10,10,512 x = _depthwise_conv_block(x, 512, depth_multiplier, strides=(2, 2), block_id=6) x = _depthwise_conv_block(x, 512, depth_multiplier, block_id=7) x = _depthwise_conv_block(x, 512, depth_multiplier, block_id=8) x = _depthwise_conv_block(x, 512, depth_multiplier, block_id=9) x = _depthwise_conv_block(x, 512, depth_multiplier, block_id=10) x = _depthwise_conv_block(x, 512, depth_multiplier, block_id=11) # 10,10,512 -> 5,5,1024 x = _depthwise_conv_block(x, 1024, depth_multiplier, strides=(2, 2), block_id=12) x = _depthwise_conv_block(x, 1024, depth_multiplier, block_id=13) # 1024 x = GlobalAveragePooling2D()(x) # 防止网络过拟合,训练的时候起作用 x = Dropout(1.0 - dropout_keep_prob, name='Dropout')(x) # 全连接层到128 # 128 x = Dense(embedding_size, use_bias=False, name='Bottleneck')(x) x = BatchNormalization(momentum=0.995, epsilon=0.001, scale=False, name='BatchNorm_Bottleneck')(x) # 创建模型 model = Model(inputs, x, name='mobilenet') return model

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

上述就是mobilenet的网络结构,看得出来,实现起来很简洁明了,(160,160,3)的输入图片经过了DEEP ARCHITECTURE之后生成了一个(5,5,1024)的feature map,然后进行了一次GlobalAveragePooling2D(全局平均池化),GAP介绍在这个blog我做了简单的GAP的介绍。GAP层将(5,5,1024)变成了(1,1,1024),再做一次Dropout,最后连接一个全连接层,让其变为长度是128的向量。

if mode == "train":

#-----------------------------------------#

# 训练的话利用交叉熵和triplet_loss

# 结合一起训练

#-----------------------------------------#

logits = Dense(num_classes)(model.output) #(None,10575)

softmax = Activation("softmax", name = "Softmax")(logits) #(None,10575)

normalize = Lambda(lambda x: K.l2_normalize(x, axis=1), name="Embedding")(model.output) #(None,128)

combine_model = Model(inputs, [softmax, normalize])

return combine_model

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

最后,将经过backbone生成的(None,128)向量连接一个全连接层和一个softmax激活。另外,将(None,128)进行L2标准化操作。