- 1Linux系统 MySQL-8.3.0安装流程_linux安装mysql8.3

- 2【Linux】计算机操作系统和软硬件体系结构_硬件架构和操作系统

- 3两万字自动驾驶技术综述,你想知道的这里都有_velofcn

- 4【Java秒杀方案】4. rabbitMQ 3.8.5安装 erlang_23 jdk1.8 centos7 Springboot 集成 starter Exchange RabbitMQConfig_rabbitmq3.8.5

- 5当世界加速离你而去

- 6Linux/Debian/Ubuntu系统中apt/apt-get的20个常见命令

- 7Java vs Kotlin,开发人员应该首选哪种语言?

- 8idea 2019.3 破解 (亲测有效)_intellij idea 2019.1.3 x64验证码

- 9成为优秀的技术管理者: 先从改变思维做起

- 10手机在网状态多方面重要性

【Peter Dayan】自然和人工强化学习的结合、以及未来的发展方向

赞

踩

深度强化学习实验室

官网:http://www.neurondance.com/

论坛:http://deeprl.neurondance.com/

来源:AI科技评论

作者:Mr Bear、青暮

德国马克斯·普朗克生物控制论研究所所长Peter Dayan讲述了主题为《The Wedding of Neural and Artificial Reinforcement Learning》的报告,从脑认知启发、算法设计两个方面介绍了如何将自然强化学习和人工强化学习结合起来,并指出了该领域具有研究前景的几个方向。

图 1:自然和人工强化学习的联姻

Peter Dayan以应用机器学习和人工智能中的贝叶斯方法来理解神经功能而闻名,尤其是将神经递质水平与预测误差、贝叶斯不确定性相关联的研究。

他是强化学习领域的先驱,帮助开发了 Q 学习算法,并为无监督学习做出了贡献,包括神经网络的wake-sleep算法和亥姆霍兹机。他是《理论神经科学》的合著者,这是一本很有影响力的计算神经科学教科书。在获得博士学位后,Dayan 曾在索尔克研究所与 Terry Sejnowski 和Geoffrey Hinton 一起做博士后研究。

以下是报告原文,AI科技评论进行了不改变原意的整理。

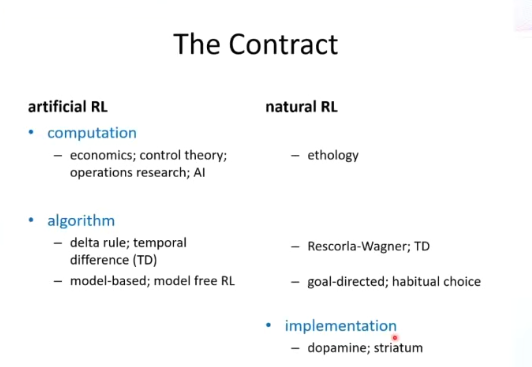

图 2:人工强化学习和自然强化学习之间的异同

人工强化学习和自然强化学习有着千丝万缕的联系,这两个领域有许多相似的机制。从计算的角度来说,人工强化学习从经济学、控制论、运筹学、人工智能等领域出发寻找灵感,而自然强化学习则受到了动物行为学的启发,即研究动物适应新环境而最大化奖励、最小化惩罚的机制。从算法的角度来看,人工强化学习研究者发展出了各种学习规则。从自然的角度来说,心理学家在过去的一百多年中针对动物的奖励、惩罚机制开展了大量研究。

人们在这两个领域的算法研究有着千丝万缕的联系。例如,它们都对时序差分(TD)算法做出了贡献;工程领域的德尔塔学习规则与心理学中著名的 Rescorla-Wagner 规则十分相似。

如今,人工强化学习与自然强化学习以非常有效的方式结合在了一起。从实现的角度来看,我们在计算机系统中实现人工强化学习的方式与自然界中的强化学习有很大的区别。这些机制在人类大脑和动物大脑中都在运作着。

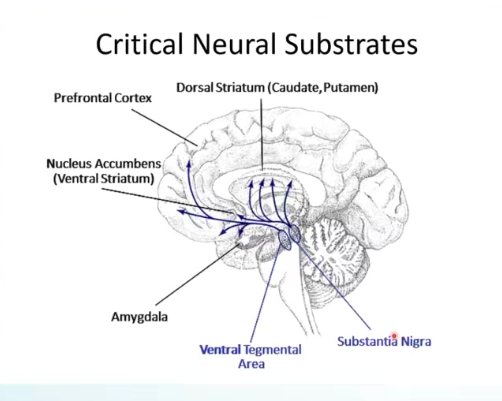

图 3:人类大脑构造

图 3 展示了人类大脑的构造,重点标明了与强化学习相关的神经基质。多巴胺是其中最重要的一种神经调节剂,它主要由腹侧被盖区和黑质的神经元合成。

多巴胺在大脑中分布相对广泛,它不会直接刺激神经元,使它们兴奋或抑制它们。相反,多巴胺以某种方式调节神经系统的可塑性和可接受性,从而调节大脑的学习方式。多巴胺会参与运动控制。以帕金森病(一种严重的神经疾病)为例,患者的多巴胺细胞会逐渐死亡,导致身体僵硬和运动迟缓,最终死去。多巴胺还与几乎所有的成瘾药物有关。

可见,人类可以通过多巴胺调节关于学习的奖惩机制,我们可以借鉴它的工作原理,研究与奖励有关的行为。由于多巴胺与成瘾现象有关,我们可以类似地控制机体的行为。

事实上,我们知道多巴胺参与强化学习。那它对奖励的控制方面有很强的影响力吗?我们假设多巴胺可以通过对奖励的控制参与强化学习过程,该过程是纹状体的某种功能,不属于一般的皮层。这些区域对于调节有机体的整体行为极其重要。此外,多巴胺也会在大脑皮层的脑额叶前部皮层区域释放。在调节和控制的过程中,杏仁体等部位在情绪处理方面也起着关键作用。

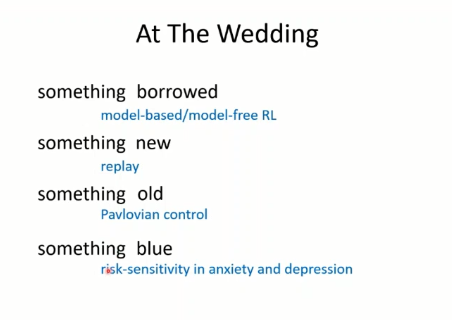

图 4:演讲大纲

本文将介绍以下 4 个方面的内容:

(1)人工强化学习和自然强化学习相互借鉴的地方,以及强化学习中思考不同控制机制的方式。

(2)近期有关「经验回放」的研究,对这种动力学现象的研究可以追溯到 20 多年前,我们发现它对强化学习十分重要。基于「经验回放缓存」(replay buffer)的「经验回放」机制与人工强化学习中的许多问题可以巧妙地结合在一起。

(3)演化预编程(在心理学领域被称为巴甫洛夫控制),这是人体内一种根深蒂固的控制机制,它使我们在面对新环境时无需每次都从头开始学习。

(4)焦虑和抑郁的背景下的风险敏感的强化学习,这与「计算精神病学」相关。我们试图基于该思路建立更好的模型,从而研究精神障碍是如何发生的,并且在精神病学和神经学的范畴内讨论某些决策是如何出错的。

1

自然强化学习的启发

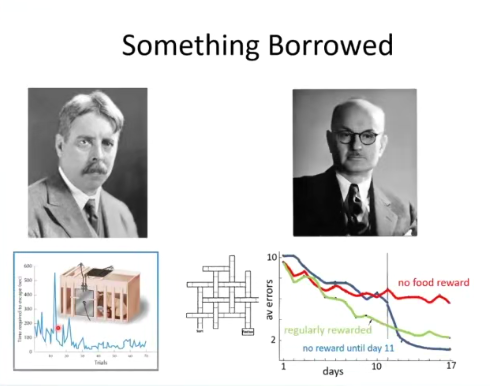

图 5:桑代克和托曼的实验

爱德华·桑代克(Edward Thorndike)是 20 世纪早期的著名心理学家,他认为动物会根据自己行为的后果进行学习,即效果法则(注:出自桑代克的著作《动物智慧》),并基于该假设提出了很多重要的理论。

如图 5 所示,他在实验中将一群小猫放进一个箱子,箱子中有一个拉杆,小猫拉动这个拉杆就可以将箱子打开,然后逃出箱子。桑代克将逃出来的小猫放回箱子,并关上箱门,让小猫不断重复逃出箱子的行动流程,桑代克会记录小猫每次成功完成该任务所需的时间。

实验结果表明,在实验初期,小猫需要较长的时间逃出箱子。随着小猫一次次成功逃出箱子,它们完成该任务的速度越来越快。因此,桑代克指出动物采取某些行动的原因是:它们可以因为做出某些行为而获得奖励,所以它们会逐渐学会有效地复现该动作。

在同一时期与桑代克并驾齐驱的心理学家爱德华·托曼(Edward Tommen)则对动物绘制环境地图的假设产生了研究兴趣。他将动物放在一个由多个 T 型轨道组成的大迷宫中,动物会在迷宫里左转或右转。动物会一直在迷宫中进行探索,直到找到一个可能放有食物的盒子。

托曼将动物分成三组。如图 5 中红色的曲线所示,一组动物从未得到任何食物奖励。在没有食物奖励的情况下,托曼将误差定义为动物走到了死胡同并且不能动弹。经过几天的试验,动物在迷宫中找盒子的效率有较小的提升。绿色曲线代表另一组会一直得到食物奖励的动物。为了找到食物,它们在迷宫中探索的效率得到了很快的提升。

蓝色曲线所代表的实验组最为关键。这组动物在前 10 天内没有获得任何奖励,它们的表现与红色曲线代表的第一组动物差不多。从第 11 天开始,托曼向盒子中投放食物。实验结果表明,自从投放食物之后,动物已经知道如何高效地穿过迷宫去获取食物。

所以,托曼认为动物在前 10 天内已经绘制出了关于环境的地图,然后在重要的时候使用它。这一观点对Jonah Keith and the Moses 等人对海马体和其它构建认知地图的相关结构的研究有很大影响。

对应于强化学习,我们设计了一种模型无关强化学习,该方法基于即时奖励(如食物)进行学习。我们还设计了基于模型的强化学习。该方法会建立世界模型并加以利用。这两种强化学习在人工强化学习社区和自然强化学习社区中都得到了广泛的应用。事实上,我们的大脑同时包含这两种机制,它们在不同的情况下发挥各自的作用。

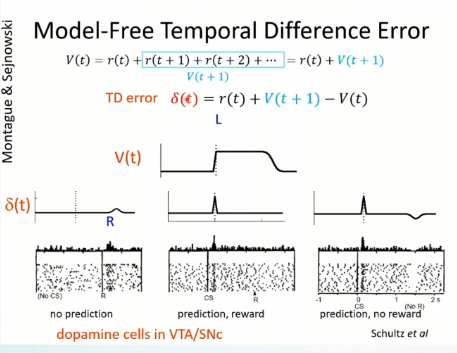

图 6:模型无关的时序差分误差

上文提到的神经调节剂多巴胺启发我们设计了模型无关的时序差分学习。人脑的学习规则使用多巴胺来控制桑代克式强化。

通常情况下,在强化学习任务中,我需要在决策序列终止后才能真正获得奖励。我们往往会对未来获得的所有奖励进行估计,考虑当前时间步以及之后每一步的奖励。为了找出学习的规则,我们必须在完全获得一长串奖励之前得到一些对奖励序列的预测的误差。事实证明,多巴胺以一种巧妙的方式解决了这个问题,这也是Rich Sutton和Andy Barto所理解的方式。

为此,我们试图采用如图 6 所示的函数预测未来的奖励。这样一来,如果在当前步得到的预测结果完全正确,在下一个时间步上进行预测,也会得到相同的序列奖励。

我们可以得到如图 6 所示的简单的等式。该等式成立时,在当前时间步上对后续奖励的估计应该等于下一个时间步上的奖励估计加上在这两个时间步的中间获得的任何即时奖励。

我们可以将方程左边和右边在实际中的差值作为预测误差。如果方程中的等号完全成立,则该误差为零。若误差为正,则奖励被低估了,实际的奖励会比 v(t)预期的更多。若误差为负的,则奖励被高估了。我们将研究在不同的情况下,这个奖励信号将会如何变化。

假设我们给出了一种动物并不期待的奖励,且对奖励并不提供任何提示。在这种情况下,我们无法对奖励做出估计出预测,而预测误差 δ(t) 实际上相当于某种能够提示奖励的信号。如图 6 左下角所示,我们将动物大脑对应区域的多巴胺细胞活动记录下来,并试图理解该过程。

我们记录了近 20 次试验中多巴胺的变化情况,每一行表示一次试验,行中的每个点是一个脑电尖峰,每个时间点之间的间隔为 0.5 秒。这些细胞通常每秒放电 1 到 3 个尖峰。在它们得到奖励后一百五十毫秒左右,图中会出现更多尖峰,这正是因为得到了奖励。由于这些峰值叠加在了一起,我们可以看到在奖励之后,脉冲图出现了小的凸起。

如果我们向动物给出对于奖励到达的提示(例如,亮灯)对奖励的估计值 V(t) 的信号形状会发生很明显的变化。起初,信号的值为 0。当提示出现时,该值会突然提升。接着,信号会再次逐渐下降为 0。

如果已知我们会得到三颗糖果作为奖励,当我们获得一颗糖果后,会期待剩下的两颗;当我们获得两颗后,会期待最后的一颗;当我们获得了所有糖果后,则不会继续期待奖励了。

在这种情况下,预测误差会发生奇特的变化。在我们等待三颗糖果的奖励时,并不会进行预测。而当奖励信号到达后,得到的奖励和预测的奖励之间会存在一定的预测误差。所以,只有当我们首次发现某些预测的事情在未来确实发生了,才会出现预测误差。

此时,当我们观察多巴胺细胞,会发现它们的行为与时序差分学习规则非常类似。在出现亮灯信号首次出现(CS)的 100 毫秒之内,多巴胺细胞会产生一些额外的尖峰。但是当相同的奖励再次出现时(R),多巴胺细胞的活动不会发生变化,我们看不到独立的尖峰,我们无法在累积下来的行为历史中发现这一奖励的存在。

为了进一步研究这种提示的影响,我们考虑为动物提供亮灯的提示,但是最终并不给它们奖励,并且观察预测误差。此时,我们期望预测误差与正常试验下的情况完全一致,即动物会对未来的奖励产生期待。但是,现在当奖励本应该被提供时,会出现奖励被高估的情况,因为实际上并没有奖励,因此预测误差信号将会为负值。此时,当我们观察多巴胺神经元的活动,我们会发现在预测误差被低估时,在很短的时间内,神经元的放电尖峰会消失,其值低于基线。

因此,我们认为这种时序差分学习信号在桑代克式的强化学习过程中是十分适用的,它可以指出与预期奖励相关的良好行为,帮助我们了解状态的预测质量(该状态是否在未来会提供奖励),我们基于这一思路设计学习规则。

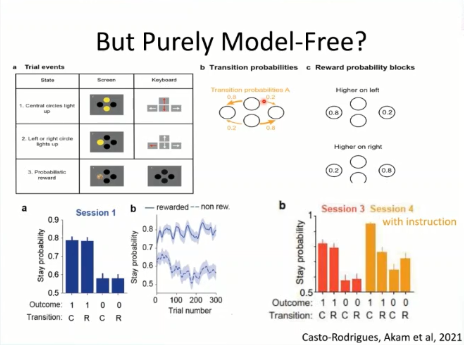

图 7:模型无关与基于模型的强化学习

托曼认为动物会构建一种世界模型。为了探究这一假说的正确性,我们针对人类设计了一项简单的任务,从而观察人类是否会构建环境模型。在实验中,首先屏幕中间的上下两个灯会亮起来,然后被试者需要选择按下其中的一个方向的箭头。接着,左和右两个灯其中的一个会亮起来,然后被试者需要按下与亮起的灯相同方向的箭头。此时,被试有可能会获得奖励,也可能不会获得奖励。

我们可以通过该实验判断受试者是否会建立关于这个环境的模型。我们假设,如果被试者选择位于上方的圆圈,那么有 80% 的几率左灯会亮起来,20% 的几率右灯会亮起来。反过来,如果被试者选择位于下方的圆圈,那么有 80% 的几率右灯会亮起来,20% 的几率左灯会亮起来。

我们不会明确地告诉被试者这种规则,将连续的状态转移规则隐藏起来,被试们只知道有时左侧的概率更高(80%),有时右侧的概率更高(80%)。假设过了很长时间,被试选择左侧的灯得到了很多奖励,他们知道要想通过选择左侧的灯获得很高的奖励,就需要先选上,再选左。但是,如果被试在选择了「上」之后,偶然间选择了右边的 20% 的奖励。被试可能会认为这是一种提示,说明规则改变了。那么,他们就会先按下「下」,因为这样会有更大的几率让右边灯亮起来。

这样一来,就形成了鲜明的对比。从桑代克式的思维来看,我们选择了某种行为,然后获得了奖励。因此,我们就应该更多地选择这一行为。然而,从托曼式的思维来看,我们选择某种行为并获得奖励后,如果下次还想获得奖励,可能最好选择另一个选项。因此,我们可以通过观察输出是概率为 80% 的频繁项还是概率为 20% 的稀有项,来判断被试是否改变了他们的行为。

如图 7 下方所示,我们会向人类被试提供很微弱的指示,C 代表状态转移到频繁项(common),R 代表稀有项(Rare),1 代表得到了奖励,0 代表没有得到奖励。那么,关键之处在于我们是否能够在输出为稀有项时得到奖励。

如果我们使用的是托曼那种基于模型的方法,你就会在通过选择稀有转移状态获得奖励后,减小选择「上」圆圈的倾向。在真实的实验中,被试们从早期开始就采取了桑代克式的思维:如果我们能通过某种行为获得奖励,那么就会重复地选择该动作;如果我们无法通过某种行为获得奖励,就会更少地选择该动作。同时,如果我们将规则和转移概率告诉被试们,那么他们每次选择相同动作的倾向就会发生变化。如果被试在选择稀有项时获得了奖励,那么他们选择相同动作的可能性就会下降。反过来,他们会更倾向于选择「下」方的圆圈。可见,被试们同时具备选用模型无关和基于模型的思维方式,这两种思维也在强化学习的设计中得以体现。

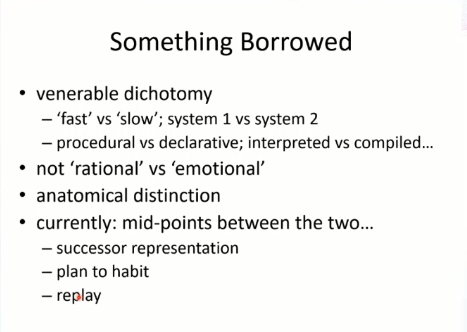

图 8:人工强化学习向自然强化学习的借鉴之处

人工强化学习借鉴了许多自然强化学习中的机制。首先,我们借用了二分法心理学中的概念,设计了基于模型和模型无关的强化学习。模型无关强化学习对应于“快系统”(system 1),而基于模型的强化学习则对应于“慢系统”(system 2)。在程序设计领域,解释型语言和编译型语言的区别也与此类似。

此外,「非理性」的思维和「情绪化」的思维都试图优化奖励函数,但是它们会使用不同的机制。在强化学习领域,很多研究者试图在「模型无关」和「基于模型」的方法之间找到一个折中点,将二者结合起来。「经验回放」指的是大脑可能使用某种环境模型,然后以某种间接的方式将其表达出来,即大脑可以重新表达我们通常看到的模型。因此,我们可以使用基于模型的系统训练模型无关的系统(即使是在睡觉时)。

2

经验回放

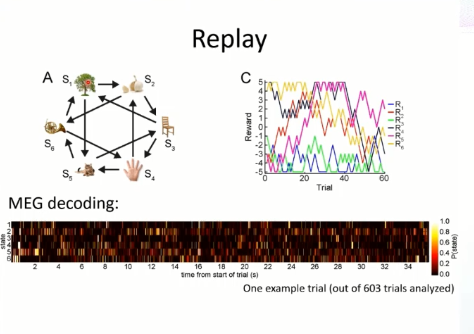

图 9:经验回放

在如图 9 所示的 EEG 神经元活动记录中,每一行代表在某一时刻某个细胞的活动情况。例如,一只小鼠从左向右移动,则它就会在图 9 中留下一条神经元活动轨迹。

众所周知,在海马体中有一种位置细胞(place cell),当动物处于环境中某些特定位置时,位置细胞就会放电。在图 9 中,小鼠运动到某些位置上时,对应颜色的神经元就会放电。通过观察该图,我们可以判断出小鼠运动的速度。当动物在运动时,这些细胞会以一种协调的方式放电。同时,我们注意到,当小鼠处于静止状态(开始跑之前或在跑道上跑完之后),所有的神经元都会被激活。

如果我们进一步探究这些神经元是如何被激活的,我们会发现如红框中所示的结构。其中,在几毫秒的加速阶段中,所有这些位置细胞将会被以与其奔跑时对应的位置相同的顺序被激活。在结束奔跑并静止时,神经元被激活的顺序则反了过来。我们将红框中的片段称为「正向经验回放」,将紫框中的片段称为「反向经验回放」。

许多研究人员一直认为存在某种结构使动物能够了解环境,因此我们将海马体作为一个系统来考虑,它能够为我们提供世界的「地图」,具有空间特异性。我们认为,动物也许可以使用这种机制在身处于环境之外时进行离线的规划,通过思考事先想象出环境应该是怎样的。

图 10:经验回放 MEG 编码实验

如图 10 所示,我们让被试在较为复杂的环境中进行规划,该环境中存在树、大蒜、椅子、圆号、猫、手。被试处于任意状态(一共有 6 个状态)时可以按下两个按键中的其中一个,并转移到相应的新状态。

在做出这些决策的过程中,被试会在并不知晓如图 10 所示的自顶向下的状态转移图时,自己学习出世界的结构。不同的状态会对应不同的奖励,我们会让被试处于这个「迷宫」中的某一点,并且让他们给出三到四步的决策。在这个过程中,被试也会学习出每个状态实际上对应多少奖励(如图 10C 所示)。被试会根据三到四步路径上累积的奖励做出决策。

在该实验中,我们使用脑磁图(MEG)技术记录大脑的活动,并对脑磁图进行解码,从而观察被试大脑在 60 秒钟的规划活动,了解它们如何思考状态转移的模式。图 10 下方展示了在一次试验的 35 秒钟大脑进行规划时的脑磁信号,6 行脑磁信号分别对应于对这 6 种物体的解码器,我们可以通过脑磁图得知被试在每个时间点上考虑了哪些物体。我们试图探究能否将经验回放与任务的结构关联起来。

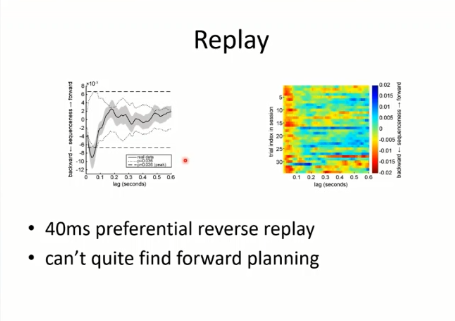

图 11:实验结果

如图 11(左)所示,当纵轴值为负时,我们测量的是反向经验回放的值;当纵轴为正时,我们测量的是前向经验回放的值,我们可以看到压缩的神经元在 250 毫秒内的活动,它将我们通过回忆利用大脑的状态编码的能力压缩了。在大约前 40 毫秒内,我们更多地对反向经验回放进行编码。

在图 11(右)中,纵观所有的试验,尽管回放的速度不一,但是在所有试验的前 40 毫秒中都发生了反向经验回放。可见,被试在进行规划时都会对某些因素进行回放。我们也试图使用这些信息,从而更好地完成任务。

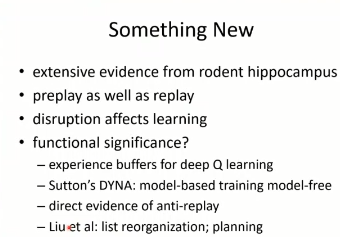

图 12:新的思考

我们从啮齿动物海马体的功能中获得了大量启示。事实上,动物在做出决策时,不仅会使用经验回放,还会进行预测。它们会使用世界模型来规划可能的策略,蒙特卡洛树搜索就属于这类算法,旨在在环境中规划出可能的优秀决策轨迹。

对于动物和人类来说,受到干扰都会影响学习。从功能意义的角度来说,许多强化学习算法都会在训练中学习回放经验,来确保算法的正确性。例如,Q 学习模型就是一种模型无关的强化学习算法。同时,我们认为动物和人类会表达自己从模型中获得的信息,并利用它们控制自己的行为。事实上,大约 30 年前,人们就提出了使用基于模型的系统训练模型无关系统,从而实现高效行为的算法。我们可以从很多的方式来实现这一思想。Liu 等人针对回放机制的其它功能进行了进一步的研究。

3

巴普洛夫控制

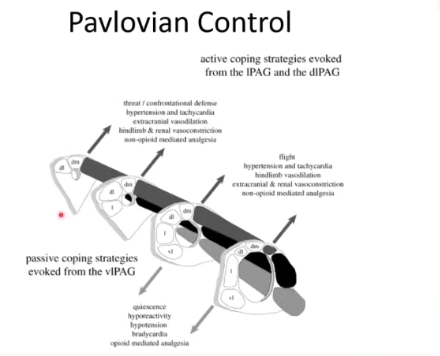

图 13:中脑导水管周围灰质

中脑导水管周围灰质(PAG)的结构如图 13 所示,它是大脑中一个非常深层的结构,旨在从根本上组织我们在面对威胁时做出的防御反应。人类需要作出各种不同的防御行为,包括静止血管低反应性等被动反应,以及战斗等积极反应。该结构描绘了人体固有的防御机制是如何产生的。

人类通过进化产生了这种非常复杂的结构,并且不再需要自己学习在面对致命威胁时应该做出怎样的本能防御反应。如果我们的背部遭受攻击,就会本能地反击。如果我们的腹部遭受攻击,就会产生被动反应。在构建人工系统时,我们希望通过预编程的方式对这一机制进行编码,从而使其更好地满足我们的需要。研究者们关于这种巴浦洛夫机制或演化编程机制对于行为过程的正面/负面影响进行了探究。

图 14:旧的启示

有时,我们会因为巨大的奖励而处于竞争环境下,我们有一种内在的机制去靠近环境中能够找到的奖励来源。在竞争过程中,我们不断试图接近奖励,而当对手获得奖励后,我们期望的奖励可能就消失了,那么就很难继续依赖于奖励学习。因此,人类在进化过程中产生了预编程机制,这是一种非常强的归纳偏置。

这种归纳偏置有时是有益的,有时也存在一定副作用。从这种巴浦洛夫控制的角度来说,完美反应(consummatory response)会引导人类获得好处,或者反击威胁。预备反应(preparatory)是根据预测自动产生的。有时,我们可能并不能看到奖励,但是可以看到某种预示着奖励会在未来出现的线索(例如,望梅止渴)。动物无需学习这种机制,它深深地「预编程」在动物的本能中。

然而,这种机制也会带来一些麻烦。例如,我们有时会冲动,缺乏自控能力。同时,我们的预测结果会受到干扰,这些干扰项说明我们的主动选择旨在最大化奖励、最小化惩罚。这种机制被称为巴浦洛夫工具性转移,它并不是最优的机制,环境也无法最好地反映出最优机制。

通常而言,我们可以将上述机制视为「进化预编程」的组成部分。例如,马在出生后不就就可以稳稳地行走,而人类需要花费较长的时间学会走路,教会机器人行走则需要非常长的时间。可见,进化预编程是一种思考如何提升模型性能的重要方式。

4

悲观的风险

图 15:决策理论精神病

「焦虑和抑郁情况下的风险敏感度」是一个计算精神病学领域的话题。此时,我们试图使用我们对正常决策的理解来思考我们为何会在面对疾病或某些环境时做出错误的决策。我们可以将出现的错误分为三类:

(1)身体做好了准备,但是精神意志很薄弱。此时系统实际上试图解决错误的问题,就好比由于兴趣缺失而导致的抑郁。因此,通常会得到回报的行为也失去了提供奖励的能力。这意味着,即使我们解决的问题是正确的,但是由于不存在奖励值,就无法求解。在这种情况下,我们作出的行为不再是别人期望的。

(2)心有余而力不足。此时我们希望正确地解决问题,奖励值也可以提供很强的监督信号,但是我们用于解决问题的机制存在缺陷,不具备完成我们需要的动作的能力。

(3)错误的解决方案。此时我们要解决的任务是正确的,精神和肉体都做好了准备,但是求解问题的环境并不能提供任何解决问题的机会(例如:沙漠)。但是如果在面对新的环境(例如,充满机会的热带雨林)时,我们仍然采用旧环境中的系统,就会丧失探索的动力。

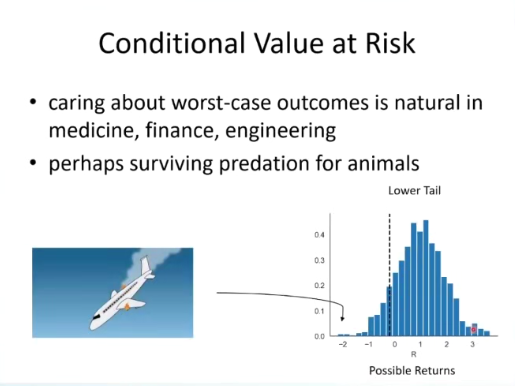

图 16:条件风险值

为了解决上述问题,我们需要考虑风险。此时,我们将面对不确定性,这种不确定性可能导致好的结果,也可能导致不好的结果。在这种存在风险的环境下,我们通常需要考虑最差的情况,这种思路在医学、金融、工程领域被广泛应用,动物为了在捕食中幸存下来也需要具备这种能力。我们可能得到各种不同的输出结果,其分布如图 16 所示。最差的情况位于左尾中箭头所示的地方。

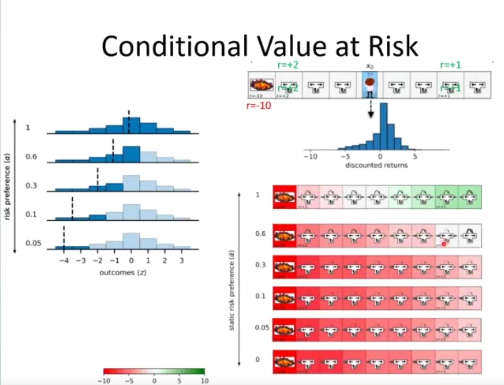

图 17:调节条件风险

金融学研究社区已经发展出了一些风险度量方法,这些方法也被用于人工智能领域,它们重点关注最差的结果。

如图 17 所示,条件风险值指的是分布的核心分位数之下的平均值。当风险倾向为 1 时,条件风险涵盖了整个分布,黑色虚线代表均值。当风险倾向为 5% 时,积累起来为 5% 的条件风险如图 17 左侧最下方的分布中的深蓝色部分所示。当我们对经验越来越敏感时,会越来越关注左侧尾的分布,即更加糟糕的情况。因此,我们会越来越少地考虑相同分布的值。如图 17 右上角所示,在一个规划任务中,智能体需要作出决策,其奖励值处于[-10,10]的区间。其中,有两个行为的奖励为正,奖励较小的行为位于右侧,奖励较大的行为位于左侧。如果我们对风险敏感,就会避免处于左侧的情况。尽管此时奖励更大,但是我们可能会陷入左侧,得到较差的结果。

我们可以通过值函数对世界环境进行评估。我们使用强化学习规则来训练值函数,它也反映了我们对风险的敏感程度。

如图 17 右侧所示,不同的颜色代表不同状态下的值,其中我们以相同的频率向左或向右移动或者静止不动。如果我们对风险是中性的,红色的状态的值为负(左尾),而绿色的状态的正值会给出正的奖励。如果我们抵抗风险的意识很强,则我们往往只会考虑最差的情况,陷入左尾。当我们改变风险倾向,对风险的抵抗稍微降低一些,则值函数的输出就会有所改变(右移),更加偏向于对风险中立,更加关注整体的分布。考虑风险不仅对执行行为有帮助,也对构建经验回放有所帮助。对风险敏感的人会对糟糕的决策进行反思。

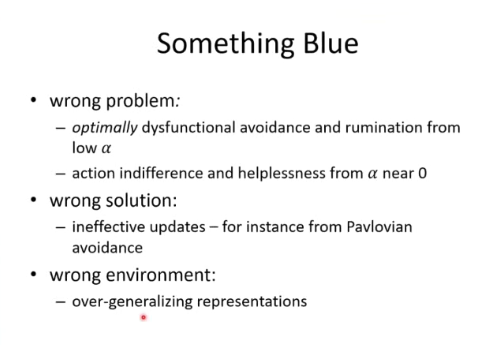

图 19:悲观的情况

如前所述,我们将错误的类型分为:错误的问题、错误的解决方案和错误的环境。

就错误的问题而言,当 α 值很小时,我们对风险十分敏感。此时,尽管机体可以完成任务,但是我们还是会十分保守。无论做出什么动作,输出都是 0。

就错误的解决方案而言,我们试图解决的问题是正确的,但是解决方案错误。此时,我们可能通过反思更高地进行规划,但是规划的方式仍然失败了。实际上,我们需要在规划中探索一些颠覆性的思路,但是它们存在让机体无法工作的风险。

就错误的环境而言,我们描述世界的方式可能太过笼统,这意味着我们设置的存在风险的环境可能本身的风险也较为有限。我们可能将本应该独立考虑的状态偶合在一起了。

5

自然强化学习和人工强化学习

图 20:自然强化学习和人工强化学习

在本文中,我们介绍了自然强化学习和人工强化学习。至今,该学科已经有上百年的历史,目前仍然是科研的前沿。自然强化学习和人工强化学习应该双向互动,二者之间有很多可以结合的地方。

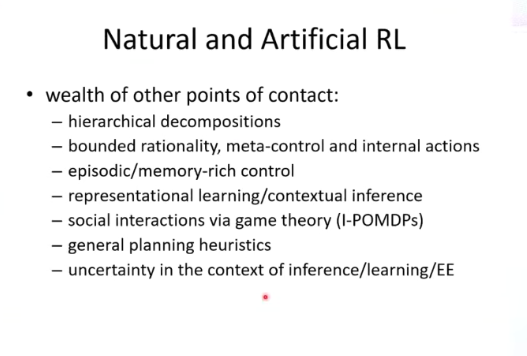

我们可以通过层次化的分解来表征这个世界。此外,从有限理性的角度来说,许多我们试图解决问题的方法在计算上存在很大的困难。有时,我们会有一些启发式的想法,我们不能完全通过理性的方式来求解,需要在可计算性和求解效果之间折中。人工强化学习领域的研究者对此类工作也很感兴趣。我们讨论了基于模型的系统和模型无关系统的控制。我们还可以从记忆接口控制的角度来思考自然强化学习和人工强化学习的结合。目前,许多研究者们试图从博弈论的角度研究社交活动,此时博弈各方都会在脑海中建立相应的世界模型。此时,人们会基于强化学习方法构建交互式的部分可观测模型。研究者们对人工强化学习和自然界中的不确定性展开了研究,其中,我们会考虑探索和利用之间的折中。

完

总结3: 《强化学习导论》代码/习题答案大全

总结6: 万字总结 || 强化学习之路

完

第114篇:使用新的物理模拟引擎加速强化学习

第113篇:如何降低深度强化学习研究的计算成本

第112篇:基于Novelty-Pursuit的高效探索方法

第111篇:Reward is enough奖励机制。

第110篇:163篇ICML2021强化学习领域论文汇总

第109篇:【Easy-RL】200页强化学习总结笔记

第108篇:清华大学李升波老师《强化学习与控制》

第107篇:阿里巴巴2022届强化学习实习生招聘

第106篇:奖励机制不合理:内卷,如何解决?

第105篇:FinRL: 一个量化金融自动交易RL库

第104篇:RPG: 通过奖励发现多智能体多样性策略

第103篇:解决MAPPO(Multi-Agent PPO)技巧

第102篇:82篇AAAI2021强化学习论文接收列表

第101篇:OpenAI科学家提出全新强化学习算法

第100篇:Alchemy: 元强化学习(meta-RL)基准环境

第98篇:全面总结(值函数与优势函数)的估计方法

第97篇:MuZero算法过程详细解读

第96篇: 值分布强化学习(Distributional RL)总结

第95篇:如何提高"强化学习算法模型"的泛化能力?

第94篇:多智能体强化学习《星际争霸II》研究

第93篇:MuZero在Atari基准上取得了新SOTA效果

第91篇:详解用TD3算法通关BipedalWalker环境

第88篇:分层强化学习(HRL)全面总结

第85篇:279页总结"基于模型的强化学习方法"

第84篇:阿里强化学习领域研究助理/实习生招聘

第83篇:180篇NIPS2020顶会强化学习论文

第81篇:《综述》多智能体强化学习算法理论研究

第80篇:强化学习《奖励函数设计》详细解读

第79篇: 诺亚方舟开源高性能强化学习库“刑天”

第77篇:深度强化学习工程师/研究员面试指南

第75篇:Distributional Soft Actor-Critic算法

第74篇:【中文公益公开课】RLChina2020

第73篇:Tensorflow2.0实现29种深度强化学习算法

第72篇:【万字长文】解决强化学习"稀疏奖励"

第71篇:【公开课】高级强化学习专题

第70篇:DeepMind发布"离线强化学习基准“

第66篇:分布式强化学习框架Acme,并行性加强

第65篇:DQN系列(3): 优先级经验回放(PER)

第64篇:UC Berkeley开源RAD来改进强化学习算法

第61篇:David Sliver 亲自讲解AlphaGo、Zero

第59篇:Agent57在所有经典Atari 游戏中吊打人类

第58篇:清华开源「天授」强化学习平台

第57篇:Google发布"强化学习"框架"SEED RL"

第53篇:TRPO/PPO提出者John Schulman谈科研

第52篇:《强化学习》可复现性和稳健性,如何解决?

第51篇:强化学习和最优控制的《十个关键点》

第50篇:微软全球深度强化学习开源项目开放申请

第49篇:DeepMind发布强化学习库 RLax

第48篇:AlphaStar过程详解笔记

第47篇:Exploration-Exploitation难题解决方法

第45篇:DQN系列(1): Double Q-learning

第44篇:科研界最全工具汇总

第42篇:深度强化学习入门到精通资料综述

第41篇:顶会征稿 || ICAPS2020: DeepRL

第40篇:实习生招聘 || 华为诺亚方舟实验室

第39篇:滴滴实习生|| 深度强化学习方向

第37篇:Call For Papers# IJCNN2020-DeepRL

第36篇:复现"深度强化学习"论文的经验之谈

第35篇:α-Rank算法之DeepMind及Huawei改进

第34篇:从Paper到Coding, DRL挑战34类游戏

第31篇:强化学习,路在何方?

第30篇:强化学习的三种范例

第29篇:框架ES-MAML:进化策略的元学习方法

第28篇:138页“策略优化”PPT--Pieter Abbeel

第27篇:迁移学习在强化学习中的应用及最新进展

第26篇:深入理解Hindsight Experience Replay

第25篇:10项【深度强化学习】赛事汇总

第24篇:DRL实验中到底需要多少个随机种子?

第23篇:142页"ICML会议"强化学习笔记

第22篇:通过深度强化学习实现通用量子控制

第21篇:《深度强化学习》面试题汇总

第20篇:《深度强化学习》招聘汇总(13家企业)

第19篇:解决反馈稀疏问题之HER原理与代码实现

第17篇:AI Paper | 几个实用工具推荐

第16篇:AI领域:如何做优秀研究并写高水平论文?

第15篇:DeepMind开源三大新框架!

第13篇:OpenSpiel(28种DRL环境+24种DRL算法)

第11篇:DRL在Unity自行车环境中配置与实践

第8篇:ReinforceJS库(动态展示DP、TD、DQN)

第5篇:深度强化学习在阿里巴巴的技术演进

第4篇:深度强化学习十大原则

第2篇:深度强化学习的加速方法

第1篇:深入浅出解读"多巴胺(Dopamine)论文"、环境配置和实例分析