热门标签

热门文章

- 1月薪65k的大厂云计算工程师,是种什么体验_云计算大厂的学历

- 2基于springboot+vue框架的电影订票系统_wqc3k_基于springboot和vue的电影售票管理系统设计与实现参考文献

- 3【校招面经】这10道指针面试真题,快来检测自己掌握了几道。_指针面经

- 4AI人工智能学习之激活函数_leaky_relu

- 5Fetch 使用详解_fetch命令linux

- 6signature=afa01c88c54d50cbb031be121a63b5d9,fomo3d_simple/yarn.lock at master · MajorTom404/fomo3d_si...

- 7vscode配置golang远程开发调试环境_vscode 配置golang远程linux主机

- 8Docker简介

- 9基于Java SpringBoot和Vue UniAPP的微信商城小程序_微信小程序商城 springboot

- 10Pandas:DataFrame的行列操作_dataframe 整列 操作

当前位置: article > 正文

深度学习(六十九)darknet 实现实验 Compressing Deep Neural Networks with Pruning, Trained Quantization and Huffma_darknet prunning

作者:IT小白 | 2024-03-05 11:47:17

赞

踩

darknet prunning

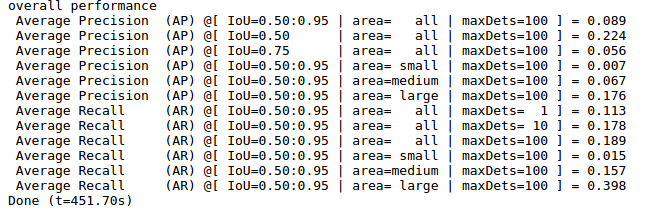

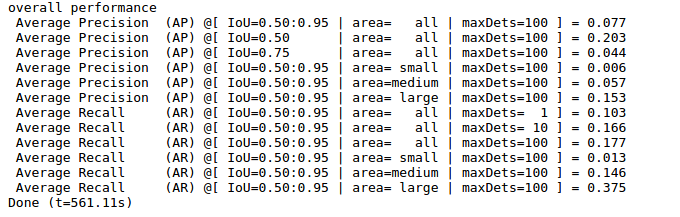

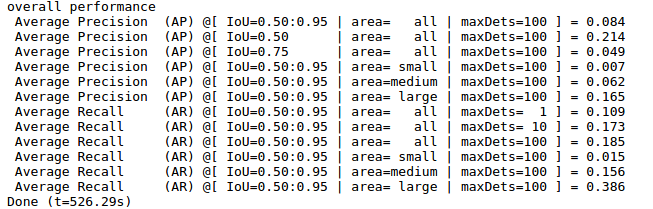

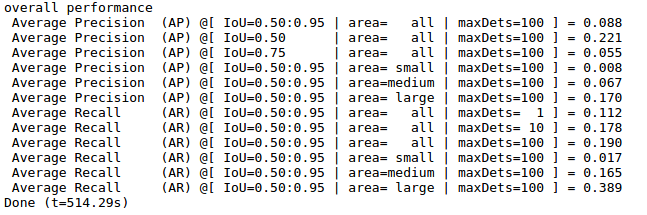

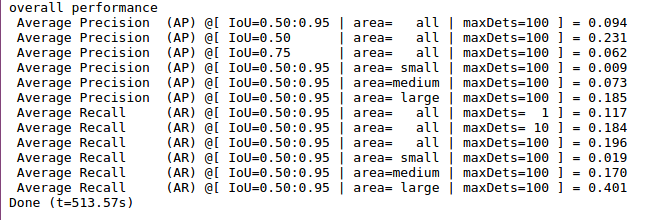

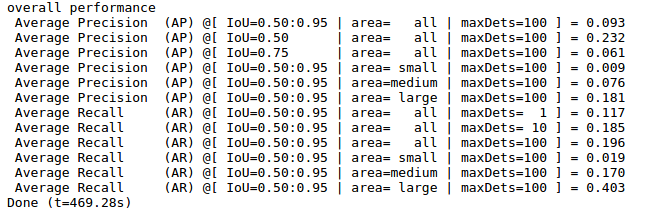

本文主要实验文献文献《Deep Compression: Compressing Deep Neural Networks with Pruning, Trained Quantization and Huffman Coding》算法,在tiny-yolo coco上的压缩效果,在darknet基础上,编写该算法进行压缩实验,结果如下:

原始模型大小64M:mAP=0.224

训练500次,模型大小54M:mAP=0.203

训练5000次,模型大小49M:mAP=0.214

训练50000次,模型大小39M:mAP=0.221

训练100000次,模型大小30M:mAP=0.231

训练180000次,模型大小23M:mAP=0.232

懒得训练了,目前每迭代1500次,下降0.1M,要训练到底,应该是可以压缩到18M左右

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/IT小白/article/detail/190800

推荐阅读

相关标签