热门标签

热门文章

- 12024年第四届机器人与人工智能国际会议(JCRAI 2024) | Ei、Scopus双检索

- 2在GitHub上下载项目&文件_github下载按钮在哪

- 3写作、绘画、视频、办公等领域人工智能AI工具导航网站集合

- 4Flutter 实战:构建跨平台应用_flutter跨平台

- 5自然语言处理 | (19) Python中文文本表示_python中文字能用for i in

- 6Vue - 3( 15000 字 Vue 入门级教程)

- 7ai python 吾爱破解_【Python】人工智能全栈工程师(0基础到精通)教程 第十八课...

- 8房产中介租房小程序系统开发搭建:详细指南教你如何构建

- 9小说变成视频脚本化,并自动上传快手_把小说改成脚本

- 10【JVM】Java内存溢出分析(堆溢出、栈溢出、方法区溢出、直接内存溢出)_堆内存溢出的原因

当前位置: article > 正文

Transformer——Decoder_transformer不加mask会怎么样

作者:IT小白 | 2024-04-01 10:12:39

赞

踩

transformer不加mask会怎么样

目录

1 多头注意力机制

1.1 mask

ques:为什么需要mask?

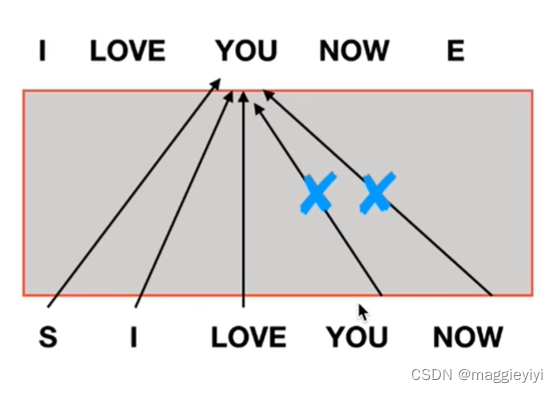

ans:如果没有mask,那么在训练的时候存在you和know。如下图,但是在测试的时候,没有mask,会出现误差,模型效果不好。

需要mask 如图:

训练的时候将you和know mask掉,保证一致性。

2 交互层

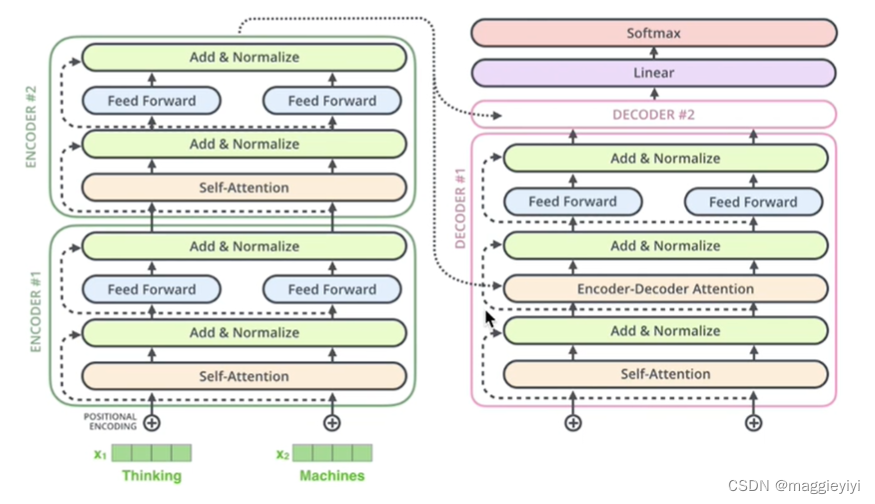

所有的encoder输出和每一个decoder去做交互。

具体交互如下:

encoder生成K、V矩阵;decoder提高Q矩阵,即多有注意力机制计算K、Q、K的值。公式如下:

![]()

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/IT小白/article/detail/348330?site

推荐阅读

相关标签