热门标签

热门文章

- 1MQ2烟雾传感器_mq2烟雾传感器浓度算法

- 2数仓建模分层概述_dws 轻度汇总

- 3【股价预测】基于matlab遗传算法优化BP神经网络预测股价【含Matlab源码 1250期】_bp神经网络预测股票模型代码

- 4Python调用deepl api脚本

- 5Docker配置mysql以及宿主机容器目录挂载_docker绑定宿主机目录和容器目录 容器目录需要创建嘛

- 6Jupyter Notebook的安装及在网页端和VScode中使用教程(详细图文教程)_jupyter notebook网页版

- 7经典算法之——解决全排列问题以及详解_排列问题的过程

- 82020江苏计算机事业单位,2020江苏事业单位计算机类岗位考情

- 9HuggingFace开源的自然语言处理AI工具平台_huggingface平台

- 10xcode15 ios17安装问题 an Library ‘iconv.2.4‘ not found Unable to execute command: Segmentation fault: 11_library 'iconv.2.4.0' not found

当前位置: article > 正文

大模型-DeltaTuning-增量式01:Adapter-tuning(0.5-8%)【每个transformer层内加入2个Adapter层】【Adapter就是先降维再升维的全连接】_delta tuning adapter

作者:IT小白 | 2024-04-21 08:48:11

赞

踩

delta tuning adapter

Adapter Tuning

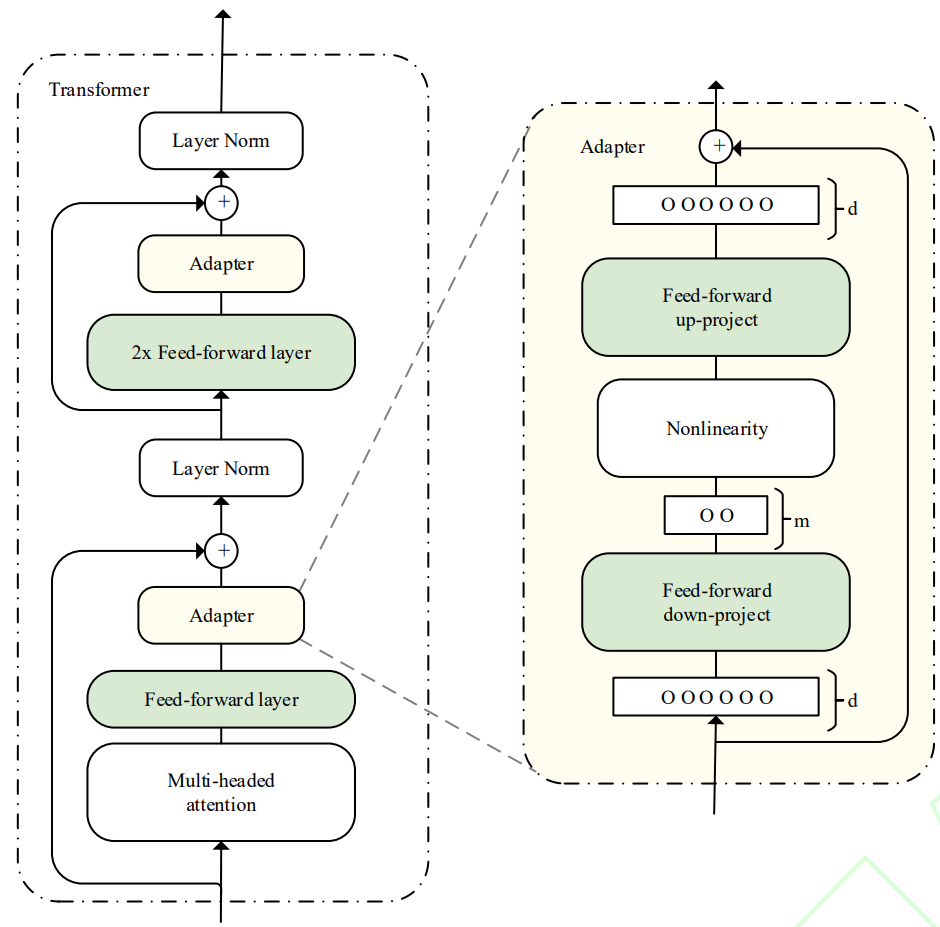

随着计算机硬件性能的提高,预训练模型参数量越来越多,在训练下游任务时进行全模型微调变得昂贵且耗时,Adapter 的出现缓解了这个问题。Adapter在预训练模型每层中插入用于下游任务的参数,在微调时将模型主体冻结,仅训练特定于任务的参数,减少训练时算力开销。

Adapter模块设计方法

2019年,Houlsby N等人将Adapter引入NLP领域,作为全模型微调的一种替代方案。Adapter主体架构下图所示。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/IT小白/article/detail/462109

推荐阅读

相关标签