热门标签

热门文章

- 1拒绝零散碎片, 一文理清MySQL的各种锁_mysql 有哪些锁

- 2【python如何爬取视频】_python爬取视频

- 3Docker Harbor安装、使用_docker安装harbor

- 4C++设计模式-抽象工厂模式_c++ 抽象工厂模式

- 5ESLint:代码质量的守护者_否引入 eslint 用于代码质量检测?

- 6Python爬虫基础讲解(十二):初探selenium——动态网页&静态网页_动态视频免费观看

- 7嵌入式:ARM间接寻址、变址寻址与多寄存器寻址

- 8es相关概念、索引操作(相当于mysql中的数据库操作)

- 9数据解析——Jsonpath

- 10iPhone官方商店软件下载---免费看各种剧第④弹【iOS版包括iPad】

当前位置: article > 正文

【AI实践】Dify调用本地和在线模型服务

作者:Li_阴宅 | 2024-08-20 22:00:22

赞

踩

dify

背景

Ollama可以本地部署模型,如何集成私有数据、如何外部应用程序对接,因此需要有一个应用开发框架

Dify功能介绍

下文将把dify部署在PC上,windows环境;

安装部署

安装dify及docker

- jacob@Jacobs-NUC:/mnt/d/wsl$ git clone https://github.com/langgenius/dify

- Cloning into 'dify'...

- remote: Enumerating objects: 59108, done.

- remote: Counting objects: 100% (8801/8801), done.

- remote: Compressing objects: 100% (1569/1569), done.

docker已经安装完成的情况下

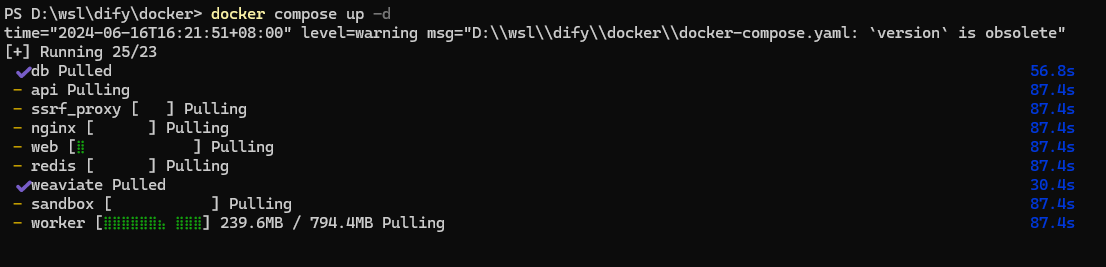

- PS C:\Users\iamlv> cd D:\wsl\dify\docker\

- PS D:\wsl\dify\docker> docker compose up -d

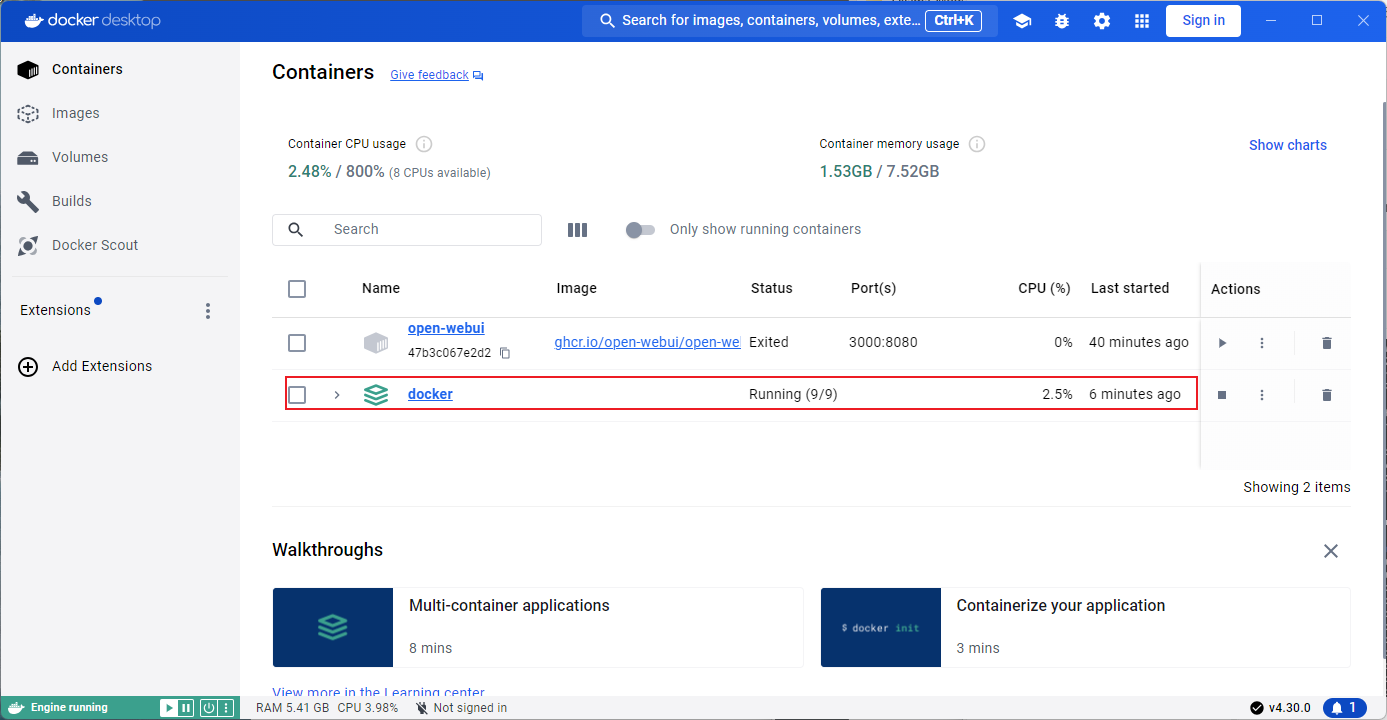

在docker页面里面,也可以看到running

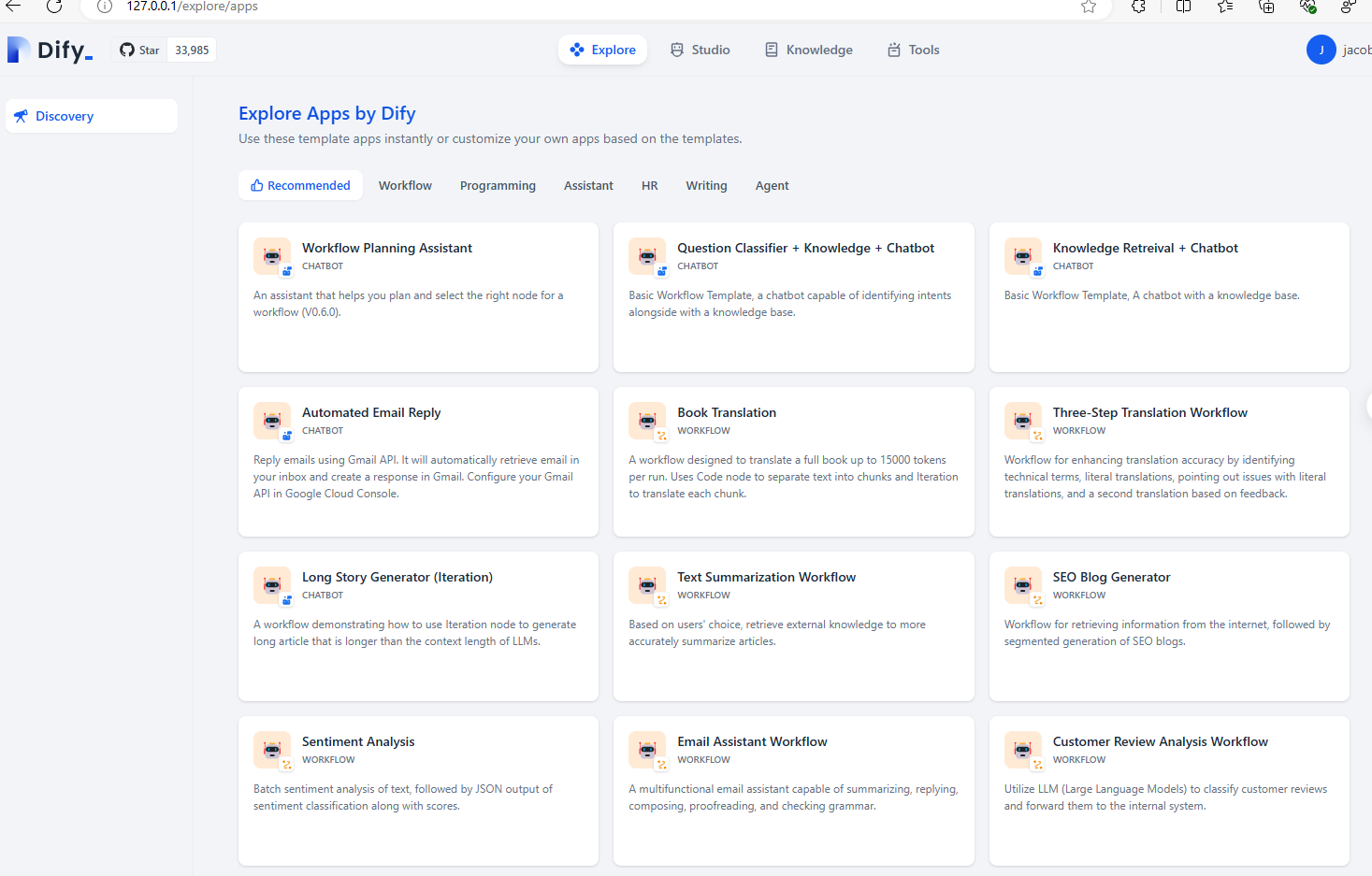

网页中输入http://127.0.0.1,打开dify,注册登录后

添加本地Ollama模型

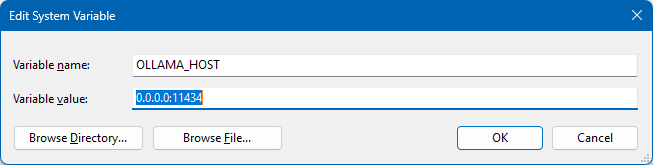

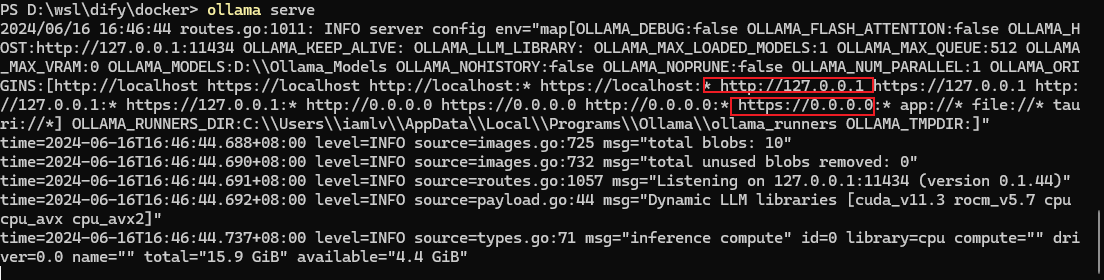

docker是虚拟环境的主机,Ollama部署在本地主机,无法通过本机访问

环境变量增加如下

重启Ollama

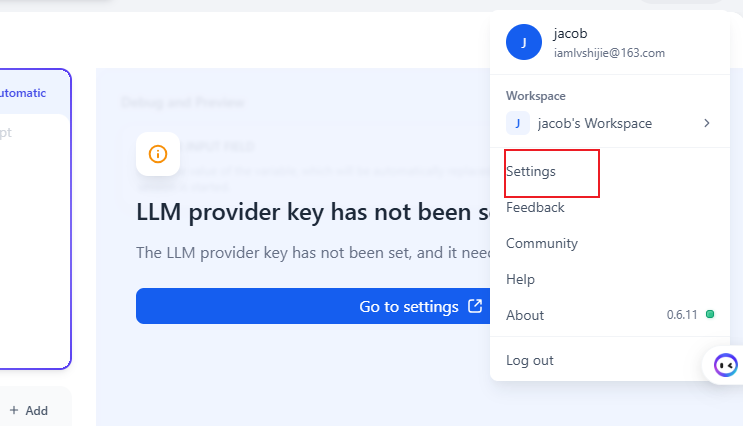

选择设置,

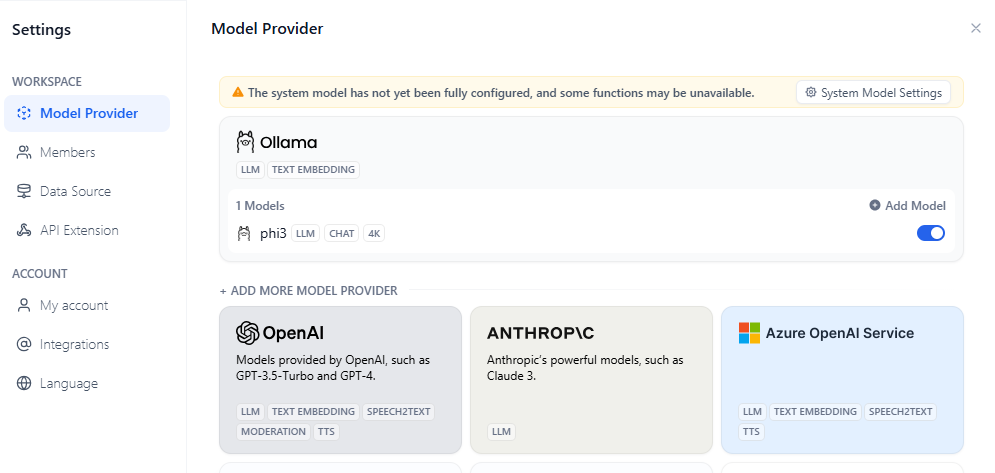

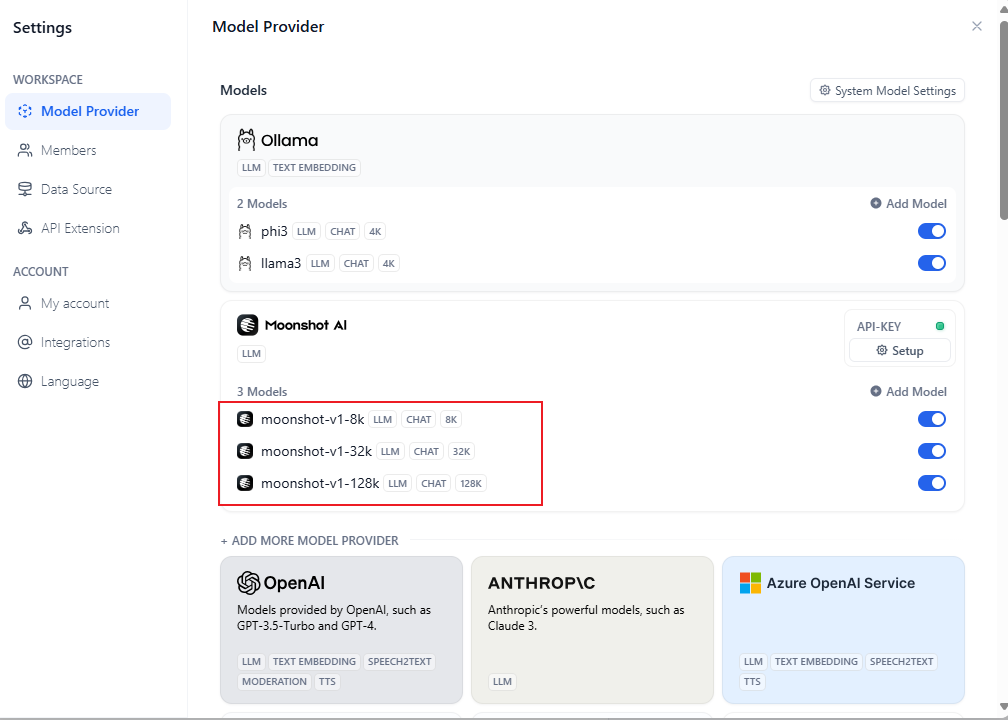

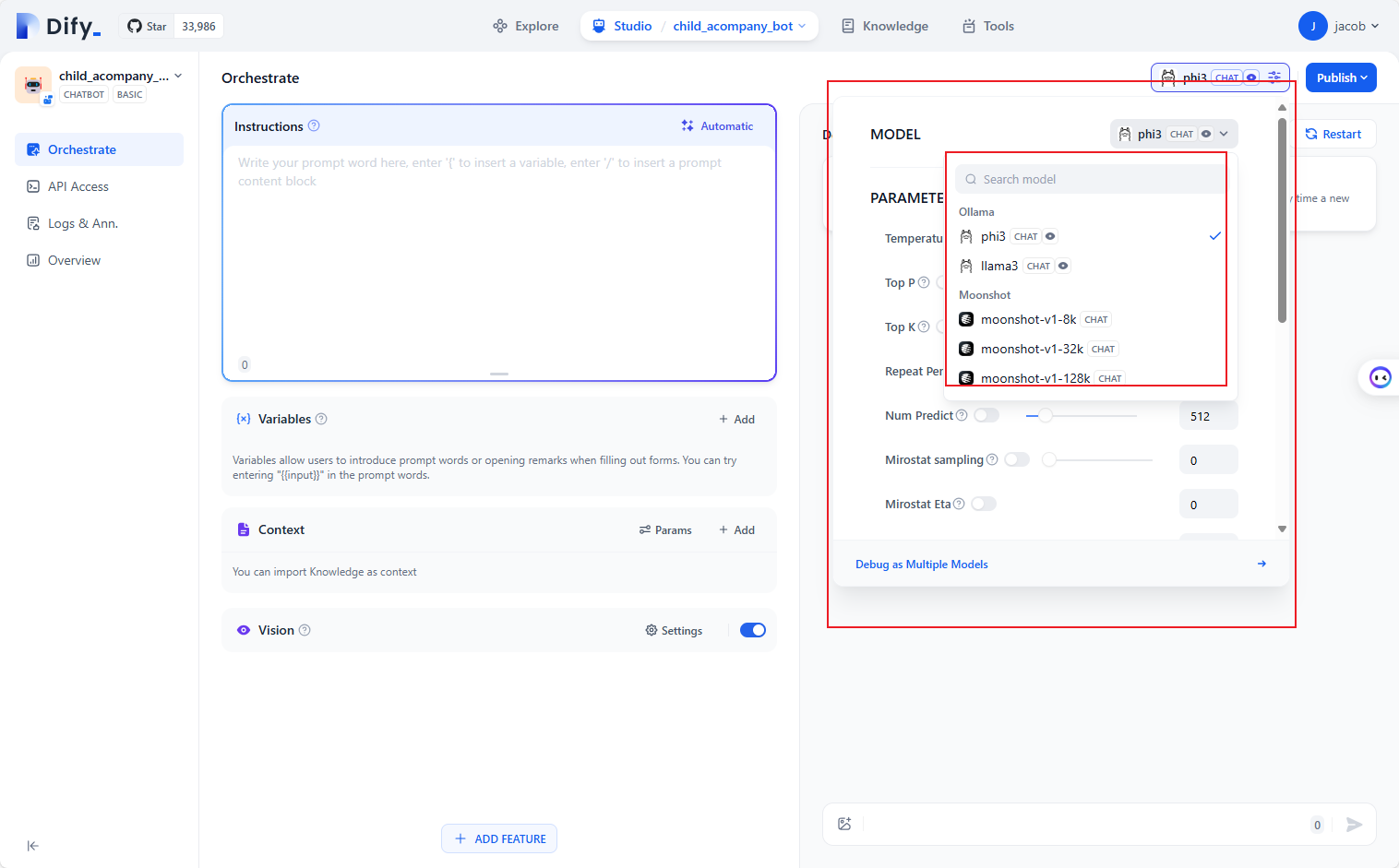

选择模型供应商

找到Ollama,配置本地Ollama已经验证的模型,如phi3

ip地址需要换成自己电脑的IP地址;模型名称需要和Ollama模型名称保持一致;

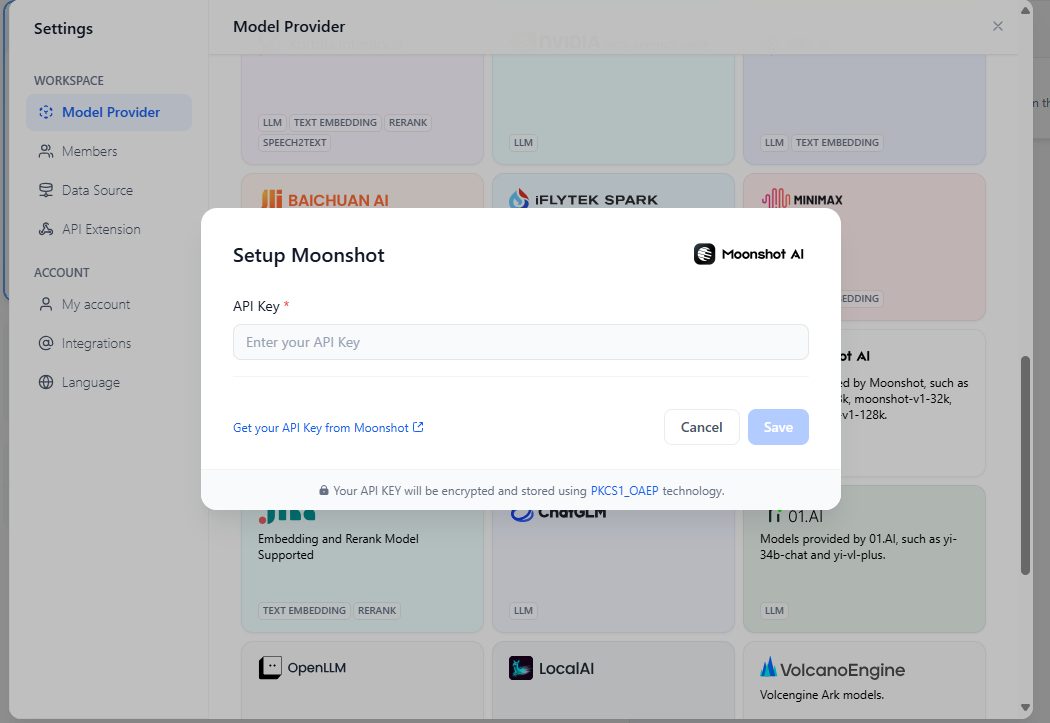

添加在线模型

从Moonshot AI - 开放平台,获取key值填入

在工作区选择调用即可。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/Li_阴宅/article/detail/1008675

推荐阅读

相关标签