- 1CPU、MCU、MPU、SOC、SOCPC、概念解释之在嵌入式领域常听到的名词含义_soc cp mcu

- 2oracle中的exists 和not exists 用法详解_oracle not exists

- 3【C#】防御性编程策略float.TryParse()

- 4【STM32外设系列】双轴按键PS2摇杆_ps2摇杆模块的使用

- 5关于could not find a writer for the specified extension in function “cv:imwrite_”的问题解决办法。

- 6如何下指令让gpt修改文章【一文读懂】_gpt洗稿指令

- 7ins07001 oracle,Error in installing Oracle client 11g on Windows 2008 R2 (64bit) XenApp 6 — oracle-t...

- 8实验笔记之——Ubuntu20.04配置nvidia以及cuda并测试3DGS与SIBR_viewers

- 9探索AI作画算法的原理:从深度学习到创造性艺术

- 10【AIGC调研系列】OpenInterpreter/01的项目如何赋能软件测试领域_open interpreter支持哪些模型

行业巨变!LLama3要来了!!

赞

踩

文:Congerry,来源:头部科技 转:datawhale

经过将近一年的等待,Meta 的新一代大型语言模型Llama 3终于要来了。

根据The Information的报道,一位Meta员工透露,两款小型Llama 3模型将于下周发布。这两款模型只能处理纯文本,尚未具备多模态能力,真正的多模态Llama 3大规模版本预计将于今年夏天推出。

前不久,谷歌、埃隆·马斯克的 xAI 和 Mistral 在内的几家公司相继都发布了开源大型语言模型(LLM)。

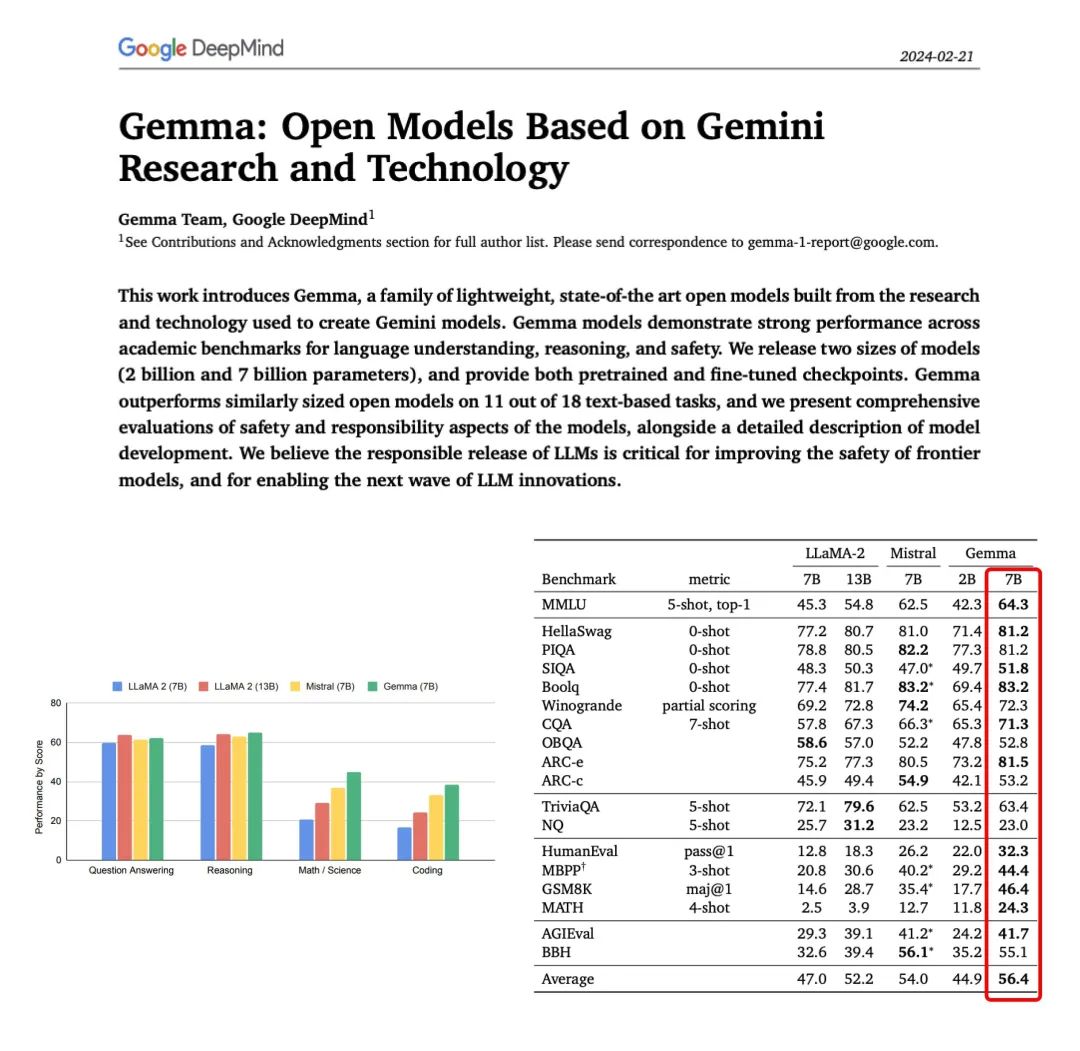

2月21日,Google 发布了 Gemma 大模型,包括 Gemma 2B(20亿参数)和 Gemma 7B(70亿参数)两个版本。

尽管参数较小,但 Gemma 的70亿参数模型在主流的测试平台如 MMLU、BBH、GSM8K 等上,在数学、推理、代码等方面的性能超过了同规模的 Llama-2 模型,在某些关键能力上甚至超越了 Llama-2 的130亿参数模型。

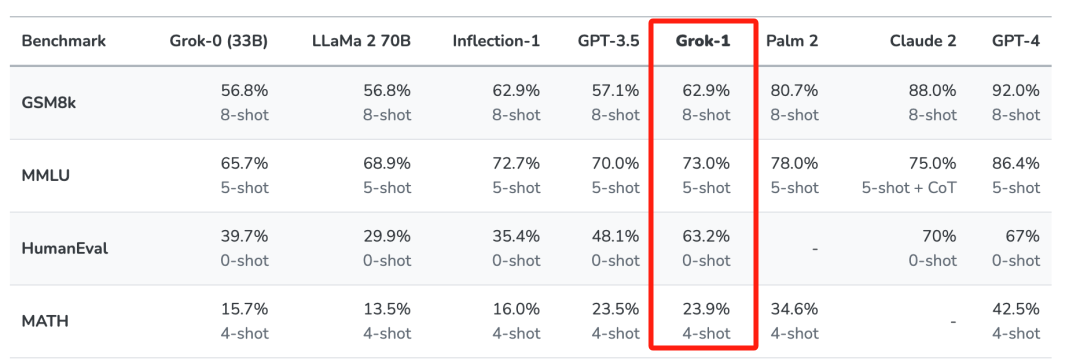

马斯克的Grok-1在多项基准测试中的成绩也稳压了LLaMa 2一头。

但是Llama 2已经是去年7月的产品,当时,Meta也采用了先发小模型的策略。在发布700亿参数的Llama 2大规模版本之前,该公司就先行推出了130亿和70亿参数的小型版本,以此测试市场反响。

虽然小型模型训练和运行成本更低,而且适合移动设备等场景的部署,但是毫无疑问,大规模版才是Meta真正的"压箱底"。据此前报道,Llama 3的大规模版本参数量可能超过1400亿,参数规模之大将助力模型在多种下游任务中发挥最大潜能。

而且,Meta 希望 Llama 3 能够赶上 OpenAI 的 GPT-4,后者能够根据用户上传到聊天机器人的图像回答问题。最大的 Llama 3 版本将是多模态的,它将能够理解和生成文本和图像。

另外,Meta 公司使用 Llama 2 为其应用程序中的人工智能助手提供动力。近几个月来,Meta 公司生成式 AI 部门的员工一直在努力使 Llama 3 在回答有争议问题时更加开放,此前 Meta 的领导层认为 Llama 2 在回答上过于保守。

据了解,Llama系列模型自开源以来便获得了开发者的广泛关注。Meta的计划是让Llama 3沿袭对开发者友好的定位。毕竟,拥有活跃的开发者社区,才能更好促进大模型的迭代优化,构建出既强大、又好用的人工智能。

扎克伯格此前在Meta的财报电话会议中,解释了他认为 Meta 开源战略的潜在好处。扎克伯格表示,开源模型通常更安全、更高效,而且运行起来更具成本效益,因为它们不断受到社区的审查和开发。

开源软件还可以成为行业标准,从而更容易将创新融入 Meta 的产品中。最后,开源在开发人员和研究人员中的普及可以帮助 Meta 吸引更好的人才。

Llama 3 的入局不仅将在消费级AI助理市场掀起腥风血雨,更有望在学术界、工业界生产力应用等多个领域叫板现有模型。