- 1Springboot+Vue项目-基于Java+MySQL的宠物商城网站系统(附源码+演示视频+LW)

- 2c 语言如何处理表格文件中的数据库,C#程序从Excel表格中读取数据并进行处理

- 3C++11:std::function 函数封装器

- 4android开发 -- 复制文本内容到系统剪贴板_android 复制内容到剪切板

- 5【模型复现】CV、NLP多用途模型——Transformer复现_nlp和cv有没有共用的模型

- 6知识图谱学习笔记(三)—— 实体识别与链接_基于表示学习的实体链接

- 7手术麻醉系统管理源码

- 8angular入门_angular安装

- 9毕业设计项目 python金融大数据分析与可视化_python金融数据可视化

- 10产品经理有没有必要考NPDP?考了有用吗?

阿里云推出第八代企业级实例 g8i:AI 推理性能最高提升 7 倍、可支持 72B 大语言模型_intel emr 第八代实例什么时候上市的

赞

踩

云布道师

1 月 11 日,全球领先的云计算厂商阿里云宣布推出第八代企业级通用计算实例 ECS g8i,这也是国内首款搭载第五代英特尔至强可扩展处理器(代号 EMR)的云计算产品。依托阿里云自研的「飞天+CIPU」架构体系,ECS g8i 实例的整机性能最高提升 85%,AI 推理性能最高提升 7 倍,可支撑高达 72B 参数的大语言模型,为 AI 提速,同时新实例还提供了端到端安全防护,为企业构建可信 AI 应用提供强有力的隐私增强算力支撑。

通用算力再提升,整机性能提升 85%

作为企业级通用计算实例,ECS g8i 实例在计算、存储、网络和安全等能力得到了全方位提升。从关键参数上看,ECS g8i 实例的 L3 缓存容量提升到 320MB,内存速率高达 5600MT/s,整机性能提升 85%,单核性能提升 25%;存储方面,ESSD 云盘提供 100万 IOPS,全面搭载 NVMe,存储延迟低至百微秒;网络方面,PPS 高达 3000 万,标配阿里云自研 eRDMA 大规模加速能力,时延低至 8 微秒;安全方面,ECS g8i 实例支持可信计算与加密计算等特性,全球率先支持机密虚拟机 TDX 技术,构建了全面的安全防护。

在 E2E 场景下,ECS g8i 实例可将 MySQL 性能提升最高达 60%,Redis 和 Nginx 的性能分别提升 40% 和 24%,面向游戏、视频直播、电商、金融、医疗、企业服务等行业提供强劲的算力支持,满足其在数据库、大数据、AI 推理等应用场景下对性能的严苛要求。

此外,ECS g8i 实例还提供了多种硬件原生加速能力,包括 QAT 和 IAA 等加速器。阿里云通过自研技术,将硬件加速能力更细颗粒度透传至实例虚拟机,小规格的 ECS g8i 实例也同样具备加速能力。其中,依托于 QAT 原生加解密加速器,ECS g8i 实例在压缩/解压缩场景下性能最大可提升 70 倍,加解密性能提升 4 倍以上。

为 AI 提速,可支撑 72B 参数的大语言模型

生成式 AI 掀起的技术革命,正在推动计算范式发生根本性的变化。当前,AI 大模型推理在算力上依然面临诸多挑战,例如首包延迟受限于并行处理能力与浮点运算能力,吞吐性能则受限于内存带宽和网络延迟。

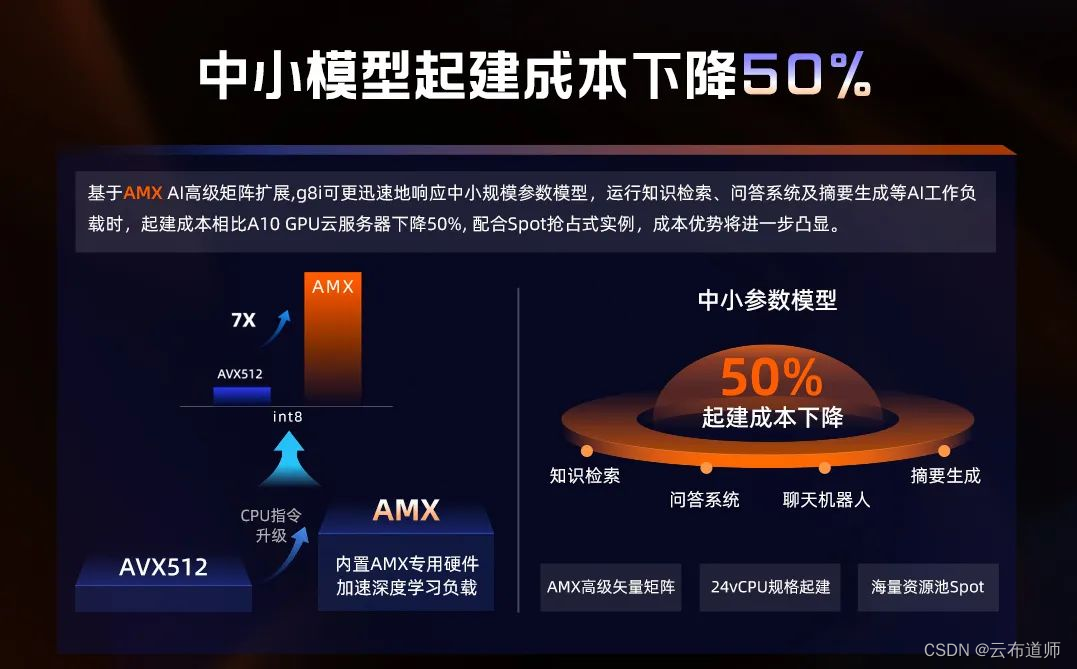

阿里云 ECS g8i 实例针对这些难题都进行了相当程度的优化,包括内置指令集从AVX512 升级到了 Intel AMX 高级矩阵扩展加速技术,可让生成式 AI 更快地运行。相对于 AVX512 指令集,启用 AMX AI 加速后,ECS g8i 实例在 int 8 矩阵计算的性能最高提升 7 倍。

基于 AMX AI 加速能力,g8i 可更迅速地响应中小规模参数模型,运行知识检索、问答系统及摘要生成等 AI 工作负载时,起建成本相比 A10 GPU 云服务器下降50%。此外,配合阿里云平台的 Spot 抢占式实例,成本优势将进一步凸显,进一步降低 AI 推理成本。

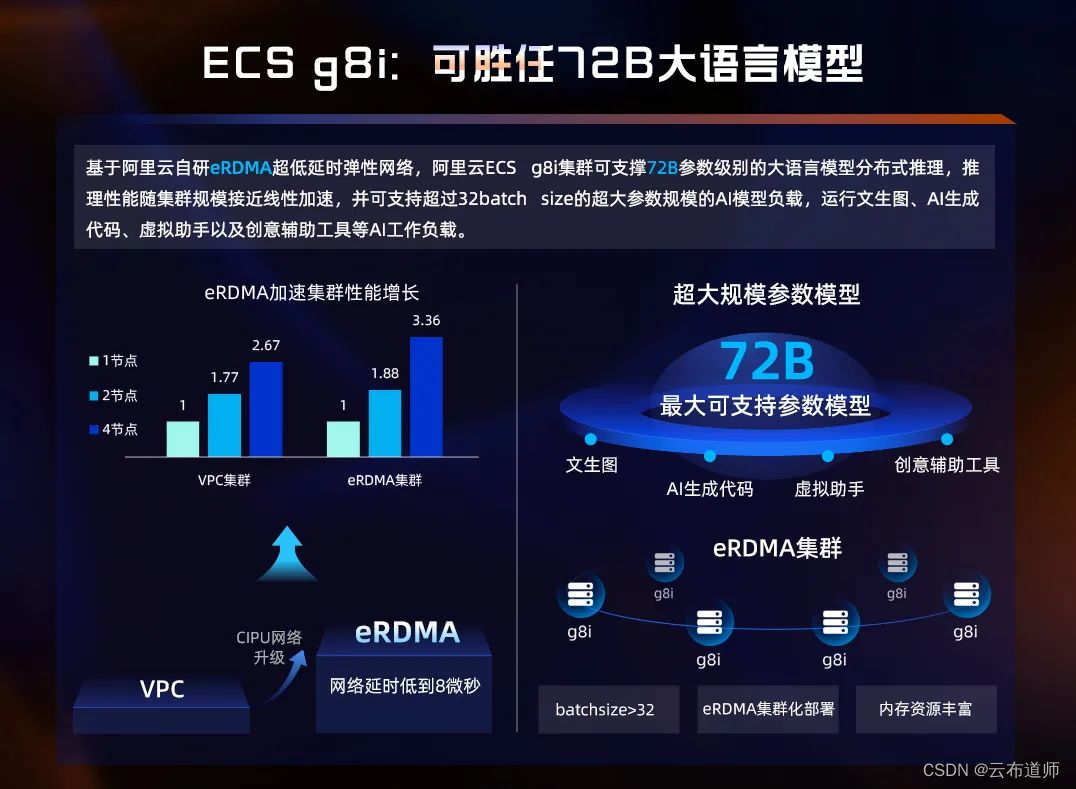

对于超大规模参数的模型来讲,通常会通过模型并行、流水线并行切分到 AI 集群,这个时候网络通讯成了主要的性能瓶颈。基于阿里云自研的 eRDMA 超低延时弹性网络,ECS g8i 实例集群拥有超低延时网络和高弹性优势,可轻松支撑 72B 参数级别的大语言模型分布式推理,推理性能随集群规模接近线性加速,并可支持超过32batchsize 的超大参数规模的 AI 模型负载,运行文生图、AI 生成代码、虚拟助手以及创意辅助工具等 AI 工作负载。

以阿里云开源的 Qwen-72B 大模型为例,可在 g8i 实例 eRDMA 网络构建的集群实现高效运行,在输入小于 500 字情况下,首包延时小于 3 秒,每秒可生成 7 个Token。

为安全加码,助力企业构建可信 AI 应用

长久以来,云厂商一直在不遗余力提升数据的隐私保护和安全性,AI 时代尤为明显。基于自研的 CIPU,阿里云在全产品线构建了端到端的安全防护,可保障数据存储、数据传输、数据计算的全流程安全。在最底层,基于 CIPU 的安全架构搭载安全芯片 TPM 作为硬件可信根,实现服务器的可信启动,确保零篡改;虚拟化层面,支持虚拟可信能力 vTPM,提供实例启动过程核心组件的校验能力;在实例可信的基础上支持不同平台的机密计算能力,实现了运行态的内存数据隔离和加密的保护。

值得一提的是,此次升级的 ECS g8i 实例全量支持 Trust Domain Extension TDX 技术能力,业务应用无需更改,即可部署到 TEE 之中,极大降低了技术门槛,并以极低的性能损耗为大模型等 AI 应用提供隐私增强算力,护航大模型的云上数据安全。

以 Qwen-Chat-7B 模型为例,启用 TDX 后,既确保了模型推理的安全可信,也保护了数据的机密性和完整性。