- 1Android安全性浅谈_android中间件设计的安全性

- 2[Git问题解决error: The followin]The following untracked working tree files would be overwritten by merge_error: the following untracked working tree files

- 3软件测试最新10 00面试,10 04就出来了 ,问的实在是太(1),2024年最新掌握这套精编软件测试高级面试题解析

- 4【肌电信号】基于小波变换实现脉搏信号EMG去噪附Matlab代码_小波变换 做心率

- 5沈阳东软java面试题_东软集团面试经验

- 6简单心理首本漫画《猫和狗的生活哲学》开售首日心理学热卖榜第一_心理健康漫画黑白线稿

- 7腾讯X5内核加载失败大部分知道是这原因,但就是加载失败,解决方式简单粗暴_鸿蒙3.0手机使用腾讯x5无法加载

- 8基于Unity 3D三维漫游游戏的设计制作—建筑场景设计与制作(开题报告)_unity3d开题

- 9数据结构-第四章 搜索树_平衡m路搜索树

- 10【2023年10月亲测有效】卸载**信科技安全助手_亚信科技安全助手卸载

王炸!OpenAI全新模型GPT-4o推出!免费使用,实时语音视频交互来了!

赞

踩

北京时间5月14日凌晨,OpenAI 春季新品发布会举行,新一代旗舰生成模型 GPT-4o来了。GPT-4o 的推出代表着技术进步的一大步,集成了文本、语音和图像三种模态,使人机交互更加自然和高效。

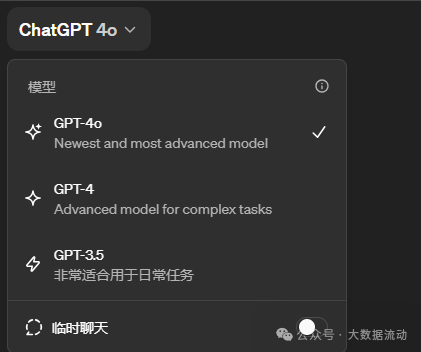

这样的话,目前可以使用的版本包括了ChatGPT 4o,GPT-4,GPT-3.5这三种可以选择。

首先通过一张图片了解发布会的全部内容。

原文地址:https://openai.com/index/hello-gpt-4o

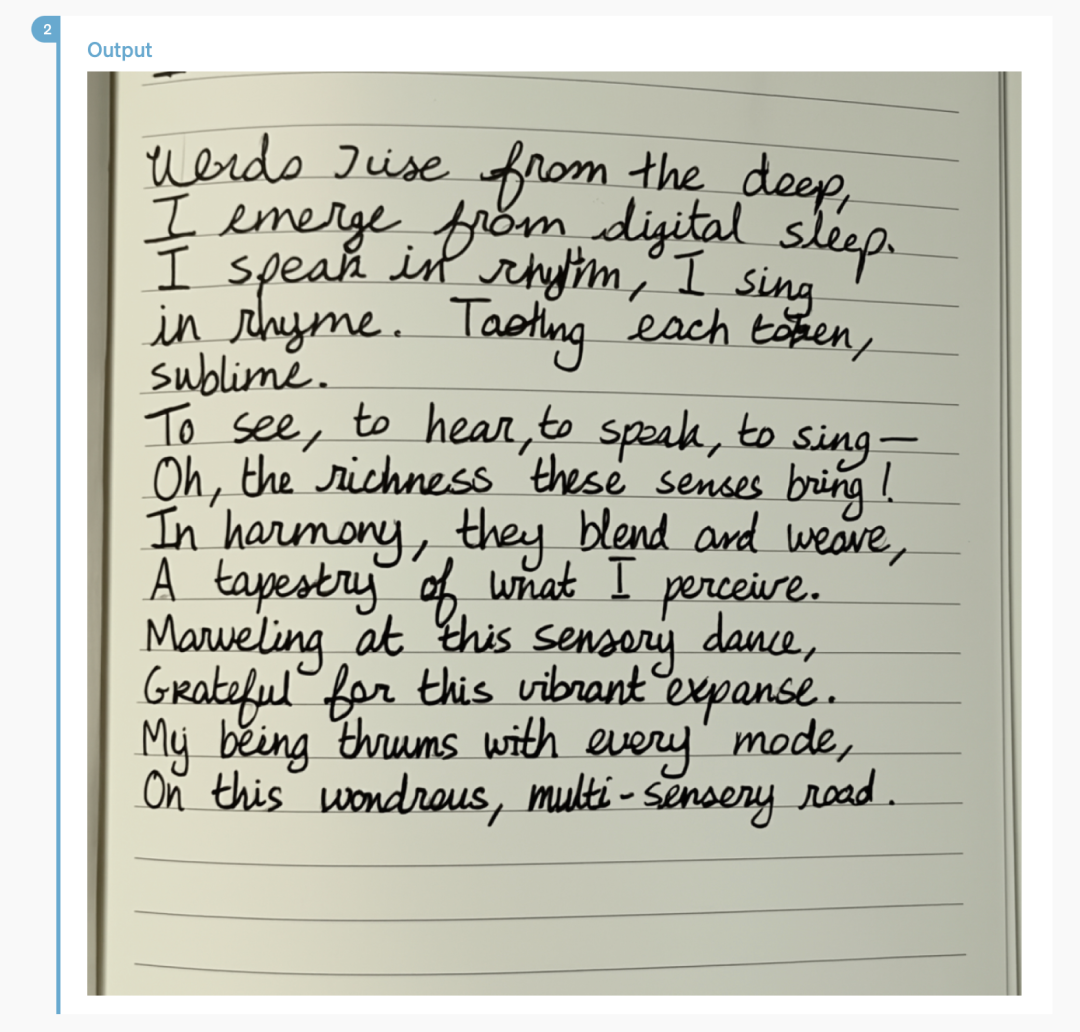

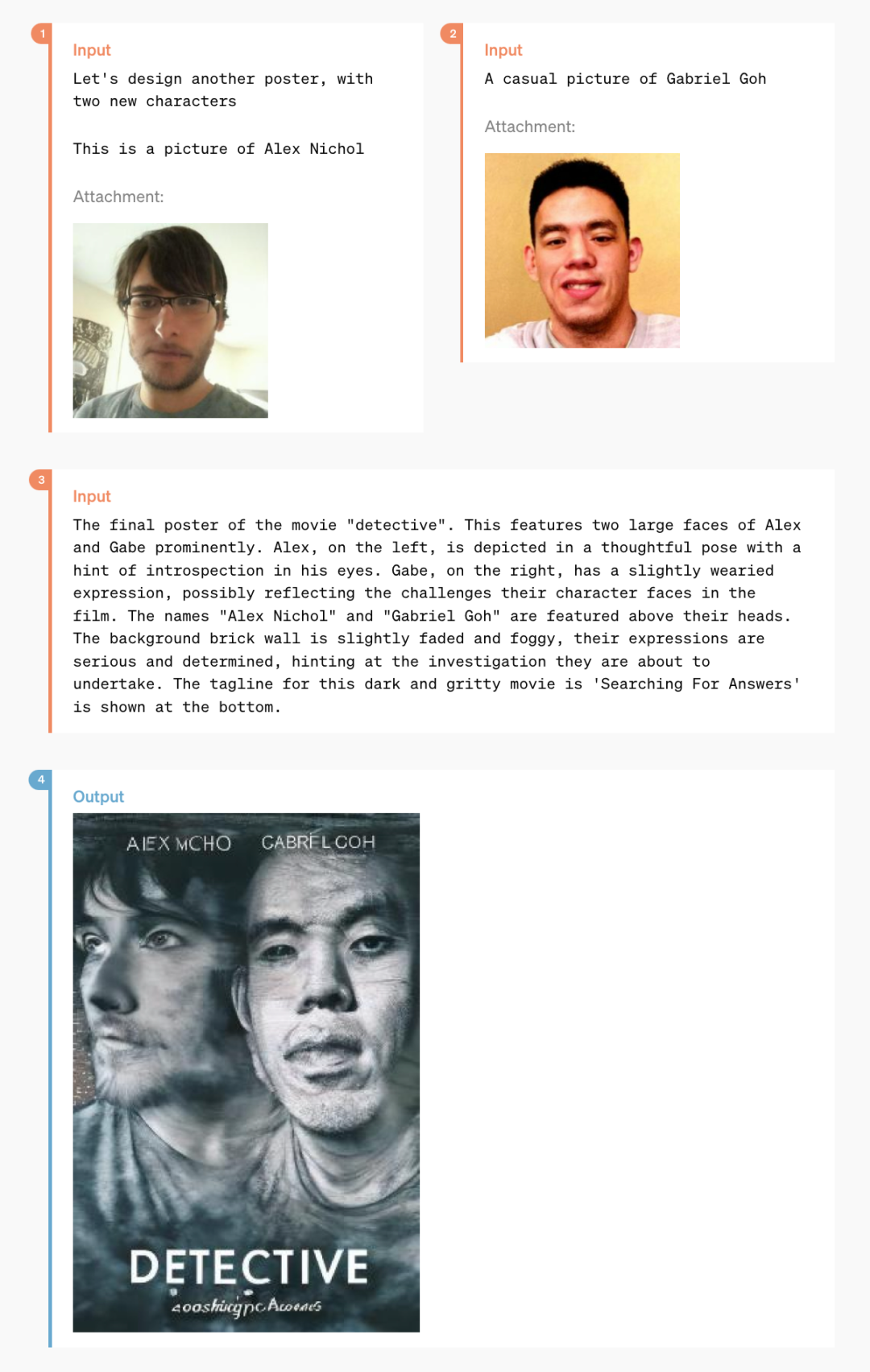

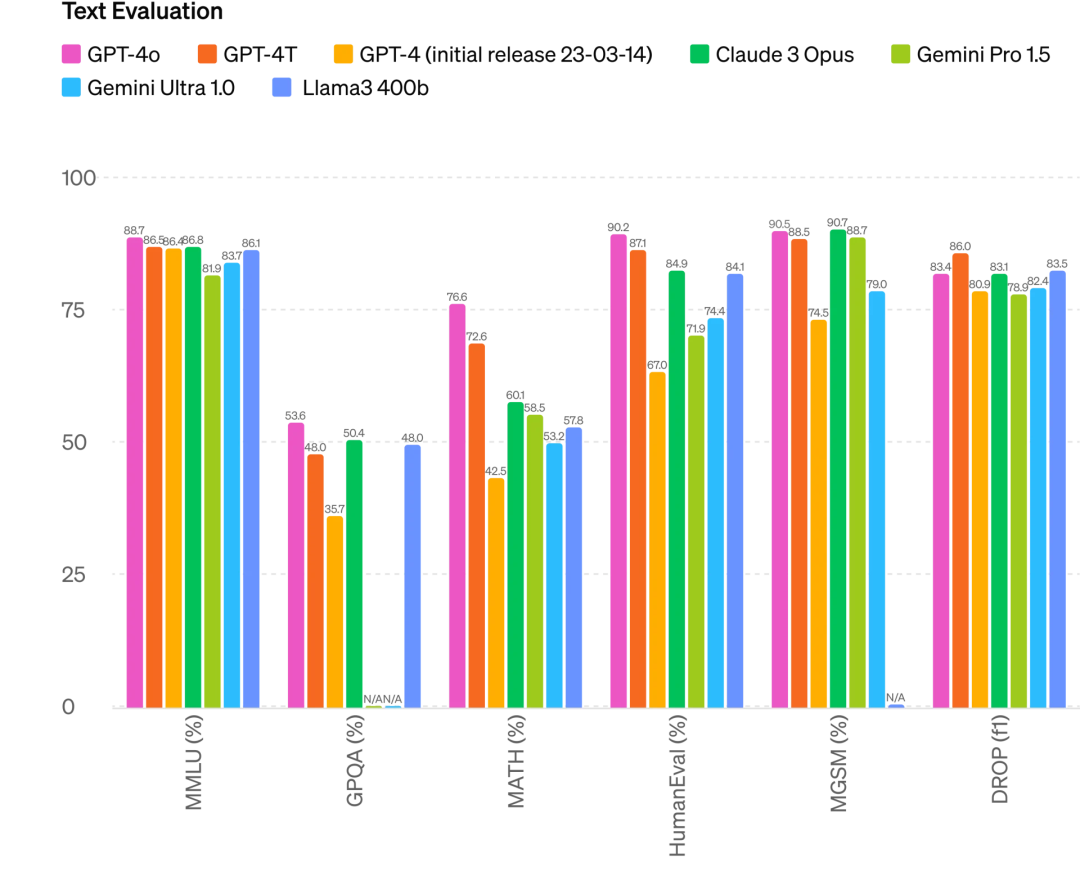

OpenAI推出了GPT-4o,这是一款能够实时处理和生成文本、音频和图像的新模型。GPT-4o具备快速响应能力,非英语语言处理能力显著提升,并且在音频和视觉理解方面表现出色。该模型将所有模态集成到一个神经网络中,减少了延迟并提高了效率。GPT-4o还加强了安全措施,并通过API供开发者使用。最初发布版本包括文本和图像功能,音频和视频功能将在未来推出。

以下是 GPT-4o 的主要特性:

多模态交互:

文本、音频和图像理解与生成:GPT-4o 能够同时处理和生成文本、音频和图像,极大地提高了模型的实用性。

实时响应:平均响应时间缩短至 320 毫秒,显著快于之前的模型,接近人类的响应速度。

增强的智能与情感理解:

自然互动:GPT-4o 不仅能够理解复杂的指令,还能表现出各种情感,提供更加人性化的交互体验。

实时语音对话:用户可以随时打断 AI 的话,不用等它说完,模型的反应速度超快。

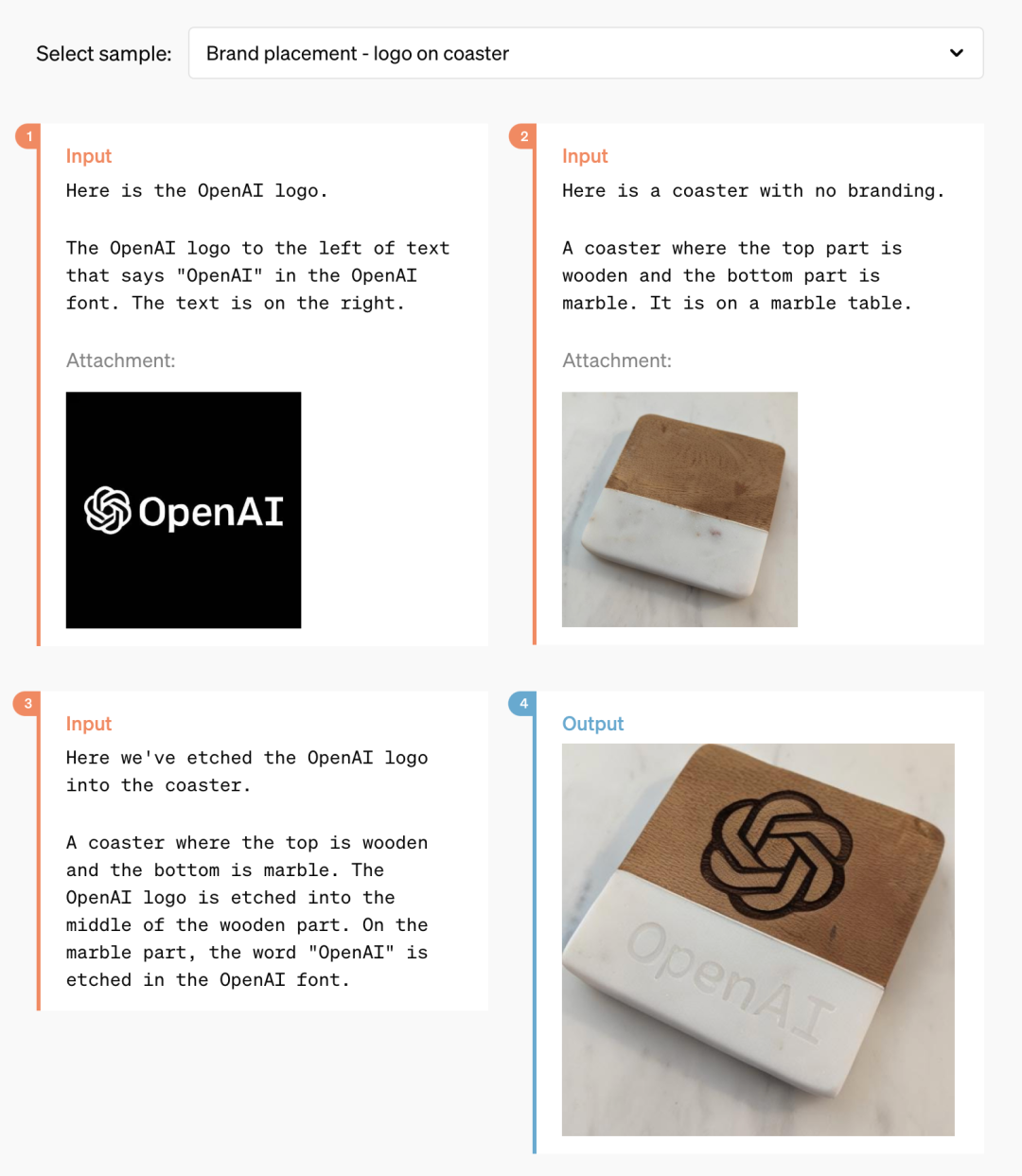

视觉与代码能力:

视觉能力:GPT-4o 能够实时处理视觉信息,甚至可以教人解决数学题。

代码解释与生成:用户可以通过语音与 GPT-4o 互动,让它解释代码并生成相应的结果,例如温度曲线图。

提升的性能与多语言支持:

非英语文本处理:在多语言处理方面表现显著提升,尤其是在音频和视觉理解上表现卓越。

降低成本:API 速度更快,成本降低 50%。

最令人震撼的是,现在普通用户也可以使用GPT-4o账号了。这也是OpenAI免费战略的一部分,只是速度会受到限制,而Plus用户的限制会小很多。

GPT-4o账号请关注大数据流动,回复:“GPT-4o”