热门标签

热门文章

- 1文本的向量化表示总结_当前比较流行的文本向量化算法有

- 2计算机视觉方向怎么样?应该怎么准备计算机视觉方向保研?_计算机视觉考研

- 3How Rocket Companies run their data science platform on AWS

- 4李沐动手学深度学习pytorch :问题:找不到d2l包,No module named ‘d2l’_modulenotfounderror: no module named 'd2l

- 5TF-IDF实现关键词提取_tfidf关键词提取

- 6空间和时间 ----节选《时间简史》 霍金_python人马大战csdn免费专区

- 7图像情感分析标签分布学习

- 8机器学习入门指南_机器学习入门教程

- 9ESP8266 开发之旅 网络篇 无线更新 --OTA 固件更新_zolo-1d-pp1sl0dbijy

- 10作业_比较不同分类模型_hourlyrate和monthlyincome 的区别

当前位置: article > 正文

论文笔记:Cross -Scale Self-Attention Module(CSSA):跨尺度自注意力模块

作者:weixin_40725706 | 2024-04-02 23:02:31

赞

踩

论文笔记:Cross -Scale Self-Attention Module(CSSA):跨尺度自注意力模块

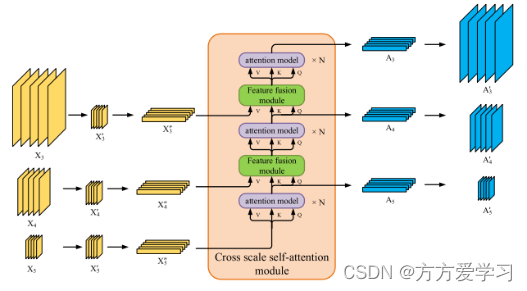

网络原理及流程:

CSSA模块包括注意力模块和特征融合模块。网络中与正常的注意力模块不同之处是利用特征融合将深层特征向量作为Q和K的输入,将浅层特征向量作为V的输入,这种方式通过深层特征之间的高语义相关性来丰富增强浅层的特征。

ResNet 50 中的第i阶段的最后模块产出为Xi(C*H·W), 首先经过一系列的卷积核为3的卷积变换压缩特征块为(256*H·W)为Xi’,接Xi下来Xi’在空间上被分成向量Xi’’,对于最深特征Xi’’通过注意力模块得到,此时的深层作为向上的K和Q,浅层的特征作为V,先进性特征融合,后进入注意力模块进一步增强获得Ai。

网络结构图如下:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/weixin_40725706/article/detail/353980

推荐阅读

相关标签