- 1基于STM32+SPI+FLASH芯片跨页读写擦除的实现_芯片的擦除,覆盖,写入

- 2STP——STP生成树协议讲解_stp协议

- 3SpringCloud学习笔记:Eureka注册中心_springcloud服务注册中心学习笔记

- 4A star与RRT搜索的速度和效率对比,A satr VS Rapidly Exploring Random Trees_rrt和a星

- 5【免安装的MATLAB--MATLAB online】

- 6openstack-t 之Horizon(dashboard)_openstack修改默认时区

- 7Devops初讲

- 8java集合进行排序的两种方式--自然排序和定制排序_自然排序集合还有那些实现排序的方法

- 9maya导入abc动画_人物动画极速制作宝典分享!再也不用担心项目周期不够了

- 10U盘所有文件(夹)变成.exe文件的解决方法_文件夹复制到优盘里把优盘所有文件弄成exe

HDFS编程实践_hadoop创建目录命令

赞

踩

HDFS编程实践

首先开启hadoop

hadoop 时,无需进行 NameNode 的初始化

cd /usr/local/hadoop

./sbin/start-dfs.sh #启动hadoop

- 1

- 2

1.利用Shell命令与HDFS进行交互

有三种shell命令方式。

- hadoop fs 适用于任何不同的文件系统,比如本地文件系统和HDFS文件系统

- hadoop dfs 只能适用于HDFS文件系统

- hdfs dfs 跟hadoop dfs的命令作用一样,也只能适用于HDFS文件系统

1.1 目录操作

HDFS中为hadoop用户创建一个用户目录

cd /usr/local/hadoop

./bin/hdfs dfs -mkdir -p /user/hadoop

- 1

- 2

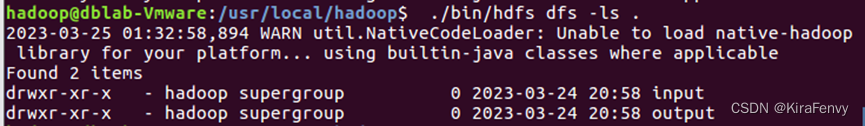

显示HDFS中与当前用户hadoop对应的用户目录下的内容:

./bin/hdfs dfs -ls .

- 1

上面的命令和下面的命令是等价的:

./bin/hdfs dfs -ls /user/hadoop

- 1

如果要列出HDFS上的所有目录,可以使用如下命令,“.”表示HDFS中的当前用户目录,也就是“/user/hadoop”目录

./bin/hdfs dfs -ls .

- 1

可以使用如下命令创建一个input目录,这个input目录创建成功以后,它在HDFS中的完整路径是“/user/hadoop/input”。

./bin/hdfs dfs -mkdir input

- 1

在HDFS的根目录下创建一个名称为input的目录

./bin/hdfs dfs -mkdir /input

- 1

可以使用rm命令删除一个目录,比如,可以使用如下命令删除刚才在HDFS中创建的“/input”目录(不是“/user/hadoop/input”目录):

./bin/hdfs dfs -rm -r /input

- 1

-r是递归删除(删除目录及其子目录所有内容)

1.2 文件操作

在实际应用中,经常需要从本地文件系统向HDFS中上传文件,或者把HDFS中的文件下载到本地文件系统中。

在本地Linux文件系统的“/home/hadoop/”目录下创建一个文件myLocalFile.txt

cd /home/Hadoop/

gedit myLocalFile.txt

- 1

- 2

里面可以随意输入一些单词,比如,输入如下三行:

Hadoop

Spark

XMU DBLAB

- 1

- 2

- 3

把本地文件系统的“/home/hadoop/myLocalFile.txt”上传到HDFS中的当前用户目录的input目录下,也就是上传到HDFS的“/user/hadoop/input/”目录下:

./bin/hdfs dfs -put /home/hadoop/myLocalFile.txt input

- 1

使用ls命令查看一下文件是否成功上传到HDFS中

./bin/hdfs dfs -ls input

- 1

- 2

下面使用如下命令查看HDFS中的myLocalFile.txt这个文件的内容:

./bin/hdfs dfs -cat input/myLocalFile.txt

- 1

把HDFS中的myLocalFile.txt文件下载到本地文件系统中的“/home/hadoop/下载/”这个目录下,命令如下:

./bin/hdfs dfs -get input/myLocalFile.txt /home/hadoop/下载

- 1

到本地文件系统查看下载下来的文件myLocalFile.txt:

cd ~

cd 下载

ls

cat myLocalFile.txt

- 1

- 2

- 3

- 4

了解一下如何把文件从HDFS中的一个目录拷贝到HDFS中的另外一个目录。比如,如果要把HDFS的“/user/hadoop/input/myLocalFile.txt”文件,拷贝到HDFS的另外一个目录“/input”中(注意,这个input目录位于HDFS根目录下),可以使用如下命令:

./bin/hdfs dfs -cp input/myLocalFile.txt /input

- 1

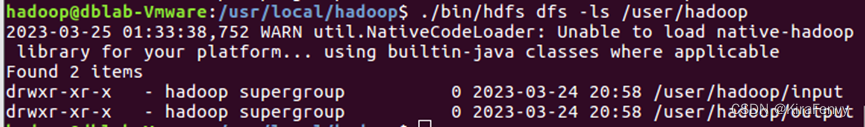

2.利用Web界面管理HDFS

WEB界面的访问地址是http://localhost:9870

3.利用Java API与HDFS进行交互

3.1 在Ubuntu中安装Eclipse

可以到Eclipse官网(https://www.eclipse.org/downloads/)下载安装包。文章是eclipse-4.7.0-linux.gtk.x86_64.tar.gz。假设安装文件下载后保存在了Linux系统的目录“~/Downloads”下,下面执行如下命令对文件进行解压缩:

cd ~/Downloads

sudo tar -zxvf ./eclipse-4.7.0-linux.gtk.x86_64.tar.gz -C /usr/local

- 1

- 2

启动eclipse

cd /usr/local/eclipse

./eclipse

- 1

- 2

3.2 使用Eclipse开发调试HDFS Java程序

Hadoop采用Java语言开发的,提供了Java API与HDFS进行交互。上面介绍的Shell命令,在执行时实际上会被系统转换成Java API调用。Hadoop API文档

假设在目录“hdfs://localhost:9000/user/hadoop”下面有几个文件,分别是file1.txt、file2.txt、file3.txt、file4.abc和file5.abc,现在需要从该目录中过滤出所有后缀名不为“.abc”的文件,对过滤之后的文件进行读取,并将这些文件的内容合并到文件“hdfs://localhost:9000/user/hadoop/merge.txt”中。

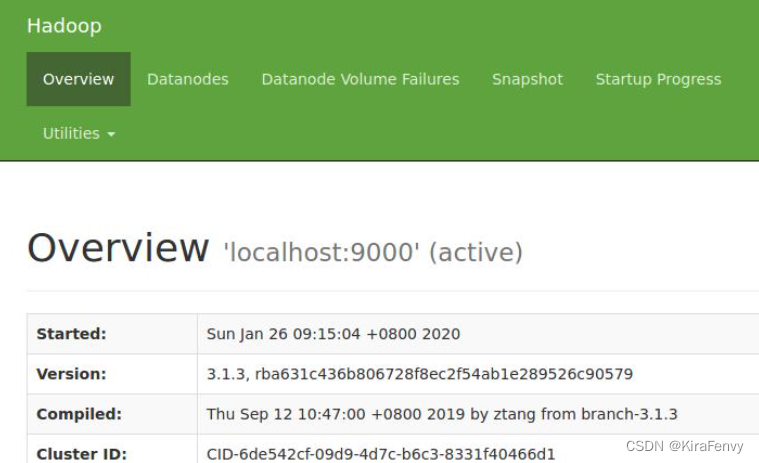

3.2.1 在Eclipse创建项目

“File–>New–>Java Project”

新项目设置

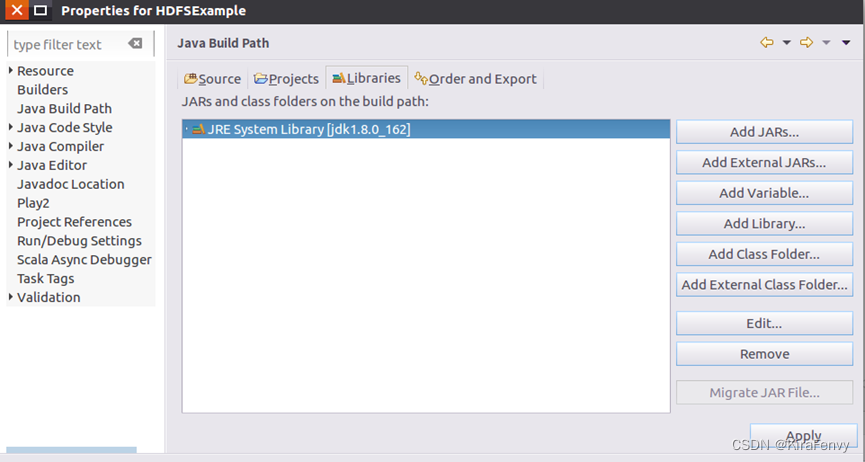

创建之后,在File->Properties找到Java Build Path,点Libraries

然后Add External JARs

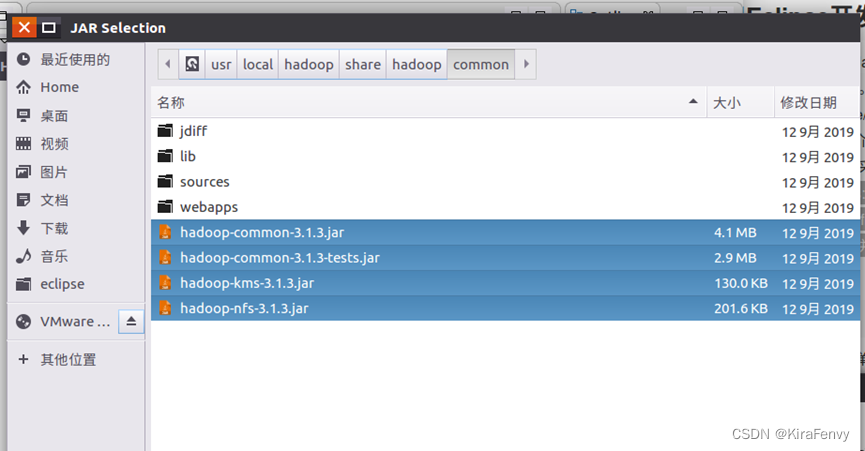

向Java工程中添加以下JAR包:

(1)“/usr/local/hadoop/share/hadoop/common”目录下的所有JAR包,包括hadoop-common-3.1.3.jar、hadoop-common-3.1.3-tests.jar、haoop-nfs-3.1.3.jar和haoop-kms-3.1.3.jar,注意,不包括目录jdiff、lib、sources和webapps;

(2)“/usr/local/hadoop/share/hadoop/common/lib”目录下的所有JAR包;

(3)“/usr/local/hadoop/share/hadoop/hdfs”目录下的所有JAR包,注意,不包括目录jdiff、lib、sources和webapps;

(4)“/usr/local/hadoop/share/hadoop/hdfs/lib”目录下的所有JAR包。

3.3 编写Java应用程序

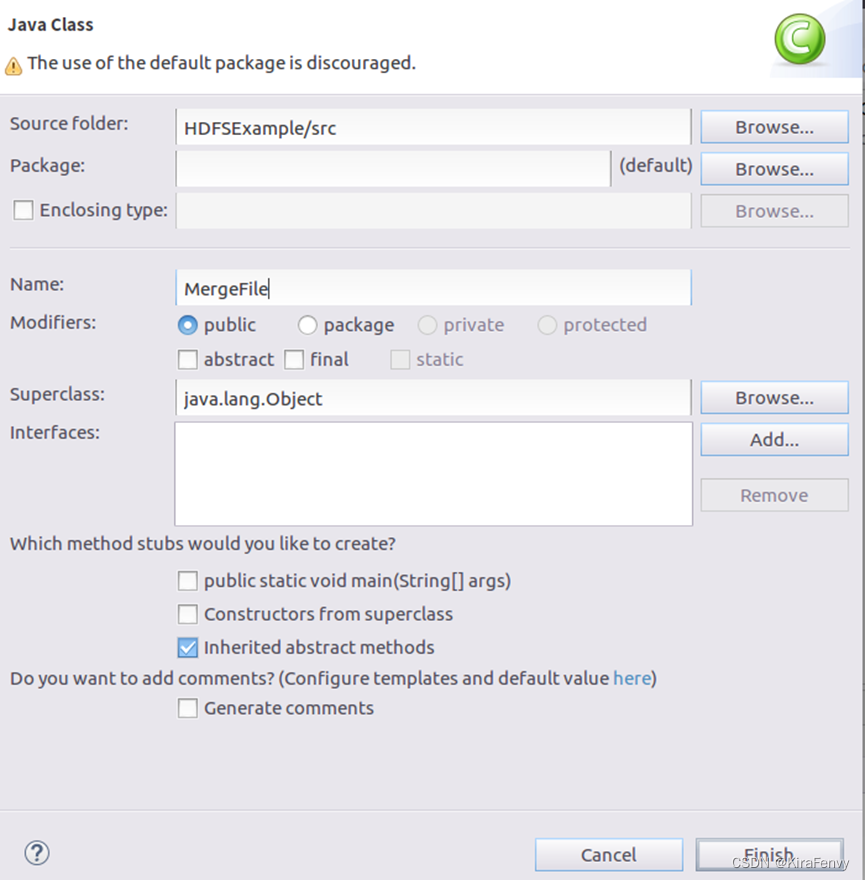

“Package Explorer”面板中(如下图所示),找到刚才创建好的工程名称“HDFSExample”,然后在该工程名称上点击鼠标右键,在弹出的菜单中选择“New–>Class”菜单。

只需要在“Name”后面输入新建的Java类文件的名称,这里采用名称“MergeFile”,其他都可以采用默认设置

“MergeFile.java”的源代码文件,请在该文件中输入以下代码:

import java.io.IOException; import java.io.PrintStream; import java.net.URI; import org.apache.hadoop.conf.Configuration; import org.apache.hadoop.fs.*; /** * 过滤掉文件名满足特定条件的文件 */ class MyPathFilter implements PathFilter { String reg = null; MyPathFilter(String reg) { this.reg = reg; } public boolean accept(Path path) { if (!(path.toString().matches(reg))) return true; return false; } } /*** * 利用FSDataOutputStream和FSDataInputStream合并HDFS中的文件 */ public class MergeFile { Path inputPath = null; //待合并的文件所在的目录的路径 Path outputPath = null; //输出文件的路径 public MergeFile(String input, String output) { this.inputPath = new Path(input); this.outputPath = new Path(output); } public void doMerge() throws IOException { Configuration conf = new Configuration(); conf.set("fs.defaultFS","hdfs://localhost:9000"); conf.set("fs.hdfs.impl","org.apache.hadoop.hdfs.DistributedFileSystem"); FileSystem fsSource = FileSystem.get(URI.create(inputPath.toString()), conf); FileSystem fsDst = FileSystem.get(URI.create(outputPath.toString()), conf); //下面过滤掉输入目录中后缀为.abc的文件 FileStatus[] sourceStatus = fsSource.listStatus(inputPath, new MyPathFilter(".*\\.abc")); FSDataOutputStream fsdos = fsDst.create(outputPath); PrintStream ps = new PrintStream(System.out); //下面分别读取过滤之后的每个文件的内容,并输出到同一个文件中 for (FileStatus sta : sourceStatus) { //下面打印后缀不为.abc的文件的路径、文件大小 System.out.print("路径:" + sta.getPath() + " 文件大小:" + sta.getLen() + " 权限:" + sta.getPermission() + " 内容:"); FSDataInputStream fsdis = fsSource.open(sta.getPath()); byte[] data = new byte[1024]; int read = -1; while ((read = fsdis.read(data)) > 0) { ps.write(data, 0, read); fsdos.write(data, 0, read); } fsdis.close(); } ps.close(); fsdos.close(); } public static void main(String[] args) throws IOException { MergeFile merge = new MergeFile( "hdfs://localhost:9000/user/hadoop/", "hdfs://localhost:9000/user/hadoop/merge.txt"); merge.doMerge(); } }

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

3.4 编译运行程序

在开始编译运行程序之前,请一定确保Hadoop已经启动运行,如果还没有启动,需要打开一个Linux终端,输入以下命令启动Hadoop:

cd /usr/local/hadoop

./sbin/start-dfs.sh

- 1

- 2