热门标签

热门文章

- 1使用hping3网络工具构造TCP/IP数据包和进行DDos攻击_hping3 ddos 攻击

- 2SQLyog安装配置(注册码)连接MySQL_注册sqlyog在哪输入名称

- 3辅助脚本使用教程手册_野马脚本

- 4RoboCom机器人大赛使用yolov5抽取20个随机图片进行人群识别_编写代码,从100张图片中随机选出20张图片,识别出图片中的虛拟人物,统计虚拟人物的

- 5ROS 2 Humble Hawksbill发布时间节点(转载)_ros2开线程监控发布时间

- 6伪分布式Hadoop+Spark+Scala的搭建

- 7chromium 53 chrome 各个版本发布功能列表(85-108)

- 8python通过数据库实现简单的注册+登录_用python使用字符串作为数据库,模拟注册与登录

- 9微信小程序开发学习笔记《17》uni-app框架-tabBar_uniapp设置tabbar

- 10在pandas导入csv文件时出现 ‘utf-8‘ codec can‘t decode_pandas读取csv文件报错utf-8

当前位置: article > 正文

生物医药相关大模型:BioMedLM、Mixtral_BioMedical、Med-PaLM2、BioMistral、BioMedGPT、OpenBioLLM

作者:不正经 | 2024-05-12 12:29:39

赞

踩

生物医药相关大模型:BioMedLM、Mixtral_BioMedical、Med-PaLM2、BioMistral、BioMedGPT、OpenBioLLM

BioMedLM:

https://huggingface.co/stanford-crfm/BioMedLM

Mixtral_BioMedical:

https://huggingface.co/LeroyDyer/Mixtral_BioMedical_7b

Med-PaLM:

https://sites.research.google/med-palm/

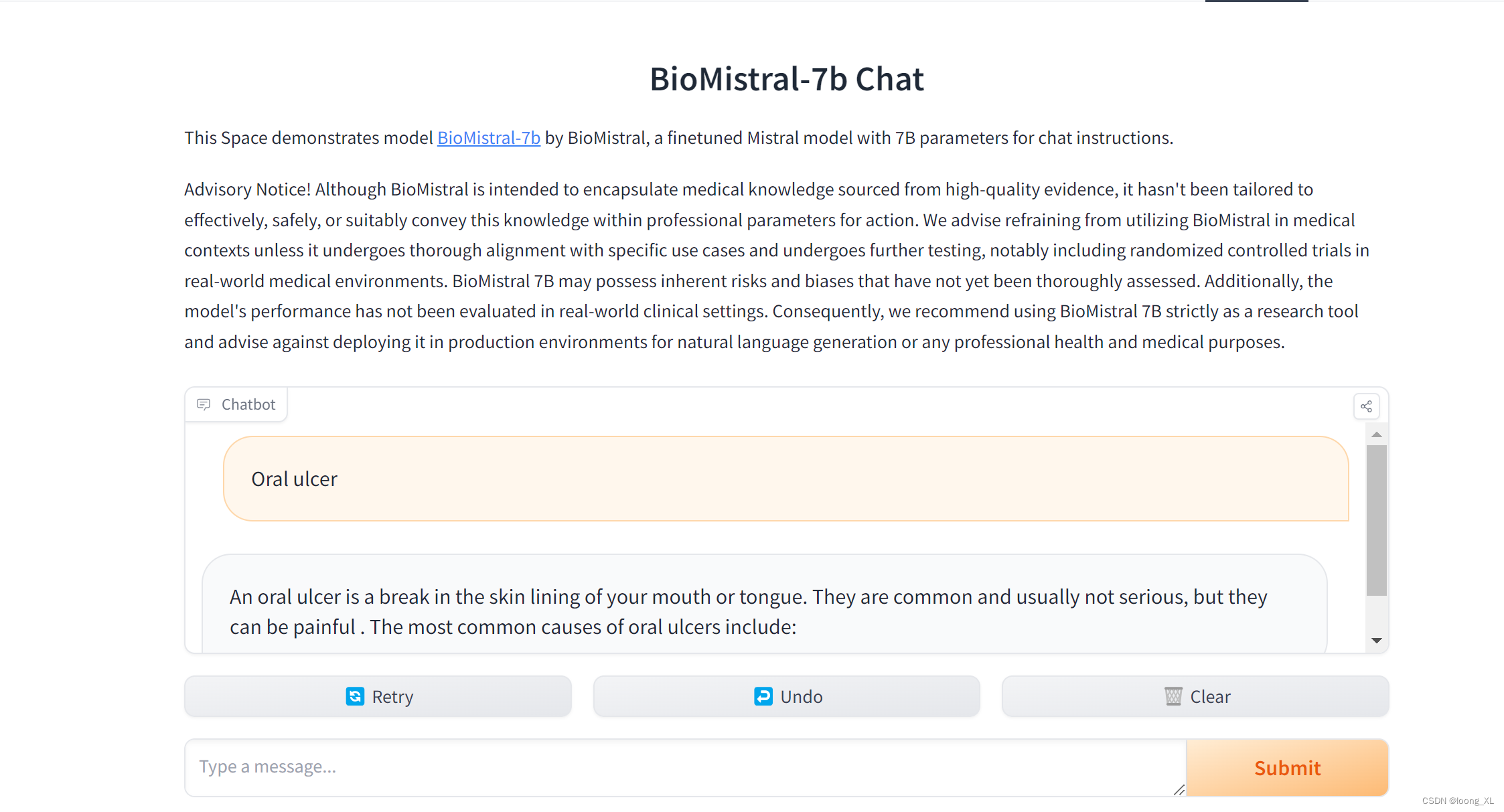

BioMistral:

https://huggingface.co/BioMistral/BioMistral-7B

BioMedGPT:

https://github.com/PharMolix/OpenBioMed/blob/main/README-CN.md

OpenBioLLM-70B

https://huggingface.co/aaditya/OpenBioLLM-Llama3-8B

主要就是将生物医药相关知识,文本、图像等多模态数据进行构建的行业大模型进行知识问答

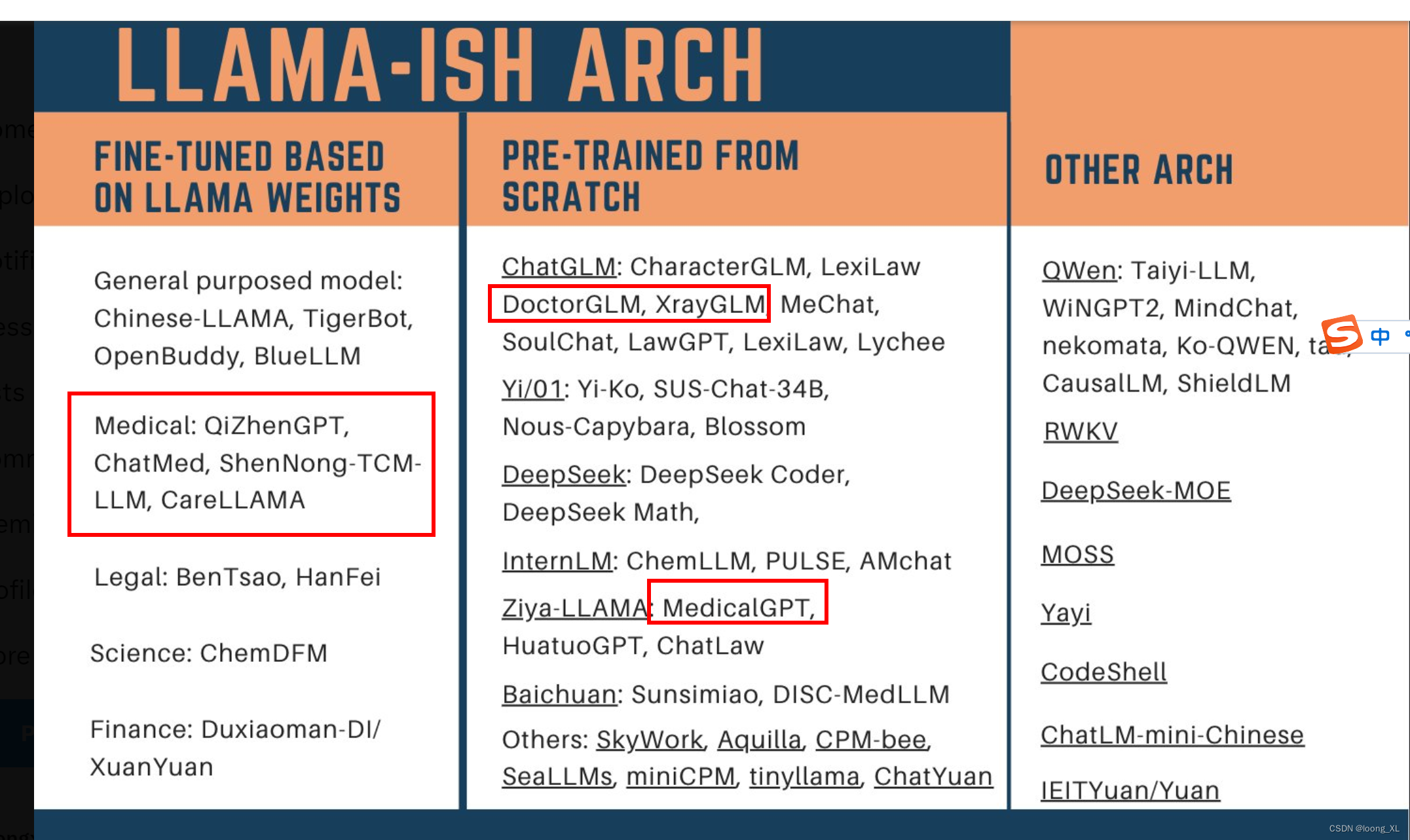

中文领域相关模型:

简单在线网页体验

https://huggingface.co/spaces/Artples/BioMistral-7b-Chat

代码运行

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM, BitsAndBytesConfig

model_id = "BioMistral/BioMistral-7B"

bnb_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_use_double_quant=True,

bnb_4bit_quant_type="nf4",

bnb_4bit_compute_dtype=torch.bfloat16

)

model = AutoModelForCausalLM.from_pretrained(

model_id,

quantization_config=bnb_config,

device_map="auto",

trust_remote_code=True,

)

eval_tokenizer = AutoTokenizer.from_pretrained(model_id, add_bos_token=True, trust_remote_code=True)

eval_prompt = "The best way to "

model_input = eval_tokenizer(eval_prompt, return_tensors="pt").to("cuda")

model.eval()

with torch.no_grad():

print(eval_tokenizer.decode(model.generate(**model_input, max_new_tokens=100, repetition_penalty=1.15)[0], skip_special_tokens=True))

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/不正经/article/detail/558929

推荐阅读

相关标签