- 1常用 Git 命令清单

- 2如何搭建Java开发环境——JDK的安装与配置_第1关:配置开发环境 - javajdk的配置

- 3c语言链表实现_c语言实现链表

- 4kafka扩容和分区重新分配_kafaka空间扩容

- 5用matlab实现Dijkstra算法,内附函数详解_dijkstra matlab

- 6N皇后问题(Java深度优先递归解法)_n皇后问题java

- 7commonjs vs ES module in Node.js_annotate the commonjs export names for esm import

- 8全网最好玩的谷歌相机AGC8.4版本,体验70合一的拍照快感_谷歌相机70合1

- 9AIGC:让传统农村小型作坊焕发新能量

- 10Python 异常的传递性_python的异常传递

【Spark MLlib】(五)随机森林(Random Forest,靠着这份190页的面试资料

赞

踩

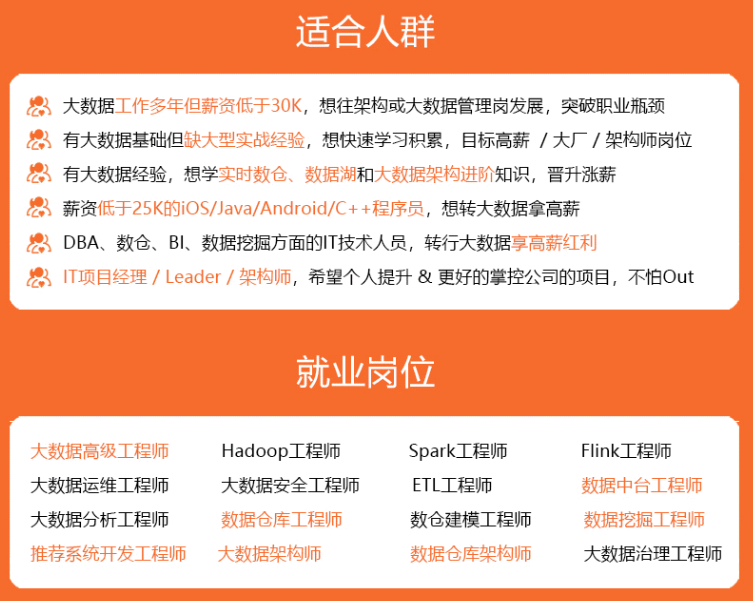

先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

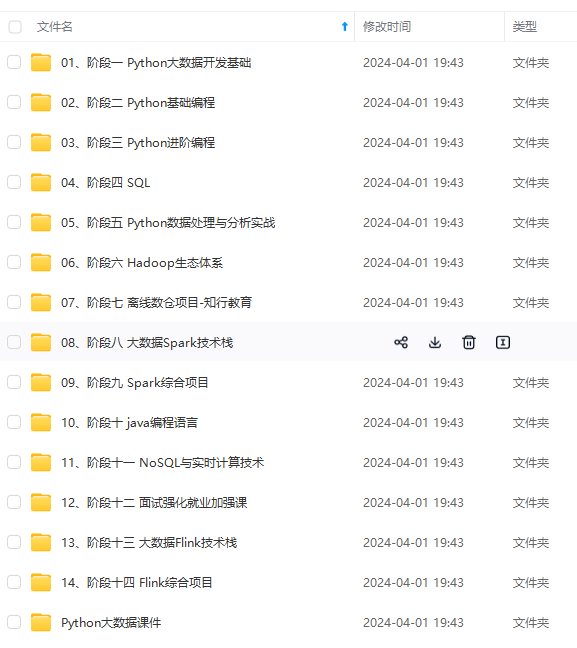

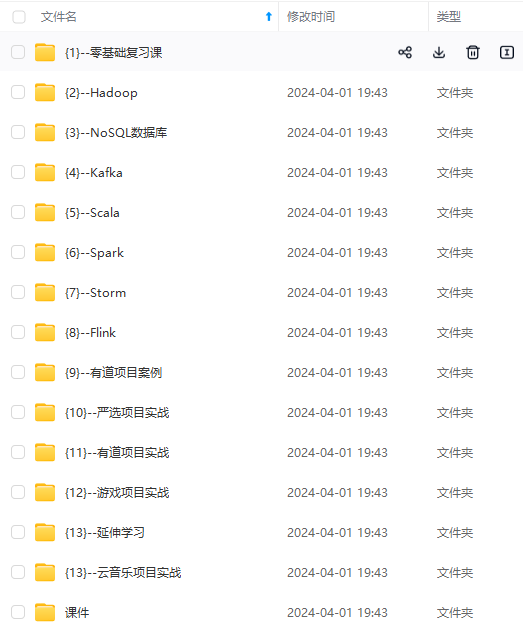

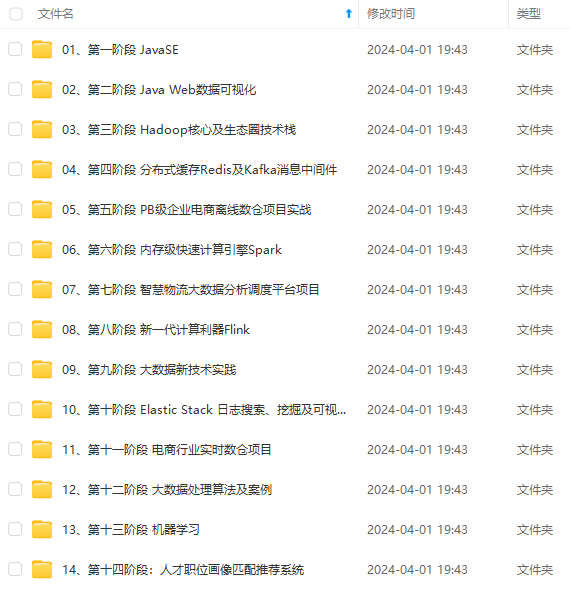

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

首先我们来对决策树和随机森林进行简单的了解:

决策树 GBDT-Decision Tree(DT)

- 关键问题

- 节点分裂:使用的特征及阈值

- 特征选取:最小均方差、信息增益(ID3)、信息增益率(C4.5)

- 阈值:从特征值中选取、等步长选取最大最小值之间的值

- 叶子节点的值:叶子所属数据的均值(回归)、对应类别(分类)

- 截止条件:达到叶子节点数上限、继续划分无法使误差减小

- 节点分裂:使用的特征及阈值

在决策树的训练中,如上图所示,就是从根节点开始,不断的分裂,直到触发截止条件,在节点的分裂过程中要解决的问题其实就两个:

- 分裂点:一般就是遍历所有特征的所有特征值,选取impurity最大的分成左右孩子节点,impurity的选取有信息熵(分类),最小均方差(回归)等方法

- 预测值:一般取当前最多的class(分类)或者取均值(回归)

随机森林

随机森林就是构建多棵决策树投票,在构建多棵树过程中,引入随机性,一般体现在两个方面,一是每棵树使用的样本进行随机抽样,分为有放回和无放回抽样。二是对每棵树使用的特征集进行抽样,使用部分特征训练。

在训练过程中,如果单机内存能放下所有样本,可以用多线程同时训练多棵树,树之间的训练互不影响。

三、随机森林算法原理

随机森林是由多个决策树构成的森林,算法分类结果由决策树的投票结果得到,其属于集成学习中的bagging方法。算法的主要原理如下:

- 假设为一棵决策树,其中每个决策树的抽样方式为重抽样,独立抽样次,每次随机抽取个样本,就可组成个训练集数据集,且它们是相互独立同分布的。

- 单棵决策树的生长原则遵循:每次从数据集的全部特征属性中随机选取个来训练,并比较评估效果。选择内节点的分裂属性中评估效果最好的属性进行分裂,并且遵循节点不纯度的原则。决策树由根节点遍历向下分裂。那么由一系列的决策树组合得到随机森林,其中是独立同分布的随机变量。

- 对于分裂后的2个或以上的子节点,继续进行分裂直到数据集S能够正确评估,或者属性全部用完。每棵决策树都不进行剪枝,使其充分生长。

- 所生成的棵决策树构成了随机森林。随机性表现在两个方面:每棵树训练集的抽取过程与节点分裂时的特征属性的选择过程。这样各棵树之间的相关性很低。对于新样本输入时,根据训练好的模型,每一棵树都会对其评估一个值,根据投票机制给出样本的类别标签或者根据均值法给出回归结果。

四、Spark ML 优化随机森林

在 Spark 平台上,传统单机形式的迭代方式必须要进行相应改进才能适用于分布式环境,这是因为在分布式环境下,数据也是分布式的,算法设计不得当会生成大量的 IO 操作,影响算法效率三个优化策略。

1.切分点抽样统计

在单机环境下的决策树对连续变量进行切分点选择时,一般是通过对特征点进行排序,然后取相邻两个数之间的点作为切分点,如果在分布式环境下如此操作的话,会带来大量的网络传输操作,特别是当数据量达到 PB 级时,算法效率将极为低下 Spark 中的随机森林在构建决策树时,会对各分区采用一定的子特征策略进行抽样, 然后生成各个分区的统计数据,并最终得到切分点。

2.切分特征装箱(Binning)

决策树的构建过程就是对特征的取值不断进行划分的过程对于离散的特征,如果有M个值,最多个划分如果值是有序的,那么就最多 M-1个划分(按老,中,少的序,那么只有 m-1 个,即 2 种划分,老|中,少;老,中|少)

划分的点就是 split(切分点),划分出的区间就是 bin。对于连续特征 ,理论上 split 是无数的,在分布环境下不可能取出所有的值,因此它采用的是1中的切点抽样统计方法。

3.逐层训练(level-wise training)

单机版本的决策数生成过程是通过递归调用(本质上是深度优先)的方式构造树,在构造树的同时,需要移动数据,将同一个子节点的数据移动到一起

分布式环境下采用的策略是逐层构建树节点(本质上是广度优先),这样遍历所有数据的次数 等于所有树中的最大层数。每次遍历时,只需要计算每个节点所有切分点统计参数,遍历完后,根据节点的特征划分,决定是否切分,以及如何切分。

五、使用Spark ML分别进行回归与分类建模

数据集

No,year,month,day,hour,pm,DEWP,TEMP,PRES,cbwd,Iws,Is,Ir 1,2010,1,1,0,NaN,-21.0,-11.0,1021.0,NW,1.79,0.0,0.0 2,2010,1,1,1,NaN,-21,-12,1020,NW,4.92,0,0 3,2010,1,1,2,NaN,-21,-11,1019,NW,6.71,0,0 4,2010,1,1,3,NaN,-21,-14,1019,NW,9.84,0,0 5,2010,1,1,4,NaN,-20,-12,1018,NW,12.97,0,0 6,2010,1,1,5,NaN,-19,-10,1017,NW,16.1,0,0 7,2010,1,1,6,NaN,-19,-9,1017,NW,19.23,0,0 8,2010,1,1,7,NaN,-19,-9,1017,NW,21.02,0,0 9,2010,1,1,8,NaN,-19,-9,1017,NW,24.15,0,0 10,2010,1,1,9,NaN,-20,-8,1017,NW,27.28,0,0 11,2010,1,1,10,NaN,-19,-7,1017,NW,31.3,0,0 12,2010,1,1,11,NaN,-18,-5,1017,NW,34.43,0,0 13,2010,1,1,12,NaN,-19,-5,1015,NW,37.56,0,0 14,2010,1,1,13,NaN,-18,-3,1015,NW,40.69,0,0 15,2010,1,1,14,NaN,-18,-2,1014,NW,43.82,0,0 16,2010,1,1,15,NaN,-18,-1,1014,cv,0.89,0,0 ……

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

1、读取pm.csv,将含有缺失值的行扔掉(或用均值填充)将数据集分为两部分,0.8比例作为训练集,0.2比例作为测试集。

case class data(No: Int, year: Int, month: Int, day: Int, hour: Int, pm: Double, DEWP: Double, TEMP: Double, PRES: Double, cbwd: String, Iws: Double, Is: Double, Ir: Double)

def main(args: Array[String]): Unit = {

val conf = new SparkConf().setMaster("local[\*]").setAppName("foreast")

val sc = new SparkContext(conf)

val sqlContext = new SQLContext(sc)

Logger.getLogger("org").setLevel(Level.ERROR)

val root = MyRandomForeast.getClass.getResource("/")

import sqlContext.implicits._

val df = sc.textFile(root + "pm.csv").map(_.split(",")).filter(_ (0) != "No").filter(!_.contains("NaN")).map(x => data(x(0).toInt, x(1).toInt, x(2).toInt, x(3).toInt, x(4).toInt, x(5).toDouble, x(6).toDouble, x(7).toDouble, x(8).toDouble, x(9), x(10).toDouble, x(11).toDouble, x(12).toDouble)).toDF.drop("No").drop("year")

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

2、使用 month、day、hour、DEWP、TEMP、PRES、cbwd、Iws、Is、Ir 作为特征列(除去No,year,pm),pm作为label列,使用训练集、随机森林算法进行回归建模,使用回归模型对测试集进行预测,并评估。

val splitdf = df.randomSplit(Array(0.8, 0.2)) val (train, test) = (splitdf(0), splitdf(1)) val traindf = train.withColumnRenamed("pm", "label") val indexer = new StringIndexer().setInputCol("cbwd").setOutputCol("cbwd\_") val assembler = new VectorAssembler().setInputCols(Array("month", "day", "hour", "DEWP", "TEMP", "PRES", "cbwd\_", "Iws", "Is", "Ir")).setOutputCol("features") import org.apache.spark.ml.Pipeline val rf = new RandomForestRegressor().setLabelCol("label").setFeaturesCol("features") // setMaxDepth最大20,会大幅增加计算时间,增大能有效减小根均方误差 // setMaxBins我觉得和数据量相关,单独增大适得其反,要和setNumTrees一起增大 // 目前这个参数得到的评估结果(根均方误差)46.0002637676162 // val numClasses=2 // val categoricalFeaturesInfo = Map[Int, Int]()// Empty categoricalFeaturesInfo indicates all features are continuous. val pipeline = new Pipeline().setStages(Array(indexer, assembler, rf)) val model = pipeline.fit(traindf) val testdf = test.withColumnRenamed("pm", "label") val labelsAndPredictions = model.transform(testdf) **网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。** **需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)**  **一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!** V获取:vip204888 (备注大数据)** [外链图片转存中...(img-6MHrIp54-1713350731799)] **一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36