- 1VUE动态切换Button的icon_vue button icon

- 2【React】React 的StrictMode作用是什么,怎么使用?

- 3前端开发学习路线图,完整学习教程+工具+框架_前端流动路径图

- 4H3C接入层交换机和AC配置802.1x_交换机配置802.1x

- 5uniapp运行微信小程序--本地图片无法显示_uni-app微信小程序无法加载网络图片

- 6YOLOv8蒸馏 | 知识蒸馏 | 利用模型蒸馏改进YOLOv8进行无损涨点 | 在线蒸馏 (附代码 + 完整文件 + 解析教程)_yolo模型的知识蒸馏

- 7ElasticSearch系列 - SpringBoot整合ES:filter 过滤器查询原理_es中filterr

- 8【自然语言处理NLP】Bert中的特殊词元表示_bert cls

- 9rows between unbounded preceding and current row等,unbounded ,preceding ,following,current row含义详解

- 10【Spark】RDD入门编程实践(完整版)_rddfffffrrrdfffdrdrrrrddrdd4rrrrdrrrrrddrdrdrr4drd

CVPR最佳论文颁给自动驾驶大模型!中国团队第一单位,近10年三大视觉顶会首例...

赞

踩

金磊 假装发自 温哥华

量子位 | 公众号 QbitAI

这个高光时刻,属于自动驾驶,属于大模型,更是属于中国团队。

就在刚刚,CVPR 2023最佳论文新鲜出炉,2篇论文从总量高达9155篇的投稿中脱颖而出。

对于这2篇最佳论文中的任何一个,可以说用“万里挑一”来形容都不足为过了。

第一篇名为Planning-oriented Autonomous Driving(以路径规划为导向的自动驾驶),由上海人工智能实验室、武汉大学及商汤科技联合完成。

据了解,这是近十年来,计算机视觉三大顶级国际会议(CVPR、ICCV、ECCV)上,第一篇以中国学术机构作为第一单位的最佳论文。

第二篇名为Visual Programming: Compositional visual reasoning without training(视觉编程:未经训练的组合视觉推理),由艾伦人工智能研究所发表。

而在最佳论文的“候选名单”中,不乏谷歌、斯坦福大学、康奈尔大学等在内的顶尖企业和高校。

竞争之激烈,可见一斑。

那么这两篇为何能在众多论文中成为佼佼者,我们继续往下看。

首次提出感知决策一体的自动驾驶通用大模型

自动驾驶历来被人们称为集AI技术之大成者。

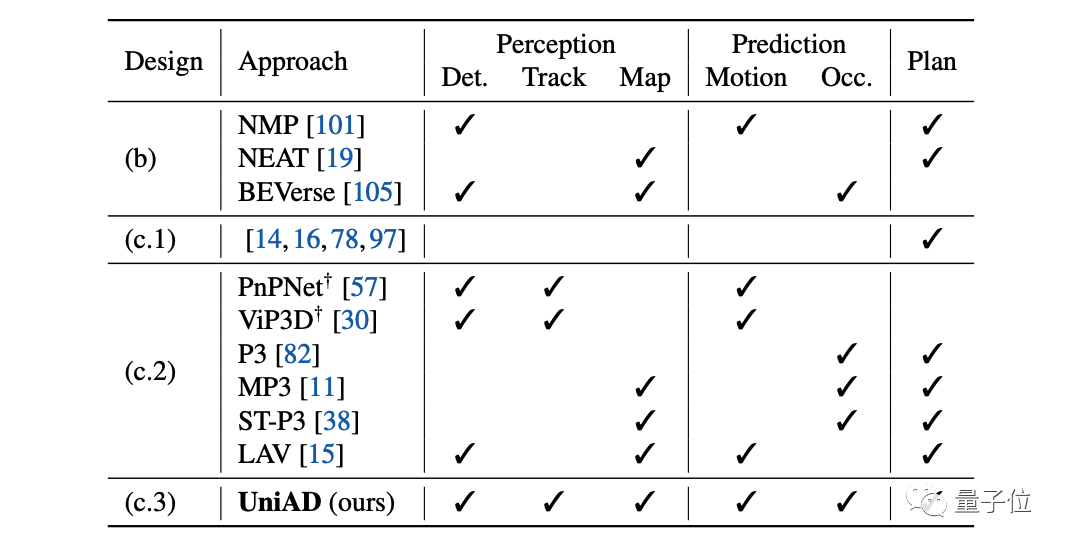

一般在自动驾驶任务中,通常包含三大模块,分别是感知、预测和规划,不过主流方案通常是分开来处理具体任务。

由此导致的缺陷也是比较明显,要么是任务之间协调不足,要么是影响到了整体性能的提升。

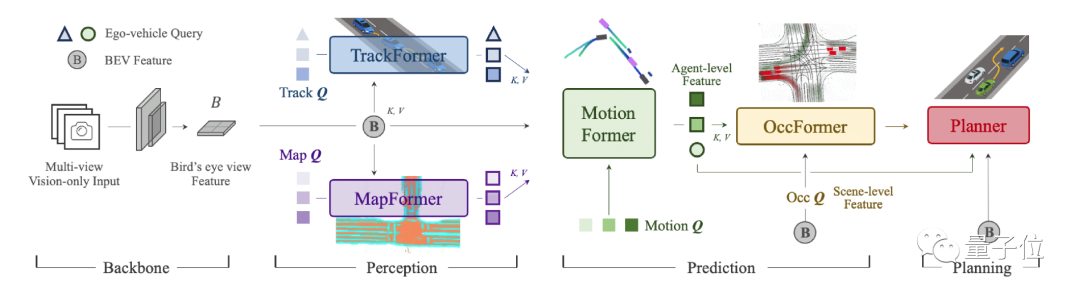

基于这样的一个背景,这篇论文便首次提出了感知决策一体化的自动驾驶通用大模型——UniAD。

UniAD是一个综合框架,将全栈驾驶任务整合到一个基于Transformer的端到端网络中。

除了我们刚才提到的三个主任务之外,还包括六个子任务,包括目标检测、目标跟踪、场景建图、轨迹预测、栅格预测和路径规划。

那么如此“大一统”的方式之下,结果又如何?

根据论文显示,在nuScenes真实场景数据集中,UniAD的所有任务均达到SOTA!

具体“实战”效果如下:

在面对采访时,上海人工智能实验室青年科学家李弘扬介绍:

凭借其充分的可解释性、安全性、与多模块的可持续迭代性,UniAD是目前为止最具希望实际部署的端到端模型。

值得一提的是,除了这篇最佳论文之外,上海人工智能实验室和商汤科技在本届CVPR中均取得了不凡的表现。

两个单位还联合斩获了一篇最佳论文候选,共计54篇论文被接收。

通过编写代码解决计算机视觉任务的AI

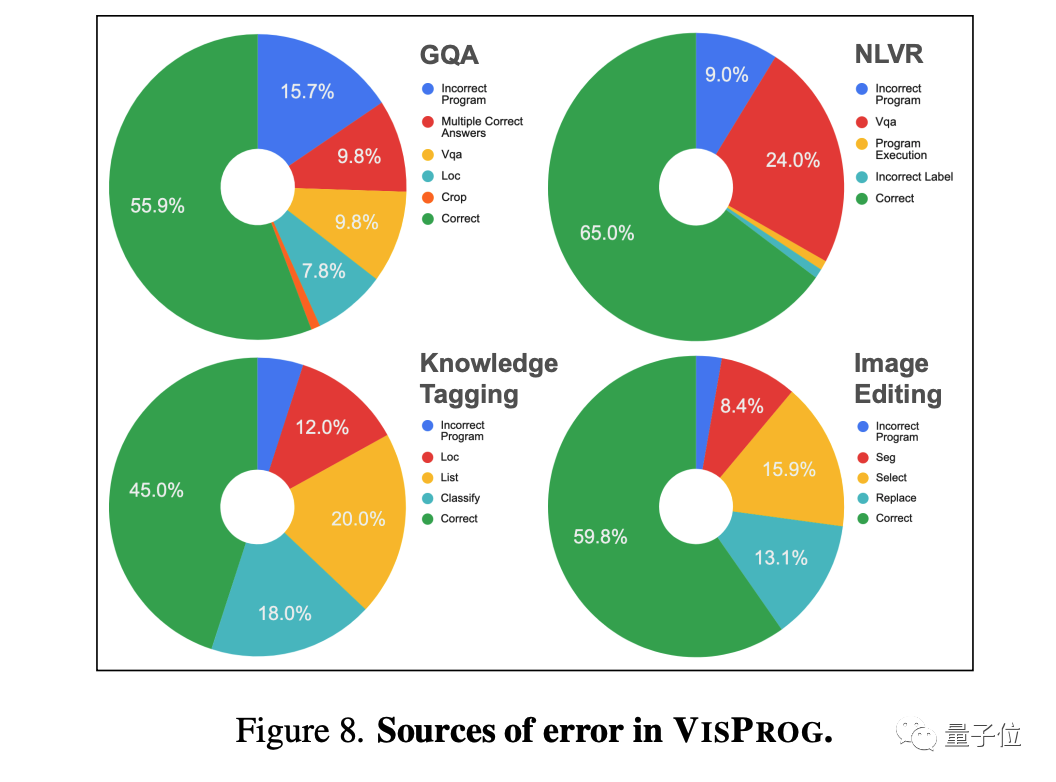

在第二篇论文中,研究人员提出了VISPROG,是一种神经符号结合(Neuro-Symbolic)的方法,用于在给定自然语言指令的情况下解决复杂和组合的视觉任务。

VISPROG无需对任何特定任务进行专门训练。

相反,它利用大语言模型的上下文学习能力,生成类似Python代码的模块化程序,然后执行这些程序来获得解决方案和全面且可解释的理由。

生成的程序的每一行可能会调用多个现成的计算机视觉模型、图像处理程序或Python函数,来生成可能被程序的后续部分使用的中间输出。

研究人员在四个不同的任务上展示了VISPROG的灵活性,包括组合视觉问答、对图像对进行零样本推理、事实知识对象标签和以语言引导的图像编辑。

研究人员表示:

像VISPROG这样的神经符号方法是令人兴奋的,它可以轻松有效地对AI系统做扩展,满足人们可能希望执行的复杂任务需求。

CVPR 2023其它奖项一览

除了2篇最佳论文之外,其它奖项也在刚刚的开幕式中逐一浮出水面。

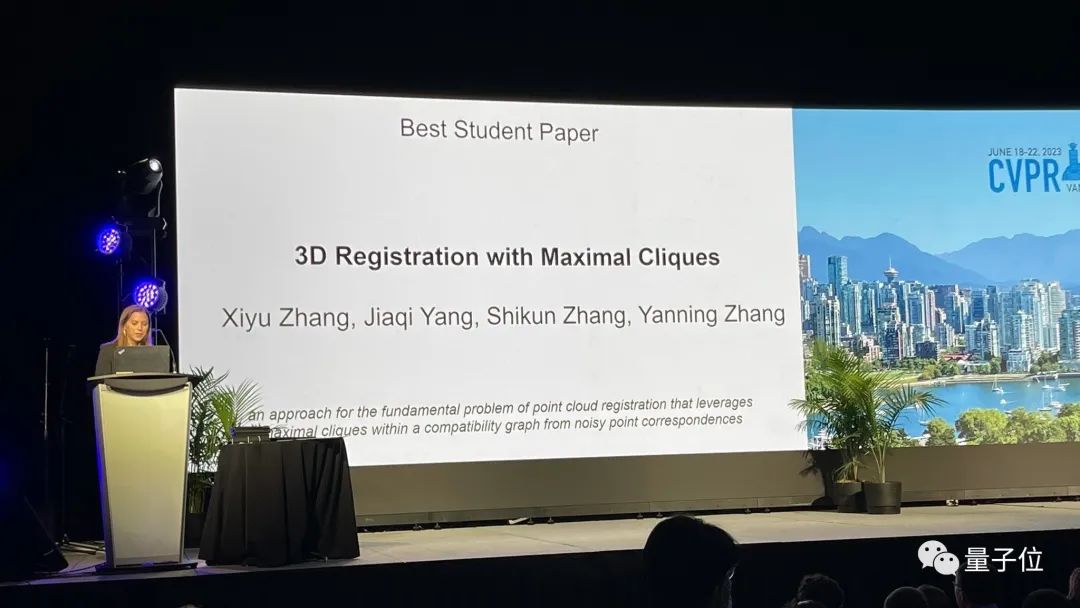

最佳学生论文——

3D Registration with Maximal Cliques。

这篇论文的作者来自西北工业大学,提出了一种新的3D点云配准方法,能够获得最优的姿态假设。

最佳学生论文荣誉奖——

DreamBooth: Fine Tuning Text-to-lmage Diffusion Models for Subject-Driven Generation。

来自谷歌,可以基于少量的图片,利用text-to-image模型将其转换到不同场景中,并且保持高分辨率。

这篇论文的方法已在AI绘画社区被广泛使用。

除此之外,大会还颁发了PAMITC奖,包括Longuet-Higgins奖、年轻研究者奖以及Thomas Huang纪念奖。

Longuet-Higgins奖——

年轻研究者奖——

Thomas Huang纪念奖——

关于本届最佳论文更细致的内容,可戳下方链接查看详情:

两篇最佳论文地址:

[1]https://arxiv.org/abs/2212.10156

[2]https://arxiv.org/abs/2211.11559

参考链接:

[1]https://twitter.com/cvpr/status/1671545306838626306?s=46&t=iTysI4vQLQqCNJjSmBODPw

[2]https://mp.weixin.qq.com/s/8svV4yxRi6TikcRivgHr_A

[3]https://finance.eastmoney.com/a/202306212759316444.html

[4]https://github.com/OpenDriveLab/UniAD

[5]https://blog.allenai.org/visual-programming-ca58c7af51cd

— 完 —

「AIGC+垂直领域社群」

招募中!

欢迎关注AIGC的伙伴们加入AIGC+垂直领域社群,一起学习、探索、创新AIGC!

请备注您想加入的垂直领域「教育」或「电商零售」,加入AIGC人才社群请备注「人才」&「姓名-公司-职位」。

点这里

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。