热门标签

热门文章

- 1【Sql Server】C#通过拼接代码的方式组合添加sql语句,会出现那些情况,参数化的作用

- 2Markdown语法之数学公式【总结】_markdown数学公式 点乘

- 3牛客_将链表m到n节点间的元素进行反转_c++反转链表中m位置到n位置的元素

- 4nginx作为tcp的负载均衡

- 5Xcode6模拟器路径的变更&应用沙盒地址的变更_xcode 沙盒路径 变化

- 6DELL PowerEdge R720XD 磁盘RAID及Hot Spare热备盘配置_dellr720配置raid

- 7Linux运维工程师面试题全面汇总(2023)_linux运维面试

- 8压缩qcow2虚拟机镜像文件_pve qcow2 压缩

- 9第二节HarmonyOS DevEco Studio创建项目以及界面认识_deveco studio 创建harmony项目

- 10Hadoop从入门到入土(第十天)_如果某个datanode的节点上的空闲空间低于特定的临界点,按照均衡策略,系统就

当前位置: article > 正文

分享 | 用于视图合成的神经辐射场技术_由空间位置计算体素密度

作者:从前慢现在也慢 | 2024-03-23 18:48:46

赞

踩

由空间位置计算体素密度

2020和2021年,最火的计算机视觉技术非Transformer莫属。而除Transformer之外,最受欢迎也最有趣的技术我想应该是ECCV 2020的神经辐射场 (Neural Radiance Field, NERF) ,其核心点在于非显式地将一个复杂的静态场景用一个神经网络来建模。在网络训练完成后,可以从任意角度渲染出清晰的场景图片。

NeRF惊艳的效果吸引了大量研究者的关注,在20年3月挂上arXiv后,后续已经有大量的工作跟进,在速度、效果、动态场景等多个不同的角度对NeRF进行了改进。作为3D视觉里的一个新范式,学习后续的工作离不开对NeRF本身深入的理解。笔记中有不对之处欢迎指正。

Code: yenchenlin/nerf-pytorch

Awesome-Nerf: yenchenlin/awesome-NeRF

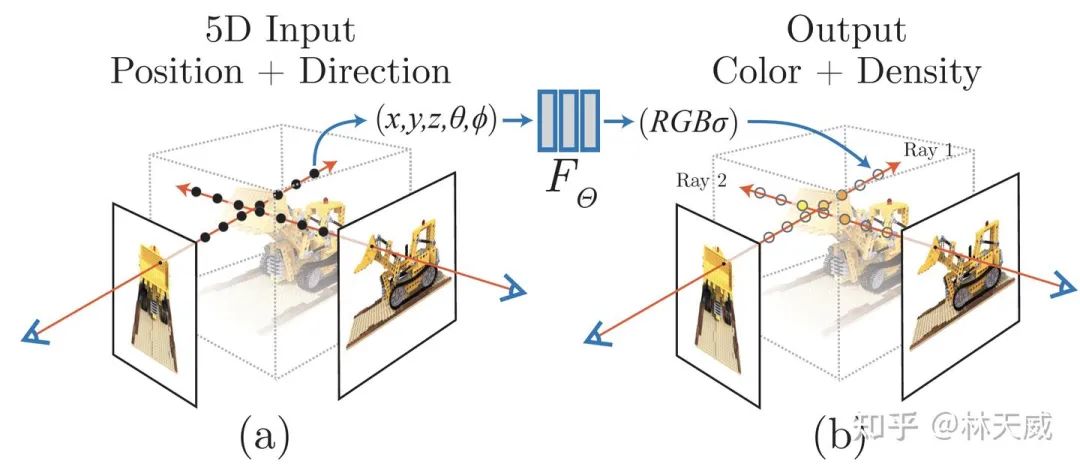

01算法概览

NeRF可以简要概括为用一个MLP神经网络去隐式地学习一个静态3D场景。为了训练网络,针对一个静态场景,需要提供大量相机参数已知的图片。基于这些图片训练好的神经网络,即可以从任意角度渲染出图片结果了。理解NeRF主要需要理解三个方面:

-

如何用NeRF来表示3D场景?

-

如何基于NeRF渲染出2D图像?

-

如何训练NeRF?

即我们要理解NeRF是如何从一系列2D图像中学习到3D场景,又是如何渲染出2D图像。

02用神经辐射场来表示场景

NeRF函数是将一个连续的场景表示为一个输入为5D向量的函数,包括一个空间点的3D坐标位置

,以及视角方向

。这个神经网络可以写作:

输出结果中,

是对应3D位置(或者说是体素)的密度,而

是视角相关的该3D点颜色。在具体的实现中,

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/从前慢现在也慢/article/detail/296940

推荐阅读

相关标签