- 1Swift 3.0中GCD的常用方法_swift group.notify主动退出

- 2春招复盘来了,腾讯,蚂蚁,百度等一线名企面试总结,大厂真没你想的那么难!_现在有一列火车,有10站,每站都有人上下车,设计数据结构,处理每个站的座位数

- 3解决安卓手机无法连接fastboot但是可以usb调试_fastboot连不上

- 4我的MYSQL学习心得(十) 自定义存储过程和函数

- 5HackingLab的一套渗透测试题_hackinglab题目

- 6Redis教程(十八):Redis的Redisson的看门狗机制_redis看门狗

- 7移动硬盘插入提示需要格式化RAW_Macbook无法识别移动硬盘?!不仅仅因为硬盘格式问题...

- 8jenkins svn插件_Jenkins+SVN

- 9【ESP32S3 Sense接入语音识别+MiniMax模型对话】_esp32语音识别

- 10web前端面试题整理(vue、uni-app、前端三件套、web基础)_前端uniapp面试题

聊聊火出圈的ChatGPT_火出圈的chatgpt感悟

赞

踩

前言

OpenAI 近期发布聊天机器人模型 ChatGPT,迅速火爆各大技术网站,就像一个突然激起的巨浪打破了沉寂已久的水面。它的出现无论是对人工智能的资本圈还是技术圈都感受到了春风回暖,前兔似锦的未来。

尤记得2015年谷歌开源的Tensorflow,让人们对AI的未来充满了想象,紧接着AlphaGo的各种辉煌战绩不断的挑战人们对AI的认知,但是随着能力越来越强,模型越来越大,数据、参数等暴增,导致工业落地困难,效果不好。自动驾驶虽然近期一直也被关注,但是始终也不温不火,缺少实质性的突破。这次的自然语言处理方向的爆火,确实让人眼前一亮。

那ChatGPT是什么呢,它为什么能火出圈呢?ChatGPT以对话方式进行交互,以更贴近人的对话方式与使用者互动,可以回答问题、承认错误、挑战不正确的前提、拒绝不适当的请求,能舞文弄墨、编写代码甚至几乎无所不能。据数据统计目前其MAU已破亿。

今天我们就聊聊这个新宠,看看它是怎么拥有这种魔法能力的,还有哪些问题和方案要不断演进的,资本圈如何看待这个新兴的产物。

What is ChatGPT

ChatGPT 是一种专注于对话生成的语言模型,基于 GPT3.5 通过人类反馈的强化学习微调而来。其中GPT是Generative Pre-trained Transformer(生成型预训练变换模型)的缩写。它能够根据用户的文本输入,产生相应的智能回答。这个回答可以是简短的词语,也可以是长篇大论。毫无疑问,它又强又聪明,且跟它说话很好玩,还会写代码。

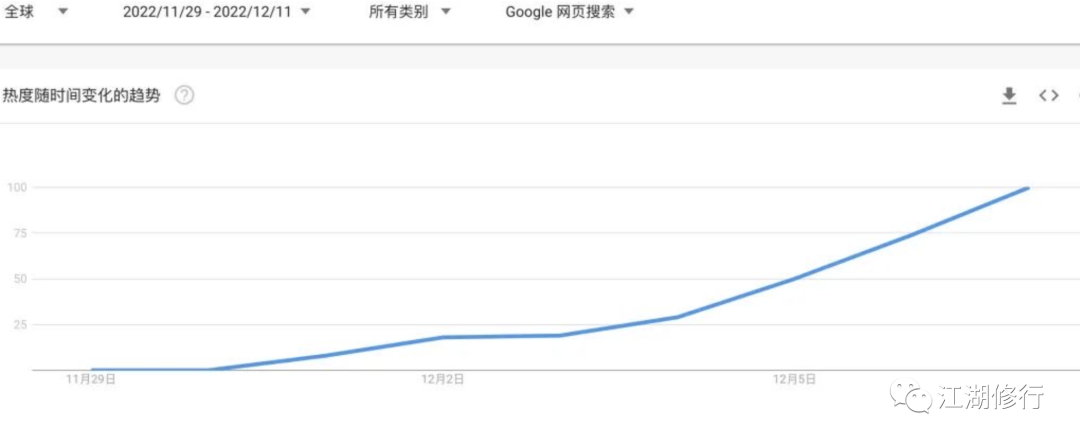

OpenAI 11 月 30 号发布,首先在北美、欧洲等已经引发了热烈的讨论。随后在国内开始火起来。全球用户争相晒出自己与 ChatGPT 极具创意的交流成果。我们通过谷歌搜索指数,看其火爆程度可见一斑。

横空出世的背后

OpenAI家族

我们首先了解下OpenAI是哪路大神。

OpenAI是一个人工智能研究实验室,目的是促进和发展友好的人工智能,使人类整体受益,总部位于旧金山,由特斯拉的马斯克、Sam Altman及其他投资者在2015年共同创立,目标是开发造福全人类的AI技术。而马斯克则在2018年时因公司发展方向分歧而离开。

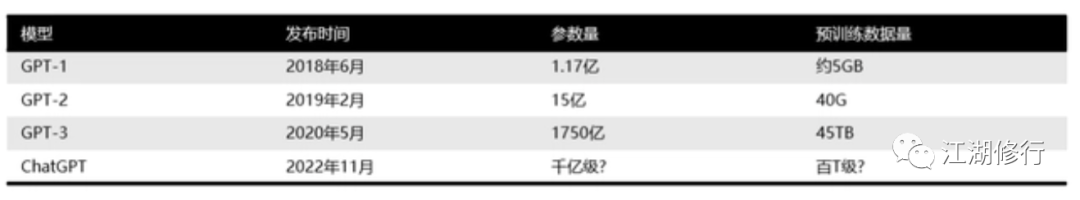

此前,OpenAI 因推出 GPT系列自然语言处理模型而闻名。从2018年起,OpenAI就开始发布生成式预训练语言模型GPT(Generative Pre-trained Transformer),可用于生成文章、代码、机器翻译、问答等各类内容。

GPT系列的每一代的参数和数据都是爆发式增长,追求“越大越强”的目标道路一去不复返。

OpenAI 目标之初就很远大,解决通用人工智能问题,主要涉及强化学习和生成模型。

强化学习最早被认为是实现人类通用智能重要手段,2016 年 DeepMind 开发的 AlphaGo Zero 使用强化学习训练,让人类围棋的历史经验成为了「Zero」,标志着人类向通用型的人工智能迈出了重要一步。2019 年 OpenAI 在《Dota2》的比赛中战胜了人类世界冠军。OpenAI 在强化学习有很多深入的研究,Dactyl 也是一款 OpenAI 通过强化强化学习训练能够高精度操纵物体的机器人手,OpenAI Gym 是一款用于研发和比较强化学习算法的工具包,所以 ChatGPT 中使用强化学习也是顺理成章。

曾经的创始人之一马斯克也发推称赞ChatGPT的强大。

背后的技术原理

能力提升概述

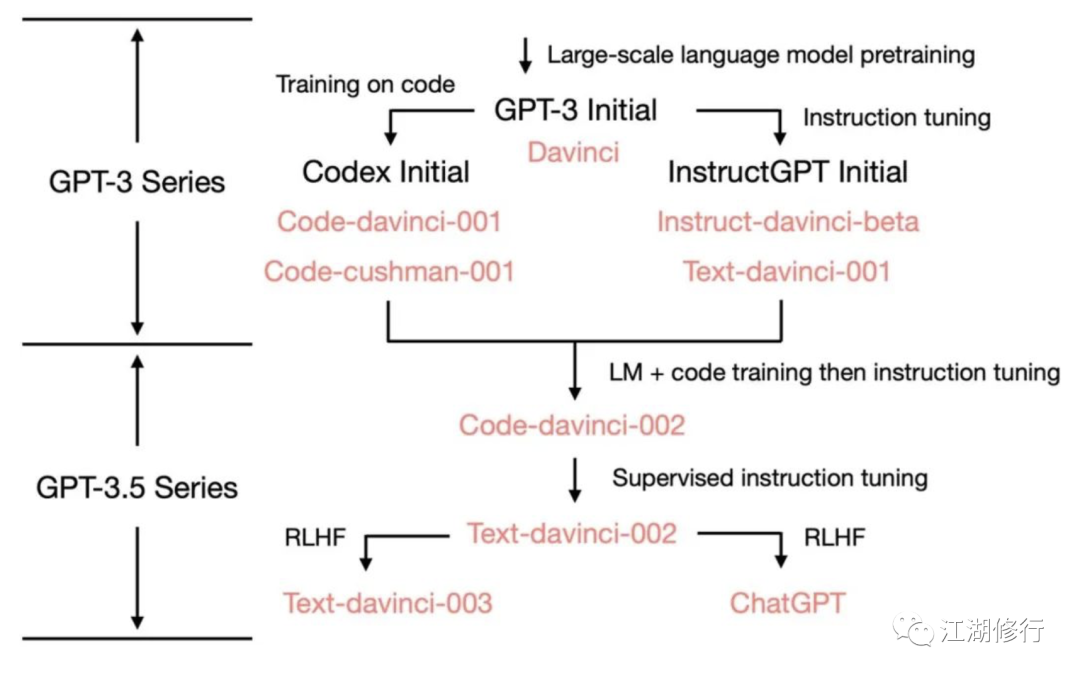

ChatGPT 整体技术方案是基于 GPT-3.5 大规模语言模型通过人工反馈强化学习来微调模型,是InstructGPT 的兄弟模型,让模型一方面学习人的指令,另一方面学习回答的好不好。

OpenAI使用 RLHF(Reinforcement Learning from Human Feedbac,人类反馈强化学习) 技术对 ChatGPT 进行了训练,且加入了更多人工监督进行微调。

此外,ChatGPT 还具有以下特征:

1)可以主动承认自身错误。若用户指出其错误,模型会听取意见并优化答案。

2)ChatGPT 可以质疑不正确的问题。例如被询问 “哥伦布 2015 年来到美国的情景” 的问题时,机器人会说明哥伦布不属于这一时代并调整输出结果。

3)ChatGPT 可以承认自身的无知,承认对专业技术的不了解。

4)更好地理解用户的提问,提升模型和人类意图的一致性,同时具备连续多轮对话能力。

指令微调

code-davinci-002 是一个基础模型,对于纯代码补全任务。这也是 ChatGPT 具备超强代码生成能力的原因。

text-davinci-002 是在 code-davinci-002 基础上训练的 InstructGPT 模型,训练策略是 instructGPT+FeedRM。

text-davinci-003 是基于 text-davinci-002 模型的增强版本,训练策略是 instructGPT+PPO。

001 模型主要是为了做纯代码 / 纯文本任务;002 模型则深度融合了代码训练和指令微调,代码和文本都行。ChatGPT 是在 text-davinci-003 基础上微调而来,这也是 ChatGPT 模型性能如此强大的核心要素。

能够响应人类指令的能力是指令微调的直接产物,对没有见过的指令做出反馈的泛化能力是在指令数量超过一定程度之后自动出现的。

人类反馈强化学习

InstructGPT/GPT3.5(ChatGPT的前身)与GPT-3的主要区别在于,新加入了被称为RLHF(Reinforcement Learning from Human Feedback,人类反馈强化学习)。这一训练范式增强了人类对模型输出结果的调节,并且对结果进行了更具理解性的排序。

在InstructGPT中,以下是“goodness of sentences”的评价标准。

回应详细:text-davinci-003 的生成通常比 text-davinci-002长。ChatGPT 的回应则更加冗长

公正性:ChatGPT 通常对涉及多个实体利益的事件(例如政治事件)给出非常平衡的回答。

拒绝问题:这是内容过滤器和由 RLHF 触发的模型自身能力的结合,过滤器过滤掉一部分,然后模型再拒绝一部分。

承认能力不足:例如,拒绝在2021 年 6 月之后发生的新事件(因为它没在这之后的数据上训练过)。这是 RLHF 最神奇的部分,因为它使模型能够隐式地区分哪些问题在其知识范围内,哪些问题不在其知识范围内。

通过人的反馈数据,学习一个最能解释人类判断的奖励模型 Reward Model,然后使用 RL 来学习如何实现目标。随着人类继续提供模型无法判断时候的反馈,实现了进一步完善它对目标的理解。

局限及未来演进

1.chatGPT对算力的消耗巨大,难以达到工业级落地水平,动辄上TB的数据及参数所需要的算力和资源足够让很多公司及技术开发者望而却步,产出的模型也过大导致落地场景受限。所以想要落地工业化,模型的压缩及剪枝等势在必行。

2.chatGPT目前无法联网获取数据,但有一篇 WebGPT 论文发表于2021年12月,里面就让 GPT 调用了搜索引擎,所以检索的能力已经在 OpenAI 内部进行了测试,可以用chatGPT+webGPT组合来实现。无法联网就失去了动态信息的输入导致实时的信息无法获取,导致某些问题的答案滞后,且由于数据是2021的数据集,部分答案甚至会产生和现实世界的割裂感。

3.数理及推理能力补足,chatGPT虽然连续对话的能力强,但在部分数理场景很容易尬聊甚至胡说八道的场景。比如一些复杂的小学数学题由于chatGPT推理逻辑的权重问题难以给出正常答案,鸡兔同笼问题等。

资本追捧or怀疑?

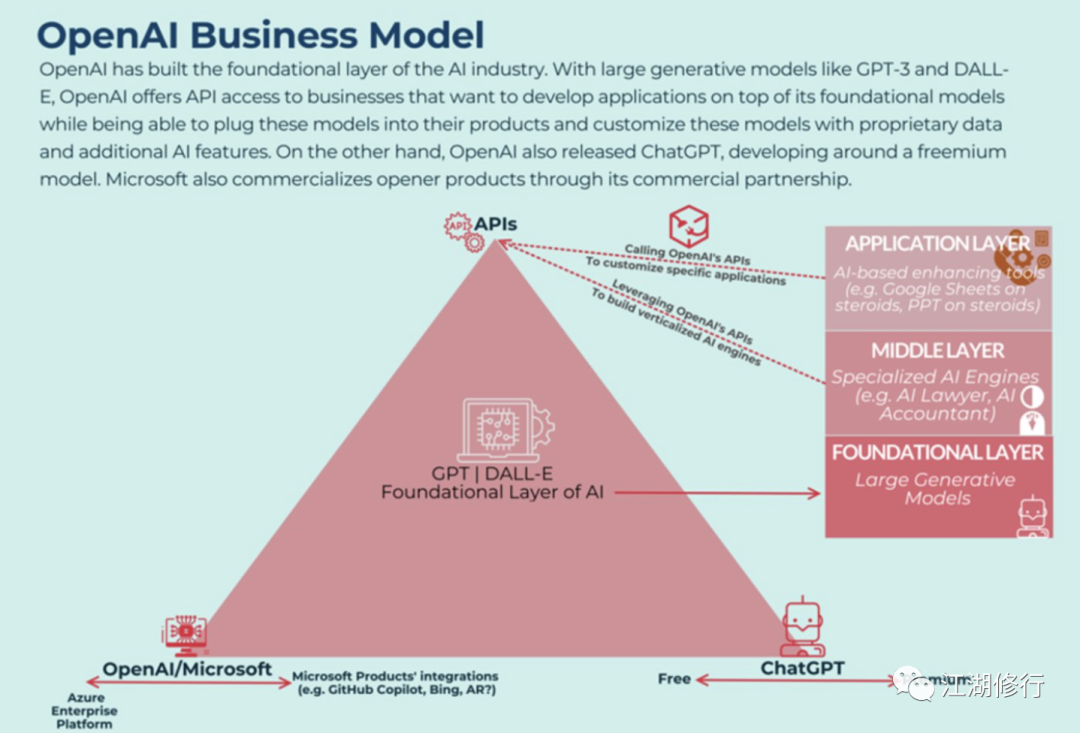

在chatGPT出圈的时候,质疑的声音也接踵而至,所谓“人红是非多”有些技术研究员认为chatGPT并没有实质性的突破,只是目前技术的集大成者且技术落地的切入点选择的比较好,能激起大家的兴趣。但是这些也不能阻挡科技巨头和资本的追捧,chatGPT属于泛AIGC(AI Generated Content),目前这个领域是AI界投资的大热。

科技巨头争先入场,布局早的都迫不及待地发布自己的相关产品,比如谷歌的Bard,微软搜索引擎内置chatGPT,包括新秀公司Anthropic推出的Claude聊天机器人,还有国内百度即将上线的“文心一言”等,阿里、京东也马不停蹄地将chatGPT技术融入自己现有的业务场景中,有的即将完成内测。

金融市场上百度、商汤、讯飞等一众公司受资本的逐利,股价也是水涨船高,但是可以看到资本对于这次热点也是适可而止,并没有盲目赌上全部身家,而是一种更合理更冷静的方式入场。毕竟市场整体环境不景气,外部影响因素较多,像谷歌的Bard给出的错误答案可能还会变成一场灾难性的表演。

但也不能否认chatGPT确实给AI的应用市场来了一针强心剂,伴随着后续AIGC应用多点开花,商业模式进一步的探索落地,资本的入局(投资机构红杉在《Generative AI: A Creative New World》研究报告中提到,生成式AI有潜力产生数万亿美元的经济价值。国外研究机构数据显示,2022年海外投资者在AIGC赛道至少投入13.7亿美元,完成78笔交易,相当于前五年投资额之和。),让人工智能的未来可期。

题外话

chatGPT的火爆随之而来的质疑也不断,有声音说未来的工作会被AI所取代,危险的AI即将来临,甚至AI要统治世界的灭亡论都出现了,其实大可不必,尤记得几年前参加了一次AI安全攻防的讲座AI在学术界和工业界的技术在安全攻防上还有很大的发展空间,许多漏洞能让AI瘫痪,但同时也容易被黑客利用进行破坏性的活动。当然我们chatGPT本身也要不断进化,尤其是对一些敏感问题需要更严谨的回答,减少片面的偏见性回答。

人类应当利用AI将自己从重复性脑力劳动中解放出来,做人类应该做的事——爱、服务、探索与创造,以给生活和世界赋予意义。

微信公众号首发,欢迎各位coder关注:江湖修行,666.

参考资料:

WebGPT: Improving the Factual Accuracy of Language Models through Web Browsing