- 11盒子刷Armbian,看这一篇就够了——Armbian全方位安装指导书_armbian_linkfog_lbox.img.xz

- 2《C专家编程》学习笔记_通过宏定义将变量变为常量

- 3Dubbo总结_@service(version = "1.0.0", loadbalance = "roundro

- 4并发编程中的设计模式_多步操作使用什么设计模式

- 5李倩星r语言实战_《基于R的统计分析与数据挖掘》教学大纲

- 6dubbo安装及使用

- 7ROS 2的前世今生 | ROS 2学习笔记

- 8win10笔记本电脑总是自动休眠解决办法_笔记本自动休眠

- 9Android相机之MediaStore.ACTION_IMAGE_CAPTURE

- 10ZYNQ7020-linux下使用pl端扩展串口,内核无法启动,串口无反应解决方案_zynq linux串口扩展

OpenVINO 2022.3之一:OpenVINO概述_openvino是什么

赞

踩

OpenVINO 2022.3之一:OpenVINO概述

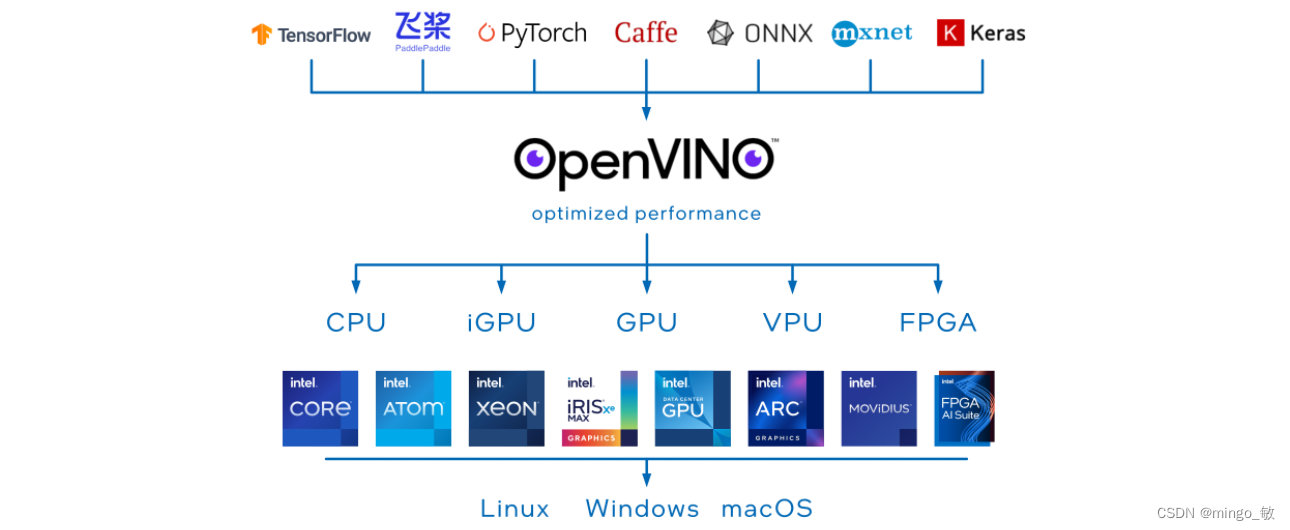

OpenVINO是一个开源工具包,可优化和部署深度学习模型。它提供了针对视觉、音频和语言模型的深度学习性能加速,支持流行框架如TensorFlow、PyTorch等。

1 概述

OpenVINO可以优化几乎任何框架的深度学习模型,并在各种英特尔处理器和其他硬件平台上以最佳性能进行部署。

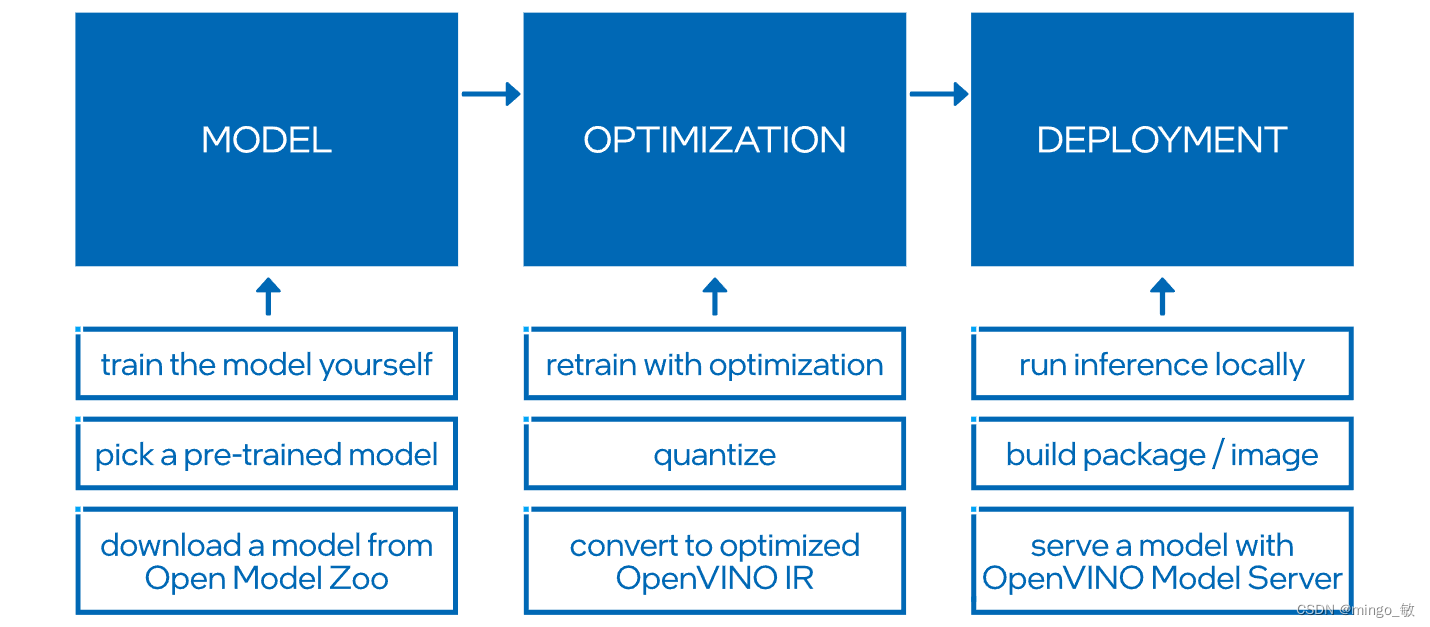

OpenVINO 工作流如下:

2 高性能的深度学习

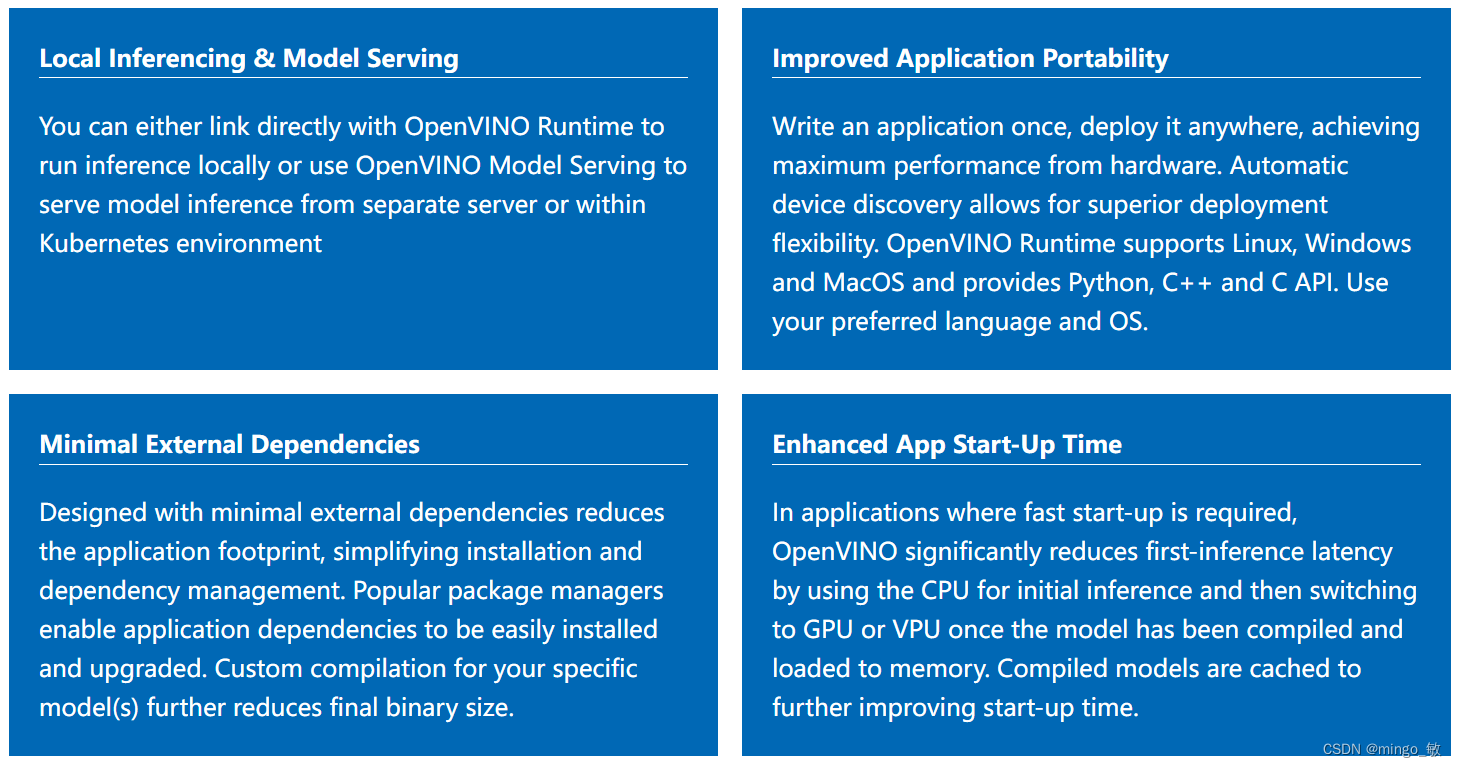

OpenVINO Runtime可以自动使用激进的图形融合、内存重用、负载平衡和跨CPU、GPU、VPU等进行集成并行处理,以优化深度学习流水线。您可以集成和卸载加速器附加操作,以减少端到端延迟并提高吞吐量。

3 模型量化和压缩

通过OpenVINO的后训练优化工具和神经网络压缩框架中提供的量化和其他最先进的压缩技术,进一步提高模型的速度。这些技术还可以减少模型的大小和内存需求,使其能够部署在资源受限的边缘硬件上。

4 支持设备

OpenVINO支持广泛的硬件平台。

完整的OpenVINO兼容平台列表 OpenVINO™ Supported Devices

OpenVINO 2022.3之一:OpenVINO概述

OpenVINO 2022.3之二:Windows安装OpenVINO

OpenVINO 2022.3之三:Linux安装OpenVINO

OpenVINO 2022.3之四:OpenVINO模型转换

OpenVINO 2022.3之五:OpenVINO Runtime部署推理

OpenVINO 2022.3之六:OpenVINO加密模型

OpenVINO 2022.3之七:OpenVINO 预处理API提升模型推理性能

OpenVINO 2022.3之八:OpenVINO Async API

OpenVINO 2022.3之九:Post-training Optimization Tool (POT)

OpenVINO 2022.3之十:OpenVINO™ 中用于推理优化的自适应参数选择

OpenVINO 2022.3实战一:Window 10 环境下用 OpenVINO 2022.3部署yolov5 7.0

OpenVINO 2022.3实战二:Window 10 环境下用 OpenVINO 2022.3部署yolov5-seg_7.0

OpenVINO 2022.3实战三:POT API实现图像分类模型 INT8 量化

OpenVINO 2022.3实战四:POT API 实现 YOLOv5 模型 INT8 量化

OpenVINO 2022.3实战五:NNCF实现图像分类模型 INT8 量化

OpenVINO 2022.3实战七:OpenVINO加速Anomalib部署推理