- 1Jmeter系列(48)- 详解 Random Variable 随机变量

- 2Pandas数据透视表--pivot_table_pivot table

- 3Niginx工作笔记-通过error.log定位错误(记录一个寻找问题的方法)_error.log 怎么看问题

- 4opencv(38) 图像轮廓之七:椭圆拟合和直线拟合_opencv椭圆拟合

- 5使用Transformers微调基于BERT模型做中文命名实体识别任务_transformers实现中文实体识别

- 6git如何统计代码行数

- 7JAVA计算机毕业设计在线玩具租赁系统Mybatis+源码+数据库+lw文档+系统+调试部署

- 8整个公司都可以敏捷吗?

- 9Pytest系列(14)- 配置文件pytest.ini的详细使用_pytest ini文件 markers

- 10汽车之家 css自定义字体反爬解析_汽车之家字体反爬

Flink集群安装部署(Standalone,Yarn模式)

赞

踩

目录

一.环境准备

需要提前安装配置JDK,Hadoop

二.Flink集群安装步骤

1.下载安装包

下载地址 :Index of /dist/flink (apache.org)

根据自己所需选择版本,一个是scala版本为2.11,一个是scala版本为2.12,我下载的是flink-1.14.0-bin-scala_2.12.tgz

2.解压安装包

将下载完成的安装包上传至/opt/software目录,然后解压到/opt/servers目录

[root@master ~]# tar -zxvf /opt/software/flink-1.14.0-bin-scala_2.12.tgz -C /opt/servers/

为了方便,我将解压后的目录重命名为flink

[root@master ~]# mv /opt/servers/flink-1.14.0/ /opt/servers/flink

3.配置环境变量

修改/etc/profile文件

[root@master ~]# vi /etc/profile

#添加以下内容

export FLINK_HOME=/opt/server/flink

export PATH=$PATH:$FLINK_HOME/bin

:wq保存退出,要记得生效: source /etc/profile

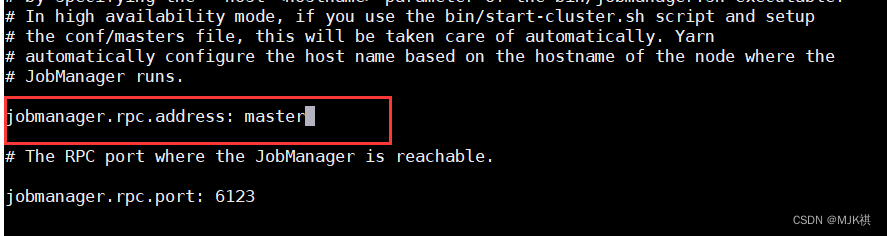

4.修改flink-conf.yaml文件

进入flink的conf目录,修改flink-conf.yaml文件,设置jobmanager.rpc.address为master节点

cd /opt/servers/flink/conf/

vi ./flink-conf.yaml

修改masters,workers文件,内容如下:

[root@master conf]# vi ./masters

master:8081

[root@master conf]# vi ./workersslave1

slave2

5.分发文件

将flink目录分发至slave1,slave2

scp -r /opt/servers/flink/ slave1:/opt/servers/

scp -r /opt/servers/flink/ slave2:/opt/servers/

分发/etc/profile文件,并分别在slave1,slave2生效(source /etc/profile)

scp -r /etc/profile slave1:/etc/profile

scp -r /etc/profile slave2:/etc/profile

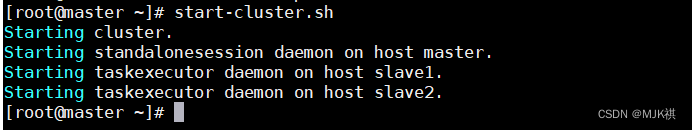

6.启动flink standalone集群

#启动

start-cluster.sh

#关闭

stop-cluster.sh

使用jps查看节点进程

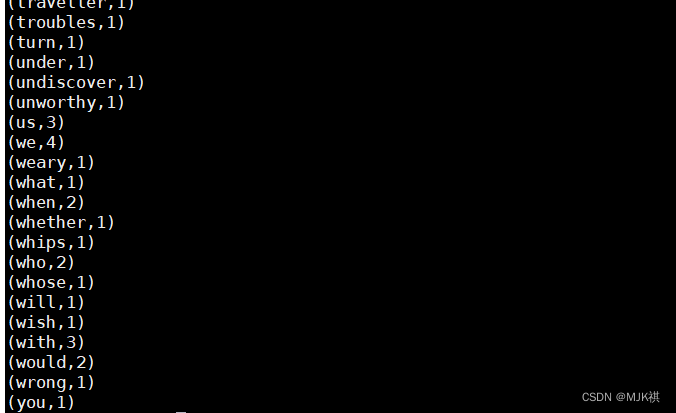

7.测试官方案例

启动flink standalone集群后,可以使用flink client向该集群master节点提交任务

[root@master ~]# flink run -m master:8081 /opt/servers/flink/examples/batch/WordCount.jar

三.Flink On Yarn

在完成flink standalone集群部署后,使用Yarn模式提交作业,flink on yarn不需要启动flink集群,只需要启动hadoop集群即可

在测试官方案例之前,需要在flink-conf.yaml文件添加:

classloader.check-leaked-classloader: false

在命令行直接输入以下内容:

[root@master flink]# export HADOOP_CLASSPATH=`hadoop classpath`

使用Per-Job模式启动单个作业(要提前启动hadoop集群,命令:start-all.sh):

[root@master flink]# flink run -m yarn-cluste /opt/servers/flink/examples/batch/WordCount.jar