- 1游戏程序员如何正确的写简历_客户端游戏简历怎么写

- 2Sass:提升CSS开发效率的利器_css sass开发

- 3MySQL的下载与安装及MySQL的图形管理工具的下载与安装(Windows版本)_mysql图形化界面下载

- 4Springboot 拦截器 + 自定义注解,实现权限控制_springboot自定义逻辑来实现禁止用户禁用自己账号的功能

- 5【制作100个unity游戏之27】使用unity复刻经典游戏《植物大战僵尸》,制作属于自己的植物大战僵尸随机版和杂交版1(附带项目源码)_unity植物大战僵尸

- 6数据解读:资本追逐的14个人工智能细分领域

- 7【Neo4j】Python操作Neo4j_neo4j python操作

- 8基础知识----Java ArrayList遍历输出顺序会和添加的顺序不一致吗?_arraylist顺序会乱吗

- 9LetCode 127. 单词接龙_python 127. 单词接龙

- 10kafka踩坑、实践篇_this message has failed its crc checksum, exceeds

Cohere继Command-R+之后发布大模型Aya-23,性能超越 Gemma、Mistral 等,支持中文_aya23 gemma mistral mixtral phi3 哪个强

赞

踩

前言

近年来,多语言大模型(MLLM)发展迅速,但大多数模型的性能依然存在显著差距,尤其是在非英语语言方面表现不佳。为了推动多语言自然语言处理技术的发展,Cohere团队发布了新的多语言指令微调模型家族——Aya 23,其性能超越了 Gemma、Mistral 等同类模型,并首次支持了中文。

-

Huggingface模型下载:https://huggingface.co/CohereForAI/aya-23-8B

-

AI快站模型免费加速下载:https://aifasthub.com/models/CohereForAI

技术特点

Aya-23 基于 Cohere 自研的 Command 模型系列,并结合了 Aya 多语言指令风格数据集,旨在为 23 种语言提供强大的多语言理解和生成能力。

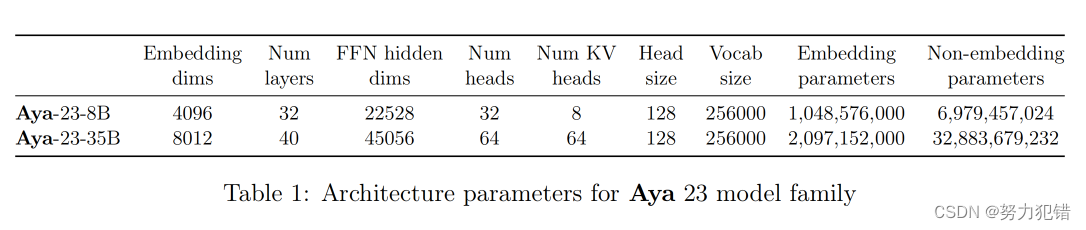

基于 Command 模型,拥有强大的性能基础

Aya 23 模型家族基于 Cohere Command 系列模型,该系列模型使用包含 23 种语言的混合数据进行预训练,并采用了一系列先进的技术,例如:

-

并行注意力和 FFN 层: 类似于 PALM-2 模型,Aya 23 采用了并行块架构,在保持模型质量的同时,显著提高了训练效率,尤其是在张量并行设置下。

-

SwiGLU 激活函数: 与其他激活函数相比,SwiGLU 能够在保证参数量级基本一致的情况下,提升模型的下游任务性能。

-

无偏置: 类似于 PALM2 模型,Aya 23 模型的密集层中去除了所有偏置项,提升了训练的稳定性。

-

旋转位置编码: 使用旋转位置编码 (RoPE) 技术,能够更好地进行长文本外推,同时在短文本长度的情况下,也比其他相对位置编码方法,例如 ALiBi,取得更好的下游任务性能。

-

分组查询注意力 (GQA): Aya-23-8B 模型使用了分组查询注意力,每个 KV 头共享多个 Q 头,从而降低了推理时间的内存占用。

多语言指令风格数据集,提升模型的指令理解能力

为了提升模型对指令的理解能力,Aya 23 使用了多语言指令风格数据集,该数据集包含了来自 xP3x、Aya 和 Data Provenance 等多个数据集的样本,涵盖 23 种语言和 161 个不同的数据集。该数据集还包含了由母语使用者撰写的 204K 人工标注的提示词-响应对,以及通过机器翻译获得的多种语言指令数据集的翻译版本。

支持 23 种语言,涵盖更广泛的应用场景

Aya-23 模型家族支持 23 种语言,包括阿拉伯语、简体中文、繁体中文、捷克语、荷兰语、英语、法语、德语、希腊语、希伯来语、印地语、印度尼西亚语、意大利语、日语、韩语、波斯语、波兰语、葡萄牙语、罗马尼亚语、俄语、西班牙语、土耳其语、乌克兰语和越南语,覆盖了全球约一半的人口。

性能表现

Aya-23 模型家族在各种语言、推理、编码和数学基准测试中均取得了优异的成绩,超越了同等大小甚至更大的模型,展现出了强大的多语言能力。

多语言任务评估

研究团队采用了 Üstün 等人提出的多语言评估框架,对 Aya 23 模型进行了全面评估,涵盖了 23 种语言,包括:

-

未见过的识别任务: 在 XWinograd、XCOPA 和 XStoryCloze 等完全未见过的任务中,Aya-23-35B 模型取得了最佳表现,其平均准确率为 70.8%,超越了其他模型。

-

通用语言理解: 在多语言 MMLU 测试中,Aya-23-8B 模型在 14 种语言中取得了最佳表现,其平均准确率为 48.2%,在大部分语言上超过了其他模型。

-

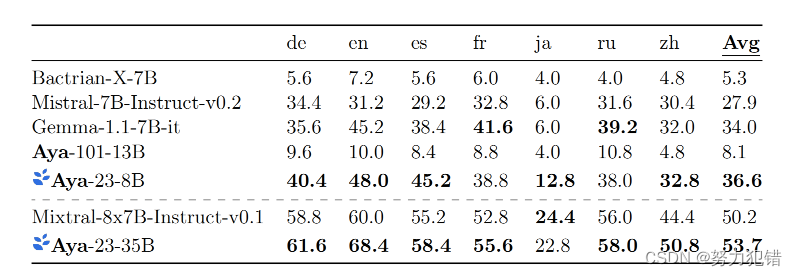

多语言数学推理: 在 MGSM 测试中,Aya-23-8B 模型也取得了领先优势,其平均准确率为 36.6%,是同类模型中表现最优秀的,并且比 Aya-101-13B 提升了 4.5 倍。

-

生成任务: 在机器翻译和多语言摘要任务中,Aya 23 模型也取得了显著的性能提升。

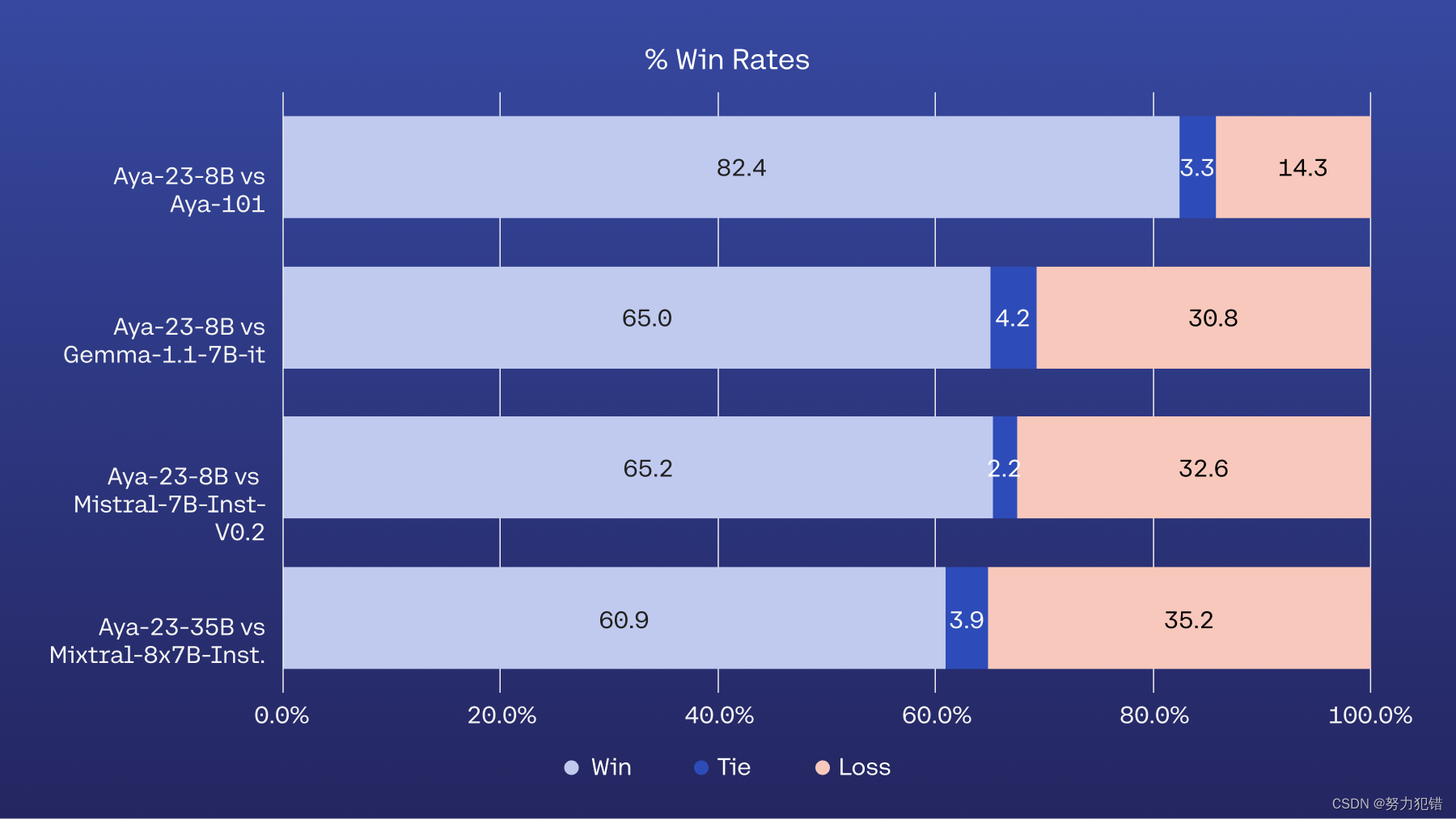

人类偏好评估

为了评估模型的开放式生成能力,研究团队进行了人类偏好评估,结果显示:

-

LLM 评估: 使用 GPT-4 作为评价模型,Aya 23 模型在 10 种语言中,针对不同规模的模型均表现出色,其平均获胜率均高于同类模型。

-

人类评估: 人类评估人员在 5 种语言中,对 Aya 23 模型的生成结果给予了更高的评价,其平均获胜率高于 Aya-101-13B 模型。

开源发布

为了促进多语言模型技术的发展,Cohere 团队公开发布了 Aya-23 的 8B 和 35B 模型,为研究人员和开发者提供了更多选择,加速多语言模型技术的发展和应用。

应用场景

Aya-23 模型家族拥有广泛的应用场景,例如:

-

机器翻译: 可以用于将一种语言的文本翻译成其他语言。

-

文本摘要: 可以用于将长篇文本压缩成简短的摘要。

-

问答系统: 可以用于回答用户的各种问题。

-

内容创作: 可以用于生成各种类型的文本内容,例如新闻报道、故事、诗歌等。

总结

Aya-23 的发布,标志着多语言模型技术取得了新的突破,其卓越的性能和广泛的语言支持能力,为多语言模型的发展开辟了新的方向。随着技术的不断进步,相信 Aya-23 模型家族将会在更多领域发挥重要作用,为人们的生活带来更多的便利和乐趣。

模型下载

Huggingface模型下载

https://huggingface.co/CohereForAI/aya-23-8B

AI快站模型免费加速下载

https://aifasthub.com/models/CohereForAI