热门标签

热门文章

- 1临平职高计算机专业高职考大学,临平职高的她考了全省第一!还有很多省前10都在这里!...

- 2Python中的filter函数用法详解_python filter

- 3HDC2021技术分论坛:ArkUI 3.0让多设备开发更简单_arkui 设置宽度与高度比例

- 4如何下载android studio的历史版本

- 5山西计算机应用基本技能,计算机应用基本技能 山西省对口高考题库

- 6验证码技术指南:在线对“验证魔方”进行个性化配置

- 7python之集合的创建与使用,遍历,集合常见的操作函数,集合与列表,元组,字典的嵌套_python每行是集合该怎么创建数据框

- 8Linux下修改gcc和g++的版本_linux重置gcc软链接

- 9如何做好一个跨团队协作项目

- 10java之Synchronized(锁住对象和锁住代码)_synchronized 项目锁住get set代码

当前位置: article > 正文

从零开始的LLaMA-Factory的指令增量微调

作者:凡人多烦事01 | 2024-03-19 23:49:42

赞

踩

从零开始的LLaMA-Factory的指令增量微调

大模型相关目录

大模型,包括部署微调prompt/Agent应用开发、知识库增强、数据库增强、知识图谱增强、自然语言处理、多模态等大模型应用开发内容

从0起步,扬帆起航。

- 大模型应用向开发路径及一点个人思考

- 大模型应用开发实用开源项目汇总

- 大模型问答项目问答性能评估方法

- 大模型数据侧总结

- 大模型token等基本概念及参数和内存的关系

- 从零开始的LLaMA-Factory的指令增量微调

一、LLaMA-Factory简介

LLaMA-Factory是开源的大模型微调框架,在模型微调方式、参数配置、数据集设置、模型保存、模型合并、模型测试以及模型试用上,提供了非常完备的开发接口。其框架使用形式分为指令与界面两种。

二、使用准备

1.拉取项目并部署相应环境(微调chatGLM3 6B很流畅,微调Qwen系列可能需要按错误提示对环境进行补包),并激活。

conda activate zwllama_factory

2.下载模型到本地

3.自行准备数据集

包括:

- 自我认知数据集(微调后可能效果也比较一般,需要多次微调,或者配合prompt。)

- 通用数据集(微调时用不用均可,可保持模型通用能力。且LLaMA-Factory的data文件夹下有alpaca_gpt4_data_zh等已经备好的数据集,不需要刻意定制。)

- 特定领域数据集

基本格式如下(alpaca,一种指令微调的格式。当然还有其他格式):

[

{

"instruction": "你好",

"input": "",

"output": "您好,我是XX大模型,一个由XXX开发的 AI 助手,很高兴认识您。请问我能为您做些什么?"

},

{

"instruction": "你好",

"input": "",

"output": "您好,我是XX大模型,一个由XXX打造的人工智能助手,请问有什么可以帮助您的吗?"

}

]

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

其中,instruction和input可以都填充进内容,如把问题作为input,把“回答问题这一要求”作为instruction。据说这种指令微调数据集的格式效果比较好。

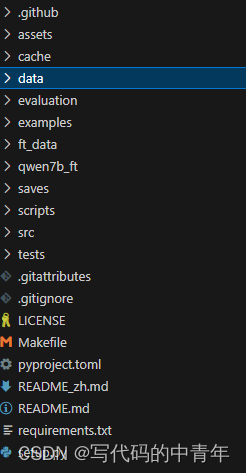

准备数据及后,应上传所用到的数据集至项目路径下data文件夹

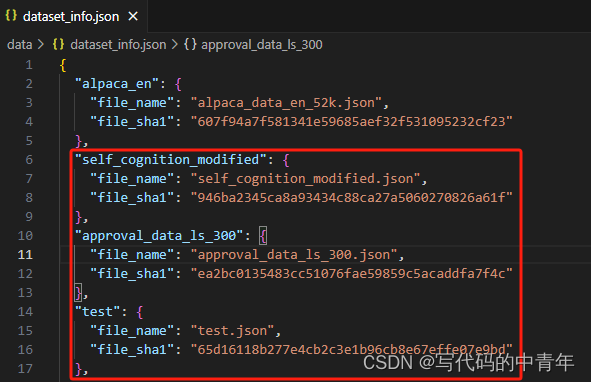

data文件夹下的数据集要想使用,还需在dataset_info.json下进行登记注册。

其中,file_sha1可通过如下代码计算获得,该字段要求并不严格,有即可,主要为了区分重复文件,作uuid使用。

import hashlib def calculate_sha1(file_path): sha1 = hashlib.sha1() try: with open(file_path, 'rb') as file: while True: data = file.read(8192) # Read in chunks to handle large files if not data: break sha1.update(data) return sha1.hexdigest() except FileNotFoundError: return "File not found." # 使用示例 file_path = r'C:\Users\12258\Desktop\xxx.json' # 替换为您的文件路径 sha1_hash = calculate_sha1(file_path) print("SHA-1 Hash:", sha1_hash)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

二、单卡微调

单卡微调往往针对6B、7B等规模不大的大模型,因此界面化操作完全狗满足需求。

下述指令启动界面:

CUDA_VISIBLE_DEVICES=0 python src/train_web.py

- 1

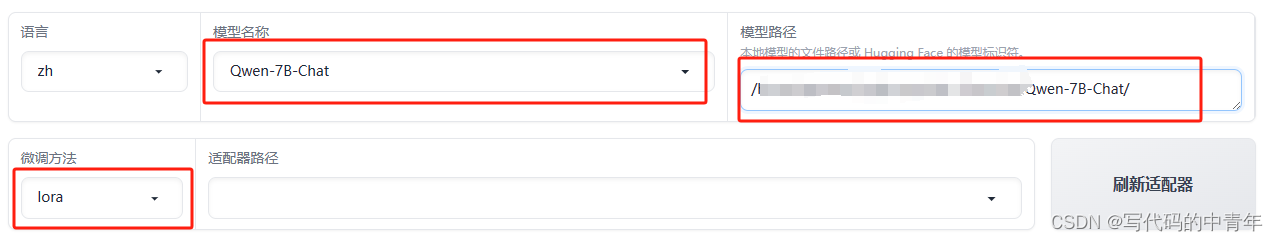

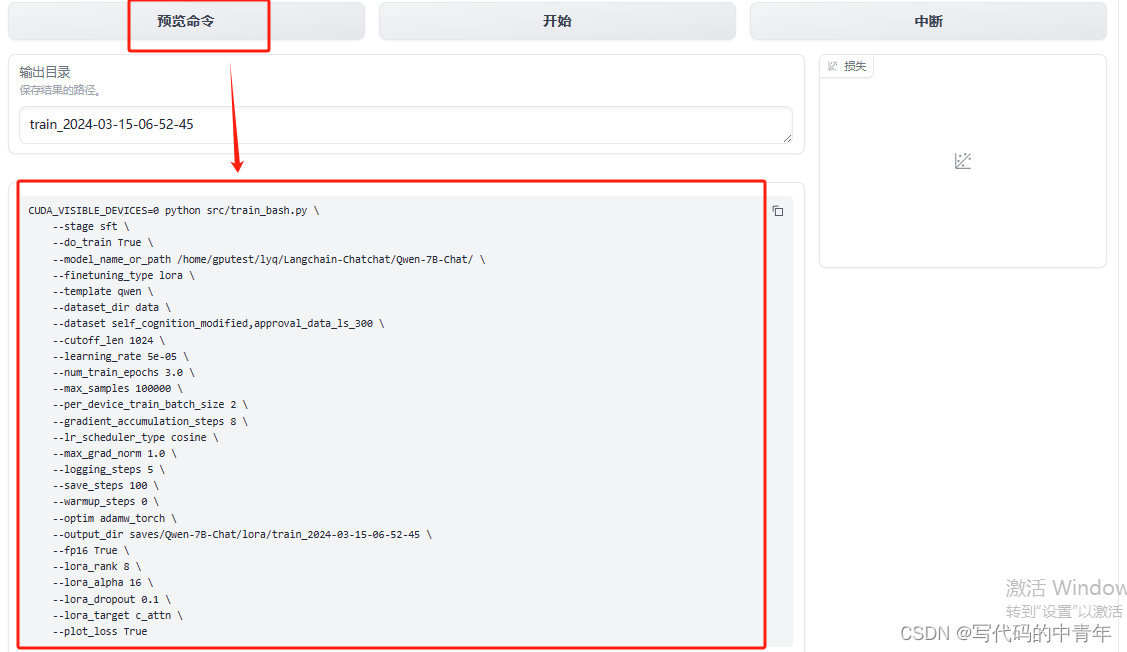

如下图所示配置页面信息

可见界面微调的本质依旧是后端的指令。

点击开始,开始微调,界面无反应,后端开始加载

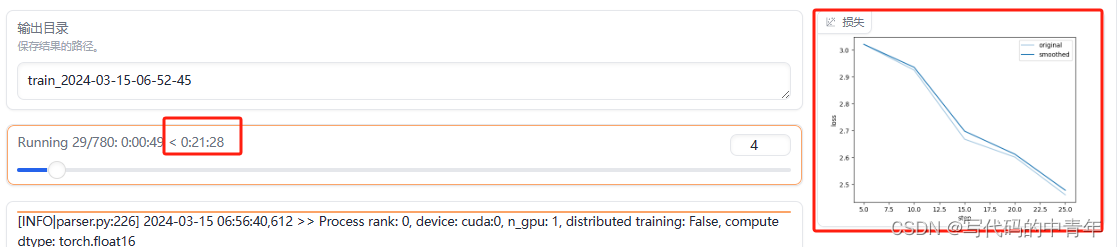

加载完毕后,前端界面出现训练所需时间和损失曲线。

注意,训练随时可以中断。

测试集对微调模型性能评估

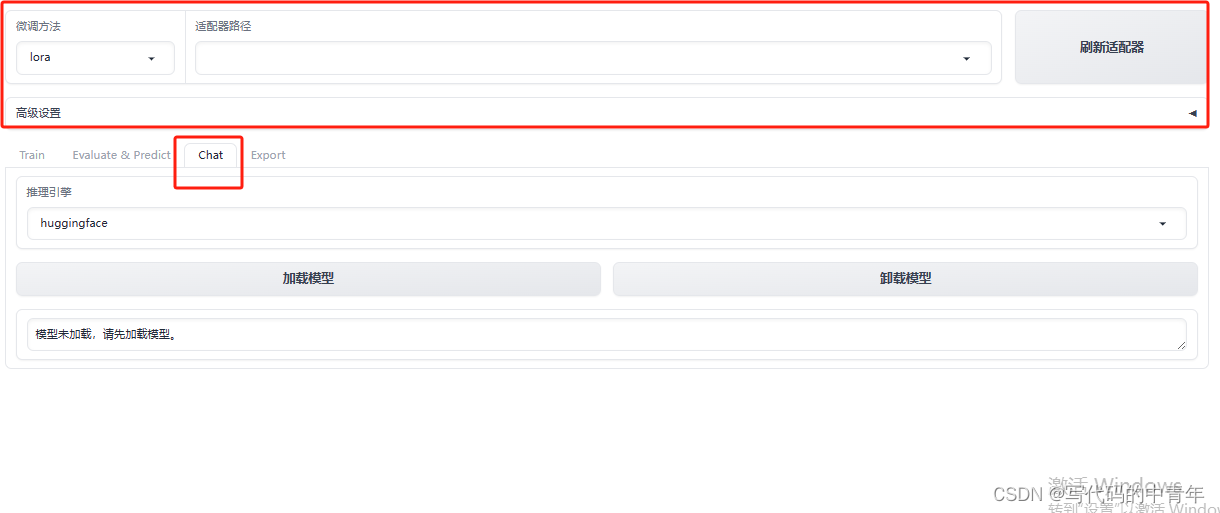

微调模型问答使用

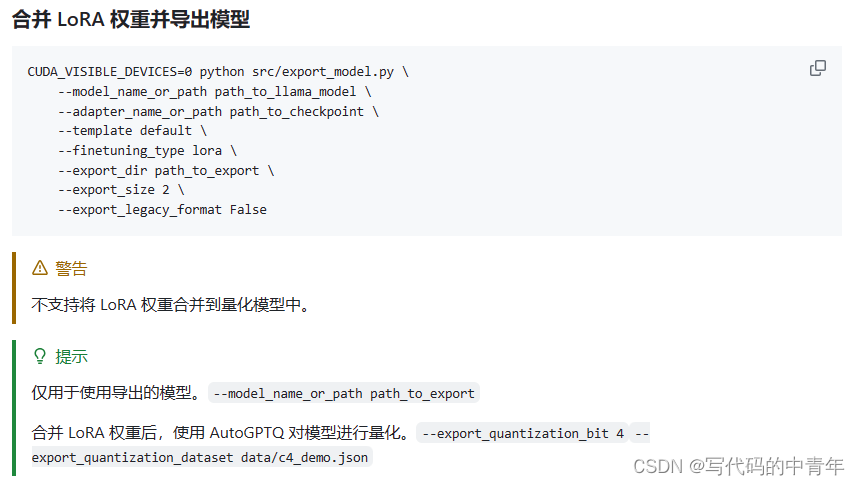

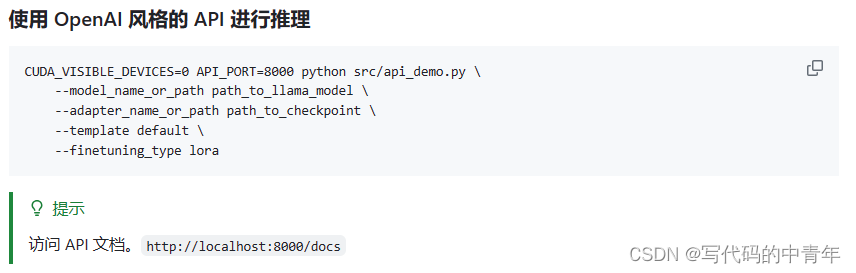

微调模型增量模型导出

三、多卡微调

四、其他

更多信息可以访问开源项目进行了解。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/凡人多烦事01/article/detail/269122

推荐阅读

相关标签