热门标签

热门文章

- 1微服务技术栈SpringCloud+RabbitMQ+Docker+Redis+搜索+分布式(五):分布式搜索 ES-下

- 2系统集成项目管理工程师证书有什么用?_系统集成高级职称有什么用

- 3QFIL的烧录、读写_高通刷机qfil教程图解

- 4BERT-BiLSTM-CRF-NER模型源码测试

- 5Mysql查询操作进阶_myspl综合查询头歌分

- 6【计算机网络安全技术】Day03-STP&RSTP_rstp拓扑变更

- 7java get与post区别_POST和GET区别

- 8Git命令添加到远程仓库_git 添加远程地址

- 9android 图片横向滑动,Android 图片横向滚动效果

- 10macOS上实现「灵动岛」效果_mediamate

当前位置: article > 正文

ChatGLM2-6B从本地加载模型报错-解决办法

作者:凡人多烦事01 | 2024-04-14 22:17:49

赞

踩

ChatGLM2-6B从本地加载模型报错-解决办法

报错

OSError: /chatglm2-6b does not appear to have a file named config.json. Checkout 'https://huggingface.co/chatglm2-6b/None' for available files.

解决方法有两,推荐第二个方法(几乎解决所有模型下载问题):

一

1.在官方下载模型到本地:

清华大学云盘![]() https://cloud.tsinghua.edu.cn/d/674208019e314311ab5c/2.执行以下代码

https://cloud.tsinghua.edu.cn/d/674208019e314311ab5c/2.执行以下代码

GIT_LFS_SKIP_SMUDGE=1 git clone https://huggingface.co/THUDM/chatglm2-6b上面代码可能什么都下载不了

试试下面这个,把地址换为镜像地址:

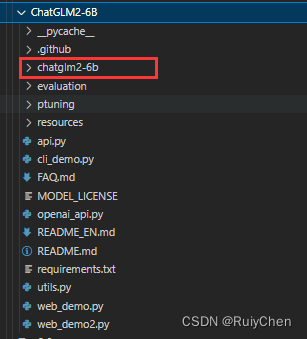

GIT_LFS_SKIP_SMUDGE=1 git clone https://hf-mirror.com/THUDM/chatglm2-6b 会在当前文件中创建一个 chatglm2-6b 文件夹:

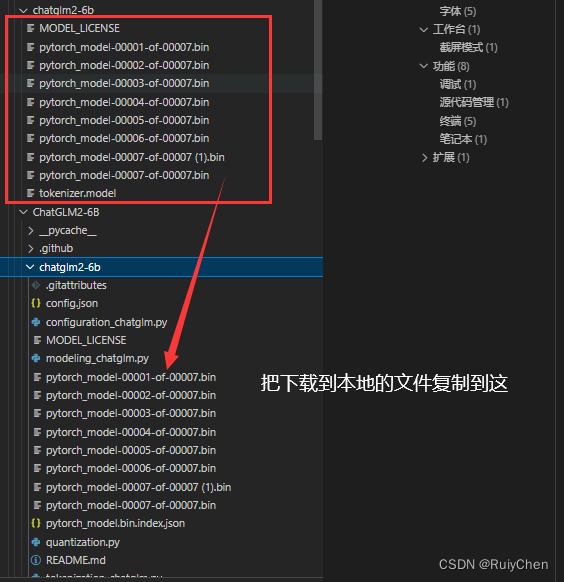

3.将下载的内容替换chatglm2-6b中的内容。

4加载

- model_path = '/chatglm2-6b' #chatglm2-6b文件夹地址

-

- tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True)

- model = AutoModel.from_pretrained(model_path, trust_remote_code=True).cuda()

方法二:

使用modelscope下载模型

或者部署huggingface镜像网作为默认下载地址,具体方法写在下面了:

需要模型api部署调用,可用翻翻,之前写过一篇 。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/凡人多烦事01/article/detail/424371?site

推荐阅读

相关标签