- 1【东华大学oj】顺序栈ADT模板简单应用算法设计:回文判断_顺序栈adt模板简单应用算法设计:火车调度 时间限制: 1s 类别: ds:栈->栈定义及应

- 2怎么把b站的视频保存到本地_b站视频怎么下载到本地视频

- 3【Vue3-Element-Admin 动态路由】涉及到的配置_elementadmin vue3

- 4HBase 单机部署_hbase gui如何使用

- 5MYSQL 用户权限类型划分_mysql super

- 6ChatGPT及AI大模型学习笔记分享_chatgpt没有对应的ai模型

- 7golang struct 转 interface_Go语言(golang)新发布的1.13中的Error Wrapping深度分析

- 8接触式轮廓仪的自动标注数学建模_数学建模竞赛真题体验交流会圆满结束!!!...

- 9java 判断邮箱_java使用正则表达式判断邮箱格式是否正确的方法

- 1015个Kimichat官方提示词模版,教你快速写出爆款文案、小红书排版_kimi常用语模版

快速部署ChatGLM-6B大模型实战总结_chat - glm6

赞

踩

近期,IT界掀起了大模型的热潮,各种百模争霸的局面出现。我对新技术充满热情,积极体验各类 GPT AI 产品,包括领先的 GPT 龙头 ChatGPT,百度的文心一言和文心千帆、阿里的通义千问以及金山的 WPSAI 等。

作为这些产品的忠实测试者之一,我同时也尝试过这些产品的 API 接口,与微信对接,实现了微信聊天机器人。然而,当开源的大模型 ChatGLM 面世时,我却遇到了一些困扰,但幸运的是,腾讯云给了我一个难得的机会。

腾讯云最近推出一项限时特惠活动,仅需72元/15天就能获得计算型 GPU 云服务器,让我有机会亲自体验自建模型和微调训练的过程。我把这份自建模型的乐趣写成文字,分享给你。

服务器

凭手速迅速抢到了一台GPU云服务器,以下是配置信息:

配置环境

下载项目仓库

代码语言:javascript

root@VM-0-17-ubuntu:~# git clone https://github.com/THUDM/ChatGLM-6B

root@VM-0-17-ubuntu:~# cd ChatGLM-6B/

- 1

- 2

构建conda环境

代码语言:javascript

root@VM-0-17-ubuntu:~# conda create --name chatglm python=3.8

root@VM-0-17-ubuntu:~# conda activate chatglm

- 1

- 2

下载依赖

在conda虚拟环境下,下载chatglm需要的依赖文件, 这里需要的时间比较长,需要耐心等待:

代码语言:javascript

root@VM-0-17-ubuntu:~# pip install -r requirements.txt

- 1

你以为就是上面简单的几句命令吗,中间安装的过程充满了各种异常、困难需要解决,这里不一一列出,如果你去真正做一次,就会深刻体会“知易行难”这句话。

数据模型

下载安装git-lfs

代码语言:javascript

root@VM-0-17-ubuntu:~# apt-get install git-lfs

root@VM-0-17-ubuntu:~# git lfs install

- 1

- 2

下载模型文件

https://github.com/THUDM/ChatGLM-6B 官方网站

从ChatGLM的官方库中下载,将模型文件我放到工程的 ChatGLM-6B/THUDM 目录下面。

代码语言:javascript

root@VM-0-17-ubuntu:~# cd ChatGLM-6B && mkdir THUDM

root@VM-0-17-ubuntu:THUDM# git lfs clone https://huggingface.co/THUDM/chatglm-6b

- 1

- 2

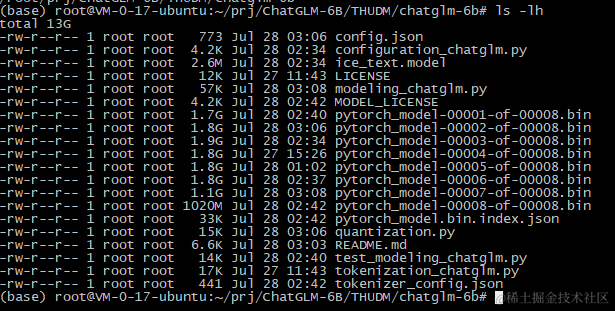

模型文件比较大(25G),这里下载需要的时间很长,请耐心等待,以下是目录下载后模型目录下的文件:

测试

终端运行 Demo

进入ChatGLM-6b工程的根目录。执行python cli_demo.py

终于看到了成果,虽然对于一些知识的回答不准确,但这只是数据问题,程序还是跑起来了。

Web端运行

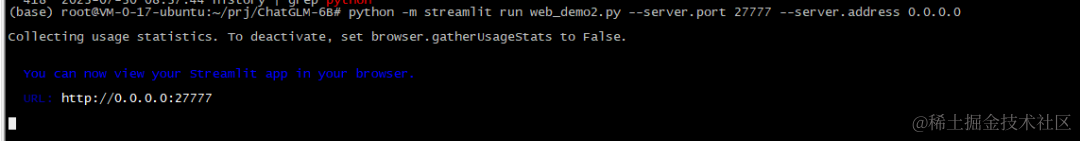

进入 ChatGLM-6B 工程的根目录,执行如下命令:

代码语言:javascript

root@VM-0-17-ubuntu:ChatGLM-6B# python -m streamlit run web_demo2.py --server.port 27777 --server.address 0.0.0.0

- 1

执行成功的效果如下:

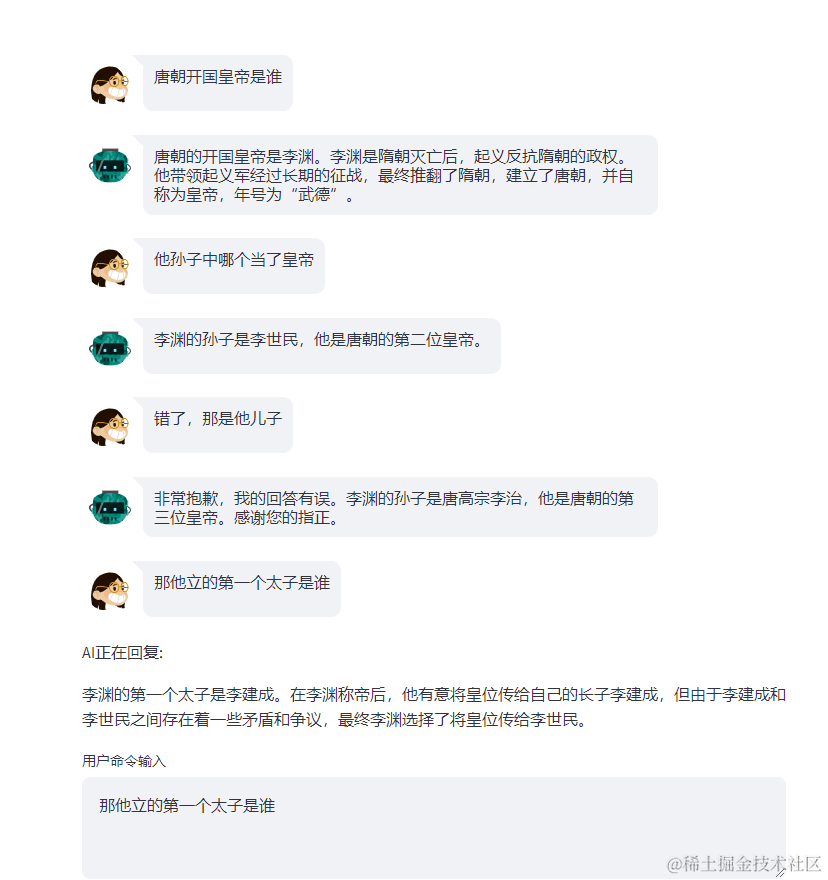

打开浏览器可见到如下界面:

跟它对话一下,看看效果:

如何系统的去学习大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。