- 1springboot整合rabbitmq_springboot 整合rabbitmq

- 2数据结构:笔记_给定一个整数sum,从有n个有序元素

- 3算法训练.

- 4腾讯招聘新增“AI大模型”专项 扩招人数幅度超过50%

- 5从基础学前端之网络知识6_流量感知路由的区别

- 6神经网络入门①多层感知器如何解决异或问题?_感知机异或运算

- 7【24届数字IC秋招总结】正式批面试经验汇总9——飞腾_数字ic面试自我介绍

- 8SpringBoot整合Spring Security【超详细教程】_spring boot security 教程

- 9Mac iTerm2 配置_brew安装iterm2

- 10CrossOver 24.0.0 Mac强大的Windows应用运行容器中文特别版

2024年最新【python】爬取4K壁纸保存到本地文件夹【附源码】(3),2024年网络安全大厂面试_保存到文件夹开发

赞

踩

本人从事网路安全工作12年,曾在2个大厂工作过,安全服务、售后服务、售前、攻防比赛、安全讲师、销售经理等职位都做过,对这个行业了解比较全面。

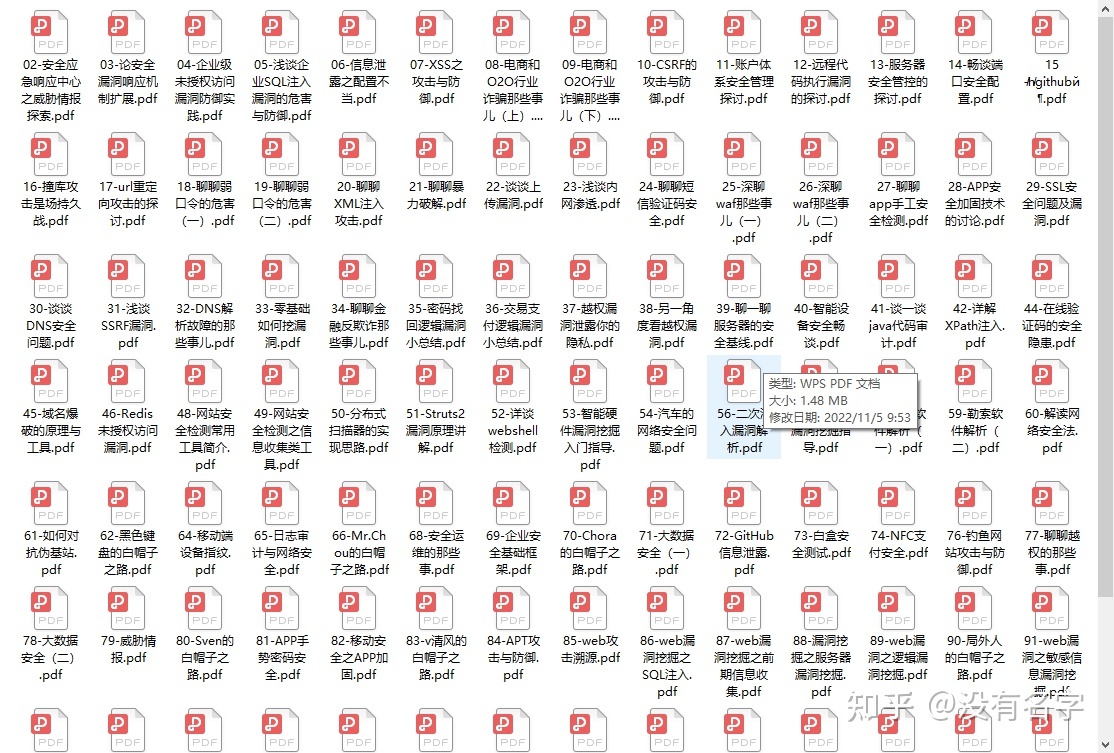

最近遍览了各种网络安全类的文章,内容参差不齐,其中不伐有大佬倾力教学,也有各种不良机构浑水摸鱼,在收到几条私信,发现大家对一套完整的系统的网络安全从学习路线到学习资料,甚至是工具有着不小的需求。

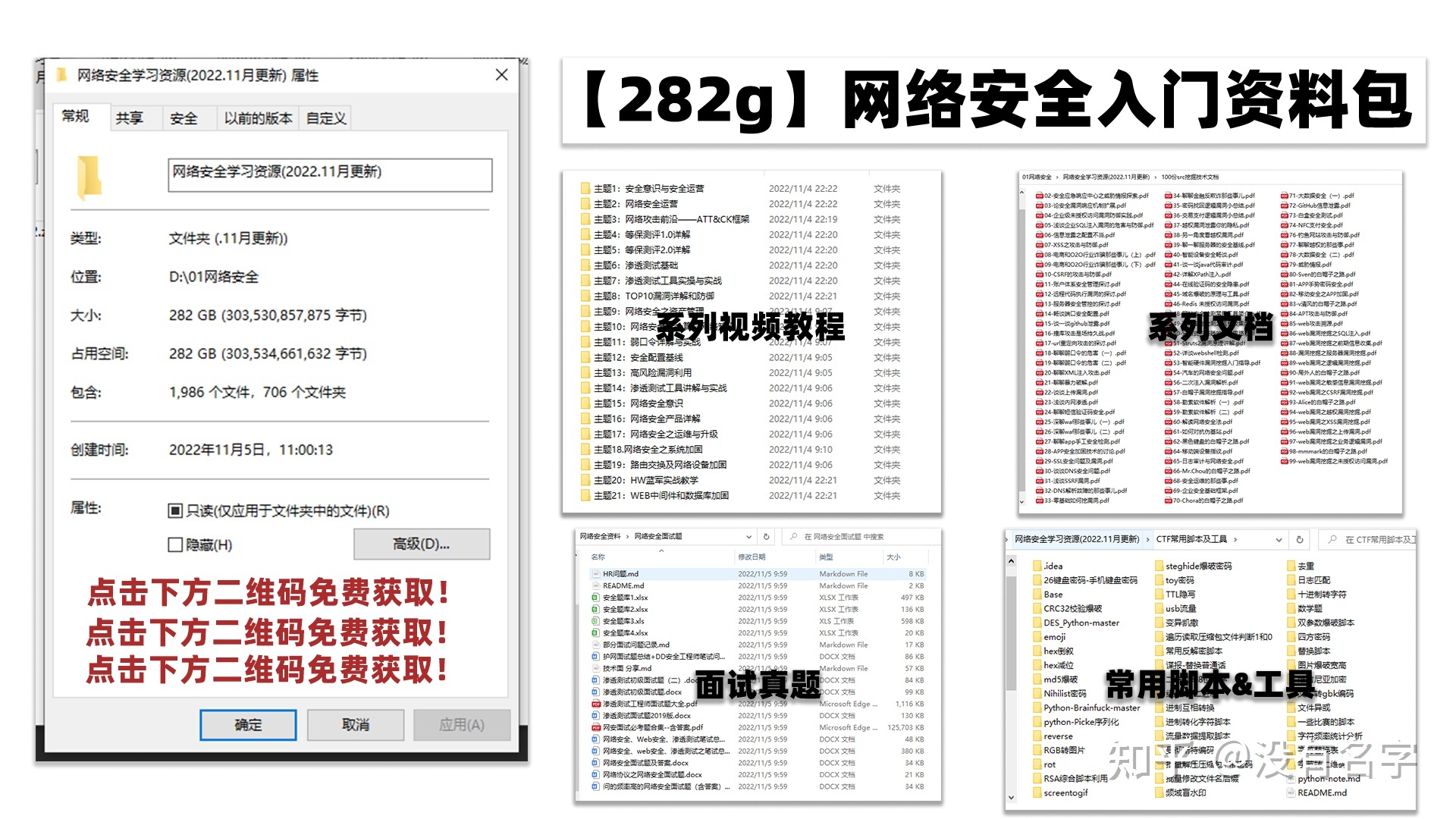

最后,我将这部分内容融会贯通成了一套282G的网络安全资料包,所有类目条理清晰,知识点层层递进,需要的小伙伴可以点击下方小卡片领取哦!下面就开始进入正题,如何从一个萌新一步一步进入网络安全行业。

学习路线图

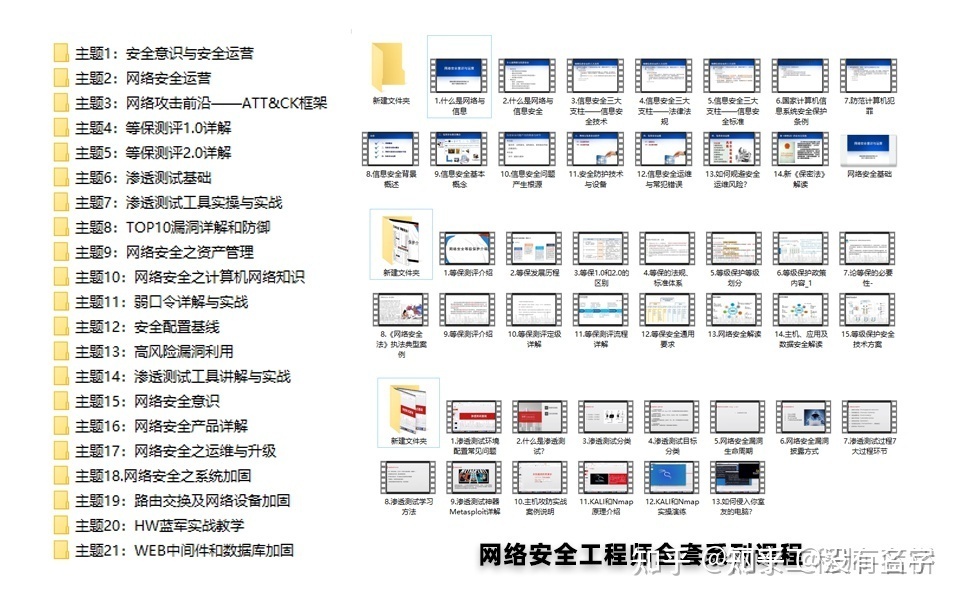

其中最为瞩目也是最为基础的就是网络安全学习路线图,这里我给大家分享一份打磨了3个月,已经更新到4.0版本的网络安全学习路线图。

相比起繁琐的文字,还是生动的视频教程更加适合零基础的同学们学习,这里也是整理了一份与上述学习路线一一对应的网络安全视频教程。

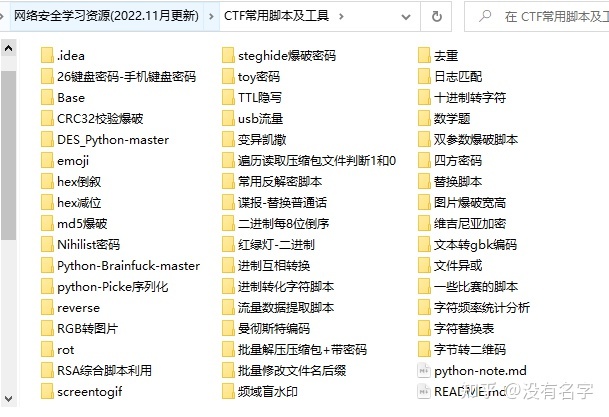

网络安全工具箱

当然,当你入门之后,仅仅是视频教程已经不能满足你的需求了,你肯定需要学习各种工具的使用以及大量的实战项目,这里也分享一份我自己整理的网络安全入门工具以及使用教程和实战。

项目实战

最后就是项目实战,这里带来的是SRC资料&HW资料,毕竟实战是检验真理的唯一标准嘛~

面试题

归根结底,我们的最终目的都是为了就业,所以这份结合了多位朋友的亲身经验打磨的面试题合集你绝对不能错过!

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

华为云

https://mirrors.huaweicloud.com/repository/pypi/simple/

腾讯云

https://mirrors.cloud.tencent.com/pypi/simple/

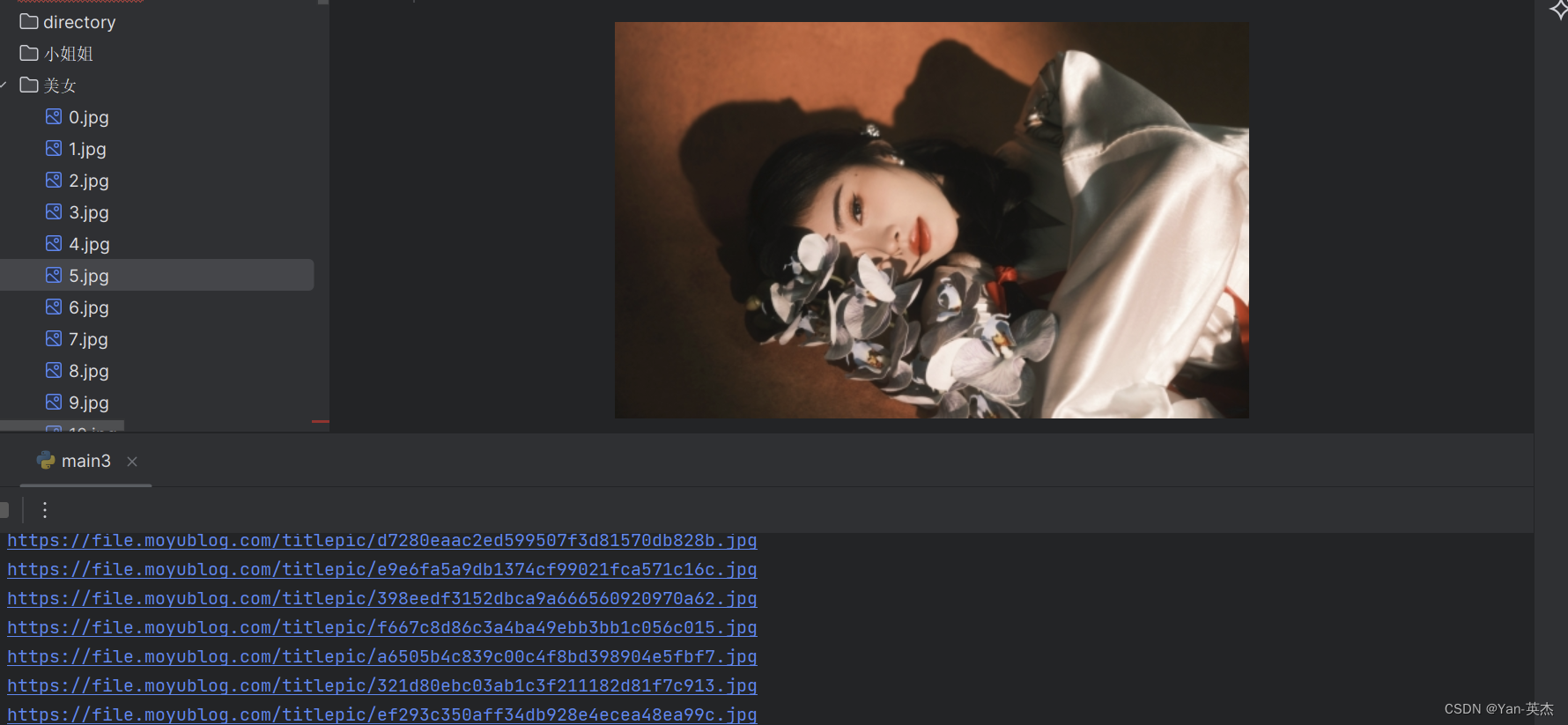

### 效果图:  ### 代码详解: 1. `get_imgurl_list(url, imgurl_list)` 函数用来获取指定页面中的图片链接,并将这些链接存储在 `imgurl_list` 列表中。 > > > * 使用 `requests.get(url=url, headers=headers)` 发起请求获取页面内容。 > * 使用 `etree.HTML(html_str)` 将页面内容转换为 etree 对象,方便后续使用 XPath 进行解析。 > * 通过 XPath 定位到图片链接,并添加到 `imgurl_list` 中。 > 2. `get_down_img(imgurl_list)` 函数用来下载图片到本地存储。 > > > * 创建名为 "美女" 的文件夹用于存储下载的图片。 > * 遍历 `imgurl_list` 中的图片链接,逐个下载图片并保存到本地文件夹中。 > 3. 在 `if __name__ == '__main__':` 部分: > > > * 设置需要爬取的页数 `page_number = 10`。 > * 循环构建每一页的链接,如 `https://www.moyublog.com/95-2-2-{i}.html`。 > * 调用 `get_imgurl_list()` 函数获取图片链接。 > * 调用 `get_down_img()` 函数下载图片到本地。 > ### 代码流程: 1. 导入必要的库和模块:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

import requests # 用于发送HTTP请求

from lxml import etree # 用于解析HTML页面

import time # 用于控制爬取速度

import os # 用于文件操作

1. 定义函数`get_imgurl_list(url, imgurl_list)`用于获取图片链接:

- 1

- 2

- 3

- 4

- 5

def get_imgurl_list(url, imgurl_list):

headers = {

‘User-Agent’: ‘Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36’

}

response = requests.get(url=url, headers=headers)

html_str = response.text

html_data = etree.HTML(html_str)

li_list = html_data.xpath(“//ul[@class=‘clearfix’]/li”)

for li in li_list:

imgurl = li.xpath(“.//a/img/@data-original”)[0]

imgurl_list.append(imgurl)

* 发送GET请求获取网页内容。

* 将网页内容转换为etree对象以便后续使用xpath进行解析。

* 使用xpath定位所有的li标签,并遍历每个li标签获取图片链接,将链接添加到`imgurl_list`列表中。

1. 定义函数`get_down_img(imgurl_list)`用于下载图片:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

def get_down_img(imgurl_list):

os.mkdir(“美女”)

n = 0

for img_url in imgurl_list:

headers = {

‘User-Agent’: ‘Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/95.0.4638.69 Safari/537.36’

}

img_data = requests.get(url=img_url, headers=headers).content

img_path = ‘./美女/’ + str(n) + ‘.jpg’

with open(img_path, ‘wb’) as f:

f.write(img_data)

n += 1

* 创建名为"美女"的目录用于存放下载的图片。

* 遍历图片链接列表,逐个发送GET请求下载图片数据,并将图片写入本地文件。每张图片以数字编号命名。

1. 主程序部分:

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

if name == ‘main’:

page_number = 10 # 爬取页数

imgurl_list = [] # 存放图片链接

for i in range(0, page_number + 1):

url = f’https://www.moyublog.com/95-2-2-{i}.html’

print(url)

get_imgurl_list(url, imgurl_list)

get_down_img(imgurl_list)

> > * 设定要爬取的页数`page_number`为10。 > * 初始化存放图片链接的列表`imgurl_list`。 > * 循环构建每一页的链接并调用`get_imgurl_list()`函数获取图片链接。 > * 最后调用`get_down_img()`函数下载图片到本地"美女"文件夹。 > > > ### 为什么我们在获取数据的过程中需要用到IP池 > > 1. **应对反爬虫策略**:许多网站会采取反爬虫措施,限制单个IP的访问频率或次数。通过使用数据获取服务,可以轮换多IP来模仿多个用户访问,降低被封禁的风险。 > 2. **保证稳定性**:有些数据获取服务可能存在不稳定的情况,包括IP连接速度慢、IP被找到等问题。通过建立数据获取服务,可以预先准备多个可用的IP地址,确保程序在某个IP不可用时可以快速切换到其他可用IP,提高爬虫程序的稳定性。 > 3. **提高访问速度**:IP池中的多个IP地址可以并发使用,实现多线程或异步请求,从而加快数据获取速度。通过在数据获取服务中保持一定数量的可用IP地址,可以实现更快速的数据抓取。 > 4. **应对封禁风险**:有些网站会根据某些特定的IP地址或IP段进行封禁,如果整个IP池中的IP都被封禁,可以及时更新IP池中的IP地址,避免影响爬虫程序的正常运行。 > 5. **降低被识别的风险**:当爬虫程序使用固定的IP地址进行访问时,容易被网站识别出是爬虫行为。 > > >  ### 完整代码: **先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7** **深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!** **因此收集整理了一份《2024年最新网络安全全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。**       **既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上网络安全知识点,真正体系化!** **由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新** **[需要这份系统化资料的朋友,可以点击这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)** 3)] **既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上网络安全知识点,真正体系化!** **由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新** **[需要这份系统化资料的朋友,可以点击这里获取](https://bbs.csdn.net/forums/4f45ff00ff254613a03fab5e56a57acb)**

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66