机器学习算法——神经网络5(ART 1网络)_art网络

赞

踩

竞争型学习是神经网络中一种常用的无监督学习策略,在使用该策略时,网络的输出神经元相互竞争,每一时刻仅有一个竞争获胜的神经元被激活,其他神经元的状态被抑制,这种机制亦称为“胜者通吃”原则。

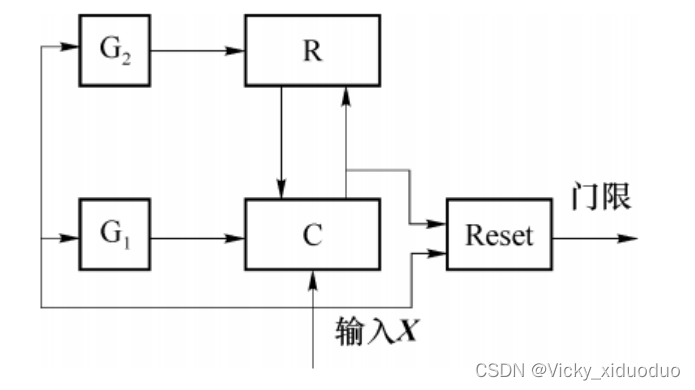

ART(Adaptive Resonance Theory,自适应谐振理论)网络是竞争型学习的重要代表。该网络由比较层、识别层、识别阈值和重置模块构成。其中,比较层负责接收输入样本,并将其传递给识别层;识别层每个神经元对应一个模式类,神经元数目可在训练过程中动态增长以增加新的模式类。

在接收到比较层的输入信号后,识别层神经元之间相互竞争以产生获胜神经元。

竞争方式:计算输入向量与每个识别层神经元所对应的模式类的代表向量之间的距离,距离最小者胜利。

获胜神经元将向其他识别层神经元发送信号,抑制其激活。

若输入向量与获胜神经元所对应的代表向量之间的相似度大于识别阈值时,则当前输入样本将被归为该代表向量所属类别。同时,网络连接权将会更新,使得以后在接收相似输入样本时该模式类会计算出更大的相似度,从而使得该获胜神经元有更大可能获胜。

若相似度不大于识别阈值,则重置模块将在识别层增设一个新的神经元,其代表向量就设置为当前输入向量。

则,识别阈值对ART网络的性能有重要影响。当识别阈值较高时,输入样本将会被分成比较多、比较精细的模式类,而如果识别阈值较低,则会产生比较少、比较粗略的模式类。

ART网络可以较好地缓解竞争型学习中的“可塑性-稳定性窘境”,可塑性是指神经网络要有学习新知识的能力,稳定性是指神经网络在学习新知识时要保持对旧知识的记忆。

这就使得ART网络具有一个很重要的优点:可进行增量学习或在线学习。

经过多年的研究和不断发展,ART网络已有3种形式:

- ART1(处理双极型或二进制信号)

ART1网络结构由两层神经元构成两个子系统,分别为比较层C和识别层R,包含三种控制信号:复位信号Reset,逻辑控制信号G1和G2。

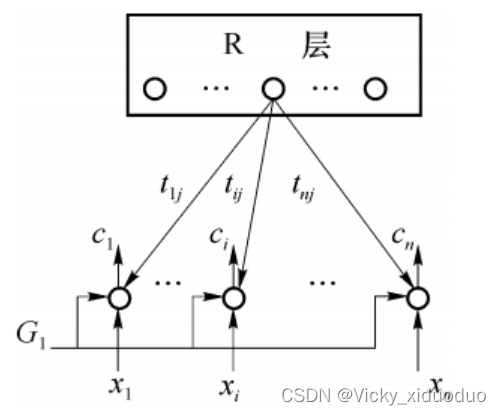

比较层C的结构为:

C层有n个神经元,每个接收来自三方面的信号:外界输入信号、R层获胜神经元的外星权向量的返回信号和控制信号G1。C层神经元的输出是根据2/3的多数表决原则产生的,输出值与三个信号中的多数信号值相同。

例如,网络开始运行时,G1=1,识别层尚未产生竞争获胜神经元,因此反馈信号为0。由2/3规则,C层输出应取决于输入信号,即C=X。当网络识别层出现反馈信号时,G1=0,由2/3规则,C层输出取决于输入信号与反馈信号的比较结果(),两者同时为1,则Ci为1,否则为0。可以看出控制信号G1的作用是使得比较层能够区分网络运行的不同阶段。网络开始运行阶段G1的作用使得C层对输入信号直接输出,之后G1的作用是使C层行使比较功能。

总之,R层的反馈信号对C的输出有调节作用。

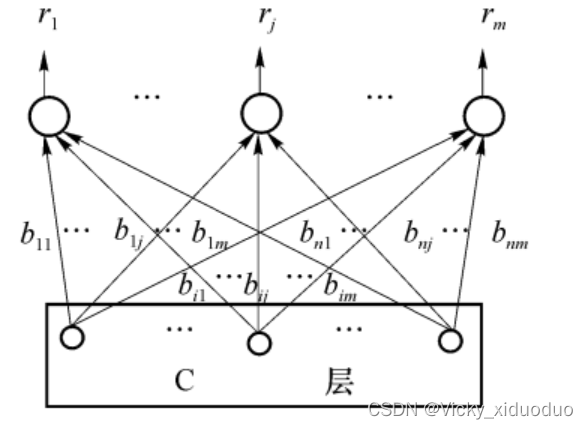

比较层R的结构为:

R层有m个神经元,代表m个输入模式类,m可以动态增长,以设立新的模式类。

C层的输出向量c沿着R层神经元的内星权向量到达R层神经元,经过竞争在产生获胜神经元处指示本此输入模式的所属类别。获胜神经元输出为1,其余为0。R层每个神经元都对应两个权向量,一个是将C层前馈信号汇聚到R层的内星权向量,另一个则是将R层反馈信号散发到C层的外星权向量。

控制信号

信号G2检测输入模式X是否为0,它等于X各分量的逻辑或,如果xi全为0,则G2=0,否则G2=1。

,R0为R层输出向量各分量的逻辑"或"。当R层的输出向量的各分量全为0时且输入向量X不是0向量时, G1=1,否则等于0。

Reset信号的作用是使得R层竞争获取神经元无效。如果根据事先设定的测量表尊,Tj(外星权向量)与X未达到设定的相似度,表明两者未充分接近,于是系统发出Reset信号,使得竞争获胜神经元无效。

对于每一个输入,模式网络运行过程可归纳为四个阶段:

(1)匹配阶段

网络在没有输入之前处于等待状态,此时输入端X=0,因此G2=0,R0=0.

当输入不全为0的模式X时,G2=1,R0=0,使得G1= 1

G1=1时,允许输入模式直接从C层输出,并向前传至R层,与R层节点所对应的所有内星权向量Bj进行匹配计算:

选择具有最大匹配度(即具有最大点积)的竞争获胜节点: