- 1用计算机打女生节快乐,2020年班级女生节快乐的祝福语

- 2Qt/C++编写安防视频监控系统(支持win/linux/mac/海康/大华/宇视/264/265等)_qt 视频监控

- 3白日门手游luac文件加密怎么解密_浅析android手游lua脚本的加密与解密

- 4FSK,PSK,ASK,BPSK调制_fsk调制

- 5深入理解CPU和异构计算芯片GPU/FPGA/ASIC_深入理解 cpu 和异构计算芯片 gpu/fpga/asic

- 6漏洞复现--JeecgBoot testConnection 远程代码执行_jeecg积木报表漏洞修复

- 7人工智能大模型专题报告:方兴未艾,并驱争先_大模型智算软件栈ogal分析报告

- 8苹果发布开源模型;盘古大模型5.0将亮相;英伟达将收购 Run:ai

- 9AI辅助编程实践-Copilot_大模型辅助编程copilot

- 10vi(vim)命令整理_程序员杰瑞。

【深度学习】深度学习md笔记总结第5篇:神经网络与tf.keras,学习目标【附代码文档】

赞

踩

深度学习笔记完整教程(附代码资料)主要内容讲述:深度学习课程,深度学习介绍要求,目标,学习目标,1.1.1 区别,学习目标,学习目标。TensorFlow介绍,2.4 张量学习目标,2.4.1 张量(Tensor),2.4.2 创建张量的指令,2.4.3 张量的变换,2.4.4 张量的数学运算,学习目标。TensorFlow介绍,1.2 神经网络基础学习目标。TensorFlow介绍,总结学习目标,1.3.1 神经网络,1.3.2 playground使用,学习目标,1.4.1 softmax回归,1.4.2 交叉熵损失。神经网络与tf.keras,1.3 Tensorflow实现神经网络学习目标,1.3.1 TensorFlow keras介绍,1.3.2 案例:实现多层神经网络进行时装分类。神经网络与tf.keras,1.4 深层神经网络学习目标。卷积神经网络,3.1 卷积神经网络(CNN)原理学习目标。卷积神经网络,3.1 卷积神经网络(CNN)原理学习目标。卷积神经网络,2.2案例:CIFAR100类别分类学习目标,2.2.1 CIFAR100数据集介绍,2.2.2 API 使用,2.2.3 步骤分析以及代码实现(缩减版LeNet5),学习目标。卷积神经网络,2.4 BN与神经网络调优学习目标。卷积神经网络,2.4 经典分类网络结构学习目标,2.4.6 案例:使用pre_trained模型进行VGG预测,2.4.7 总结。卷积神经网络,2.5 CNN网络实战技巧学习目标,3.1.1 案例:基于VGG对五种图片类别识别的迁移学习,3.1.2 数据增强的作用。卷积神经网络,总结学习目标,1.1.1 项目演示,1.1.2 项目结构,1.1.3 项目知识点,学习目标,1.2.1 安装。商品物体检测项目介绍,3.4 Fast R-CNN。YOLO与SSD,4.3 案例:SSD进行物体检测4.3.1 案例效果,4.3.2 案例需求,4.3.3 步骤分析以及代码,2.1.1 常用目标检测数据集,2.1.2 pascal voc数据集介绍,2.1.3 XML。商品检测数据集训练,5.2 标注数据读取与存储5.2.1 案例:xml读取本地文件存储到pkl,5.3.1 案例训练结果,5.3.2 案例思路,5.3.3 多GPU训练代码修改,5.4.1 预测代码,5.4.1 keras 模型进行TensorFlow导出。

全套笔记资料代码移步: 前往gitee仓库查看

感兴趣的小伙伴可以自取哦,欢迎大家点赞转发~

全套教程部分目录:

部分文件图片:

神经网络与tf.keras

1.3 Tensorflow实现神经网络

学习目标

-

目标

-

掌握Tensorflow API的使用

-

应用

-

应用TF搭建一个分类模型

1.3.1 TensorFlow keras介绍

Keras 是一个用于构建和训练深度学习模型的高阶 API。它可用于快速设计原型、高级研究和生产,具有以下三个主要优势:

- 方便用户使用,快速构建模型 Keras 具有针对常见用例做出优化的简单而一致的界面。它可针对用户错误提供切实可行的清晰反馈。

-

模块化和可组 将可配置的构造块连接在一起就可以构建 Keras 模型,并且几乎不受限制。

-

导入:

import tensorflow as tf

from tensorflow import keras

- 1

- 2

- 1、获取相关现有数据集(无需自己去构造)

-

keras.datasets

- mnist:手写数字

- fashion_mnist:时尚分类

- cifar10(100):10个类别分类

fashion_mnist = keras.datasets.fashion_mnist

(train_images, train_labels), (test_images, test_labels) = fashion_mnist.load_data()

print(train_images, train_labels)

- 1

- 2

- 3

- 4

- 5

- 2、构建模型

- 在 Keras 中,您可以通过组合层来构建模型。模型(通常)是由层构成的图。最常见的模型类型是层的堆叠,keras.layers中就有很多模型,如下图:可以在源码文件中找到

- tf.keras.Sequential模型(layers如下)

from tensorflow.python.keras.layers import Dense

from tensorflow.python.keras.layers import DepthwiseConv2D

from tensorflow.python.keras.layers import Dot

from tensorflow.python.keras.layers import Dropout

from tensorflow.python.keras.layers import ELU

from tensorflow.python.keras.layers import Embedding

from tensorflow.python.keras.layers import Flatten

from tensorflow.python.keras.layers import GRU

from tensorflow.python.keras.layers import GRUCell

from tensorflow.python.keras.layers import LSTMCell

...

...

...

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- Flatten:将输入数据进行形状改变展开

-

Dense:添加一层神经元

-

Dense(units,activation=None,**kwargs)

- units:神经元个数

- activation:激活函数,参考tf.nn.relu,tf.nn.softmax,tf.nn.sigmoid,tf.nn.tanh

- **kwargs:输入上层输入的形状,input_shape=()

tf.keras.Sequential构建类似管道的模型

model = keras.Sequential([

keras.layers.Flatten(input_shape=(28, 28)),

keras.layers.Dense(128, activation=tf.nn.relu),

keras.layers.Dense(10, activation=tf.nn.softmax)

])

- 1

- 2

- 3

- 4

- 5

-

3、训练与评估

-

通过调用model的

compile方法去配置该模型所需要的训练参数以及评估方法。 -

model.compile(optimizer,loss=None,metrics=None, 准确率衡):配置训练相关参数

- optimizer:梯度下降优化器(在keras.optimizers)

from tensorflow.python.keras.optimizers import Adadelta

from tensorflow.python.keras.optimizers import Adagrad

from tensorflow.python.keras.optimizers import Adam

from tensorflow.python.keras.optimizers import Adamax

from tensorflow.python.keras.optimizers import Nadam

from tensorflow.python.keras.optimizers import Optimizer

from tensorflow.python.keras.optimizers import RMSprop

from tensorflow.python.keras.optimizers import SGD

from tensorflow.python.keras.optimizers import deserialize

from tensorflow.python.keras.optimizers import get

from tensorflow.python.keras.optimizers import serialize

from tensorflow.python.keras.optimizers import AdamOptimizer()

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

* loss=None:损失类型,类型可以是字符串或者该function名字参考:

- 1

from tensorflow.python.keras.losses import KLD from tensorflow.python.keras.losses import KLD as kld from tensorflow.python.keras.losses import KLD as kullback_leibler_divergence from tensorflow.python.keras.losses import MAE from tensorflow.python.keras.losses import MAE as mae from tensorflow.python.keras.losses import MAE as mean_absolute_error from tensorflow.python.keras.losses import MAPE from tensorflow.python.keras.losses import MAPE as mape from tensorflow.python.keras.losses import MAPE as mean_absolute_percentage_error from tensorflow.python.keras.losses import MSE from tensorflow.python.keras.losses import MSE as mean_squared_error from tensorflow.python.keras.losses import MSE as mse from tensorflow.python.keras.losses import MSLE from tensorflow.python.keras.losses import MSLE as mean_squared_logarithmic_error from tensorflow.python.keras.losses import MSLE as msle from tensorflow.python.keras.losses import binary_crossentropy from tensorflow.python.keras.losses import categorical_crossentropy from tensorflow.python.keras.losses import categorical_hinge from tensorflow.python.keras.losses import cosine from tensorflow.python.keras.losses import cosine as cosine_proximity from tensorflow.python.keras.losses import deserialize from tensorflow.python.keras.losses import get from tensorflow.python.keras.losses import hinge from tensorflow.python.keras.losses import logcosh from tensorflow.python.keras.losses import poisson from tensorflow.python.keras.losses import serialize from tensorflow.python.keras.losses import sparse_categorical_crossentropy from tensorflow.python.keras.losses import squared_hinge

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

* metrics=None, ['accuracy']

- 1

-

model.fit():进行训练

-

(x=None,y=None, batch_size=None,epochs=1,callbacks=None)

-

x:特征值:

-

1、Numpy array (or array-like), or a list of arrays

2、A TensorFlow tensor, or a list of tensors

3、`tf.data` dataset or a dataset iterator. Should return a tuple of either `(inputs, targets)` or `(inputs, targets, sample_weights)`.

4、A generator or `keras.utils.Sequence` returning `(inputs, targets)` or `(inputs, targets, sample weights)`.

- 1

- 2

- 3

- 4

* y:目标值

* batch_size=None:批次大小

* epochs=1:训练迭代次数

* callbacks=None:添加回调列表(用于如tensorboard显示等)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

model.compile(optimizer=tf.keras.optimizers.Adam(),

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

model.fit(train_images, train_labels, epochs=5)

model.evaluate(test_images, test_labels)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

1.3.2 案例:实现多层神经网络进行时装分类

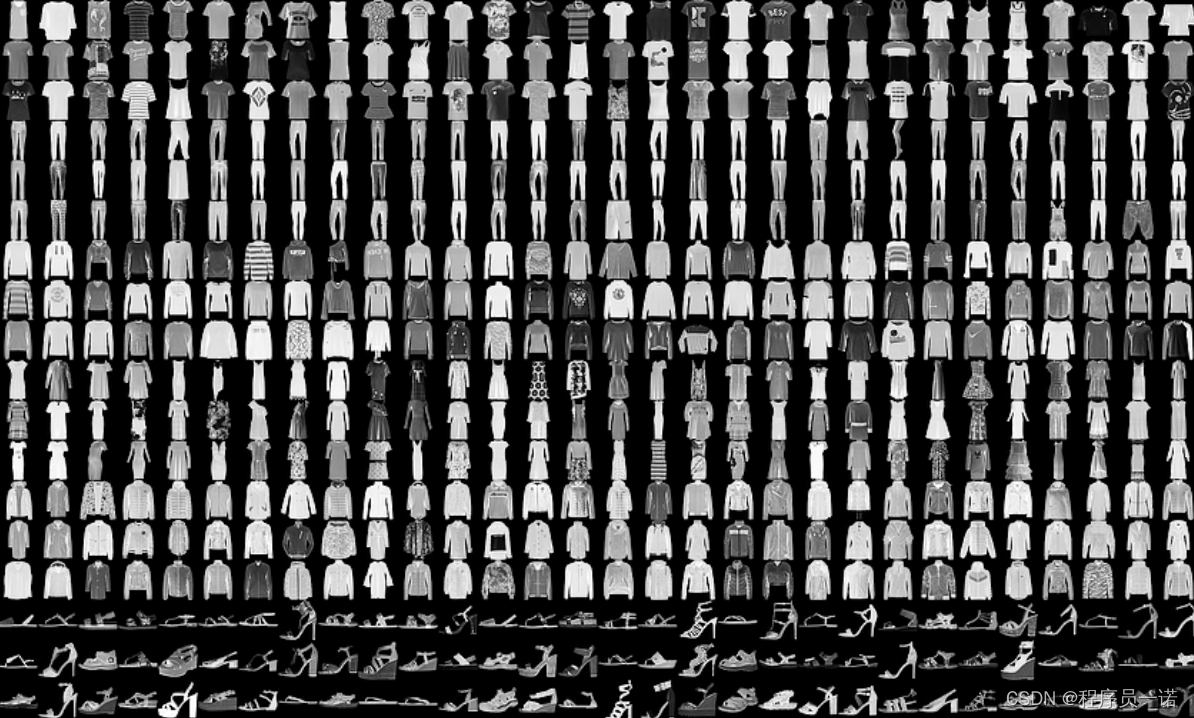

70000 张灰度图像,涵盖 10 个类别。以下图像显示了单件服饰在较低分辨率(28x28 像素)下的效果:

1.3.2.1 需求:

| 标签 | 类别 |

|---|---|

| 0 | T 恤衫/上衣 |

| 1 | 裤子 |

| 2 | 套衫 |

| 3 | 裙子 |

| 4 | 外套 |

| 5 | 凉鞋 |

| 6 | 衬衫 |

| 7 | 运动鞋 |

| 8 | 包包 |

1.3.2.2 步骤分析和代码实现:

-

读取数据集:

-

从datasets中获取相应的数据集,直接有训练集和测试集

class SingleNN(object):

def __init__(self):

(self.train, self.train_label), (self.test, self.test_label) = keras.datasets.fashion_mnist.load_data()

- 1

- 2

- 3

- 4

-

进行模型编写

-

双层:128个神经元,全连接层10个类别输出

class SingleNN(object):

model = keras.Sequential([

keras.layers.Flatten(input_shape=(28, 28)),

keras.layers.Dense(128, activation=tf.nn.relu),

keras.layers.Dense(10, activation=tf.nn.softmax)

])

- 1

- 2

- 3

- 4

- 5

- 6

- 7

这里我们model只是放在类中,作为类的固定模型属性

激活函数的选择

涉及到网络的优化时候,会有不同的激活函数选择有一个问题是神经网络的隐藏层和输出单元用什么激活函数。之前我们都是选用 sigmoid 函数,但有时其他函数的效果会好得多,大多数通过实践得来,没有很好的解释性。

可供选用的激活函数有:

- tanh 函数(the hyperbolic tangent function,双曲正切函数):

效果比 sigmoid 函数好,因为函数输出介于 -1 和 1 之间。

注 :tanh 函数存在和 sigmoid 函数一样的缺点:当 z 趋紧无穷大(或无穷小),导数的梯度(即函数的斜率)就趋紧于 0,这使得梯度算法的速度会减慢。

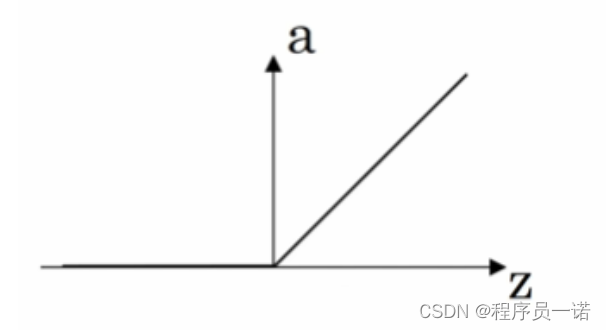

- ReLU 函数(the rectified linear unit,修正线性单元)

当 z > 0 时,梯度始终为 1,从而提高神经网络基于梯度算法的运算速度,收敛速度远大于 sigmoid 和 tanh。然而当 z < 0 时,梯度一直为 0,但是实际的运用中,该缺陷的影响不是很大。

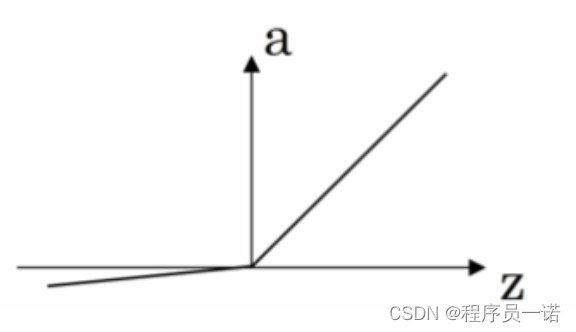

- Leaky ReLU(带泄漏的 ReLU):

Leaky ReLU 保证在 z < 0 的时候,梯度仍然不为 0。理论上来说,Leaky ReLU 有 ReLU 的所有优点,但在实际操作中没有证明总是好于 ReLU,因此不常用。

为什么需要非线性的激活函数

使用线性激活函数和不使用激活函数、直接使用 Logistic 回归没有区别,那么无论神经网络有多少层,输出都是输入的线性组合,与没有隐藏层效果相当,就成了最原始的感知器了。

a [ 1 ] = z [ 1 ] = W [ 1 ] x + b [ 1 ] a^{[1]} = z^{[1]} = W^{[1]}x+b^{[1]} a[1]=z[1]=W[1]x+b[1]

a [ 2 ] = z [ 2 ] = W [ 2 ] a [ 1 ] + b [ 2 ] {a}^{[2]}=z^{[2]} = W^{[2]}a^{[1]}+b^{[2]} a[2]=z[2]=W[2]a[1]+b[2]

那么这样的话相当于

a [ 2 ] = z [ 2 ] = W [ 2 ] ( W [ 1 ] x + b [ 1 ] ) + b [ 2 ] = ( W [ 2 ] W [ 1 ] ) x + ( W [ 2 ] b [ 1 ] + b [ 2 ] ) = w x + b {a}^{[2]}=z^{[2]} = W^{[2]}(W^{[1]}x+b^{[1]})+b^{[2]}=(W^{[2]}W^{[1]})x+(W^{[2]}b^{[1]}+b^{[2]})=wx+b a[2]=z[2]=W[2](W[1]x+b[1])+b[2]=(W[2]W[1])x+(W[2]b[1]+b[2])=wx+b

- 编译、训练以及评估

def compile(self): SingleNN.model.compile(optimizer=tf.train.AdamOptimizer(), loss=tf.keras.losses.sparse_categorical_crossentropy, metrics=['accuracy']) return None def fit(self): SingleNN.model.fit(self.train, self.train_label, epochs=5) return None def evaluate(self): test_loss, test_acc = SingleNN.model.evaluate(self.test, self.test_label) print(test_loss, test_acc) return None

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

1.3.2.1 打印模型

- model.summary():查看模型结构

1.3.2.2 手动保存和回复模型

- 目的:防止训练长时间,出现意外导致重新训练

- model.save_weights('./weights/my_model')

- model.load_weights('./weights/my_model')

SingleNN.model.save_weights("./ckpt/SingleNN")

def predict(self):

# 直接使用训练过后的权重测试

if os.path.exists("./ckpt/checkpoint"):

SingleNN.model.load_weights("./ckpt/SingleNN")

predictions = SingleNN.model.predict(self.test)

print(np.argmax(predictions, 1))

return

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

1.3.2.3 添加Tensorboard观察损失等情况

# 添加tensoboard观察

tensorboard = keras.callbacks.TensorBoard(log_dir='./graph', histogram_freq=0,

write_graph=True, write_images=True)

SingleNN.model.fit(self.train, self.train_label, epochs=5, callbacks=[tensorboard])

- 1

- 2

- 3

- 4

- 5

- 6

- 7