- 12023东北农业大学计算机考研信息汇总

- 2服务器中bind的ip地址是什么_bindip

- 3【知识图谱应用】Molecular Contrastive Learning with Chemical Element Knowledge Graph (论文笔记)

- 4svn迁移到git

- 5MybatisPlus--个人笔记_mybatisplus injectionconfig

- 6【Python-Docx库】Word与Python的完美结合_python docx库

- 7unity中鼠标与物体的交互_使用unity设计鼠标点击选中后,物体随鼠标移动,再次点击放置物体的交互。

- 8全民AI时代:手把手教你用Ollama & AnythingLLM搭建AI知识库,无需编程,跟着做就行!_ollama创建私有知识库

- 9Android ADB常用用法_android adb用法

- 10CMAK(kafka manager)部署_cmak部署

Hadoop 安装(详细步骤)_hadoop2.6.0安装教程

赞

踩

前期操作

-

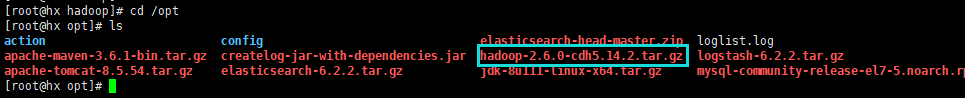

下载 hadoop 安装包至安装目录

安装目录:/opt

hadoop版本:hadoop-2.6.0-cdh5.14.2.tar.gz

-

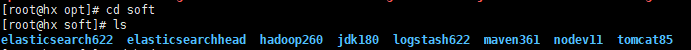

解压安装包至软件目录(最好更名,以便之后方便配置文件)

tar -zxf hadoop-2.6.0-cdh5.14.2.tar.gz

mv hadoop-2.6.0-cdh5.14.2 soft/hadoop260

-

进入文件,准备配置

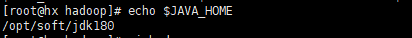

因为需要用到 java 的路径,可以代码查找,并复制至剪贴板备用cd /opt/soft/hadoop260/etc/hadoop

echo $JAVA_HOME

修改配置文件

注:注意修改路径和IP地址之类的变更项

-

配置 jdk 路径

#更换 JAVA_HOME 的路径vi hadoop-env.sh

export JAVA_HOME=/opt/soft/jdk180

-

修改核心配置文件

设置默认文件系统(本地默认 file:/位置)此处端口与HBASE端口设成一样

创建临时存储文件路径

授权访问用户为所有 root 型

授权访问用户为任意组的 root 型vi core-site.xml

fs.defaultFS hdfs://192.168.56.101:9000 hadoop.tmp.dir /opt/soft/hadoop260/tmp hadoop.proxyuser.root.hosts * hadoop.proxyuser.root.groups * -

设置文件副本个数

这里:最少3个伪分布只写1个,我只用一台机子模拟vi hdfs-site.xml

dfs.replication 1 -

设置映射化简模型框架

这里需要复制 mapred-site.xml.template 临时文件,并在复制后的文件中配置(注意命名)

设置框架为 yarncp mapred-site.xml.template mapred-site.xml

vi mapred-site.xml

mapreduce.framework.name yarn -

设置 yarn 站点+节点

设置 yarn 站点名称为:localhost

设置辅助节点管理vi yarn-site.xml

yarn.resourcemanager.localhost localhost yarn.nodemanager.aux-services mapreduce_shuffle -

添加环境变量的相关项

vi /etc/profile

#末行添加配置项

export HADOOP_HOME=/opt/soft/hadoop260

export HADOOP_MAPRED_HOME= H A D O O P H O M E e x p o r t H A D O O P C O M M O N H O M E = HADOOP_HOME export HADOOP_COMMON_HOME= HADOOPHOMEexportHADOOPCOMMONHOME=HADOOP_HOME

export HADOOP_HDFS_HOME= H A D O O P H O M E e x p o r t Y A R N H O M E = HADOOP_HOME export YARN_HOME= HADOOPHOMEexportYARNHOME=HADOOP_HOME

export HADOOP_COMMON_LIB_NATIVE_DIR= H A D O O P H O M E / l i b / n a t i v e e x p o r t P A T H = HADOOP_HOME/lib/native export PATH= HADOOPHOME/lib/nativeexportPATH=PATH: H A D O O P H O M E / s b i n : HADOOP_HOME/sbin: HADOOPHOME/sbin:HADOOP_HOME/bin

export HADOOP_INSTALL=$HADOOP_HOME

启动调试是否配置成功

-

加载环境变量配置文件

source /etc/profile

-

格式化 NameNode

hadoop namenode -format

-

启动 Hadoop

start-all.sh

-

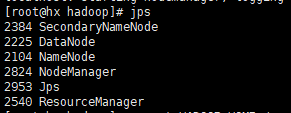

检验启动是否成功

后台进程应该有相关的5项

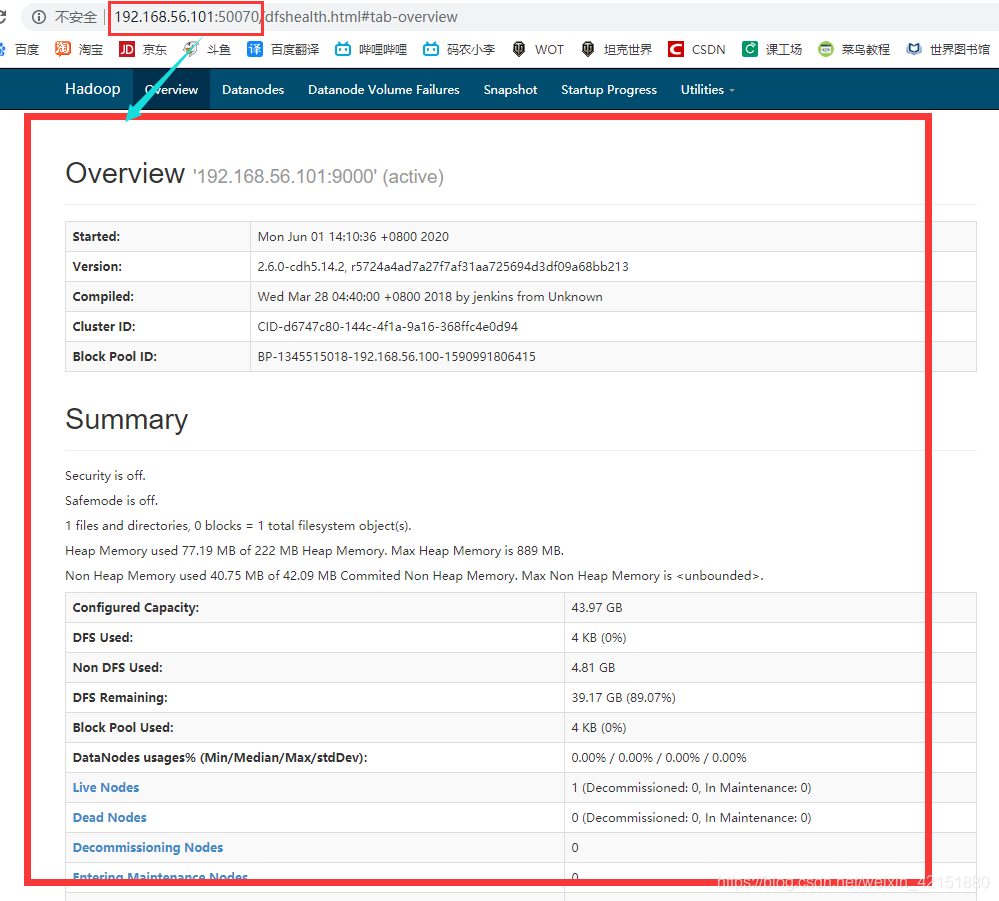

网页键入 192.168.56.101:50070 页面显示为:

检验成功,即安装成功,祝大家好运,谢谢!!!