- 1为“中国汽车价值”而战,中国星旗舰SUV星越L全球上市

- 2加串-解串芯片_解串器 调试 触发

- 3数据结构第一关---- 复杂度

- 4微软 clarity Beta 版本上线测试_微软 clarity 开源私有部署

- 5IntelliJ IDEA - 创建文件自动 Add 到 Git 选项配置_ide project settings can be added to git

- 6Baidu Comate发布中文名“文心快码”,企业级安全能力全面升级

- 7《大数据分析原理与实践》——第1章 绪论 1.1 什么是大数据

- 8java IO流进阶 模拟上传头像系统详解_java实现用户头像上传和修改

- 9《动手做科研》一步一步地展示如何入门人工智能科研_动手做科研csdn

- 10java.sql.SQLException: [Microsoft][ODBC 驱动程序管理器] 未发现数据源名称并且未指定默认驱动程序解决方法_链接服务器,未发现数据源并且未指定默认驱动

GPT4来了,多模态模型上线_we鈥檝e created gpt-4, the latest mileston

赞

踩

目录

一、GPT4来了!

今天是2023年3月14日,是非同凡响的一天,是迄今为止最强大的多模态模型GPT4发布的一天!据官方介绍,它的输入可以是文字(上限2.5万字),还可以是图像。更多详细介绍,请见下文:

OpenAI老板Sam Altman在推特上发文称:

GPT-4是迄今为止我们最强大的模型

We’ve created GPT-4, the latest milestone in OpenAI’s effort in scaling up deep learning. GPT-4 is a large multimodal model (accepting image and text inputs, emitting text outputs) that, while less capable than humans in many real-world scenarios, exhibits human-level performance on various professional and academic benchmarks.

二、什么是多模态?

如此火的GPT-4是源于支持多模态,那到底什么是多模态呢?

- 什么是模态? 模态是一种社会性、文化性的资源,是物质媒体经过时间塑造而形成的意义潜势。 从社会符号学的角度上对模态的认知可以是声音、文字和图像等。

- 人类通过眼睛、耳朵、触觉等各种感觉器官接触世界,每种信息的来源或形式都可以称之为模态。同时,模态也可以是与人类通过自身的感觉器官从外部得到的信息,比如说嗅觉、视觉、听觉等。 随着人工智能领域机器学习、深度学习的不断发展,研究内容的不断增加和更新,逐渐也赋予了模态新的定义,即机器对包含数据表征模式、数据收集模式、数据特征主体这3个外部信息的感知模式或信息信道。

- 多模态机器学习研究包含不同模态数据的机器学习问题,一般的模态有视觉、文字和声音。它们通常来自不同的传感器,数据的形成方式和内部结构有很大的不同。例如,图像是存在于自然界中的连续空间,文本是依赖于人类知识、语法规则而组织起来的离散空间,因此多模数据的异质性提出了如何学习多模之间的关联性和互补性的问题。

三、GPT-4有多强?更多玩法等你来看:

- 多模态大模型

- 各种专业和学术考试中表现出了与人类水平相当的性能

- GPT-4的训练稳定性是史无前例的

- OpenAI在过去两年里重建了深度学习栈,并与Azure共同设计了一台超级计算机以便于应付他们的工作负载

- OpenAI还开源了OpenAI Evals,这是他们的自动化评估AI模型性能的框架,任何人都可以提交他们模型的缺陷以帮助改进

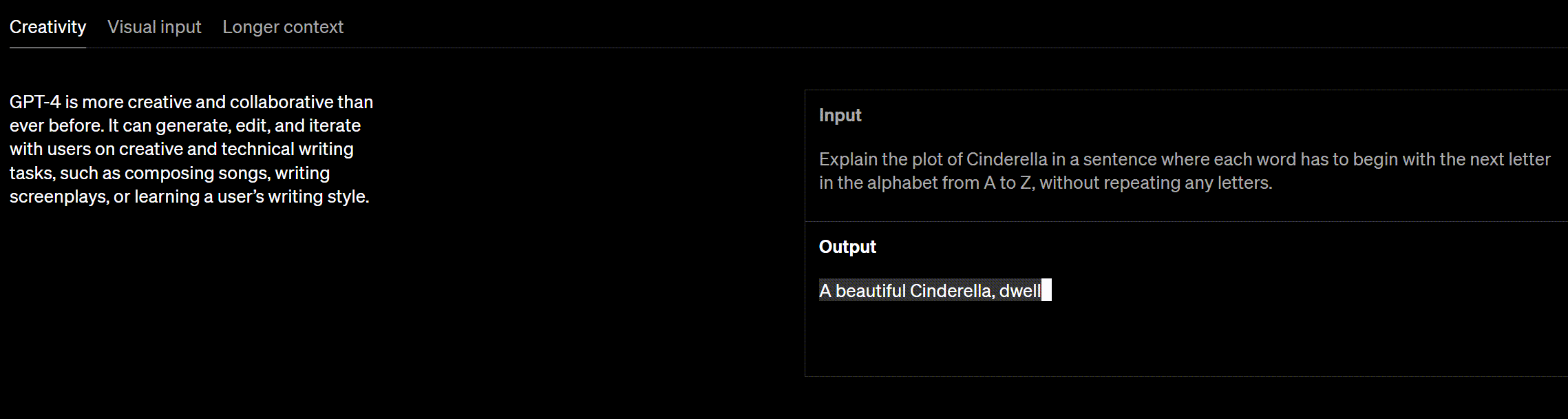

3.1 更加人性化,更具创意的回答:

GPT-4比以往任何时候都更具创造力和协作性。它能够生成、编辑和迭代创意和技术写作任务,并与用户一起进行合作,比如创作歌曲、编写剧本或学习用户的写作风格。

3.2 图像描述生成:

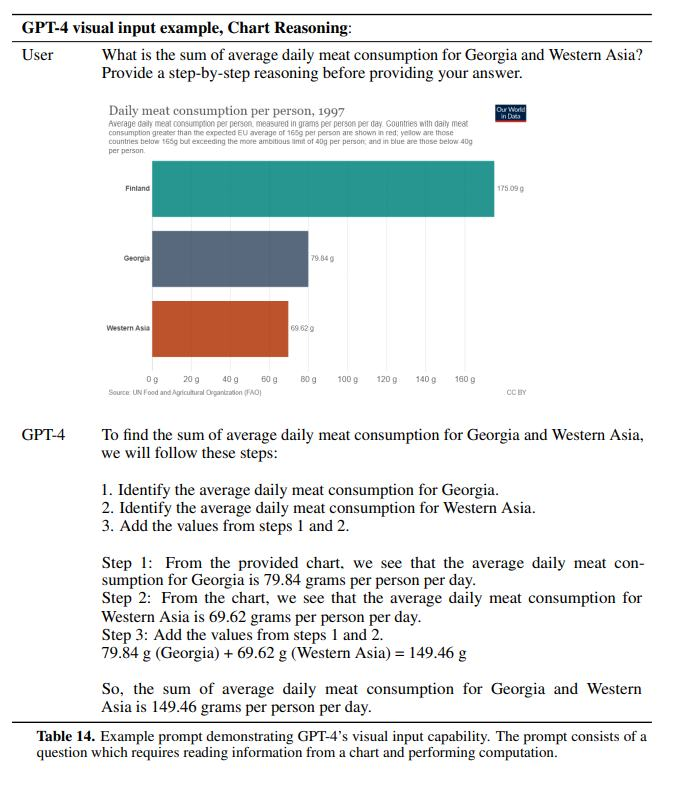

3.3 可视化输入: 文字与图片结合输入

拿一张手机插着VGA线的图给GPT4,并问:这张图有什么好笑的,分组描述它。

它给出了令人惊叹的分析与回答。

但令人更加印象深刻的是,只需要一张图表,就可以找到格鲁吉亚和西亚的日均肉类消费量

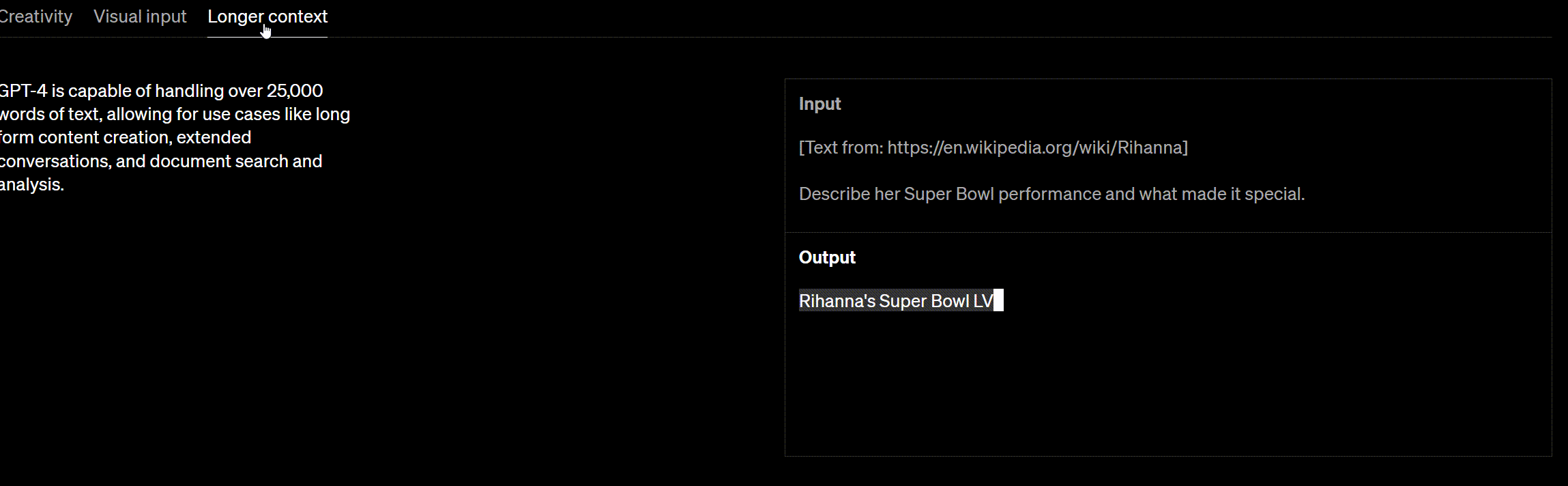

3.4 更长的上下文支持:

GPT-4能够处理超过25,000个单词的文本,这使得它可以用于创建长篇内容、进行延续性对话以及文档搜索和分析等用途

3.5 局限性:

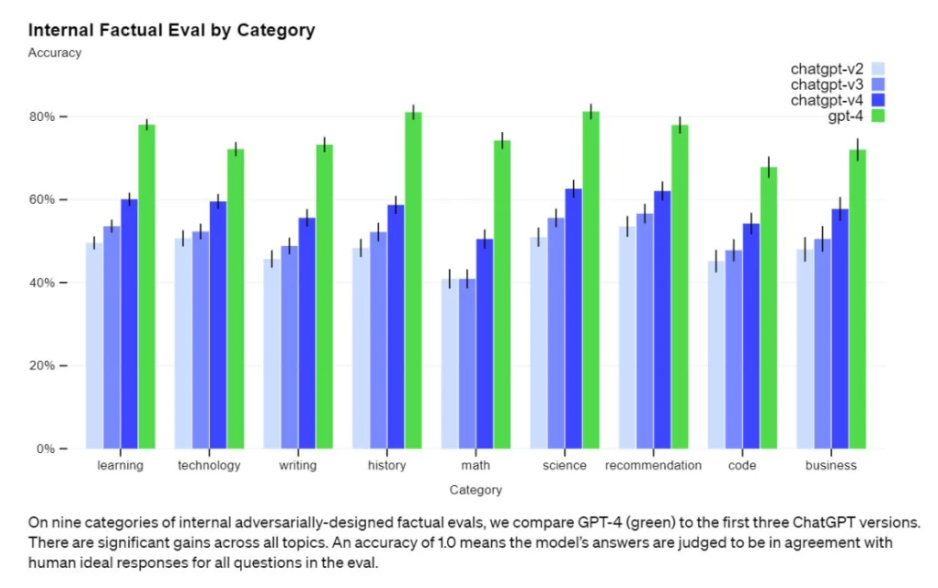

尽管GPT-4在功能方面已经非常强大,但它仍然存在与早期GPT模型相似的局限性,其中最重要的是它仍然不完全可靠。OpenAI表示,GPT-4仍然会产生幻觉、生成错误答案,并出现推理错误。因此,在使用语言模型时,应该谨慎审查输出内容,并根据特定用例的需求使用适当的协议(例如人工审查、附加上下文或完全避免使用)。总的来说,GPT-4相对于以前的模型已经显著减轻了幻觉问题,但仍需要注意其输出的准确性。在OpenAI的内部对抗性真实性评估中,GPT-4的得分比最新的GPT-3.5模型高40%。这表明GPT-4相对于以前的模型已经取得了显著的进步,但在使用时仍需注意其局限性和缺陷

四、GPT-4有多强?基础模型介绍:

GPT-4是一种非常强大的预训练语言模型,它可以接受图像和文本输入,以文本输出1。它可以在很多复杂的NLP任务中取得惊人的效果,例如文章生成,代码生成,机器翻译,Q&A等。它在以下几个方面实现了质的飞越。

GPT-4的模型大小是在1750亿到2800亿参数之间56,比GPT-3大了1到2倍,但是小于当前最大的语言模型(5300亿参数的MT-NLG和5400亿参数的PaLM)6。它使用了超级计算机来进行训练,消耗了大量的算力和数据64。它采用了自回归(AR)的架构,即根据前面的输入来预测下一个输出2。它使用了Transformer网络作为基础结构,利用注意力机制来捕捉长距离依赖关系。

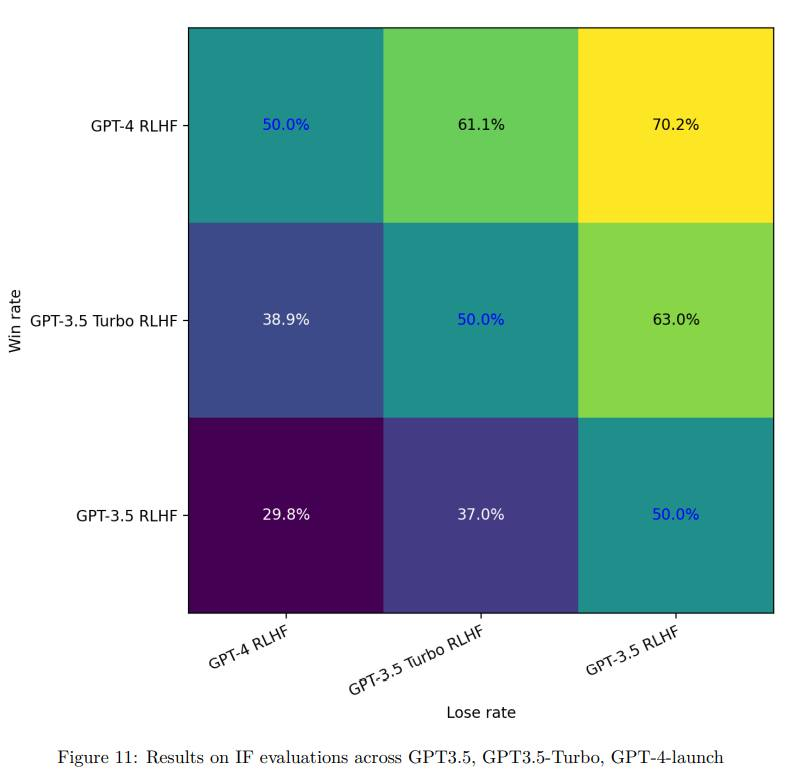

GPT-4在训练过程中加入了一些新颖的技术和方法,以提高模型的性能和安全性。其中一项是RLHF(Reinforcement Learning for Human Feedback),即利用人类反馈来对模型进行强化学习43。这样可以让模型更好地适应不同的场景和用户需求,同时避免一些不合适或有害的输出43。另一项是零样本分类器(Zero-Shot Classifier),即利用模型自身的知识和推理能力来对输入进行分类,而不需要额外的标注数据或训练过程43。这样可以让模型更灵活地处理各种类型和主题的输入,同时减少数据偏差和隐私风险43

在过去的两年里,OpenAI 重建了整个深度学习堆栈,并与 Azure 一起为其工作负载从头开始设计了一台超级计算机。一年前,OpenAI 在训练 GPT-3.5 时第一次尝试运行了该超算系统,之后他们又陆续发现并修复了一些错误,改进了其理论基础。这些改进的结果是 GPT-4 的训练运行获得了前所未有的稳定,以至于 OpenAI 能够提前准确预测 GPT-4 的训练性能,它也是第一个实现这一点的大模型。OpenAI 表示他们将继续专注于可靠的扩展,进一步完善方法,以帮助其实现更强大的提前预测性能和规划未来的能力,这对安全至关重要。

OpenAI花了6个月时间使GPT-4更安全、更具一致性。在内部评估中,与GPT-3.5相比,GPT-4对不允许内容做出回应的可能性降低82%,给出事实性回应的可能性高40%。也就是说,在去年八月份OpenAI就已经完成了对GPT-4的模型训练,不得不说,自打ChatGPT问世以来,微软和谷歌之间打响的数轮科技战役,微软这次又是真的赢麻了。

五、GPT-4有多强?性能测试介绍:

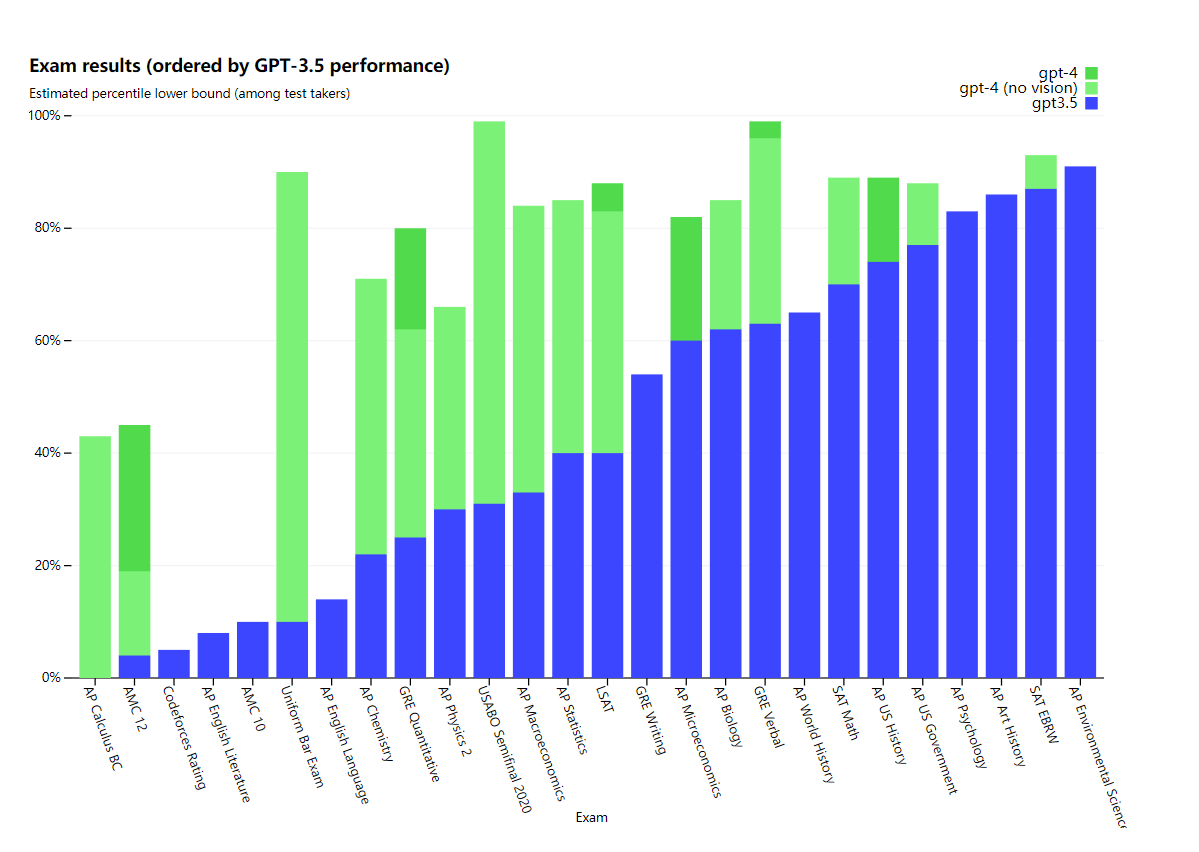

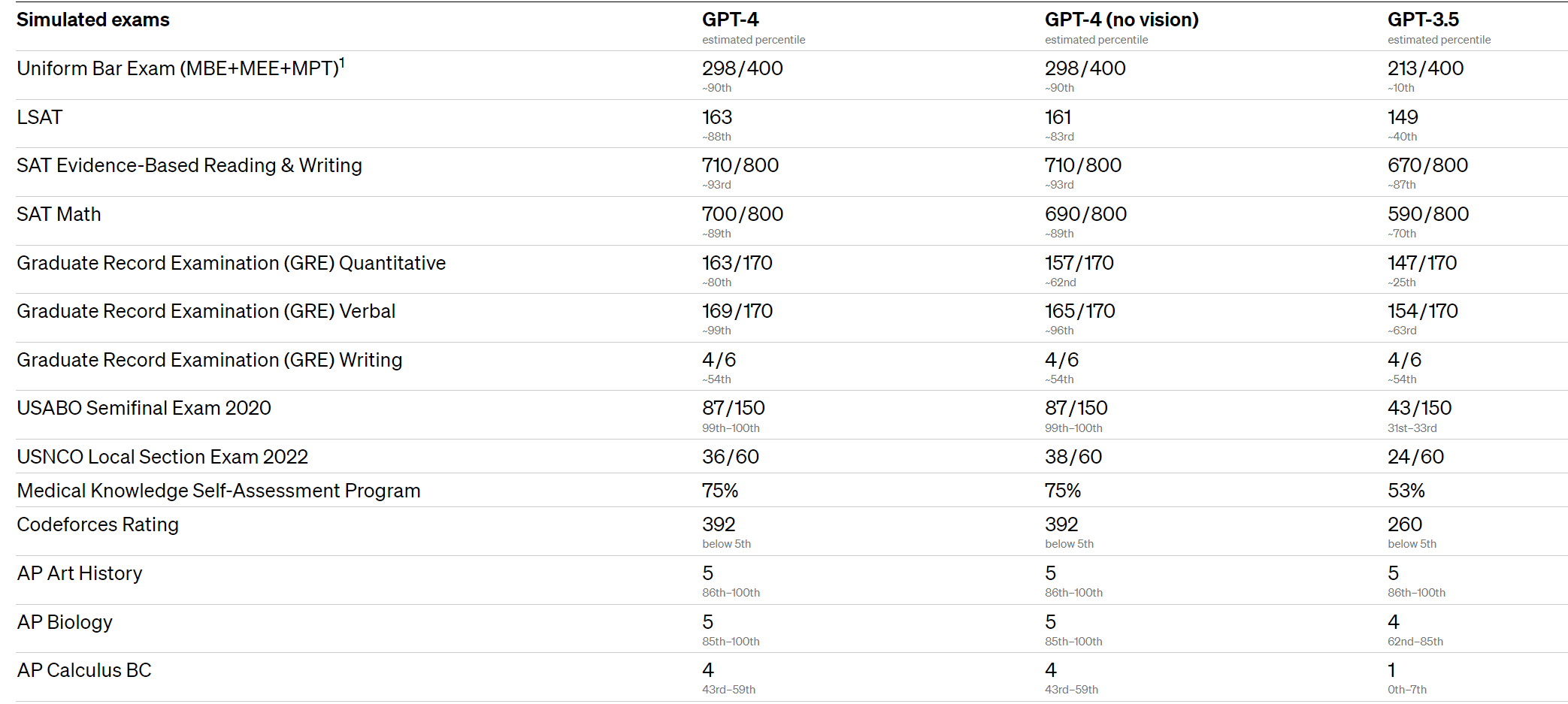

5.1 美国高考SAT试题,GPT-4在阅读写作中拿下710分,数学700分

在非正式的谈话中,GPT-3.5和GPT-4之间的区别可能是微妙的。当任务的复杂性达到足够的阈值时,区别就显现出来了——相比GPT-3.5,GPT-4更加可靠、富有创造力,并且能够处理比较微妙的指令。

为了理解这两个模型之间的区别,我们进行了各种基准测试,包括模拟最初设计给人类的考试。我们使用最近公开的测试(在奥林匹克竞赛和AP自由回答问题的情况下)或购买2022-2023年版本的模拟考试。我们没有为这些考试进行专门的训练。模型在训练期间看到的问题只占少数,但我们认为结果具有代表性——详见我们的技术报告。

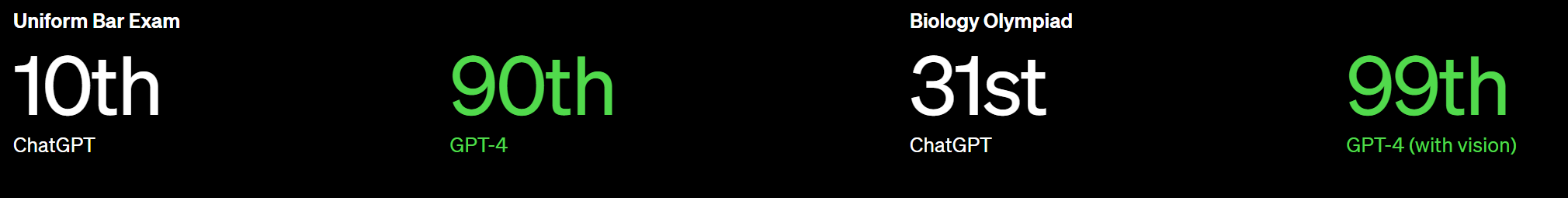

5.2 在其他各种类的模拟考试中,GPT-4也表现出不同凡响的成绩

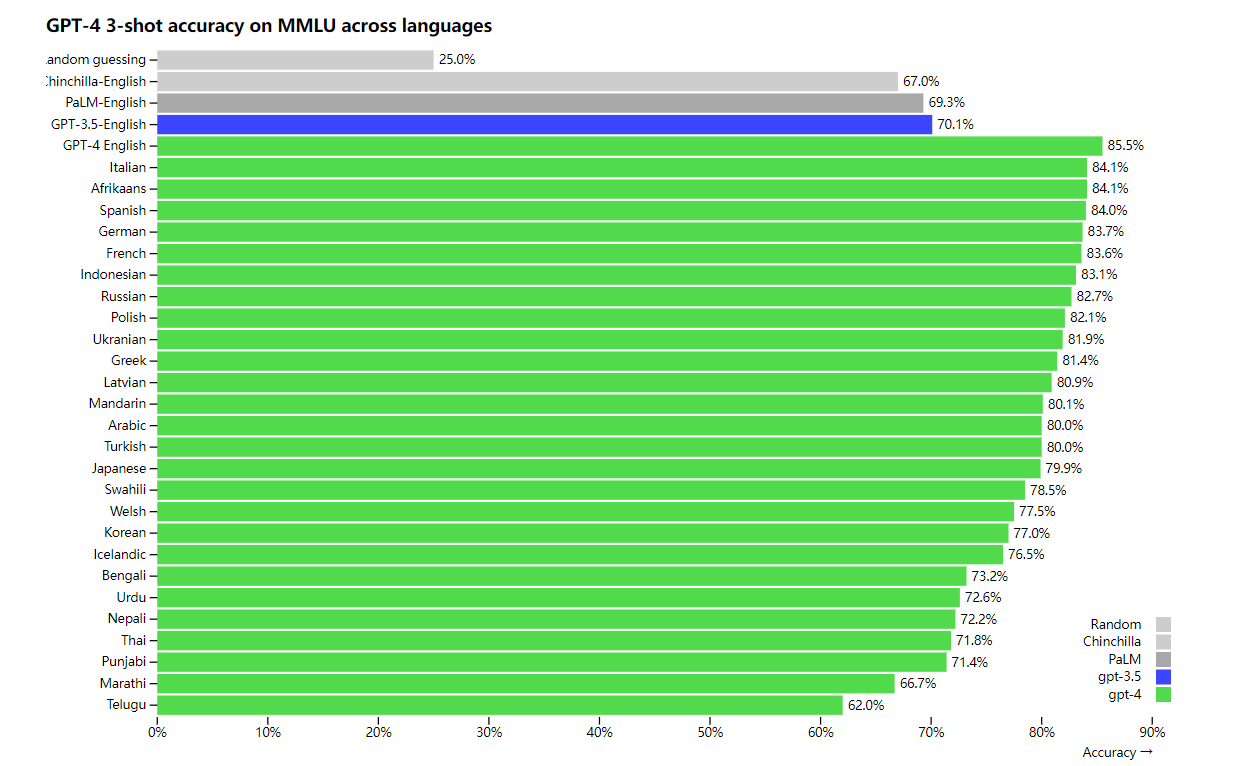

5.3 在机器学习任务测试上,GPT-4表现出的性能也远远超过当前现有的大型语言模型,以及大多数最先进SOTA模型

不仅如此,OpenAI为了展示GPT-4在非英语语言上的性能,将MMLU测试翻译成不同语言版本,意料之内,GPT-4的表现均优于GPT-3.5

5.4 New Bing 早已在用:

GPT-4发布后微软工作人员表示:

如果你在过去六周内的任何时候使用过新的 Bing 预览版(New Bing),你就已经提前了解了 OpenAI 最新模型的强大功能

没错,New Bing早就在GPT-4上运行,你是否已经被其强大的能力震撼,尽管那只是早期版本。

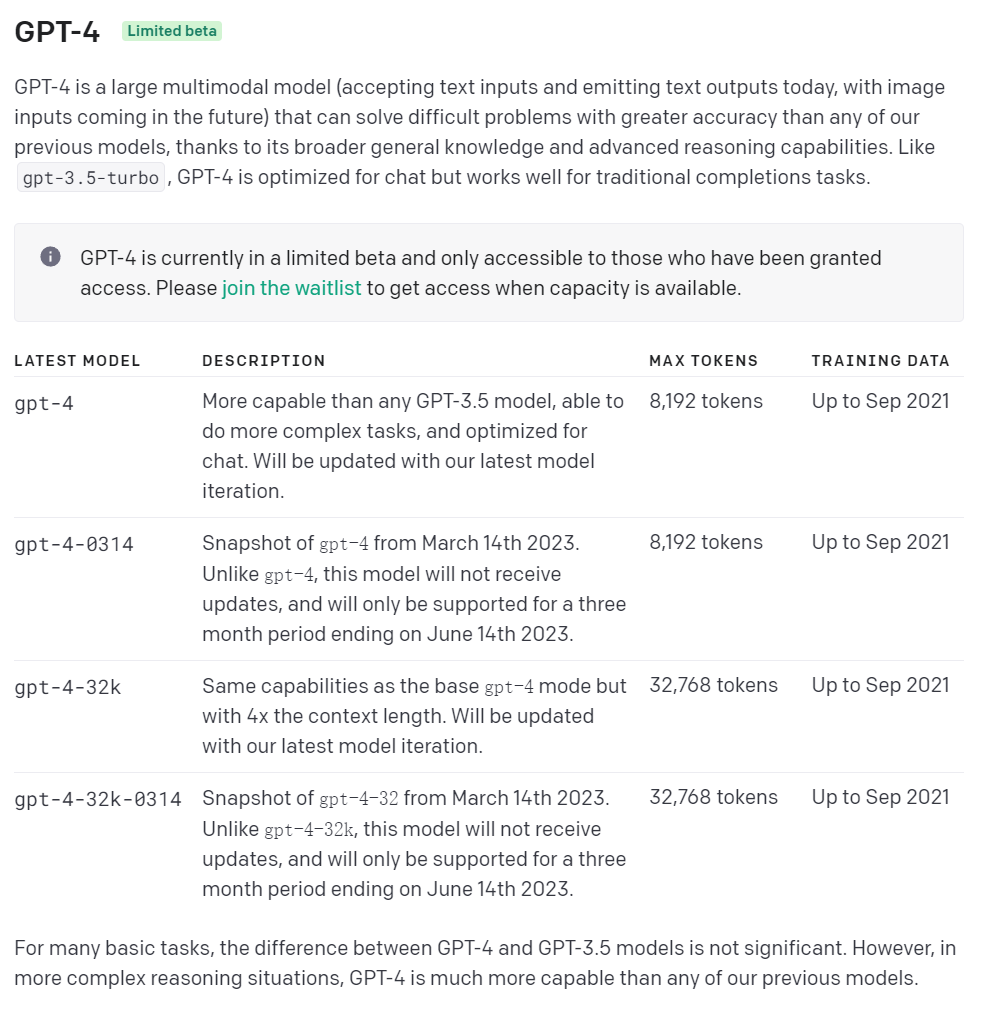

六、GPT-4 API?

- chatGPT-Plus版本用户可以直接预览GPT4

- 提出模型缺陷,就可以得到访问权限