- 1商城前台项目:商品三级分类功能实现_商城怎么实现三级分类页

- 2金航标kinghelm萨科微slkor总经理宋仕强先生,是国务院经济发展中心民营和中小企业研究员

- 3java.lang.IllegalStateException异常:简单分析和简单解决方案

- 4Matlab编程实现图像滤镜效果(浮雕、怀旧色、连环画、羽化、素描、强光等)_matlab浮雕效果

- 5Python函数中,参数前*的作用_python 函数中*

- 6AI辅写疑似度:学校是否会查?七个观点为你解答!_学校会检查论文ai率吗

- 7Android画板控件,可以写字,签名,画画并生成图片_android linearlayout生成图片

- 8【鸿蒙】HarMonyOS的Page Ability生命周期_鸿蒙ability的生命周期回调函数

- 9使用JavaScript实现UTF-8编解码_javascript _utf8_encode

- 10基于RK3399&ESP8285自动售货柜项目—③最终篇-RK3399端实现详解_rk3399 开源项目

机器学习实战之决策树(对Titanic生还者预测)_titanic生还预测项目实战决策分类树

赞

踩

一、数据准备与预处理

数据下载自kaggle

https://www.kaggle.com/c/titanic/data

另外,关于票价和年龄的处理采用如下链接的处理方法(相比于之前课上教的,计算a1+a2/2,…,an-1+an/2,n-1种划分,计算以这些方式划分,比该值小的在左,大的在右,最后计算根据不同值划分的信息增益,取最大值来说,以下方法显然划分的更加细节,不是非0即1。但是原理如何还待研究,这篇文章重点在于决策树)

https://www.kaggle.com/dmilla/introduction-to-decision-trees-titanic-dataset

根据以上代码,可以创建数据集了

返回训练集、测试集(不带生还结果)、验证集(带结果,用来验证准确率)、标签

# 创建训练集、测试集 测试集没有是否生还结果 def createDataSet(): train_data = pandas.read_csv('train.csv') # 读取文件titanic_train数据集 test_data = pandas.read_csv('test.csv') # 读取文件titanic_test数据集 # 使用平均年龄来填充年龄中的 nan 值 train_data['Age'].fillna(train_data['Age'].mean(), inplace=True) test_data['Age'].fillna(test_data['Age'].mean(), inplace=True) # 使用票价的均值填充票价中的 nan 值 train_data['Fare'].fillna(train_data['Fare'].mean(), inplace=True) test_data['Fare'].fillna(test_data['Fare'].mean(), inplace=True) # 用0,1替换male,female train_data.loc[train_data['Sex'] == 'male', 'Sex'] = 0 train_data.loc[train_data['Sex'] == 'female', 'Sex'] = 1 test_data.loc[test_data['Sex'] == 'male', 'Sex'] = 0 test_data.loc[test_data['Sex'] == 'female', 'Sex'] = 1 # 处理票价 train_data.loc[train_data['Fare'] <= 7.91, 'Fare'] = 0 train_data.loc[(train_data['Fare'] > 7.91) & (train_data['Fare'] <= 14.454), 'Fare'] = 1 train_data.loc[(train_data['Fare'] > 14.454) & (train_data['Fare'] <= 31), 'Fare'] = 2 train_data.loc[train_data['Fare'] > 31, 'Fare'] = 4 # 测试集也一并做了 test_data.loc[test_data['Fare'] <= 7.91, 'Fare'] = 0 test_data.loc[(test_data['Fare'] > 7.91) & (test_data['Fare'] <= 14.454), 'Fare'] = 1 test_data.loc[(test_data['Fare'] > 14.454) & (test_data['Fare'] <= 31), 'Fare'] = 2 test_data.loc[test_data['Fare'] > 31, 'Fare'] = 4 # 处理年龄 train_data.loc[train_data['Age'] <= 16, 'Age'] = 0 train_data.loc[(train_data['Age'] > 16) & (train_data['Age'] <= 32), 'Age'] = 1 train_data.loc[(train_data['Age'] > 32) & (train_data['Age'] <= 48), 'Age'] = 2 train_data.loc[(train_data['Age'] > 48) & (train_data['Age'] <= 64), 'Age'] = 3 train_data.loc[train_data['Age'] > 64, 'Age'] = 4 test_data.loc[test_data['Age'] <= 16, 'Age'] = 0 test_data.loc[(test_data['Age'] > 16) & (test_data['Age'] <= 32), 'Age'] = 1 test_data.loc[(test_data['Age'] > 32) & (test_data['Age'] <= 48), 'Age'] = 2 test_data.loc[(test_data['Age'] > 48) & (test_data['Age'] <= 64), 'Age'] = 3 test_data.loc[test_data['Age'] > 64, 'Age'] = 4 # 做标签 labels = ['Pclass', 'Sex', 'Age', 'SibSp', 'Parch', 'Fare'] # 船舱等级、性别、年龄、兄弟姐妹、父母孩子、票价 # 对应特征 features = ['Pclass', 'Sex', 'Age', 'SibSp', 'Parch', 'Fare', 'Survived'] # train_dataSet = train_data['Pclass', 'Sex'] 像这样取一个以上是错误的 train_dataSet = train_data[features] # 只能这样,或者只去一个,如'Pclass' test_dataSet = test_data[labels] # print(train_data['Pclass']) train_dataSet = train_dataSet.values.tolist() test_dataSet = test_dataSet.values.tolist() # print(test_dataSet) temp = train_dataSet train_dataSet = train_dataSet[:500] # 先拿里面的500条作训练 剩下的后面进行比较算准确率 verify_dataSet = temp[500:] # 从下标为[500]的开始拿,即第501项到最后 return train_dataSet, test_dataSet, verify_dataSet, labels

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

到此结束,所有的数据准备已经完成

二、构造决策树

决策树的构造,核心在于计算信息增益或信息增益率或基尼系数,用这三种的其中之一来生成树的节点。在此之前,要做些准备工作。

2.1 一些其他的准备工作

2.1.1 计算香农熵

# 计算香农熵

def calcShannonEnt(dataSet):

numEntires = len(dataSet) # 返回数据集的行数

labelCounts = {} # 保存每个标签(Label)出现次数的字典

for featVec in dataSet: # 对每组特征向量进行统计

currentLabel = featVec[-1] # 提取标签(Label)信息

if currentLabel not in labelCounts.keys(): # 如果标签(Label)没有放入统计次数的字典,添加进去

labelCounts[currentLabel] = 0

labelCounts[currentLabel] += 1 # Label计数

shannonEnt = 0.0 # 经验熵(香农熵)

for key in labelCounts: # 计算香农熵

prob = float(labelCounts[key]) / numEntires # 选择该标签(Label)的概率

shannonEnt -= prob * log(prob, 2) # 利用公式计算

return shannonEnt # 返回经验熵(香农熵)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

2.1.2 创建树及可视化

# 创建决策树 def createTree(dataSet, labels, featLabels): classList = [example[-1] for example in dataSet] # 取分类标签(是否放贷:yes or no) if classList.count(classList[0]) == len(classList): # 如果类别完全相同则停止继续划分 return classList[0] if len(dataSet[0]) == 1 or len(labels) == 0: # 遍历完所有特征时返回出现次数最多的类标签 return majorityCnt(classList) bestFeat = chooseBestFeatureToSplit(dataSet) # 选择最优特征 bestFeatLabel = labels[bestFeat] # 最优特征的标签 featLabels.append(bestFeatLabel) myTree = {bestFeatLabel: {}} # 根据最优特征的标签生成树 del (labels[bestFeat]) # 删除已经使用特征标签 featValues = [example[bestFeat] for example in dataSet] # 得到训练集中所有最优特征的属性值 uniqueVals = set(featValues) # 去掉重复的属性值 for value in uniqueVals: # 遍历特征,创建决策树。 subLabels = labels[:] myTree[bestFeatLabel][value] = createTree(splitDataSet(dataSet, bestFeat, value), subLabels, featLabels) return myTree # 获取叶子节点数目 def getNumLeafs(myTree): numLeafs = 0 # 初始化叶子 firstStr = next(iter( myTree)) # python3中myTree.keys()返回的是dict_keys,不在是list,所以不能使用myTree.keys()[0]的方法获取结点属性,可以使用list(myTree.keys())[0] secondDict = myTree[firstStr] # 获取下一组字典 for key in secondDict.keys(): if type(secondDict[key]).__name__ == 'dict': # 测试该结点是否为字典,如果不是字典,代表此结点为叶子结点 numLeafs += getNumLeafs(secondDict[key]) else: numLeafs += 1 return numLeafs # 获取树的层数(深度) def getTreeDepth(myTree): maxDepth = 0 # 初始化决策树深度 firstStr = next(iter( myTree)) # python3中myTree.keys()返回的是dict_keys,不在是list,所以不能使用myTree.keys()[0]的方法获取结点属性,可以使用list(myTree.keys())[0] secondDict = myTree[firstStr] # 获取下一个字典 for key in secondDict.keys(): if type(secondDict[key]).__name__ == 'dict': # 测试该结点是否为字典,如果不是字典,代表此结点为叶子结点 thisDepth = 1 + getTreeDepth(secondDict[key]) else: thisDepth = 1 if thisDepth > maxDepth: maxDepth = thisDepth # 更新层数 return maxDepth # 绘制节点 def plotNode(nodeTxt, centerPt, parentPt, nodeType): arrow_args = dict(arrowstyle="<-") # 定义箭头格式 font = FontProperties(fname=r"C:\Windows\Fonts\simfang.ttf", size=14) # 设置中文字体 createPlot.ax1.annotate(nodeTxt, xy=parentPt, xycoords='axes fraction', # 绘制结点 xytext=centerPt, textcoords='axes fraction', va="center", ha="center", bbox=nodeType, arrowprops=arrow_args, FontProperties=font) # 标注有向边属性值 def plotMidText(cntrPt, parentPt, txtString): xMid = (parentPt[0] - cntrPt[0]) / 2.0 + cntrPt[0] # 计算标注位置 yMid = (parentPt[1] - cntrPt[1]) / 2.0 + cntrPt[1] createPlot.ax1.text(xMid, yMid, txtString, va="center", ha="center", rotation=30) # 绘制决策树 def plotTree(myTree, parentPt, nodeTxt): decisionNode = dict(boxstyle="sawtooth", fc="0.8") # 设置结点格式 leafNode = dict(boxstyle="round4", fc="0.8") # 设置叶结点格式 numLeafs = getNumLeafs(myTree) # 获取决策树叶结点数目,决定了树的宽度 depth = getTreeDepth(myTree) # 获取决策树层数 firstStr = next(iter(myTree)) # 下个字典 cntrPt = (plotTree.xOff + (1.0 + float(numLeafs)) / 2.0 / plotTree.totalW, plotTree.yOff) # 中心位置 plotMidText(cntrPt, parentPt, nodeTxt) # 标注有向边属性值 plotNode(firstStr, cntrPt, parentPt, decisionNode) # 绘制结点 secondDict = myTree[firstStr] # 下一个字典,也就是继续绘制子结点 plotTree.yOff = plotTree.yOff - 1.0 / plotTree.totalD # y偏移 for key in secondDict.keys(): if type(secondDict[key]).__name__ == 'dict': # 测试该结点是否为字典,如果不是字典,代表此结点为叶子结点 plotTree(secondDict[key], cntrPt, str(key)) # 不是叶结点,递归调用继续绘制 else: # 如果是叶结点,绘制叶结点,并标注有向边属性值 plotTree.xOff = plotTree.xOff + 1.0 / plotTree.totalW plotNode(secondDict[key], (plotTree.xOff, plotTree.yOff), cntrPt, leafNode) plotMidText((plotTree.xOff, plotTree.yOff), cntrPt, str(key)) plotTree.yOff = plotTree.yOff + 1.0 / plotTree.totalD # 创建绘制面板 def createPlot(inTree): fig = plt.figure(1, facecolor='white') # 创建fig fig.clf() # 清空fig axprops = dict(xticks=[], yticks=[]) createPlot.ax1 = plt.subplot(111, frameon=False, **axprops) # 去掉x、y轴 plotTree.totalW = float(getNumLeafs(inTree)) # 获取决策树叶结点数目 plotTree.totalD = float(getTreeDepth(inTree)) # 获取决策树层数 plotTree.xOff = -0.5 / plotTree.totalW; plotTree.yOff = 1.0; # x偏移 plotTree(inTree, (0.5, 1.0), '') # 绘制决策树 plt.show() # 显示绘制结果

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

- 88

- 89

- 90

- 91

- 92

- 93

- 94

- 95

- 96

- 97

- 98

- 99

- 100

2.1.3 其他

一些其他的代码:

# 按照给定特征划分数据集 # 比如axis=0,value=1,那么返回的就是删除了axis这一列,并且留下的是对应0列的值为1的其他行 def splitDataSet(dataSet, axis, value): retDataSet = [] # 创建返回的数据集列表 for featVec in dataSet: # 遍历数据集 if featVec[axis] == value: reducedFeatVec = featVec[:axis] # 去掉axis特征 reducedFeatVec.extend(featVec[axis + 1:]) # 将符合条件的添加到返回的数据集 retDataSet.append(reducedFeatVec) return retDataSet # 返回划分后的数据集 # 函数说明:统计classList中出现此处最多的元素(类标签) def majorityCnt(classList): classCount = {} for vote in classList: # 统计classList中每个元素出现的次数 if vote not in classCount.keys(): classCount[vote] = 0 classCount[vote] += 1 sortedClassCount = sorted(classCount.items(), key=operator.itemgetter(1), reverse=True) # 根据字典的值降序排序 return sortedClassCount[0][0] # 返回classList中出现次数最多的元素

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

最后的使用:输入数据进行分类,返回是否生存

此段参考博客:https://blog.csdn.net/theworld666/article/details/120981481?utm_source=app&app_version=4.16.0&code=app_1562916241&uLinkId=usr1mkqgl919blen

感谢大佬的帮助

# 使用决策树分类 # 运用决策树进行分类 def classify(inputTrees, featLabels, testVec): firstStr = list(inputTrees.keys())[0] secondDict = inputTrees[firstStr] featIndex = featLabels.index(firstStr) # 寻找决策属性在输入向量中的位置 classLabel = -1 # -1是作为flag值 for key in secondDict.keys(): if testVec[featIndex] == key: # 如果对应位置的值与键值相等 if type(secondDict[key]).__name__ == 'dict': # 继续递归查找 classLabel = classify(secondDict[key], featLabels, testVec) else: classLabel = secondDict[key] # 查找到子节点则返回子节点的标签 # 标记classLabel为-1当循环过后若仍然为-1,表示未找到该数据对应的节点则我们返回他兄弟节点出现次数最多的类别 return getLeafBestCls(inputTrees) if classLabel == -1 else classLabel # 求该节点下所有叶子节点的列表 def getLeafscls(myTree, clsList): numLeafs = 0 firstStr = list(myTree.keys())[0] secondDict = myTree[firstStr] for key in secondDict.keys(): if type(secondDict[key]).__name__ == 'dict': clsList = getLeafscls(secondDict[key], clsList) else: clsList.append(secondDict[key]) return clsList # 返回出现次数最多的类别 def getLeafBestCls(myTree): clsList = [] resultList = getLeafscls(myTree, clsList) return max(resultList, key=resultList.count)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

至此,所有的准备工作均已完成

2.2 根据信息增益构造决策树

2.2.1 概念

2.2.2 代码

# 信息增益 def chooseBestFeatureToSplit1(dataSet): numFeatures = len(dataSet[0]) - 1 # 特征数量 baseEntropy = calcShannonEnt(dataSet) # 计算数据集的香农熵 bestInfoGain = 0.0 # 信息增益 bestFeature = -1 # 最优特征的索引值 for i in range(numFeatures): # 遍历所有特征 # 获取dataSet的第i个所有特征 featList = [example[i] for example in dataSet] uniqueVals = set(featList) # 创建set集合{},元素不可重复 newEntropy = 0.0 # 经验条件熵 for value in uniqueVals: # 计算信息增益 subDataSet = splitDataSet(dataSet, i, value) # subDataSet划分后的子集 prob = len(subDataSet) / float(len(dataSet)) # 计算子集的概率 newEntropy += prob * calcShannonEnt(subDataSet) # 根据公式计算经验条件熵 infoGain = baseEntropy - newEntropy # 信息增益 # print("第%d个特征的增益为%.3f" % (i, infoGain)) #打印每个特征的信息增益 if (infoGain > bestInfoGain): # 计算信息增益 bestInfoGain = infoGain # 更新信息增益,找到最大的信息增益 bestFeature = i # 记录信息增益最大的特征的索引值 return bestFeature # 返回信息增益最大的特征的索引值

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

2.2.3 结果

生成的决策树可视化如下:

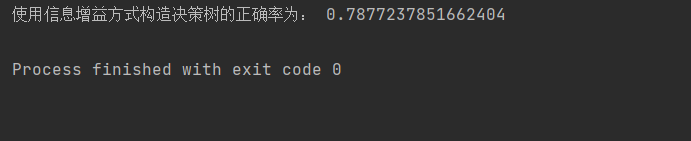

最后通过验证集验证,得到正确率:

if __name__ == '__main__': train, test, verify, labels = createDataSet() featLabels = [] myTree = createTree(train, labels, featLabels) # print(featLabels) featLabels = ['Pclass', 'Sex', 'Age', 'SibSp', 'Parch', 'Fare'] # print(labels) # createPlot(myTree) error = 0 for l in verify: vec = l[:6] # print(vec) result = classify(myTree, featLabels, vec) if l[-1] != result: error += 1 err_rate = error / len(verify) print('使用信息增益方式构造决策树的正确率为:', 1-err_rate)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

2.3 使用信息增益率方式构造决策树

2.3.1 概念

2.3.2 代码

# 信息增益率 def chooseBestFeatureToSplit2(dataSet): numFeatures = len(dataSet[0]) - 1 # 特征数量 baseEntropy = calcShannonEnt(dataSet) # 计算数据集的香农熵 bestInfoGainRate = 0.0 # 信息增益率 bestFeature = -1 # 最优特征的索引值 for i in range(numFeatures): # 遍历所有特征 # 获取dataSet的第i个所有特征 featList = [example[i] for example in dataSet] uniqueVals = set(featList) # 创建set集合{},元素不可重复 newEntropy = 0.0 # 经验条件熵 IV = 0.0 for value in uniqueVals: # 计算信息增益 subDataSet = splitDataSet(dataSet, i, value) # subDataSet划分后的子集 prob = len(subDataSet) / float(len(dataSet)) # 计算子集的概率 newEntropy += prob * calcShannonEnt(subDataSet) # 根据公式计算经验条件熵 IV -= prob * log(prob, 2) # 计算IV infoGain = baseEntropy - newEntropy # 信息增益 if IV == 0: return 0 # IV为0,直接返回0 infoGainRate = infoGain/IV # 信息增益率 # print("第%d个特征的增益为%.3f" % (i, infoGain)) #打印每个特征的信息增益 # print(i, IV) # print(infoGainRate) if infoGainRate > bestInfoGainRate: # 计算信息增益率 bestInfoGainRate = infoGainRate # 更新信息增益率,找到最大的信息增益率 bestFeature = i # 记录信息增益率最大的特征的索引值 return bestFeature # 返回信息增益率最大的特征的索引值

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

2.3.3 结果

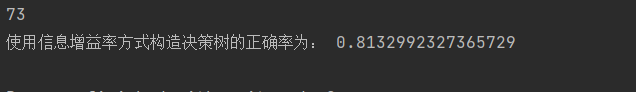

决策树可视化结果如下:

验证集验证计算正确率:

if __name__ == '__main__': train, test, verify, labels = createDataSet() featLabels = [] myTree = createTree(train, labels, featLabels) # print(featLabels) featLabels = ['Pclass', 'Sex', 'Age', 'SibSp', 'Parch', 'Fare'] # print(labels) createPlot(myTree) error = 0 for l in verify: vec = l[:6] # print(vec) result = classify(myTree, featLabels, vec) if l[-1] != result: error += 1 err_rate = error / len(verify) print(error) print('使用信息增益率方式构造决策树的正确率为:', 1-err_rate)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

相比较用信息增益的方法,这个方法能降低错误数提高准确率

2.4 基尼系数

2.4.1 概念

2.4.2 代码

# 基尼系数 def chooseBestFeatureToSplit3(dataSet): numFeatures = len(dataSet[0]) - 1 # 特征数量 bestGini = 100 bestFeature = -1 # 最优特征的索引值 for i in range(numFeatures): # 遍历所有特征 gini = 0 # 在第i个特征中的基尼系数 # 获取dataSet的第i个所有特征 featList = [example[i] for example in dataSet] uniqueVals = set(featList) # 创建set集合{},元素不可重复 for value in uniqueVals: # 计算在第i个特征中某个特征值基尼系数 gini0 = 1 # print(i, value, gini0) subDataSet = splitDataSet(dataSet, i, value) # subDataSet划分后的子集 # print(i,value,subDataSet) cnt = 0 for j in subDataSet: # 计算正例出现次数 if j[-1] == 1: cnt += 1 prob = cnt/len(subDataSet) # 该特征中该属性的正例概率 gini0 -= prob*prob+(1-prob)*(1-prob) # print(i,value,gini0) gini += prob * gini0 # 这样就得到了在第i个特征中的基尼系数 if gini < bestGini: # 如果第i个特征的基尼系数最小,那么让他成为最好的 bestGini = gini bestFeature = i return bestFeature

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

2.4.3 结果

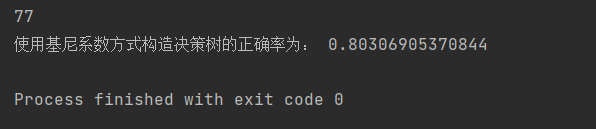

生成的树可视化结果如下:

验证集验证计算正确率:

if __name__ == '__main__': train, test, verify, labels = createDataSet() featLabels = [] myTree = createTree(train, labels, featLabels) # print(featLabels) featLabels = ['Pclass', 'Sex', 'Age', 'SibSp', 'Parch', 'Fare'] # print(labels) createPlot(myTree) error = 0 for l in verify: vec = l[:6] # print(vec) result = classify(myTree, featLabels, vec) if l[-1] != result: error += 1 err_rate = error / len(verify) print(error) print('使用基尼系数方式构造决策树的正确率为:', 1-err_rate)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

三、总结

经过这次决策树实例的实站,首先受益匪浅的是更加了解python这一语言的使用,其次是深入理解了熵的含义与决策树构造三种方式(信息增益、信息增益率、基尼系数)的构造过程,将课上的理论与代码的实践糅合在一起。还学会了利用python中的字典构造树,这是和以前c语言利用构造树完全不一样的过程。但是决策树可视化这个过程我还没有研究的很透彻明白,将会在以后的实践继续学习。