热门标签

热门文章

- 1python抓取招聘信息_sojob

- 2Docker在Linux上的安装(CentOS7)_linux centos 如何安装docker

- 3CRC校验码详解、常见算法实现及代码实例

- 4[ vscode + clangd + gcc + gdb + cmake] 一文带你构造C/C++开发环境 #支持嵌入式开发 #超详细 #小白_vscode+gcc

- 5java集成ELK(日志工具)的知识点总结_java继承elk

- 62020年总结:Java999道高频真题面试宝典+一个月Java核心技术突击,稳步大厂

- 7HEIC格式转换为jpg(C#)_c# heic

- 8安卓判断是否是模拟器,适配主流雷电,MUMU,夜神,逍遥_游戏检测安卓模拟器

- 9开发语言怎么选? 别急!深度了解【2024年全球排行榜TOP20编程语言榜单排名的特点、难易程度、跨平台性、适用领域】是什么,能干嘛?重点不是语言的新旧,是否热门语言,而是找到适合自己的技术栈!_开发语言排名

- 10git查看所有远程分支、本地分支、创建分支_git 查看远程分支

当前位置: article > 正文

自主部署和运行大语言模型Llama3的5种方法_llama3部署

作者:我家小花儿 | 2024-08-01 16:10:15

赞

踩

llama3部署

Meta 最近发布了Llama 3,这是其开源大型语言模型(LLM)的最新和最强大的版本。Llama3包括两个版本:Llama 3 8B(含80亿个参数)和 Llama 3 70B(含700亿个参数),这两个版本都有基础和指令调整变体。

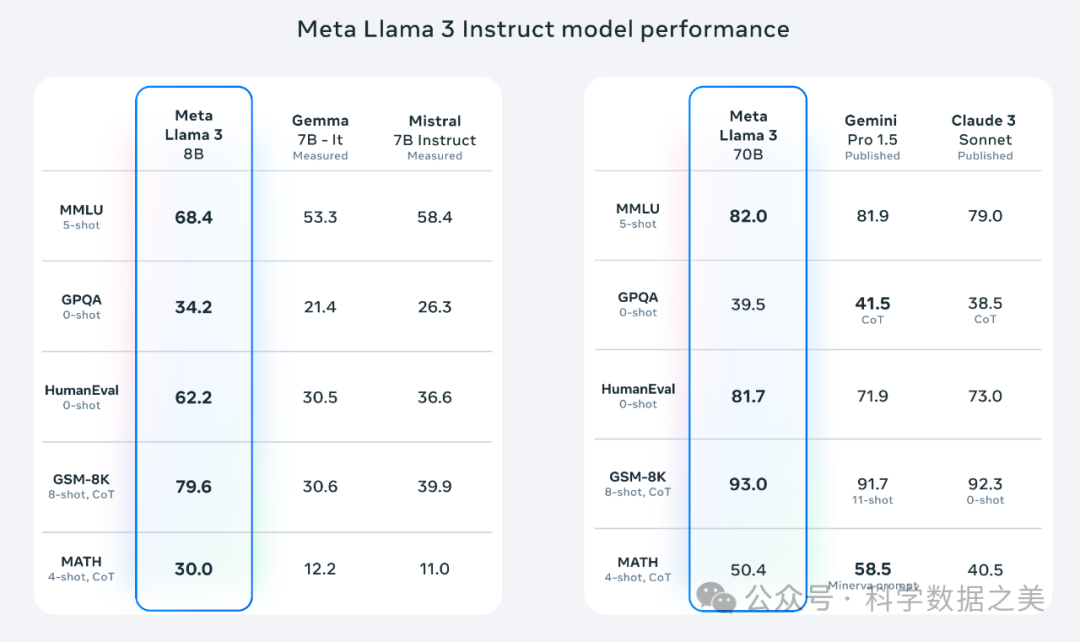

与Llama 2相比,Llama 3模型降低了错误拒绝率,提供了双倍的上下文长度,具有 8K 标记上下文窗口。Llama 3 模型的训练数据比 Llama 2 多出约 8 倍,在24000个GPU卡上,使用了超过 15 万亿个token的新的公开在线数据组合。HumanEval的大模型代码能力评测对比结果中,作为开源模型的Llama3得分为81.7分,高于闭源商业模型Gemini Pro 1.5(71.9分)和Claude 3 Sonnet(73分),低于Claude 3 Opus (84.9分) 和GPT4 Turbo (85.7分)。

本文介绍5种安装和运行Llama3的方法,供参考。

- 使用Web浏览器部署和运行模型

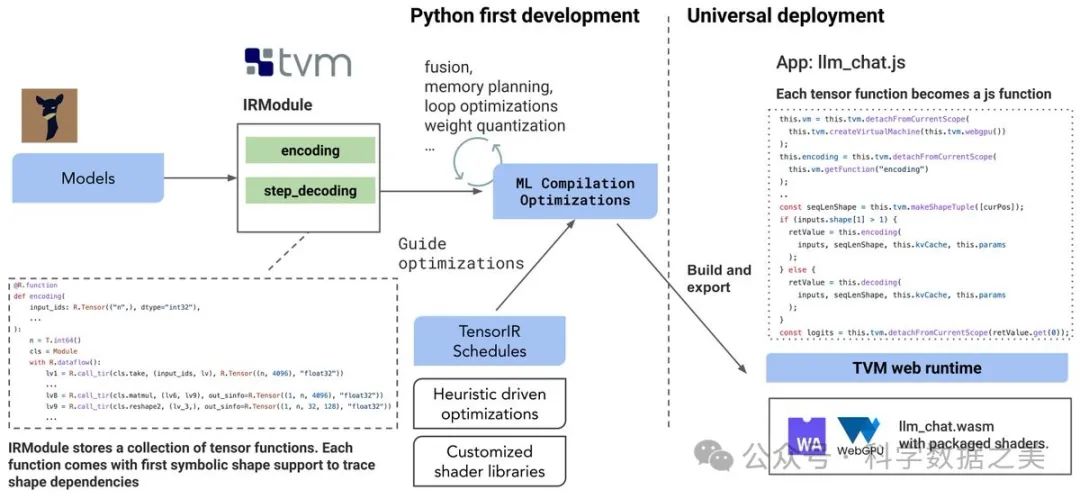

该方法使用WebGPU技术在Web浏览器运行模型,不需要网络和服务器端支持。

- WebLLM

这是一个使用WebGPU和WebAssembly等技术的项目,能够完全在浏览器中运行大语言模型和大语言模型应用程序。WebLLM 是一个模块化和可定制的 javascript 软件包,可直接将语言模型聊天直接带入Web浏览器,并进行硬件加速。一切都在浏览器内运行,无需服务器支持,并通过 WebGPU 加速。同时还支持在手机上运行模型。

Demo: https://mlc.ai/mlc-llm/

WebLLM技术架构

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/我家小花儿/article/detail/914884

推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。