- 1JS基础——模拟短信发送对话_模拟短信对话

- 2AI在招聘领域的这些应用,你都知道几个?_hr 生成式ai 应用

- 3python爬取豆瓣电影top250_Python爬虫——爬取豆瓣电影Top250代码实例

- 4bert预测被掩住的字_bert中的掩蔽词预测

- 52024年Python最全13 个Python开发者必知的Python GUI库

- 6自然语言处理中注意力机制综述

- 7【Unity3D开发小游戏】《植物大战僵尸游戏》Unity开发教程_unity植物大战僵尸

- 8分布式系列之分布式锁_分布式锁释放锁时宕机

- 9在wind7中运行启动hadoop出现错误 java.lang.UnsatisfiedLinkError_jvm.jvmmetrics (jvmmetrics.java:init(76)) - initia

- 10Python(十五)读取Excel_python 读excel 遍历

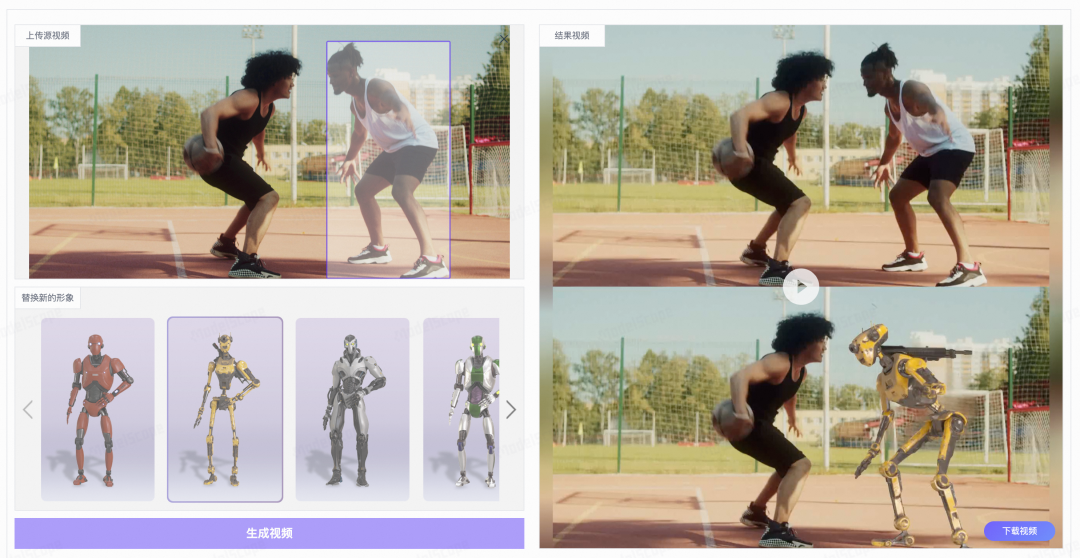

很多朋友向我咨询“机器人打篮球的视频”是如何制作的?我整理了一个教程,免费分享给大家...

赞

踩

废话不多说,先看效果:

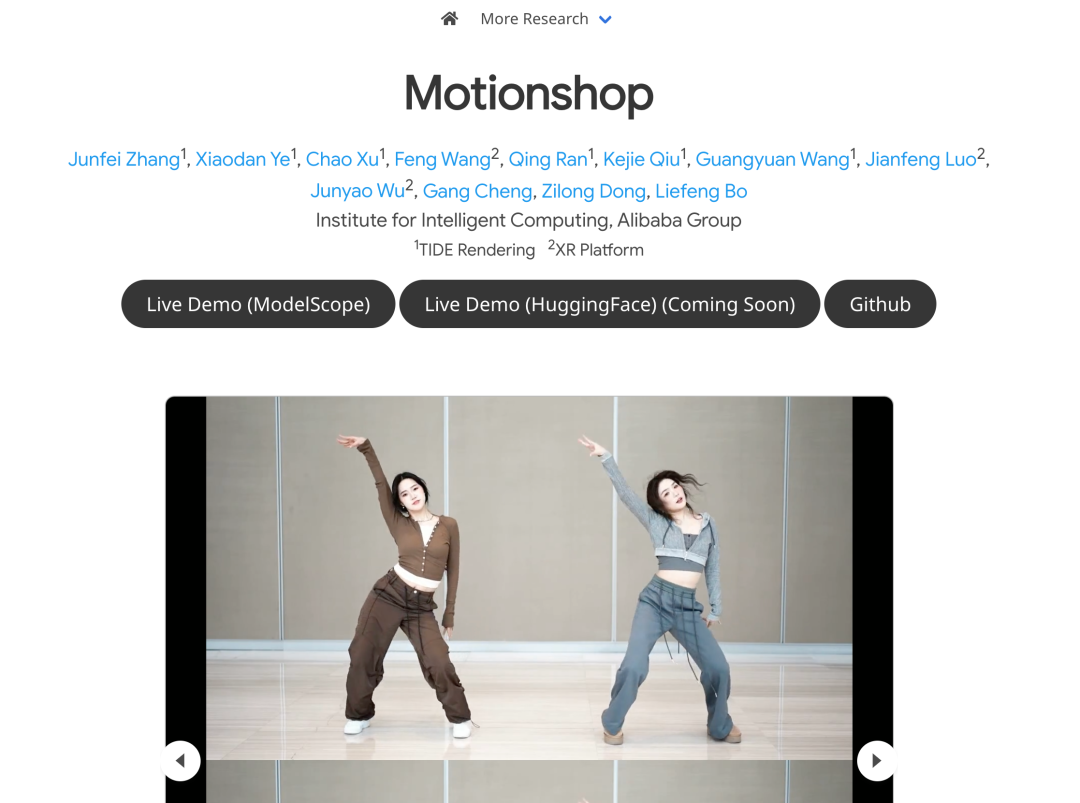

使用工具 Motionshop

Motionshop 是阿里巴巴智能计算研究院(XR 实验室和 TIDE 三维渲染团队)推出的一个AI角色动画框架,可将视频中的人物角色替换为 3D 化身,同时不改变视频中的其他场景和人物。该框架利用视频处理、角色检测/分割/追踪、姿态分析、模型提取和动画渲染等多种技术,使得动态视频中的主角能够轻松跨越现实与虚拟的界限,一键变身为有趣的 3D 角色模型。

网址:https://aigc3d.github.io/motionshop/

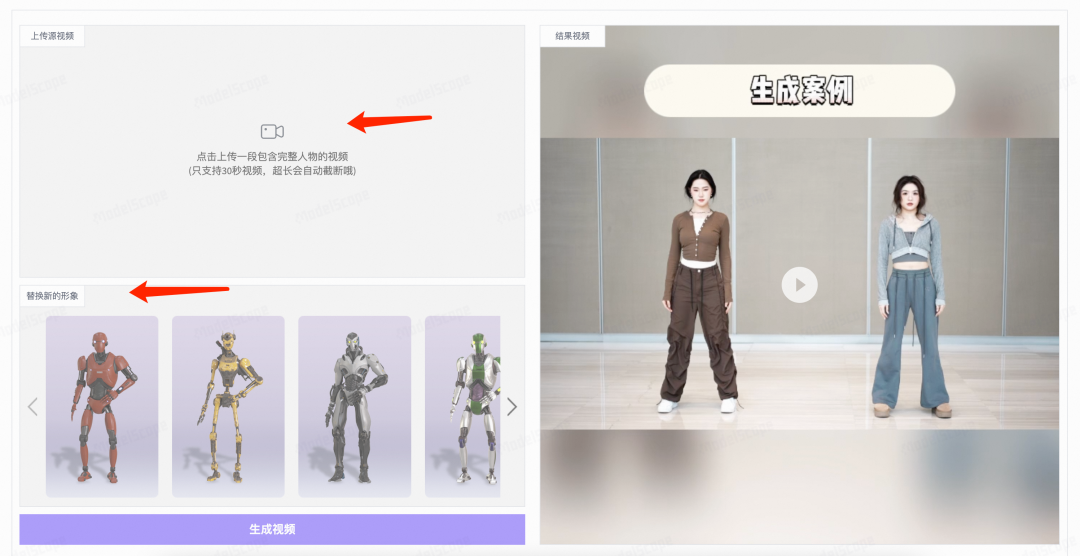

AI 替换视频人物

网址:https://modelscope.cn/studios/Damo_XR_Lab/motionshop/summary

上传视频

点击右侧「下载视频」,就可以下载使用了。

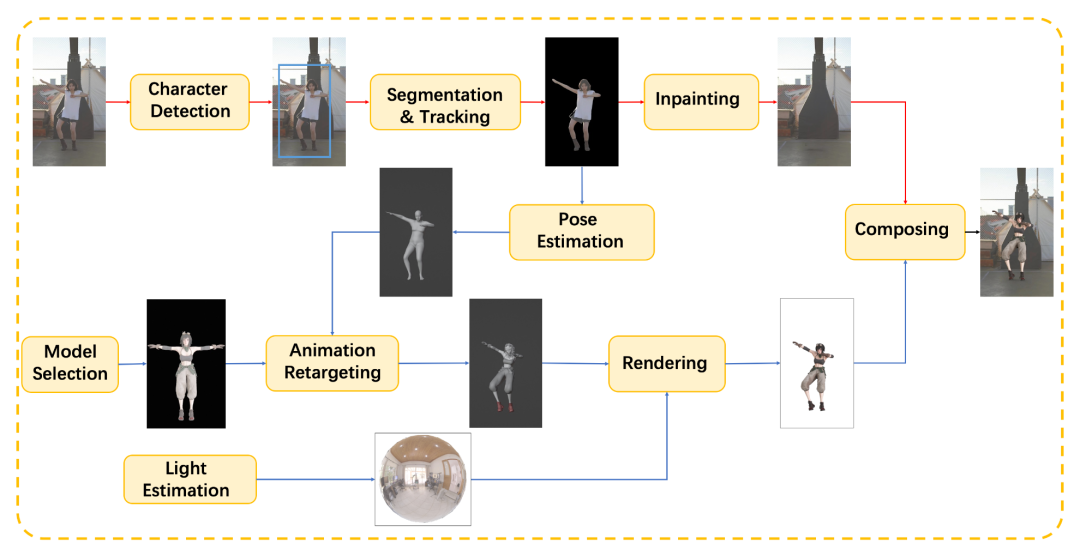

工作原理

Motionshop 框架由两部分构成,一个是用于提取修复背景视频序列的视频处理流程,另一个是用于生成 3D 虚拟角色视频序列的姿态估计和渲染流程。

通过并行两条线并使用高性能光线追踪渲染器 TIDE,整个视频替换过程可以在几分钟内完成。

一、角色检测

通过将文本信息与现有的闭合式检测器使用基于 Transformer 的框架紧密融合,零样本目标检测也可以表现良好。感兴趣的目标候选项通过开放式目标检测方法进行检测,随后采用支配选择方法确定最终目标区域。

二、分割和跟踪

一旦成功检测到目标,像素级的目标区域将通过视频对象分割跟踪方法进行跟踪,该方法由广泛使用的零样本分割方法 "segment anything model (SAM)" 初始化和细化。与直接使用 SAM 相比,时间对应性得到提升,以更好地处理视频分割任务。

三、修复

其余图像区域通过视频修复来完成。具体而言,采用循环流完成来恢复受损的流场,同时在图像和特征领域上采用双域传播来增强全局和局部的时间一致性,此外,只考虑子集的稀疏策略可以提高效率和减少内存消耗,同时保持性能。

四、姿势估计

给定角色视频序列,应用姿势估计方法 CVFFS 来估计稳定的人体姿态。SMPL 人体模型用于表示 3D 人体,这是一种广泛使用的人体形状和姿态估计参数模型。

五、动画重定位

将估计的形状和姿势映射到所选的 3D 模型上。然后,该模型可以像原始视频中的角色一样自然顺滑地播放。即使原始角色和新模型之间存在显着差异,也可以获得令人满意的结果。

六、光照估计

当新的 3D 模型替换感兴趣的角色时,需要与原始视频保持一致的照明条件。我们应用光照估计来更好地整合新的 3D 模型和原始场景。在未来,我们还将使用光照估计进行阴影处理。

七、渲染

采用路径跟踪渲染引擎 TIDE 来渲染新的 3D 模型。它配备精确的材料系统,辅以诸如动态模糊、时间反锯齿和时间降噪等算法。该引擎将光线追踪技术和速度结合在一起,为用户更高效地获得视频打下了坚实的基础。

八、合成

最后,经过渲染的图像与原始视频合成,生成最终的视频。

大家赶紧尝试用起来吧,更多有趣视频,欢迎关注我的视频号。

加我微信,可以领取一份优质 AI 知识库资料。

持续分享 AGI、大模型、转型副业,个人 GitHub 9K+ Star,欢迎关注。