热门标签

热门文章

- 1有向有环图两点间路径问题

- 2Air780e模块在linux设备上的RNDIS网卡使用_air780e linux 应用

- 3TCP协议中的三次握手法_tcp三次握手的通信方式

- 4依存分析 Dependency Parsing

- 5Java Swing + MySQL 学生选课管理系统(数据库结课作业)附带源码+文档_毕业选题管理系统源码swing

- 6Xshell+WinSCP在Linux上安装jdk_winscp怎么解压jdk

- 7图书馆定位导航:RFID、VR与AR技术在图书馆中的应用

- 8门控循环单元(GRU)及其预测和分类Python实现

- 9二十三、Hadoop的HA(高可用)_hadoop中什么是ha

- 10(详细)Hibernate框架的搭建,Hibernate的CRUD操作(一)_hibernate框架及环境搭建 使用hibernatetemplate完成curd 实验报告

当前位置: article > 正文

springboot集成kafka的相关配置及自定义_spring kafka producer bootstrap-servers

作者:正经夜光杯 | 2024-07-23 14:34:30

赞

踩

spring kafka producer bootstrap-servers

之前的文章末尾,简单的实现了springboot集成kafka,完成了简单的测试,今天我们来扩展一下相关内容。

首先详解一下配置文件的内容:

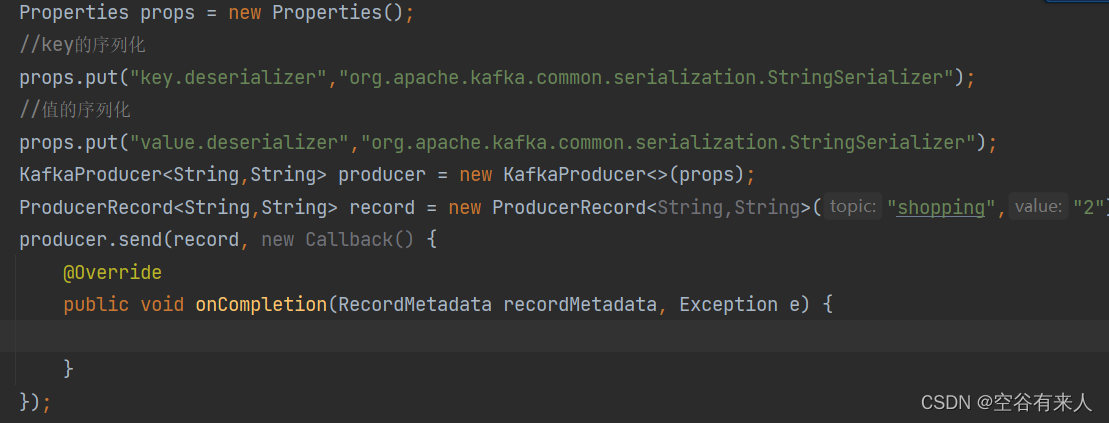

以上的producer和consumer的相关配置也可以在java文件中实现:

如上图的实现,自己可以手动实现一下。

kafka内部自己实现分区、策略等一系列的逻辑,当然这些也可以自定义,这里有需要的可以自己研究一下,我这里就不需要了。

接下来,我介绍一个场景,是大家在实际的项目中可以用到。有这样一个场景,在项目中,我们搭建了kafka集群,然而在环境中,会有各种不同的消息,有一些消息不是我们需要的,有些消息是我们需要的,这时我们可以通过过滤器来进行控制和过滤。

在生产者端,我添加一个过滤器在消息前统一加上一个前缀。

- @Slf4j

- public class ProducerPrefixInterceptor implements ProducerInterceptor<String,String> {

-

- AtomicInteger success = new AtomicInteger(0);

- AtomicInteger fail = new AtomicInteger(0);

-

- @Override

- public ProducerRecord<String, String> onSend(ProducerRecord<String, String> producerRecord) {

- // 消息统一添加前缀

- String modifyValue = "prefix-"+producerRecord.value();

- return new ProducerRecord<>(producerRecord.topic(), producerRecord.partition(), producerRecord.timestamp(), producerRecord.key(), modifyValue, producerRecord.headers());

- }

-

- @Override

- public void onAcknowledgement(RecordMetadata recordMetadata, Exception e) {

- if (Objects.nonNull(recordMetadata)){

- success.incrementAndGet();

- }else {

- fail.incrementAndGet();

- }

- }

-

- @Override

- public void close() {

- log.info("success:%d\nfail:%d\n",success.get(),fail.get());

- success.set(0);

- fail.set(0);

- }

-

- @Override

- public void configure(Map<String, ?> map) {

-

- }

- }

然后在消费者消费时,我遇到prefix前缀的消息时,就统一过滤掉,这不是我所需要的消息。

- @Slf4j

- public class ConsumerPrefixInterceptor implements ConsumerInterceptor<String,String> {

-

- /**

- * 过滤掉test开头的数据

- * @param consumerRecords

- * @return

- */

- @Override

- public ConsumerRecords<String, String> onConsume(ConsumerRecords<String, String> consumerRecords) {

- List<ConsumerRecord<String, String>> filterRecords = new ArrayList<>();

- Map<TopicPartition, List<ConsumerRecord<String, String>>> newRecords= new HashMap<>();

- Set<TopicPartition> partitions = consumerRecords.partitions();

- for(TopicPartition tp : partitions){

- List<ConsumerRecord<String, String>> records = consumerRecords.records(tp);

- for(ConsumerRecord<String, String> record: records){

- if(!record.value().startsWith("prefix")) {

- filterRecords.add(record);

- }

- }

- if(filterRecords.size() > 0){

- newRecords.put(tp, filterRecords);

- }

- }

- return new ConsumerRecords<>(newRecords);

- }

-

- @Override

- public void onCommit(Map<TopicPartition, OffsetAndMetadata> map) {

- map.forEach((k,v) -> log.info("tp:%s--offset:%s\n",k,v));

- }

-

- @Override

- public void close() {

-

- }

-

- @Override

- public void configure(Map<String, ?> map) {

-

- }

- }

相关的配置在上述的配置文件中也已经列出了,也可以在代码中加以配置。

props.put("properties.interceptor.classes","com.volga.kafka.interceptor.ProducerPrefixInterceptor");这样就能实现过滤不需要的消息了。

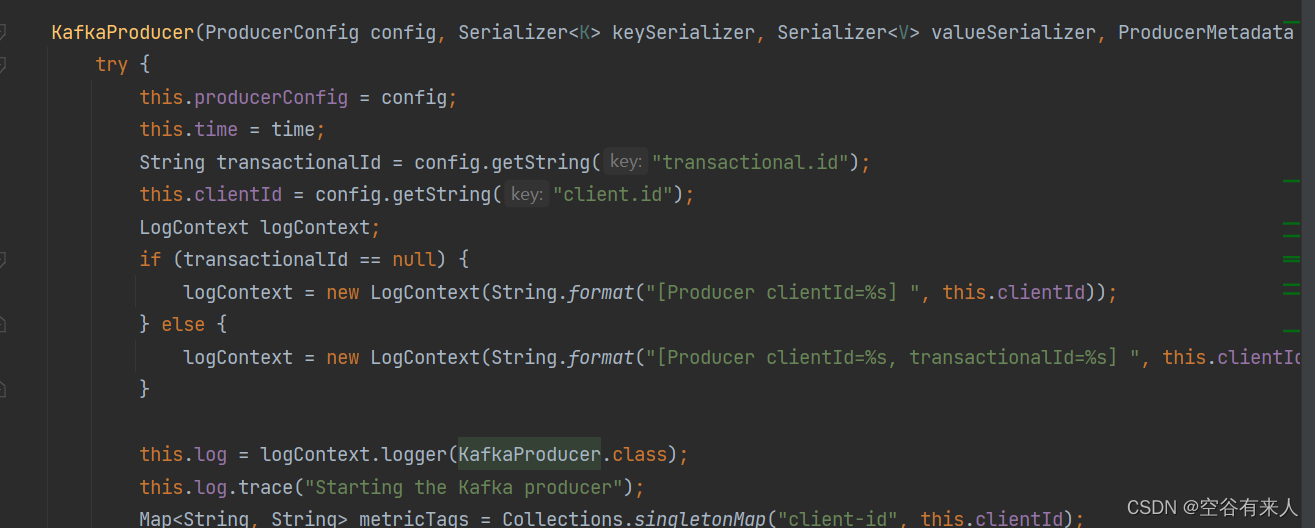

翻看源码中,生产端主要是KafkaProducer<k,v>这个类中KafkaProducer方法:

消费端这边是对应的:KafkaConsumer<k,v>,这个类中KafkaConsumer方法:

源码里kafka实现的配置逻辑大家可以仔细研究一下。

我是空谷有来人,谢谢支持!

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/正经夜光杯/article/detail/870308

推荐阅读

相关标签