- 1真正理解nodeJS,nodejs是什么,深入理解node_node 和nodejs

- 2Redis运维实战之客户端连接_redis客户端连接

- 3open3D源码解读第三篇_open3d mahalanobis distance

- 4高效程序员的45个习惯:敏捷开发修炼之道 - 读后感_习惯敏。

- 5Ubuntu 12.04安装完全指南_smsl目录

- 6鸿蒙4.2小版本推出,鸿蒙5.0已经不远了_鸿蒙4.2不如4.0

- 7vue3加ts构建项目步骤_vue3+ts写新项目教程

- 8一百三十九、Kettle——Linux安装Kettle8.2

- 9windows安装最新版Mysql8.0.27_mysql8.0.27驱动

- 10机器学习,深度学习的资料和工具库大全_10-715cmu

Llama 3.1磁力链提前泄露!开源模型王座一夜易主,GPT-4o被超越

赞

踩

【导读】Llama 3.1又被提前泄露了!开发者社区再次陷入狂欢:最大模型是405B,8B和70B模型也同时升级,模型大小约820GB。基准测试结果惊人,磁力链全网疯转。

历史再次重演,Llama 3.1 405B提前泄露了!

现在,基准测试和磁力链已经传得满天飞了。

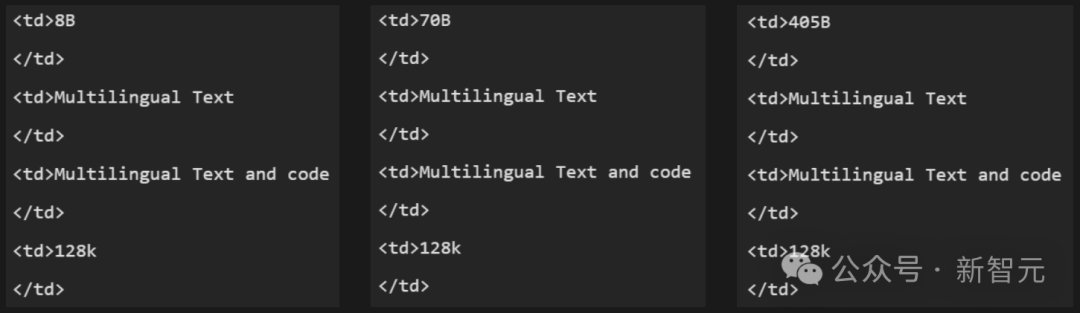

除了最大的405B,Meta这次还升级了5月初发布的8B和70B模型,并将上下文长度全部提升到了128K。

至此,模型版本也正式从Llama 3迭代到了Llama 3.1。

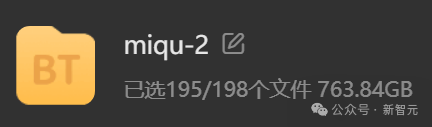

根据磁力链提供的信息,新模型大小为763.48GiB(约820GB)。

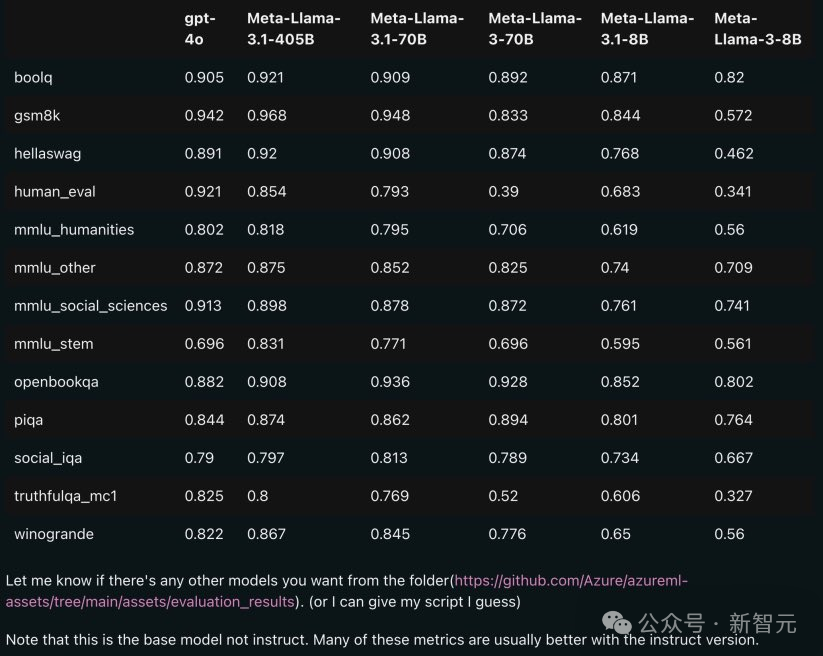

从泄露的「基准测试」可以看出,连8B小模型都很能打,而70B的模型,性能在多项基准上都能赶超GPT-4o了。

开发者们看到测试结果后也原地炸锅,Topology CEO Aidan McLau惊呼道——

如果Llama 3-405B的基准测试是真的,它将

- 成为世界上最好的模型

- 每个人都可调

- 比GPT-4o还便宜!

HyperWriteAI CEO Matt Schumer预言:它定将成为开源模型中的SOTA。(连70B都能和GPT-4o掰手腕,何况这还是在指令微调之前。)

想象一下,一个GPT-4o级别的模型,以每秒330个token的速度运行,价格还要便宜10倍。这简直太令人兴奋了。

明天,将是狂野的一天!

而小扎的一句话,更是暗示着405B的到来——重大一周前的宁静时刻。

众多网友在线逼问OpenAI:新模型啥时候放出?

Llama 3.1家族,明日上线

根据泄露的模型卡,Llama 3.1将在23日发布。

![]()

许可证为「定制商业许可」和「Llama 3.1社区许可」。

泄露的Model Card:https://pastebin.com/9jGkYbXY

具体来说,多语言大模型 Llama 3.1系列是一组预训练和指令微调的生成模型,包括8B、70B和405B三种参数规模。

指令微调后的Llama 3.1纯文本模型(8B、70B、405B),针对多语言对话用例进行了优化。

除了英语,它还可以支持7种语言,包括德语、法语、意大利语、葡萄牙语、印地语、西班牙语和泰语。

据介绍,Llama 3.1的新增能力包括,更长的上下文、支持多语言输入和输出,以及开发者与第三方工具的集成。

基准测试

在GitHub上一张基准图(现404)显示,Llama 3.1在基准测试中的优异表现。

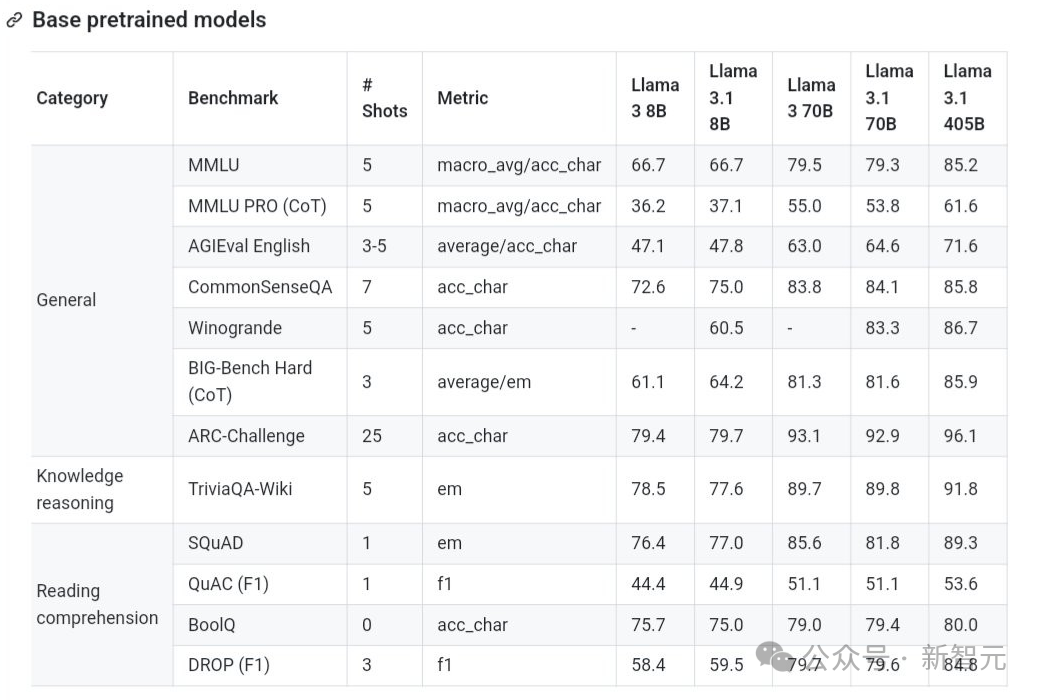

具体来说,在基准预训练模型的基准评测中,Llama 3.1 405B在通用任务、知识推理、阅读理解上创下最新纪录。

尤其在,MMLU、SQuAD细分基准上,提升最为明显。

与此同时,Llama 3.1 8B和70B参数版本,相较于Llama 3,得到了细微地改善。不过,有些指标,70B Llama 3.1还不如前一代。

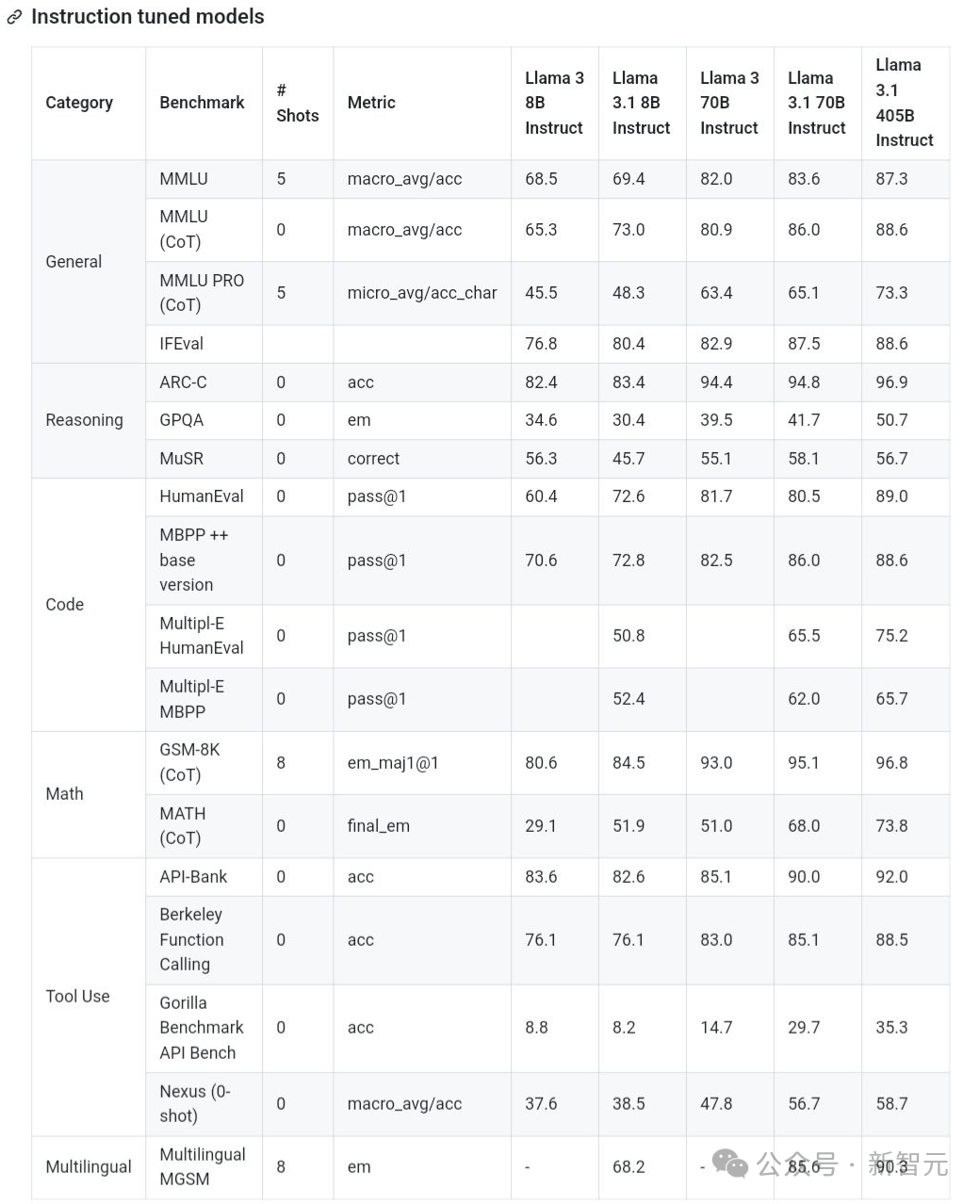

另外,指令微调模型中,看得出Llama 3.1 405B比预训练模型更强。在推理、代码、数学、工具使用、多语言基准上,纷纷碾压微调后的8B和70B版本。

Llama 3.1 8B和70B微调模型,同样在多项能力任务中,性能大幅提升。

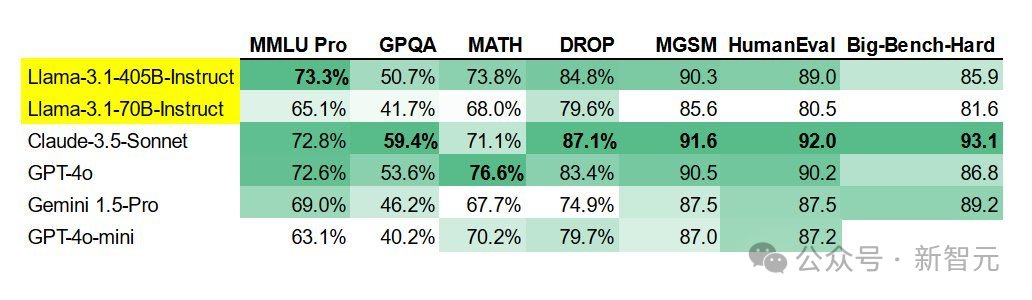

还有网友汇总了其他领先模型的基准,通过对比可以看出,Claude 3.5 Sonnet才是所有基准中的王者。

Llama 3.1 405B微调版本仅在数学基准MMLU Pro上,最能打,以73.3%成绩打败所有大模型。

另外,405B在GPQA(研究生水平的专业知识和推理)、数学、DROP(阅读理解)、MGSM(多语言数学)、HumanEval(编程),BBH(知识评估)基准上,与GPT-4o不相上下。

而且,405B大幅领先最新GPT-4o mini模型。

Llama 3.1是一个自回归语言模型,使用优化的Transformer架构。调整后的版本使用了SFT和RLHF,以符合人类对安全的偏好。

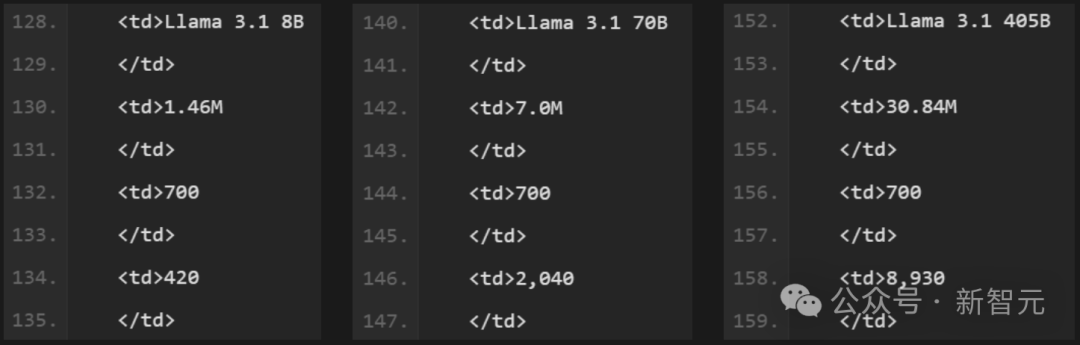

对于Llama 3.1系列模型,token计数仅指预训练数据。

所有模型的版本,都使用分组查询注意力(GQA)来提高推理的可扩展性。

15T token训练数据

与Llama 3一样,Llama 3.1也是在大约15万亿个来自公开可用来源的token上进行了预训练。

微调数据包括公开可用的指令数据集,以及超过2500万个合成样本,预训练数据截止到2023年12月。

商用研究皆可

Llama 3.1支持多语言环境下的商业和研究用途。

经过指令微调的纯文本模型适用于聊天助手,而预训练模型可以适应各种自然语言生成任务。Llama 3.1模型集合还支持利用其模型输出来改进其他模型,包括合成数据生成和模型蒸馏。

违反使用法律法规、被使用政策和Llama 3.1社区许可证禁止、支持语言之外的使用,都属于超出范围。

并且团队强调,除了支持的8种语言,Llama 3.1在更广泛的语言集合上进行了训练。开发者对其进行微调,就可以在其他语言上适用,前提是遵守社区许可证等政策,并保证使用是安全和负责的。

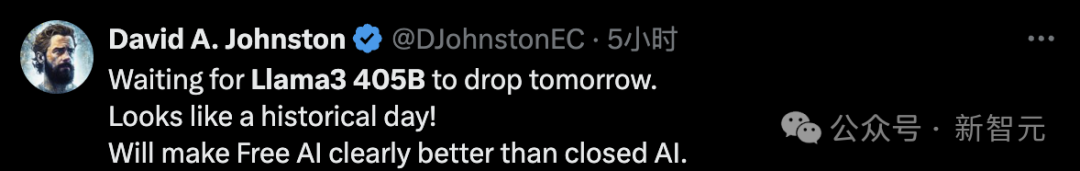

3930万GPU小时训练

在预训练时,Meta使用了定制的训练库、Meta定制的GPU集群和生产基础设施。微调、注释和评估也都是在生产基础设施上进行的。

训练累计使用了3930万GPU小时的计算时间,硬件类型为H100-80GB(TDP为700W)。

训练时间是训练每个模型所需的总GPU时间,功耗是每个GPU设备的峰值功率容量,根据功率使用效率进行了调整。

训练的总位置基温室气体排放估计为11,390吨二氧化碳当量(CO2eq)。

Meta强调,自2020年以来,自己一直保持着净零的温室气体排放,并且100%的电力都是由可再生资源生成的,因此基于市场基准的总温室气体排放为0吨二氧化碳当量。

重大风险

在重大风险上,Meta也做了测试。

包括CBRNE(化学、生物、放射性、核和爆炸材料)有用性、儿童安全和网络攻击。

在网络攻击上,团队调查了LLMs是否可以提高人类在黑客任务中的能力,包括技能水平和速度。

研究重点在评估LLMs在网络攻击行动中用作自主Agent的能力,特别是被勒索软件攻击时。

主要目标就是评估这些模型是否能在没有人为干预的情况下,有效地作为独立Agent执行复杂的网络攻击。

网友炸锅,再一次见证历史

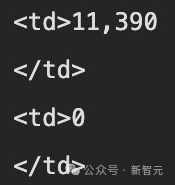

磁力链放出后,迫不及待的网友直接开始下载,不过这可能需要等待很久。

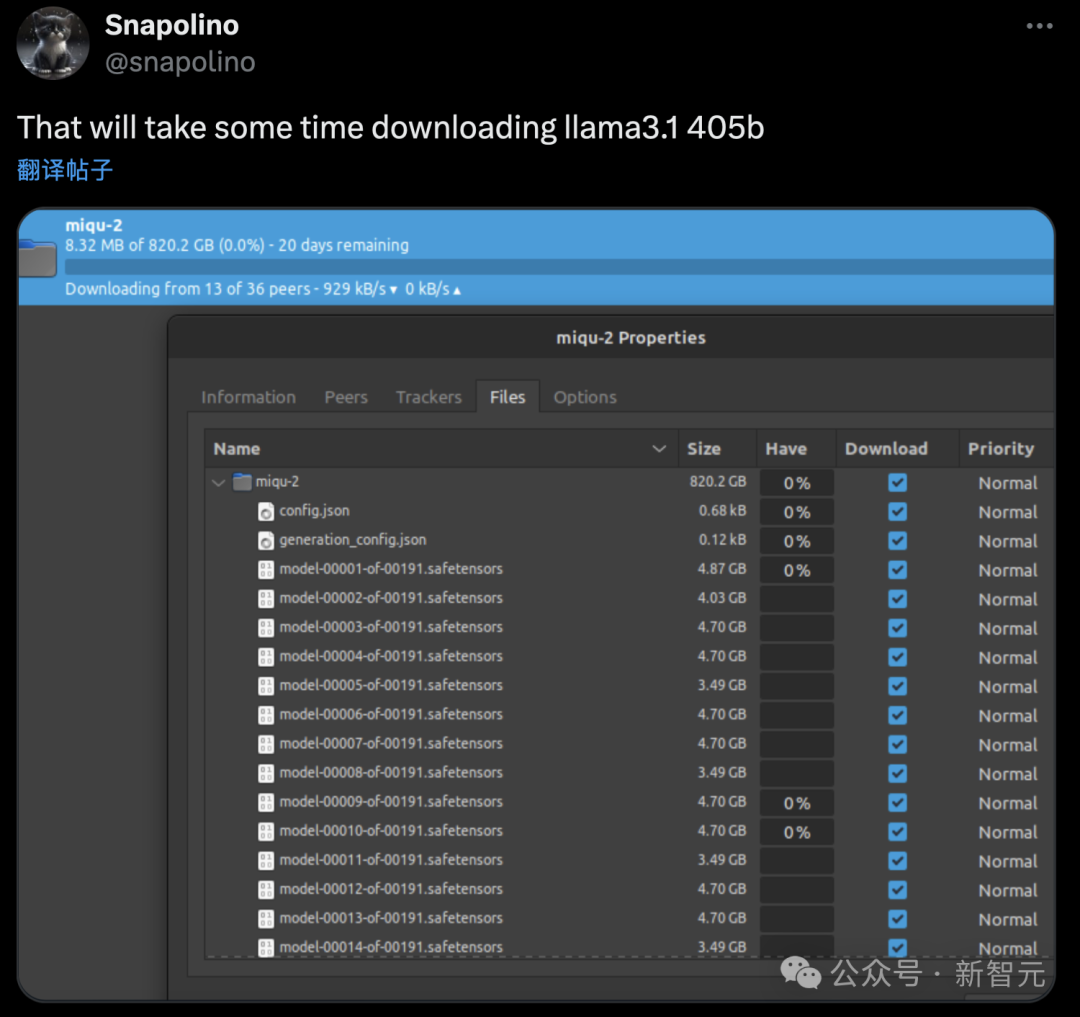

一部分网友开始坐等Llama 3.1 405B明天发布,再一次见证历史!

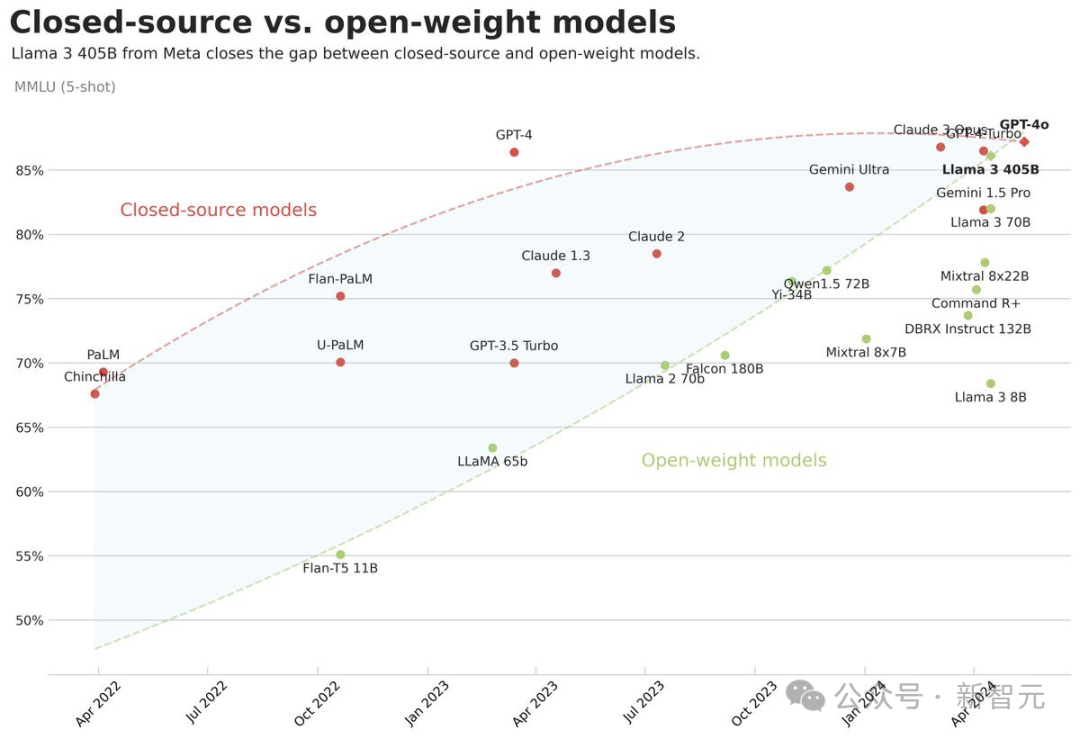

开源模型与闭源模型的差距,再次缩小了。

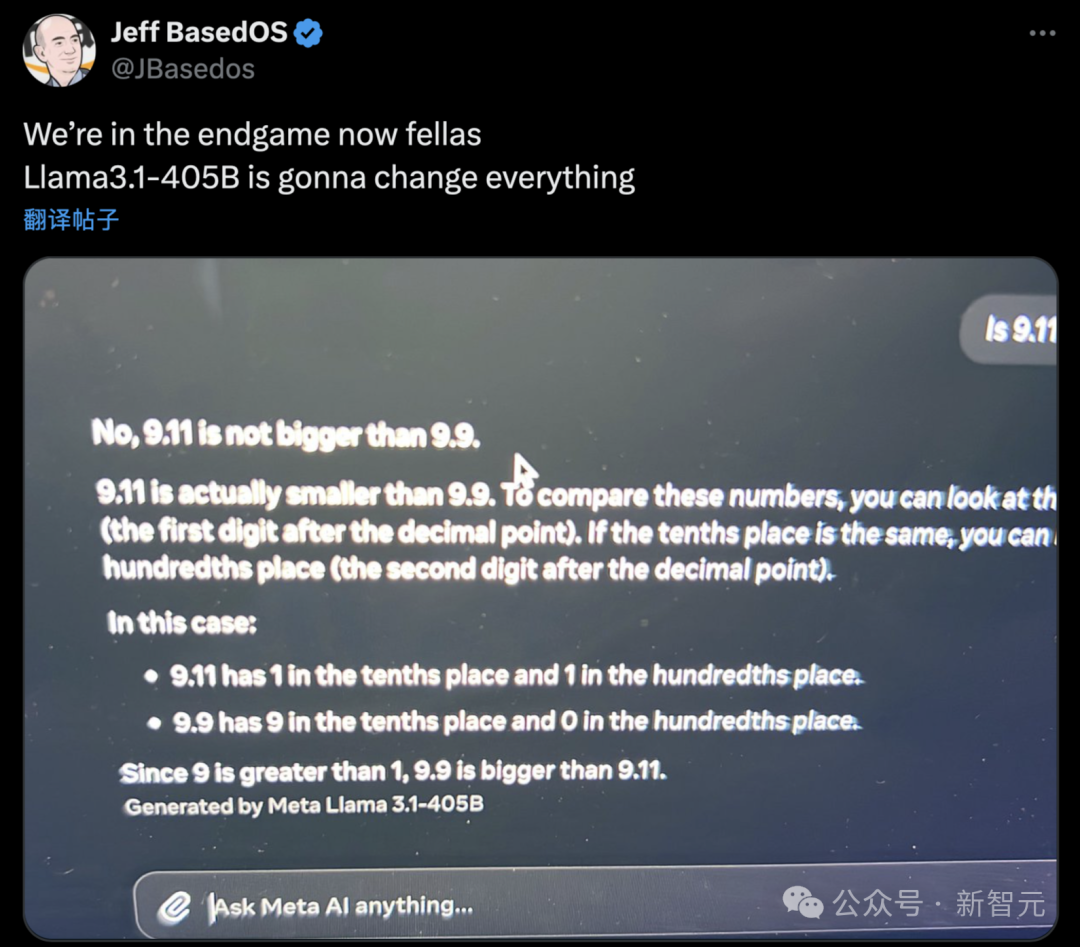

还有人测试了「9.11和9.9谁大」的经典陷阱题,Llama 3.1-405B竟答对了。

对于「GPU穷人」来说,820GB在笔记本上运行实在是太勉强了。

参考资料:

https://x.com/bindureddy/status/1815443198459990098

https://x.com/kimmonismus/status/1815314833236984274

https://x.com/mattshumer_/status/1815453195717742838

https://x.com/swishfever/status/1815512729286815756