热门标签

热门文章

- 1python导出mysql表结构和表数据并写入文件_python脚本 连接数据库,导出数据库表数据到文本文件

- 2【Python】爬虫详解(一看就懂)_python爬虫详解一看就懂

- 3pycharm激活_your pycharm trial has

- 4MySQL锁一文搞懂_mysql锁必须要在事务中才生效吗

- 5Kotlin跨平台工程的构建_idea kotlin 跨平台

- 6基于Hadoop技术实现的离线电商分析平台(Flume、Hadoop、Hbase、SpringMVC、highcharts)...

- 7PyTorch张量运算_pytorch乘除运算

- 8pytorch在有限的资源下部署大语言模型(以ChatGLM-6B为例)_pytorch chatglm模型

- 9【无人机编队】基于matlab二阶一致性多无人机协同编队控制(考虑通信半径和碰撞半径)【含Matlab源码 4215期】_无人机通信测试

- 10【华为OD机试真题 Java语言】482、加密算法、特殊的加密算法 | 机试真题+思路参考+代码解析(C卷)_有一种特殊的加密算法,明文为一段字符串,经过密码本查找

当前位置: article > 正文

大语言模型原理与工程实践:大语言模型的缩放定律_scaling law python

作者:正经夜光杯 | 2024-08-12 21:39:08

赞

踩

scaling law python

大语言模型原理与工程实践:大语言模型的缩放定律

关键词:大语言模型、缩放定律、模型性能、计算复杂度、参数优化、工程实践、未来趋势

1. 背景介绍

近年来,大语言模型(Large Language Models,LLMs)在自然语言处理领域取得了突破性进展。从GPT-3到ChatGPT,再到最新的GPT-4,这些模型展现出惊人的语言理解和生成能力,引发了学术界和工业界的广泛关注。在这一系列的发展中,一个引人注目的现象逐渐浮现:随着模型规模的增大,其性能似乎遵循某种可预测的规律。这种规律被称为"缩放定律"(Scaling Laws),它不仅揭示了大语言模型性能提升的内在机制,也为未来模型的设计和优化提供了重要指导。

本文将深入探讨大语言模型的缩放定律,从理论基础到实践应用,全面分析这一重要概念对人工智能领域的深远影响。我们将剖析缩放定律的核心原理,探讨其在模型设计、训练和应用中的关键作用,并展望未来大语言模型的发展趋势。

2. 核心概念与联系

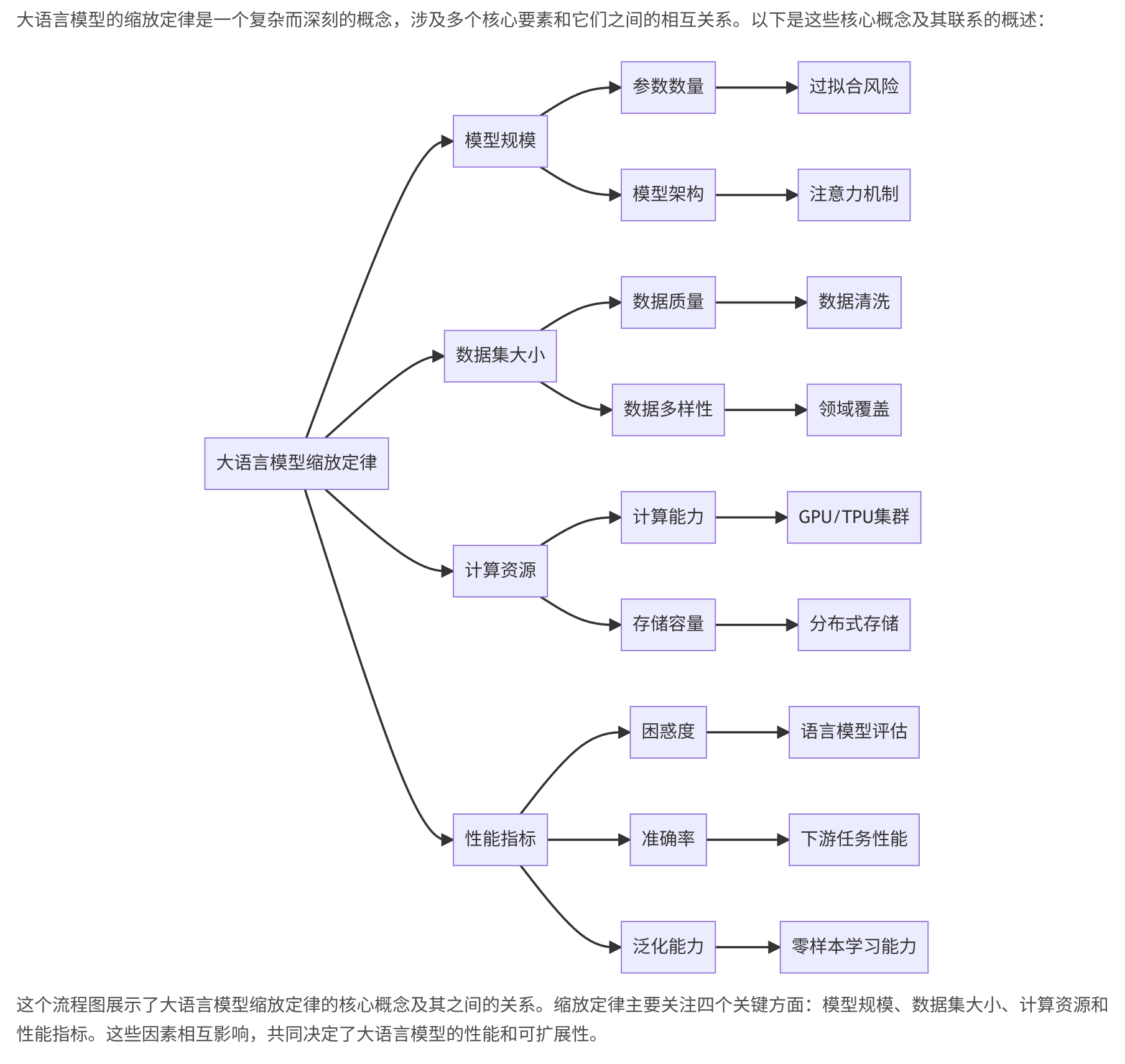

大语言模型的缩放定律是一个复杂而深刻的概念,涉及多个核心要素和它们之间的相互关系。以下是这些核心概念及其联系的概述:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/正经夜光杯/article/detail/971706

推荐阅读

相关标签