- 1[深度学习-原理篇]什么是循环神经网络RNN与LSTM_rnn箭头

- 2数据结构---单链表_单链表加什么头文件

- 3mysql 主从复制原理

- 4生成式人工智能 - 本地windows 11 + PyCharm运行stable diffusion流程简述_sd-v1-4.ckpt 下载

- 5解决跨域配置问题:When allowCredentials is true, allowedOrigins cannot contain the special value

- 6FPGA工具_fpga编程软件

- 7dubbo和springcloud有什么异同?

- 8String和JSON相互转换_string转json

- 9使用 Spring Boot + WebSocket + RabbitMQ 构建聊天应用程序

- 102024年顶级算法-黑翅鸢优化算法(BKA)-详细原理(附matlab代码)

Kimi人气飙升,手把手教你如何用极空间部署这个AI大模型~_kimi私有化部署

赞

踩

近期,从几百个AI大模型中突围的Kimi,因免费试用、模型大、响应快、扩展功能多等特点受到欢迎,被称为GPT4.0超级平替,火爆出圈!相信很多人手机中已经拥有了Kimi了吧!

先来认识一下Kimi是谁?

Kimi是一款国产人工智能助手,主要有“长文总结和生成、联网搜索、数据处理、编写代码、用户交互、翻译”6项功能,是全球首个支持输入20万汉字的智能助手产品。

Kimi的优势在于其高效的信息处理能力、多语言对话、强大的搜索能力、安全性和合规性、用户隐私保护、广泛的文件格式支持以及适应性和灵活性,这些特点使得Kimi成为用户获取信息和解决问题的有力助手。

这样的AI智能助手,是不是也想让你的极空间里拥有一个?那今天就大家都安排上↓↓↓

今天的进阶版玩法教程是: 用AI NAS 极空间Z423部署一夜爆火的【Kimi】, 极空间docker可玩性那么强!

书接上回,之前我写到过通过极空间部署kimi的API接口从而实现kimi大模型的使用,但由于过程很多人还是没看懂,且不知道如何对接到web服务中,于是今天便重新写写,同时我们将这个服务升级,除了kimi再将智谱、千问等大模型接入到我们的极空间中去部署。为了照顾老用户,这次我依然使用极空间来部署,并且过程会更为详细。

Z423

本次整个部署过程会涉及一共四个容器,我这里采用的设备为极空间Z423,作为民用级的NAS性能巅峰产品,除了出厂自带的32G大内存对于喜欢折腾各种玩法的人来说很友好,Z423的AMD锐龙7 5825U也是目前我使用过最强的NASCPU了。目前我Docker中已经部署十多个项目加上虚拟机一个,可以看到CPU的占用几乎不动,内存也完全没有焦虑。当然了,今天介绍的容器在老款Z4S以及最新的Z4Pro也可以流畅运行。

部署过程

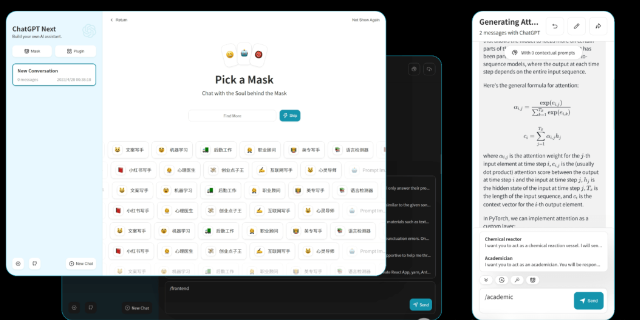

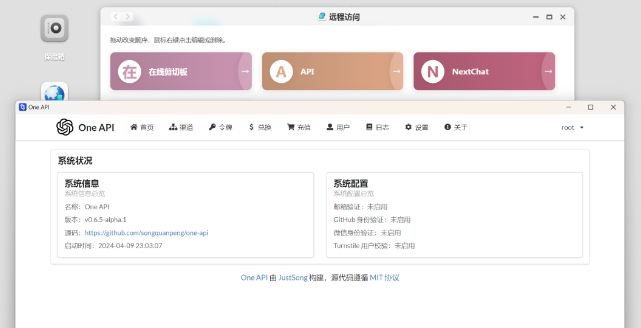

首先我们需要先部署一个web服务用于承接这些API接口,这样你才能通过可视化的界面来使用各种各样的大模型。市面上目前已经蛮多这样的web应用了,但无一例外大多都是套壳NextChat,所以我们干脆直接使用NextChat。

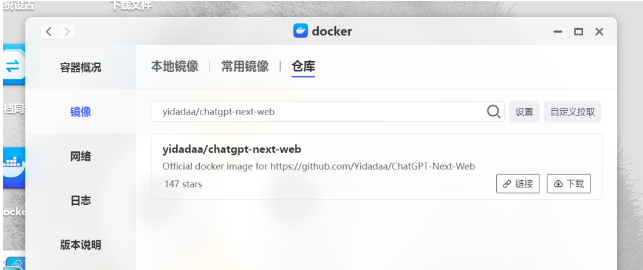

NextChat的部署并不难,首先我们访问极空间的Docker界面,在仓库中直接搜索yidadaa/chatgpt-next-web,如果下载超时,可以通过自定义拉取加代理的方式。

项目下载

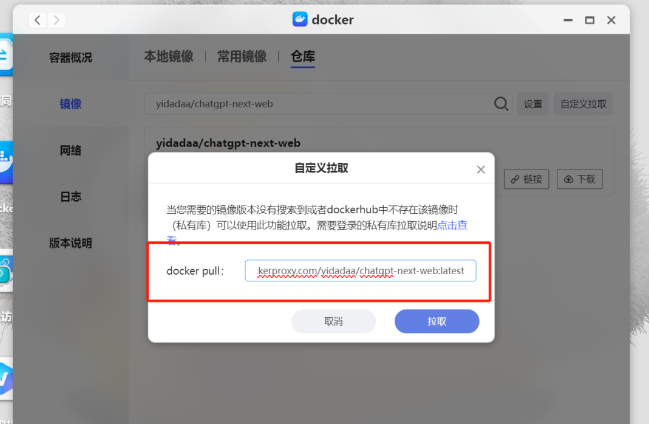

选择自定义拉取,随后在项目名前面加上dockerproxy.com,这样便可以实现更快的拉取镜像文件。(网址后面记得要加/符号哦!)

加速镜像

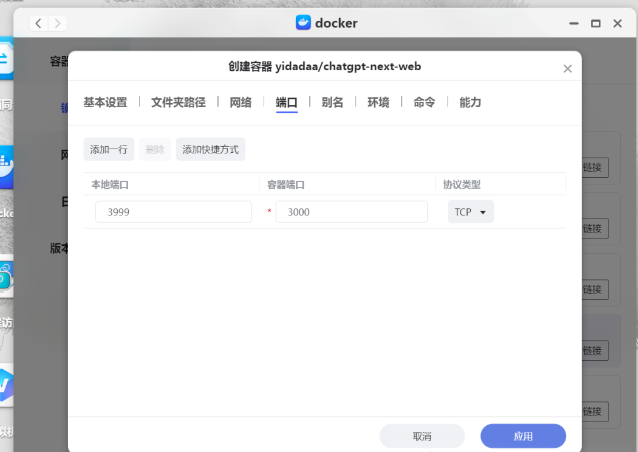

镜像下载之后我们选择镜像创建容器,容器端口3000不变,本地端口随意不冲突就行。

端口映射

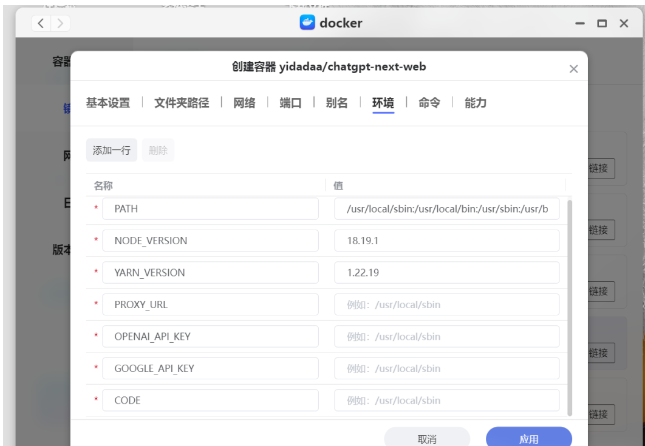

环境变量这里可以可以填写API的代理地址,key和访问密码,这里可以暂时不填写,毕竟我们还没有获取到key,访问密码变量为code,看你自己是否需要了,不填默认无密码。

环境变量

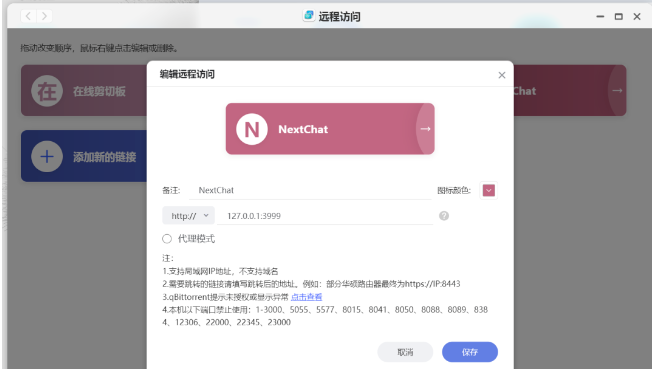

我这里直接全都不填写,随后直接创建容器。创建好之后我们打开极空间的远程访问功能(只能使用客户端)新建NextChat的远程访问,地址为127.0.0.1:本地端口,例如我这里就是127.0.0.1:3999。

远程访问

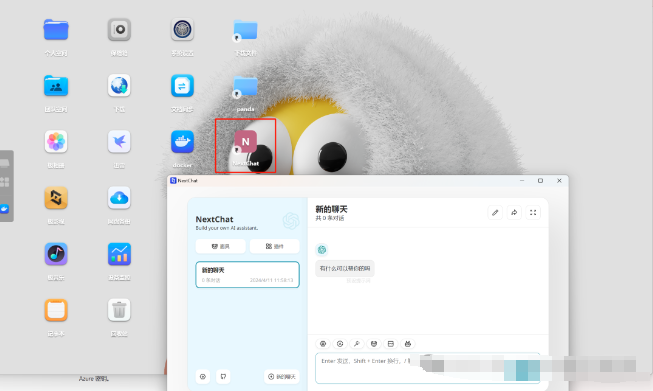

这时候我们通过远程访问的标签就可以访问到项目了,同时也可以将标签贴到首页作为快捷访问图标,极空间这一点还是蛮方便的,简单实用!

项目首页

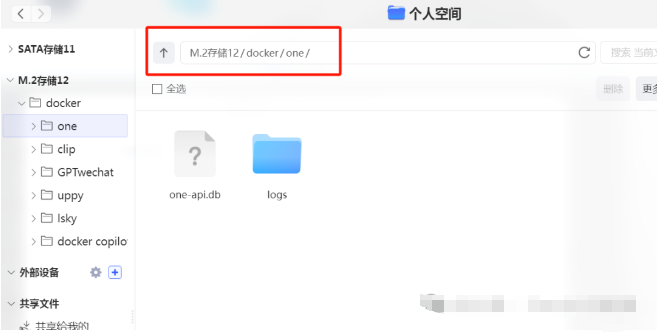

这时候我们还不能提问以及画图,毕竟我们还没有填写key。而为了将所有大模型集中到一起,所以这里我们直接部署one api来实现API接口的统一。在此之前我们在docker文件夹新建one文件夹(名字随意,好记就行)

准备工作

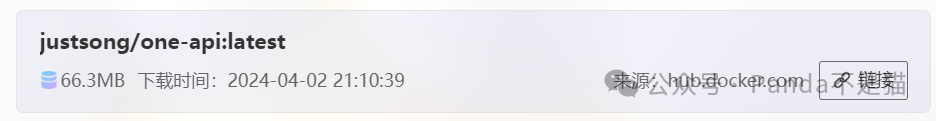

随后在极空间的Docker仓库搜索justsong/one-api,如果拉取失败,还是可以采取上述的加代理的形式。

选择镜像创建容器,文件夹路径这里我们将刚刚创建的one文件夹映射路径设置为/data,端口上容器端口3000不动,本地端口随意不冲突就行了。

容器设置

随后启动项目,这时候我们就能得到一个用于对接所有大模型的服务了,默认的用户名为root密码123456,首次登录会提醒你修改密码。这里我依然使用极空间的远程访问编辑好,这样方便我们直接使用。

项目预览

这里我们已经为api的接入做好了所有准备工作了,接下来便是大模型的api搭建。首先是kimi模型。直接打开Docker仓库界面搜索:kimi-free-api下载镜像,镜像并不大,部署好也就200多M。(需要注意的事,该项目目前仅用于自用,再次感谢LLM Red Team大模型红队组织的开源项目。)

项目下载

下载之后我们直接创建容器,这里只需要将端口8000映射出去就可以了。这时候你的kimi接口便为你的ip地址+本地端口号,例如我这里就是http://192.168.101.12:8700。

端口映射

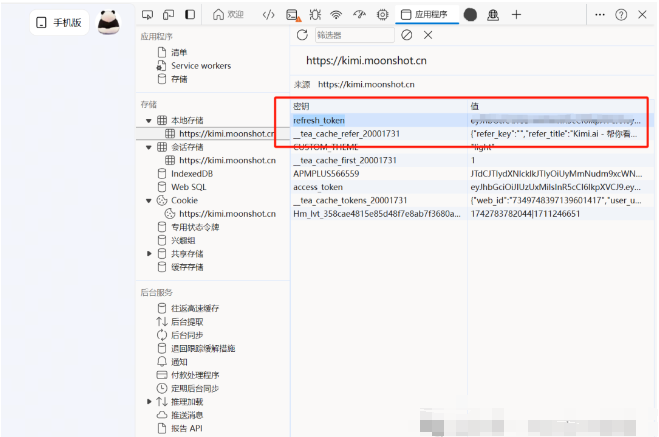

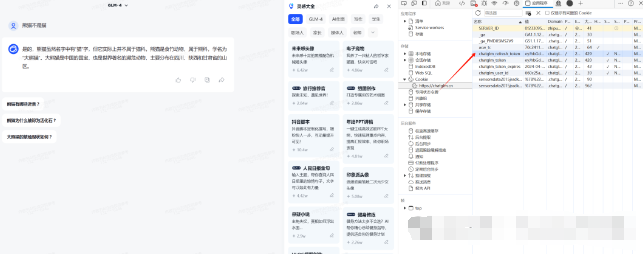

接口有了,还需要获取对应的key。kimi的key很好获取,登录kimi的官网,注册登录账号之后随便发起一段对话。随后按F12打开浏览器的开发人员功能,这里我使用的为Edge浏览器,所以点击应用程序-本地会话功能,找到refresh_token这一项,将其中的值记录下来,这就是稍后需要使用到的key。如果你是谷歌或其他浏览器,开发选项为英文界面,那么就在Application > Local Storage中去找。

key

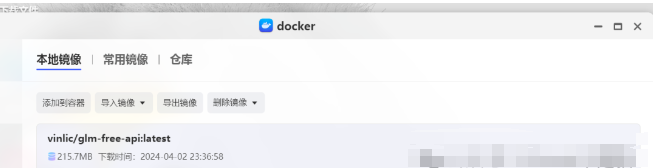

这时候我们便得到了kimi的api接口以及key。由于kimi目前不支持ai绘图,所以我们还需要其他模型,所以这里我们再采取LLM Red Team大模型红队的开源项目glm-free-api来获取智谱清言的api接口以及key。Docker中搜索vinlic/glm-free-api下载镜像。

智谱清言

依然还是一样,只需要映射端口即可。端口映射之后直接启动项目,接着我们去智谱清言的官网获取key。注册登录一个账号,随后随便发起一段对话,随后按下F12获取到key。这时候我们便得到了智谱清言的接口与key了。

获取key

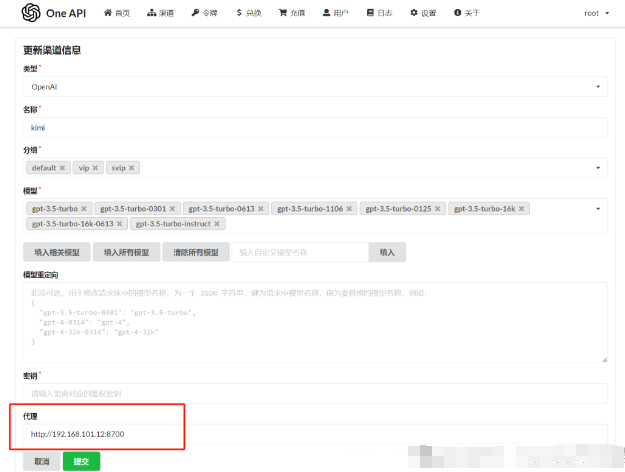

最后我们打开刚刚部署的one api项目界面,在渠道中添加kimi以及智谱清言,这里需要注意模型的选择,kimi由于不支持ai绘画,所以只需要选择对话模型即可,可以参考我这里的设置,代理地址便是我们刚刚搭建的kimi接口地址,密钥则是我们刚刚通过F12获取的值。

kimi设置

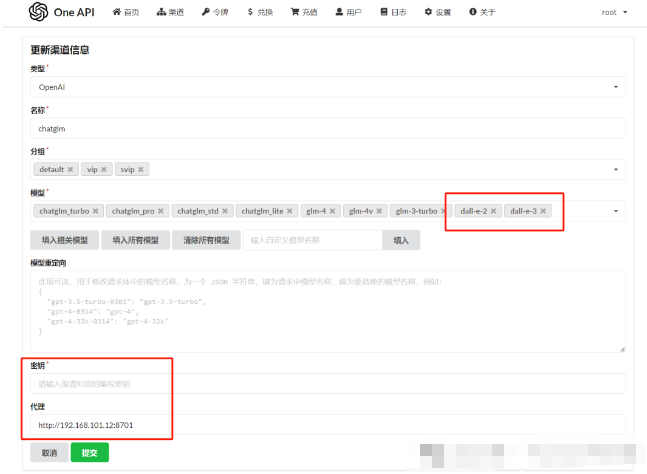

智谱清言因为具备ai绘图的能力,所以在设置中我们需要添加上dall-e-2或者-3都可以。他起模型有没有都无所谓,加上也不碍事,代理和密钥同上。

智谱设置

最后点击令牌,选择添加一个令牌,随后复制我们的令牌。再转到我们搭建的NextChat项目,点击右下角的设置项选择自定义接口,接口地址则是我们搭建的one-api服务地址,例如我这里就为http://192.168.101.12:3300。API key则是我们刚刚获取到的令牌。

web设置

这时候我们就能直接对话了,通过极空间的远程访问功能将NextChat固定到桌面,这样便可以直接在极空间中打开服务,从而实现对话了。

kimi展示

如何系统的去学习大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。