- 1torch分布式训练_torchrun

- 2java编辑yml_通过JAVA代码对yaml文件进行增加、修改的操作

- 3回溯算法求解01背包问题_利用回溯法编程求解0-1背包问题

- 4adb基本命令_adb指定设备命令

- 5微信小程序后端学习笔记——图片上传_微信小程序上传图片

- 6【Java脚本】--- 移动(剪切)文件_java移动文件到指定文件夹

- 7git clone 下载下来模型文件夹很大,清除git信息后少了一半_开源的clone下来删掉会把所有的删掉吗

- 8mac os 10.10下安装android studio问题:android studio was unable to find a valid jvm

- 9全面掌握 Swift 包依赖管理工具 —— 命令行、Manifest API、Xcode、二进制包、集合、插件_swift 依赖查找的来源

- 10图片对比相似度算法标准,图片相似度匹配算法_评价两张图片相似度或差异度的指标是

P101 adversial attack 对抗攻击- 体现AI的不可靠

赞

踩

Attack

x 与 x0 在一定误差内,两者之间的loss 越大越好

对抗攻击是指利用计算机系统或人工智能模型的弱点,通过修改输入数据,使得系统产生错误的结果或分类,而这种修改又对人类观察者来说几乎是无法察觉的。对抗攻击的目的在于欺骗或误导机器学习模型,使其在处理经过微小修改的输入数据时产生错误的输出。

关键点:

攻击类型:

梯度攻击: 通过计算模型对输入数据的梯度,并对输入数据进行微小的修改,使模型产生错误的分类或预测。

白盒攻击: 攻击者完全了解目标模型的结构和参数。

黑盒攻击: 攻击者只有有限的关于目标模型的信息,但仍能生成对抗性示例。

应用领域:

图像分类: 对抗攻击常常展示在图像分类模型中。

自然语言处理: 对抗攻击也可应用于文本数据,影响情感分析或文本分类等任务中的模型。

防御机制:

对抗训练: 通过训练模型以抵抗对抗性示例可以提高其鲁棒性。

输入预处理: 对输入数据添加随机噪声或应用其他预处理技术可以增加对抗性示例的生成难度。

对抗性检测: 开发方法在运行时检测对抗性示例。

实际影响:

对抗攻击引发对机器学习系统安全性和可靠性的担忧,特别是在自动驾驶汽车、医学诊断和安全系统等关键应用中。

对抗攻击在现实世界中具有重要意义,因为它们揭示了机器学习模型的脆弱性。研究人员和从业者不断探索提高机器学习模型对对抗攻击的鲁棒性,并开发新的防御机制来减轻其影响。这需要持续的研究和发展更具韧性的机器学习算法。

部分学者认为

adversial attack 会成功不是bug, 而是原数据数据特征不够

注意网络上的公开资料集里

Defense

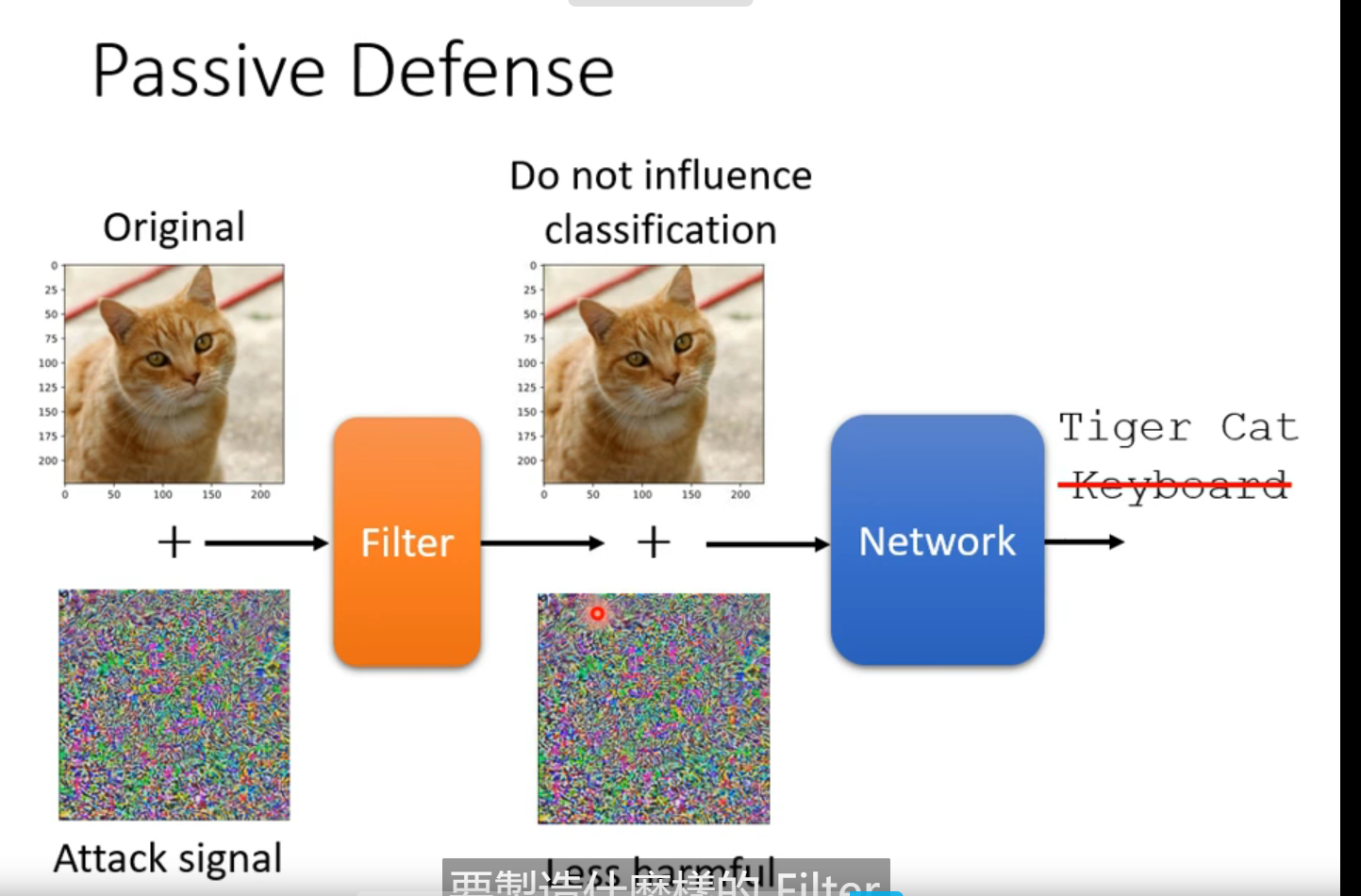

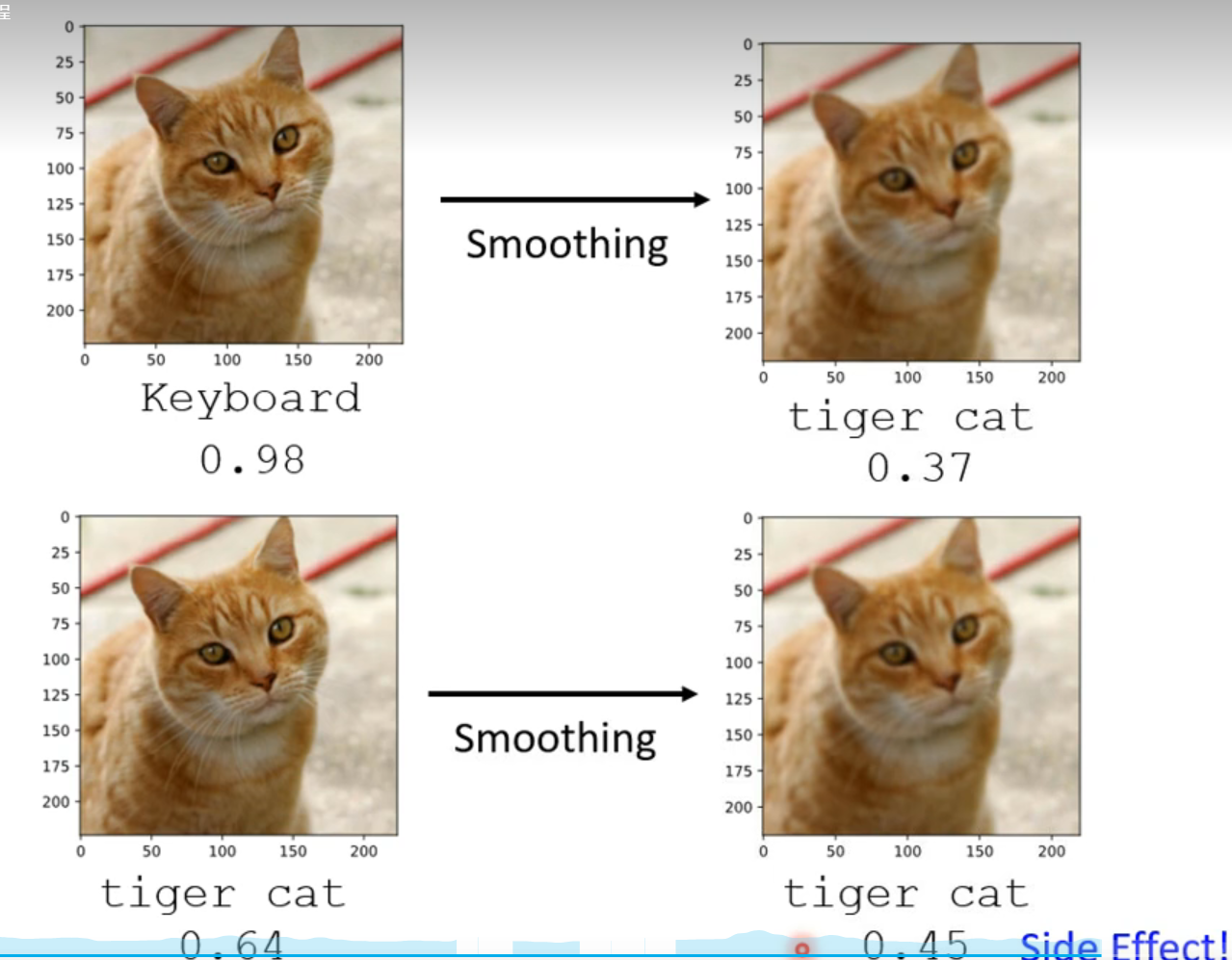

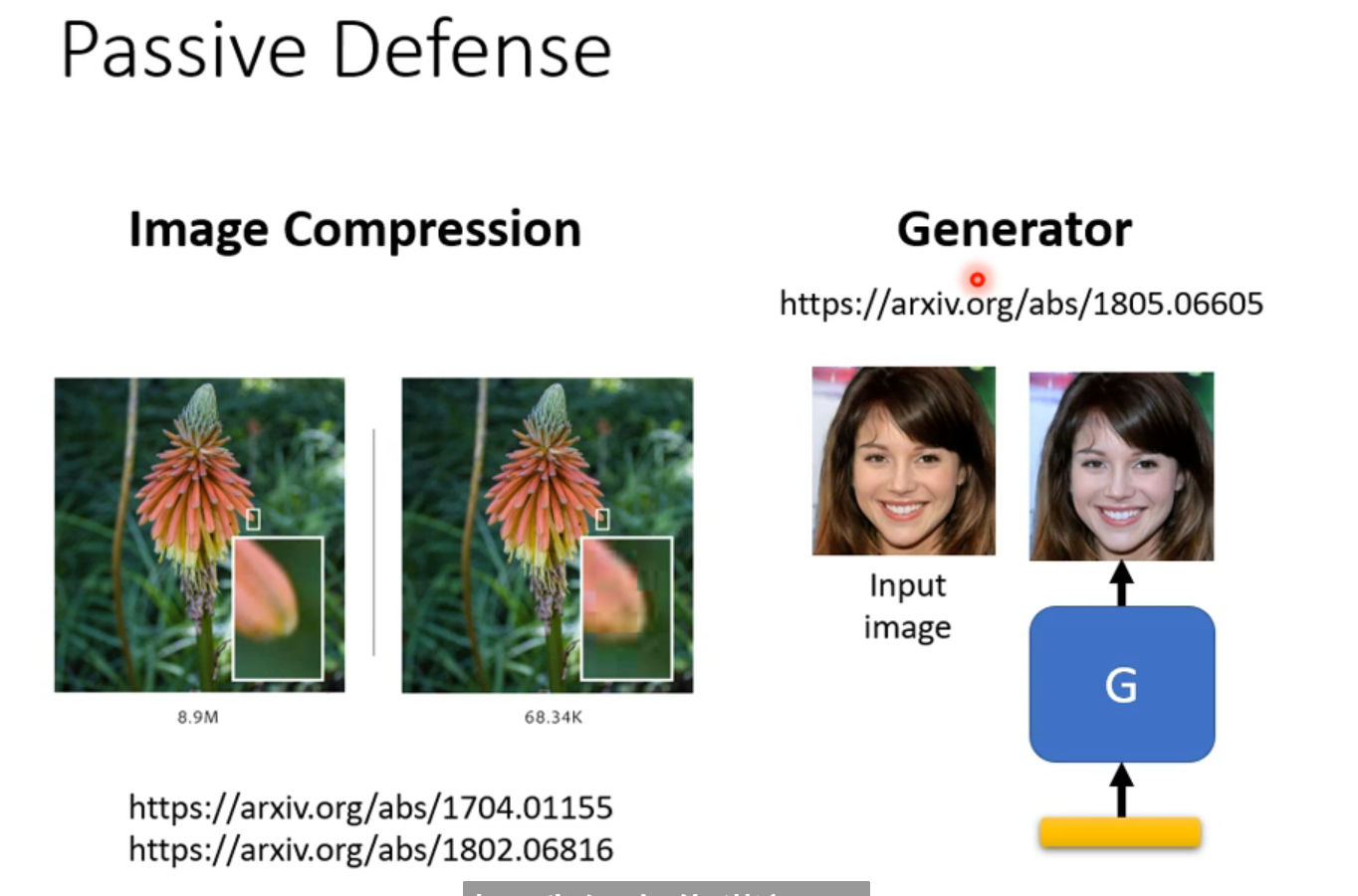

被动防御

filter 把图片做稍微的模糊化

模糊化

压缩

generator, 用generator 生成一张与输入非常接近输入的照片

但是模糊化被别人知道后,很快就会失效。 别人在attack 时使用相同的模糊,就会失效

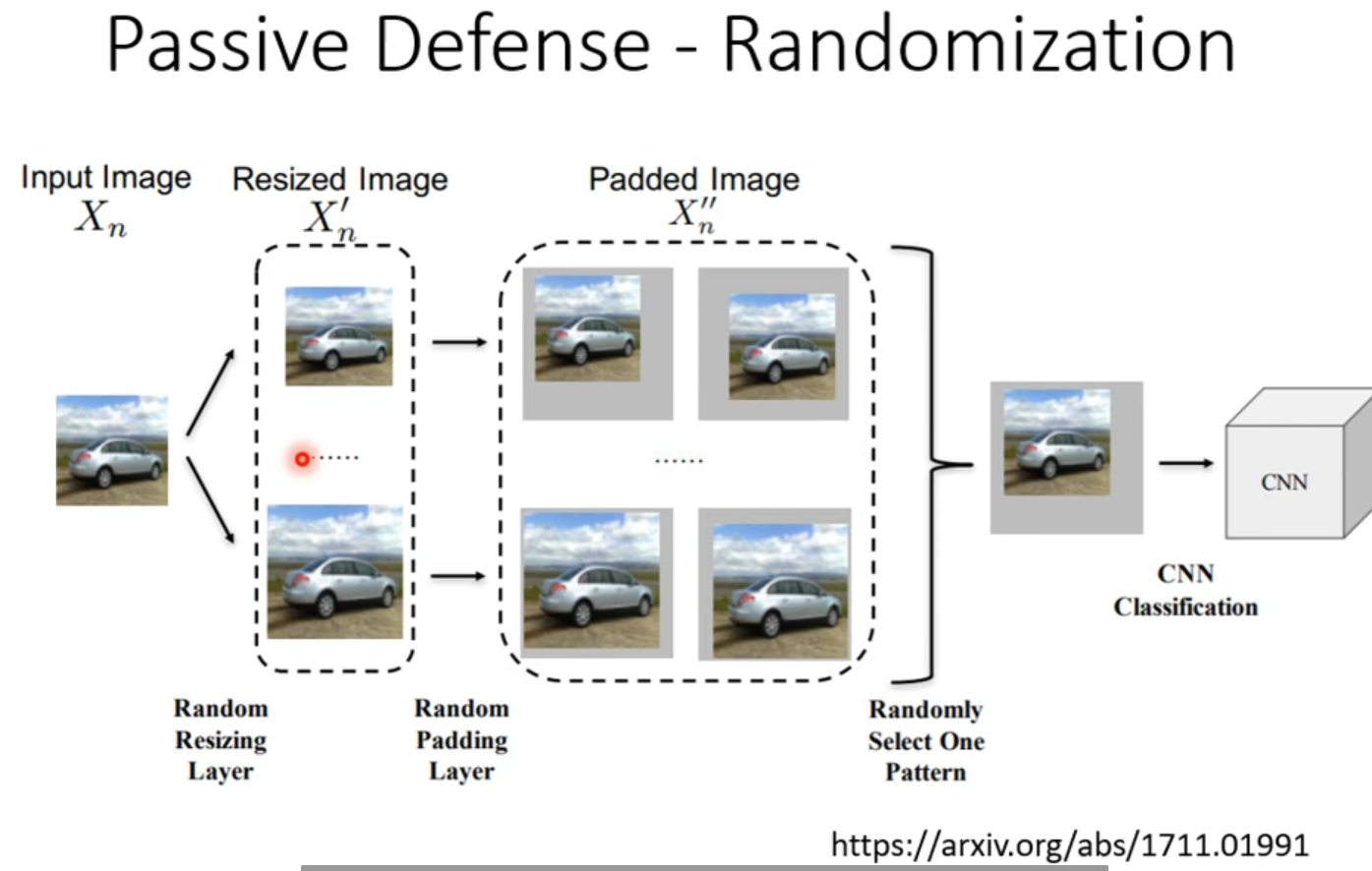

改进: 随机改变 任意改变大小,放在任意背景上

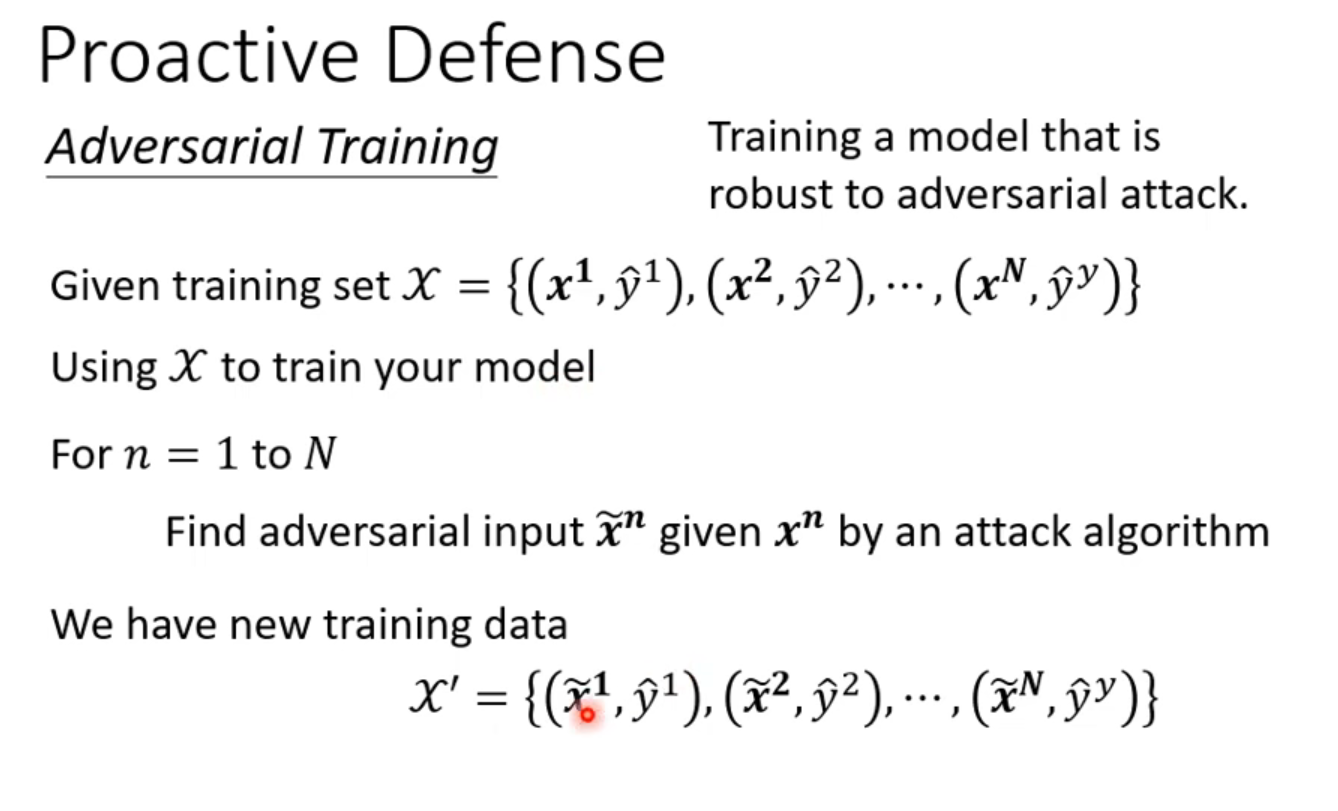

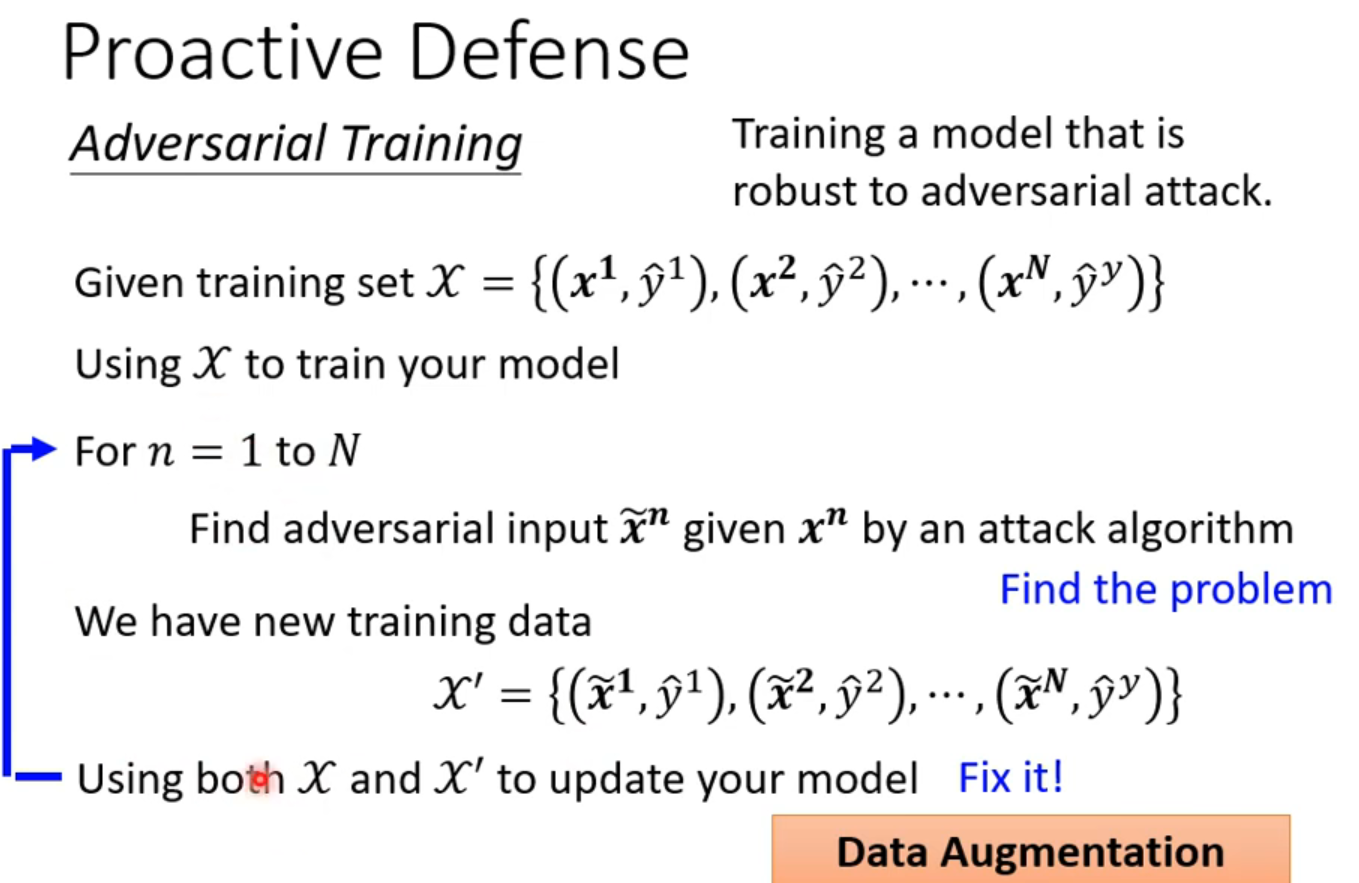

主动防御

在训练时就加入

将生成的attack 样本的label 重新打成正确的标,形成新的数据集 ~~ data augamention 资料增强