- 1Linux命令·crontab_linux crontab

- 2基于傅里叶变换的图像增强_基于傅里叶变换实现频域增强原理的图像处理

- 3eclipse连接数据库_eclipse链接数据库

- 4python time操作 格式化字符串转时间戳_python time 如何将字符串转换成时间戳

- 5Deepin 设置脚本或者程序启动_深度 启动加载脚本

- 6Docker(四)进阶:Docker镜像概述和分层原理_docker镜像分层原理

- 7油猴脚本 - Greasy Fork - 安全、有用的用户脚本大全

- 8java sort方法详解_java排序sort方法

- 9python 添加到path环境变量_pythonhome pythonpath

- 10最全java面试题整理(持续更新)

百川智能发布 Baichuan 2,号称全面领先 LLaMA 2_baihcuan2 多轮对话传参

赞

踩

百川智能gnss正式开源微调后的 Baichuan2-7B、Baichuan2-13B、Baichuan2-13B-Chat 与其 4bit 量化版本,并且均为免费可商用。

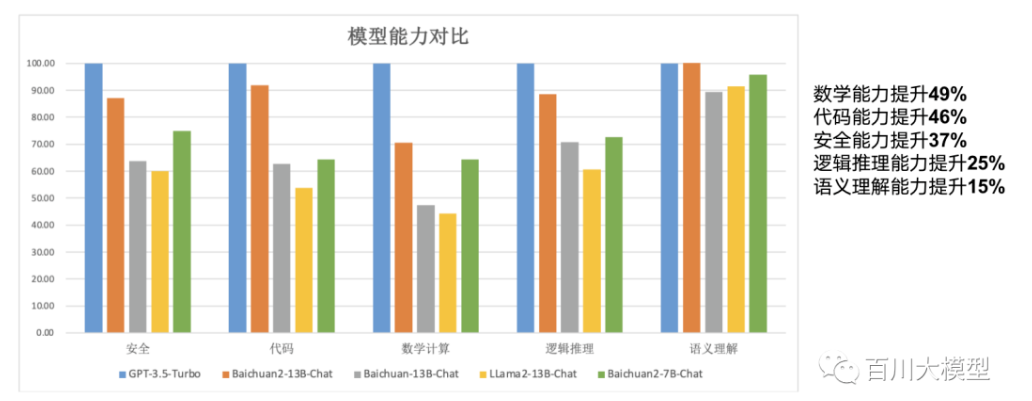

根据介绍,Baichuan2-7B-Base 和 Baichuan2-13B-Base,均基于 2.6 万亿高质量多语言数据进行训练,在保留了上一代开源模型良好的生成与创作能力,流畅的多轮对话能力以及部署门槛较低等众多特性的基础上,两个模型在数学、代码、安全、逻辑推理、语义理解等能力有显著提升。其中 Baichuan2-13B-Base 相比上一代 13B 模型,数学能力提升 49%,代码能力提升 46%,安全能力提升 37%,逻辑推理能力提升 25%,语义理解能力提升 15%。

本次开源的两个模型在各大评测榜单上的表现优秀,在 MMLU、CMMLU、GSM8K 等几大权威评估基准中,以绝对优势领先 LLaMA2,相比其他同等参数量大模型,表现也十分亮眼,性能大幅度优于 LLaMA2 等同尺寸模型竞品。

且根据 MMLU 等多个权威英文评估基准评分 Baichuan2-7B 以 70 亿的参数在英文主流任务上与 130 亿参数量的 LLaMA2 持平。

Baichuan2-7B 和 Baichuan2-13B 不仅对学术研究完全开放,开发者也仅需邮件申请获得官方商用许可后,即可以免费商用。

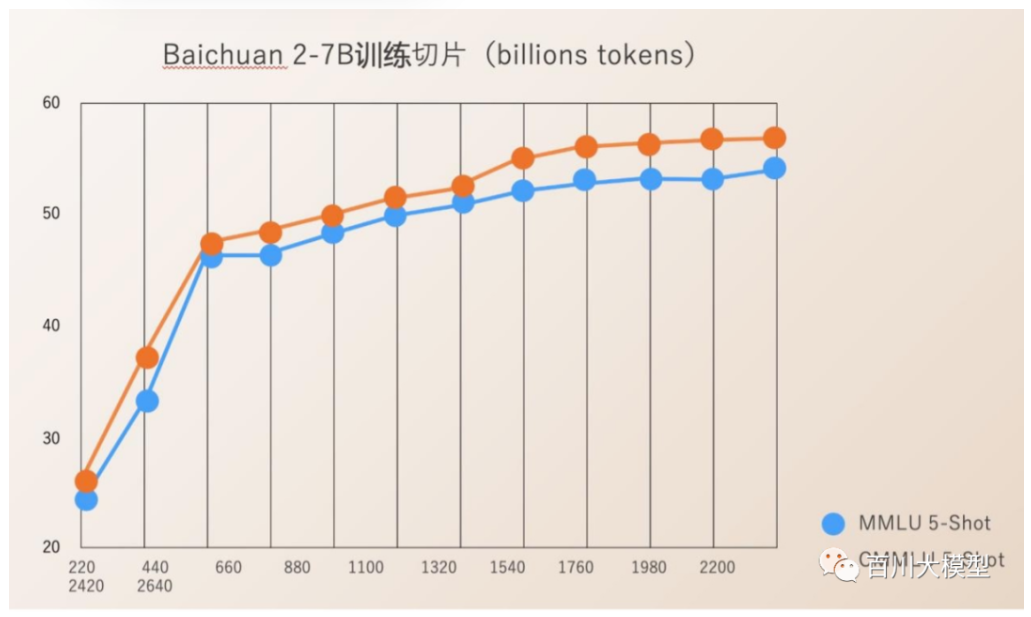

与此同时,百川智能还宣布开源了模型训练从 220B 到 2640B 全过程的 Check Ponit。

并公开了 rtk。技术报告将详细介绍 Baichuan 2 训练的全过程,包括数据处理、模型结构优化、Scaling law、过程指标等。

王小川透露,按照公司计划,今年四季度将发布对标 GPT-3.5 的千亿级参数模型,预计于明年一季度发布超级应用。“除开源模型以外,下一次在闭源模型上会有更多的突破,希望在中国的开源闭源生态中都能给中国的经济社会发展带来我们的贡献。”