热门标签

热门文章

- 1Windows 安全基础—域_windows 域理解

- 2机器学习十大算法!入门看这个就够了~(1)_机器学习入门算法

- 32024年大数据高频面试题(下篇)

- 4使用ADO.NET查询和操作数据

- 5Python手机App数据抓取实战:抖音用户的抓取,看这篇文章准没错_抖音抓包

- 6关于前端数据Fail to load response data解决方法_failed to load response data

- 7基于星火大模型的群聊对话分角色要素提取挑战赛|#AI夏令营#Datawhale#夏令营-Lora微调与prompt构造_讯飞官方微调所需训练集格式

- 8FPGA实现UART串口通信流程及代码实现_fpga的uart可以例化吗

- 9springboot集成redisson

- 10docker-compose部署Kafka_docker-compose kafka

当前位置: article > 正文

2024年大数据最新Hadoop集群部署和启动与关闭_启动hadoop(1),全网最具深度的三次握手、四次挥手讲解

作者:盐析白兔 | 2024-07-20 06:59:07

赞

踩

2024年大数据最新Hadoop集群部署和启动与关闭_启动hadoop(1),全网最具深度的三次握手、四次挥手讲解

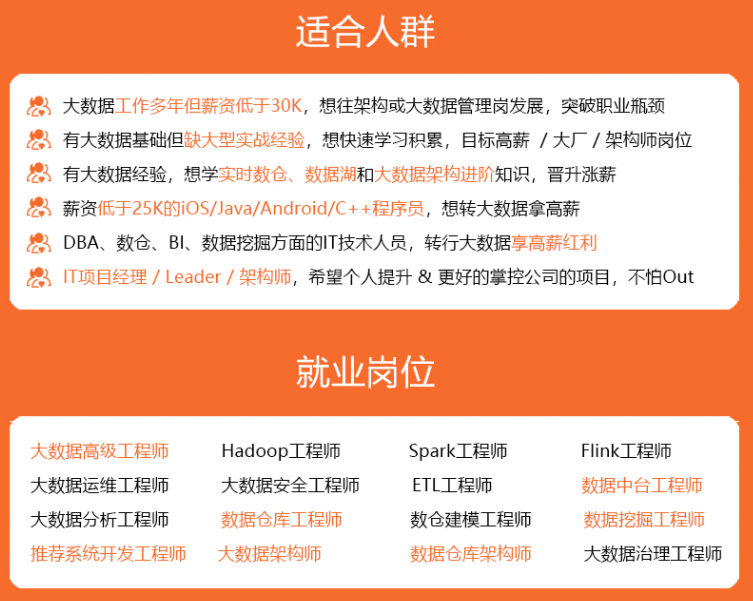

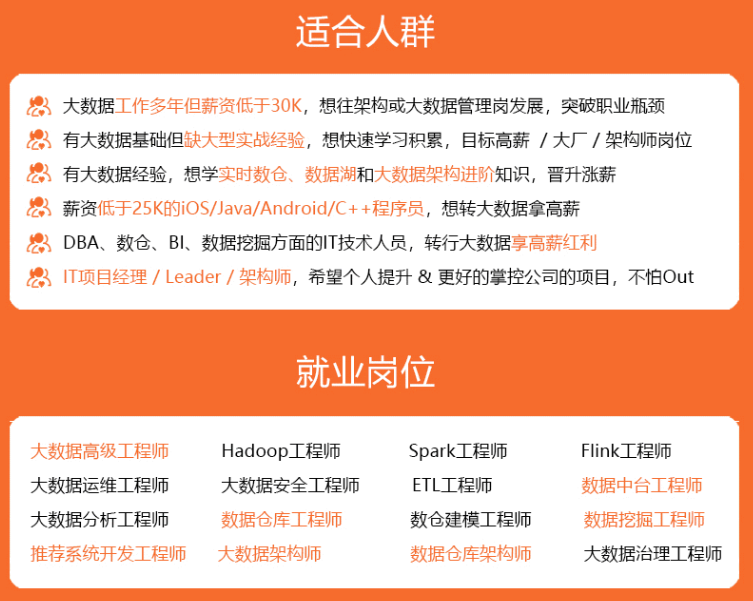

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

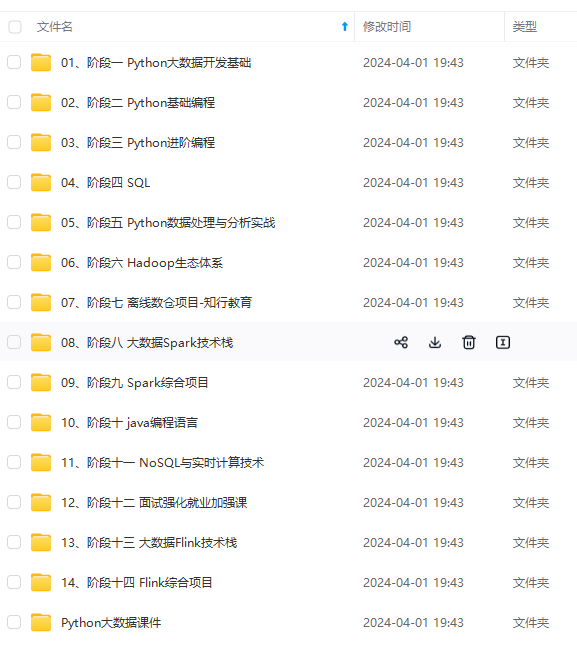

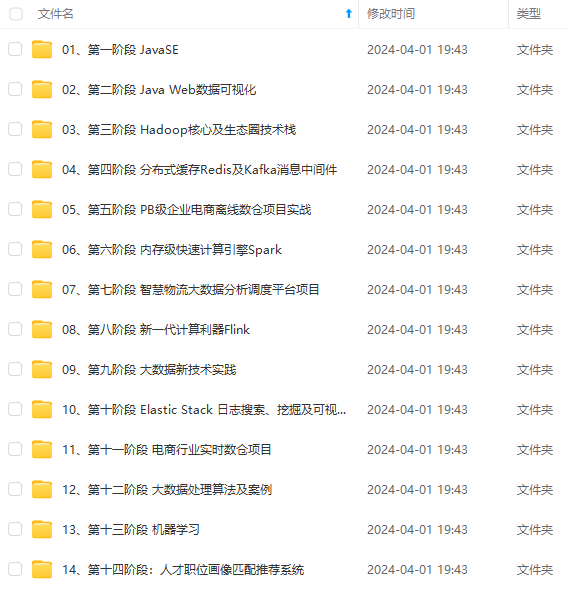

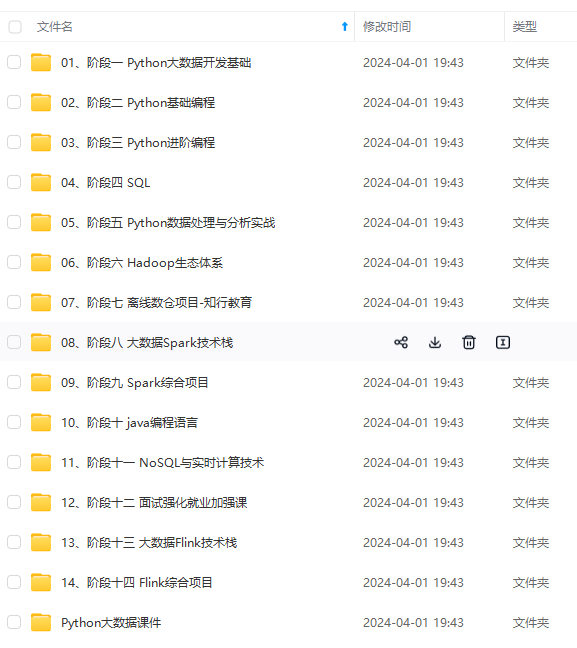

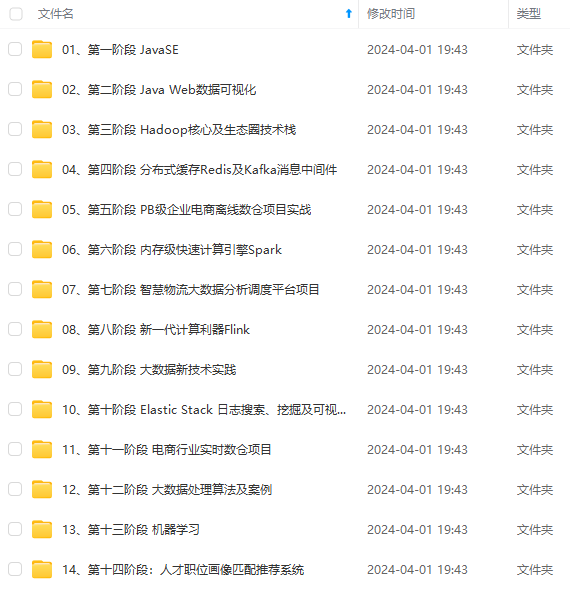

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

- 修改core-site.xml文件

在虚拟机Spark01中,进入Hadoop安装包的/etc/hadoop/目录,执行“vi core-site.xml”命令编辑Hadoop的核心配置文件core-site.xml。如下:

<property>

<name>fs.defaultFS</name> #配置命名空间管理服务制定通信地址

<value>hdfs://master</value>

</property>

<property>

<name>hadoop.tmp.dir</name> #存储临时文件的目录

<value>/export/servers/hadoop-2.7.4/tmp</value>

</property>

<property>

<name>ha.zookeeper.quorum</name> #ZooKeeper集群地址

<value>spark01:2181,spark02:2181,spark03:2181</value>

</property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 修改hdfs-site.xml文件

在虚拟机Spark01中,进入Hadoop安装包的/etc/hadoop/目录,执行“vi hdfs-site.xml”命令编辑HDFS的核心配置文件hdfs-site.xml。

<property> <name>dfs.replication</name> #HDFS副本数 <value>3</value> </property> <property> <name>dfs.namenode.name.dir</name> #NameNode 节点数据(即元数据)的存放位置 <value>/export/data/hadoop/namenode</value> </property> <property> <name>dfs.datanode.data.dir</name> #DataNode 节点数据(即数据块)的存放位置 <value>/export/data/hadoop/datanode</value> </property> <property> <name>dfs.nameservices</name> #处理外部访问HDFS的请求 <value>master</value> </property> <property> <name>dfs.ha.namenodes.master</name> #定义每个NameNode节点的唯一标识符 <value>nn1,nn2</value> </property> <property> <name>dfs.namenode.rpc-address.master.nn1</name> #标识符nn1的RPC服务地址 <value>spark01:9000</value> </property> <property> <name>dfs.namenode.rpc-address.master.nn2</name> #标识符nn2的RPC服务地址 <value>spark02:9000</value> </property> <property> <name>dfs.namenode.http-address.master.nn1</name>#标识符nn1的HTTP服务地址 <value>spark01:50070</value> </property> <property> <name>dfs.namenode.http-address.master.nn2</name>#标识符nn2的HTTP服务地址 <value>spark02:50070</value> </property> <property> <name>dfs.namenode.shared.edits.dir</name>#NameNode元数据在JournalNode上的共享存储目录 <value>qjournal://spark01:8485;spark02:8485;spark03:8485/master</value> </property> <property> <name>dfs.journalnode.edits.dir</name>#JournalNode存放数据地址 <value>/export/data/hadoop/journaldata</value> </property> <property> <name>dfs.client.failover.proxy.provider.master</name>#访问代理类,用于确定当前处于 Active 状态的 NameNode节点 <value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value> </property> <property> <name>dfs.ha.fencing.methods</name>#配置隔离机制,确保集群中只有一个NameNode处于活动状态 <value> sshfence shell(/bin/true) </value> </property> <property> <name>dfs.ha.fencing.ssh.private-key-files</name>#sshfence隔离机制需要配置本机密钥地址 <value>/root/.ssh/id_rsa</value> </property> <property> <name>dfs.ha.automatic-failover.enabled</name>#开启自动故障状态切换 <value>true</value> </property> <property> <name>dfs.ha.fencing.ssh.connect-timeout</name>#sshfence隔离机制超时时间 <value>30000</value> </property> <property> <name>dfs.webhdfs.enabled</name> #开启webhdfs服务 <value>true</value> </property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 修改mapred-site.xml文件

在虚拟机Spark01中,进入Hadoop安装包的/etc/hadoop/目录,执行“cp mapred-site.xml.template mapred-site.xml”命令,通过复制模板文件方式创建MapReduce

的核心配置文件mapred-site.xml,执行“vi mapred-site.xml”命令编辑配置文件

mapred-site.xml ,指定MapReduce运行时框架。如下:

<property>

<name>mapreduce.framework.name</name>#指定MapReduce 作业运行在 YARN框架之上

<value>yarn</value>

</property>

- 1

- 2

- 3

- 4

- 5

- 修改yarn-site.xml文件

在虚拟机Spark01中,进入Hadoop安装包的/etc/hadoop/目录,执行“cp yarn-site.xml”命令,编辑YARN的核心配置文件yarn-site.xml。如下:

<property> <name>yarn.nodemanager.aux-services</name>#配置NodeManager上运行的附属服务,需要配置为mapreduce_shuffle <value>mapreduce_shuffle</value> </property> <property> <name>yarn.resourcemanager.ha.enabled</name>#开启ResourceManager的HA机制 <value>true</value> </property> <property> <name>yarn.resourcemanager.cluster-id</name>#自定义ResourceManager集群的标识符 <value>yarncluster</value> </property> <property> <name>yarn.resourcemanager.ha.rm-ids</name>#自定义集群中每个ResourceManager节点的唯一标识符 <value>rm1,rm2</value> </property> <property> <name>yarn.resourcemanager.hostname.rm1</name>#指定标识符rm1的ResourceManager节点 <value>spark01</value> </property> <property> <name>yarn.resourcemanager.hostname.rm2</name>#指定标识符rm2的ResourceManager节点 <value>spark02</value> </property> <property> <name>yarn.resourcemanager.zk-address</name>#ZooKeeper集群地址 <value>spark01:2181,spark02:2181,spark03:2181</value> </property> <property> <name>yarn.resourcemanager.recovery.enabled</name>#开启自动恢复功能 <value>true</value> </property> <property> <name>yarn.resourcemanager.ha.automatic-failover.enabled</name>#开启故障自动转移 <value>true</value> </property> <property> <name>yarn.resourcemanager.store.class</name>#ResourceManager存储信息的方式,在HA机制下用ZooKeeper(ZKRMStateStore)作为存储介质 <value>org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</value> </property> <property> <name>yarn.log-aggregation-enable</name>#开启YARN日志 <value>true</value> </property>

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 修改slaves文件

在虚拟机Spark01中,进入Hadoop安装包的/etc/hadoop/目录,执行“vi slaves”命令,编辑记录Hadoop集群所有DataNode节点和NodeManager节点主机名的文件slaves。如下:

spark01

spark02

spark03

- 1

- 2

- 3

- 4

- 配置Hadoop环境变量

在虚拟机Spark01中,执行“vi /etc/profile”命令编辑系统环境变量文件profile,

配置Hadoop系统环境变量。如下:

export HADOOP_HOME=/export/servers/hadoop-2.7.4

export PATH=$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$PATH

- 1

- 2

- 3

系统环境变量文件profile配置完成后保存并退出即可,随后执行“source /etc/profile”命令初始化系统环境变量使配置内容生效。

- 分发文件

为了便于快速配置Hadoop集群中其他服务器,将虚拟机Spark01中的Hadoop安装目录和系统环境变量文件分发到虚拟机Spark02和Spark03。如下:

#将Hadoop安装目录分发到虚拟机Spark02和Spark03

$ scp -r /export/servers/hadoop-2.7.4/ root@spark02:/export/servers/

$ scp -r /export/servers/hadoop-2.7.4/ root@spark03:/export/servers/

#将系统环境变量文件分发到虚拟机Spark02和Spark03

$ scp /etc/profile root@spark02:/etc/

$ scp /etc/profile root@spark03:/etc/

- 1

- 2

- 3

- 4

- 5

- 6

- 7

完成分发操作,分别在虚拟机Spark02和Spark03中执行“source /etc/profile”命令初始化系统环境变量。

- 验证Hadoop环境

在虚拟机Spark01中,执行“hadoop version”命令查看当前系统环境的Hadoop版本。如下图所示:

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

g-JoIgI0Hi-1714878112281)]

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/盐析白兔/article/detail/855657

推荐阅读

相关标签