- 1如何在三年内快速成长为一名技术专家

- 2元素获取的六种方式_js根据name获取元素

- 3mysql-架构_一张自增表里面总共有 7 条数据,删除了最后 2 条数据,重启 mysql 数据库,又插入了

- 4Jetty -- 安全认证 -- 三种配置方法

- 5unity3d 实现第三人称移动与摄像机调整_unity第三人称摄像机跟随

- 6基于 NNCF 和 Optimum 面向 Intel CPU 对 Stable Diffusion 优化_diffusion 损失优化

- 7Ubuntu安装Opencv、opencv_contrib、cuda(都是细节)_ubuntuopencv cuda安装

- 8iOS中的CoreImage_ciimage如何释放

- 9前端知识--ES6_前端es6

- 10Tensorflow(三)训练自己的数据,分块版本_train_logits = model.inference(train_batch, batch_

图像识别(四)| 卷积的核心,特征提取_卷积网络提取浅层纹理特征

赞

踩

大家好啊,我是董董灿。

导读

图像识别(一)| 从像素说起

图像识别(二)| 图像的色彩空间

图像识别(三)| 初识卷积

上一篇文章——初识卷积,聊到了卷积这一算法。

通俗点讲,卷积就是模仿的人眼识图的过程,以“感受野”的视角去扫描图片,从而获取不同区域的图片信息。

但其实,这并不是卷积算法的核心思想。卷积的核心,是通过设计多个卷积核,同时对一张图片进行卷积操作,以完成不同特征的提取。

本篇重点围绕特征提取这一概念,聊一聊卷积。

卷积的数学描述

不想看数学描述的同学可以略过,不影响后面的阅读。

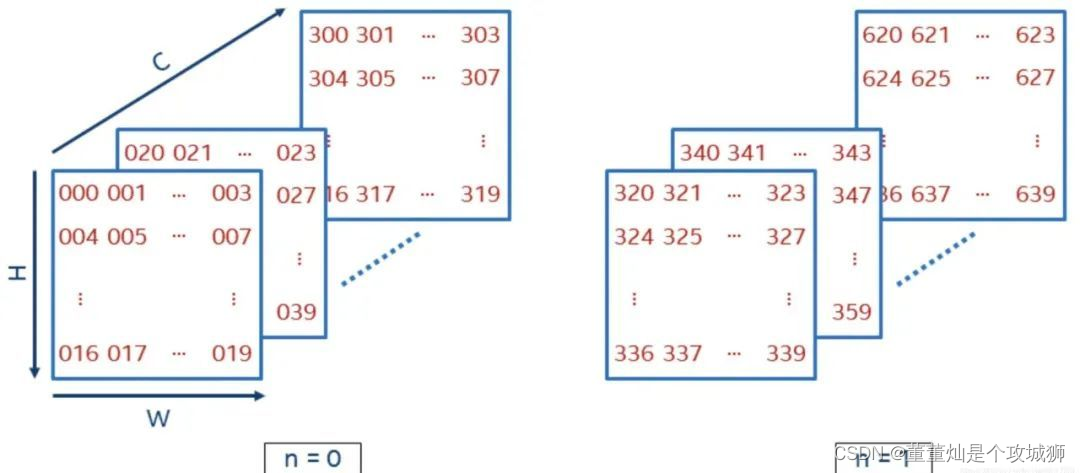

有了之前文章的铺垫,这里说一张图片的尺寸是 [n, h, w, c],应该不陌生了,其中,

- n 代表的是图片的张数。

- h 代表的是图片的高度,通俗的讲,高度方向上有多少像素。

- w代表的是图片的宽度,通俗的讲,宽度方向上有多少像素。

- c 代表图片的通道数,例如 RGB 图片,c 等于3。

不论是图片,还是卷积核,其数学描述都是具有n,h,w,c四个维度的数据。

因此,对于卷积算法而言,输入图片尺寸为 [n, hi, wi, c](下标i代表input,输入),卷积核尺寸为 [kn, kh, kw, c],输出图片尺寸为[n, ho, wo, kn](下标o代表output)。

有没有发现。输出图片的channel数与输入图片的channel数不一致!

输出图片的channel数与卷积核的个数一致!

图片的特征

这意味着什么?还记得么,channel 代表的是图片的特征,如果我们想让图片呈现出100个特征,怎么办?

用卷积,使用100个卷积核计算,输出图片就具有100个特征!卷积算法,可以通过设计卷积核的个数,随意的提取图片的不同的数量的特征!

说的数学一点,卷积算法,就是通过线性变换,将图片映射到特征空间!

有点绕?没关系,只需要知道,卷积的核心,是提取图片的特征就行了。

那么,特征怎么理解呢?

图像特征主要有图像的颜色特征、纹理特征、形状特征和空间关系特征。

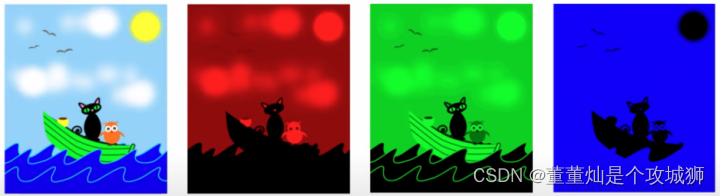

RGB图片有3个通道,可以说有3个颜色特征,分别为红色,绿色和蓝色。

那么纹理特征,形状特征和空间特征又是什么意思呢?

很简单,纹理特征就是图片的纹理,比如下面这样。

形状特征就是图片中物体的形状,比如下面这样。

那么卷积这一算法在神经网络的训练过程中学习到这些特征了么?

答案是肯定的!

卷积不仅学到了这些特征,而且还学到了更多人们不太好描述的特征,这些特征对于人类来说可能毫无意义,但对于神经网络来说,确实十分重要的。

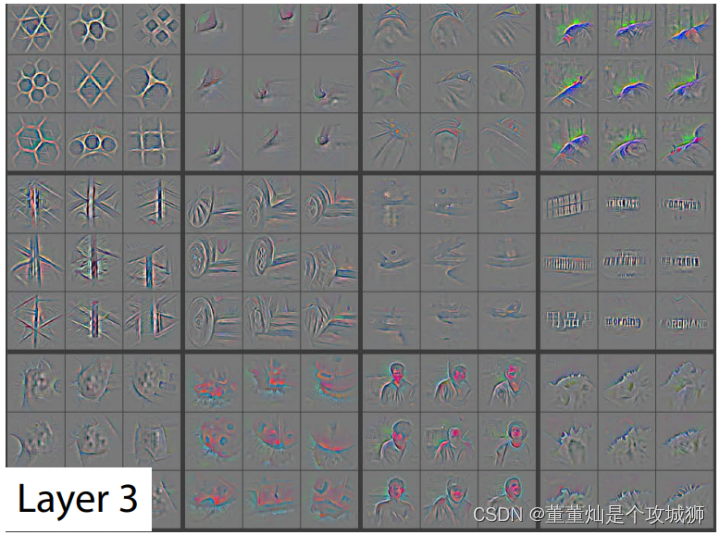

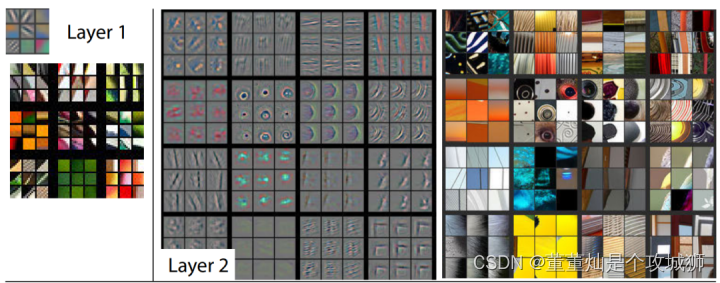

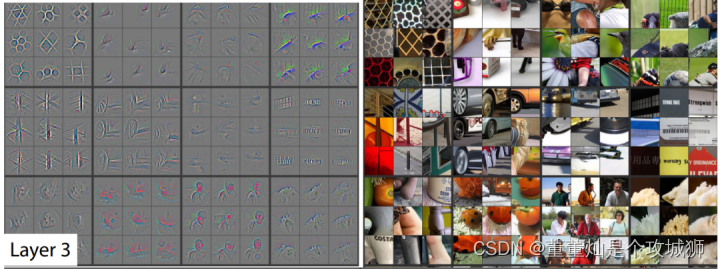

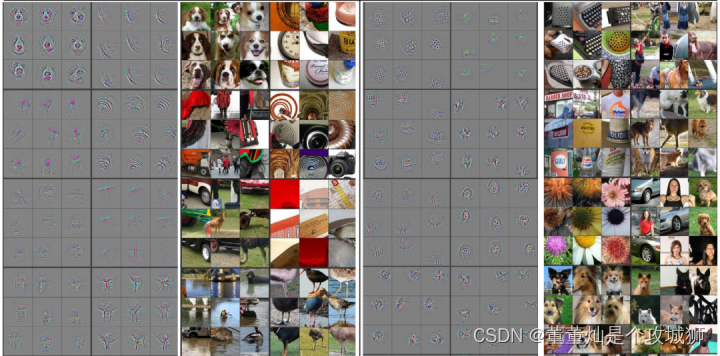

上图是著名的论文《Visualizing and Understanding Convolutional Networks》中的截图,文中提出通过反卷积这一算法,以可视化的视角,形象的展示卷积神经网络在训练过程中到底看到了什么。

所谓反卷积,通俗的理解就是卷积的逆运算。

可以看到,随着神经网络深度的不断加深,卷积提取到的特征逐渐清晰起来。由浅层次的纹理特征,逐步到深层次的形状特征!比如,在Layer 4中已经可以看到狗狗的形象!

事实上,我们希望神经网络展现出来的是,看到一张画着小猫的图片,里面有一个代表猫的特征通道,该通道最终得分最高。

说到这里,即使你是一个AI算法小白,那也应该对卷积有了一些感性的认识。如果你希望了解到更多细节的东西,后面会逐步进行拆解。

Resnet网络

这篇文章的最后,介绍一下Resnet网络。就在昨天,深度学习大牛孙剑博士因病去世,在人工智能行业掀起轩然大波。孙剑博士领导研究的Resnet网络(残差网络),曾多次荣获图片分类大赛冠军,开启了一个卷积图像分类的热潮。

而图像识别这一系列文章,重点拆解的就是Resnet50网络。

这是一个图像分类网络。

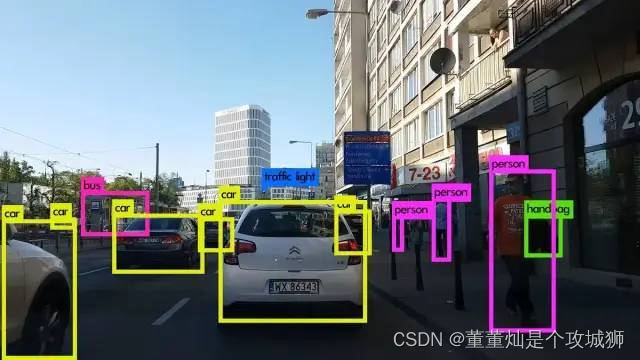

所谓图像分类,就是它可以将一张图片进行分类。猫就是猫,狗就是狗,飞机就是飞机,大树就是大树。与图像分类不同的,还有图像检测网络。比如物体识别,需要在一张图片上准确的标注出物体是啥以及物体的位置。

这些网络里都大量使用了卷积这一算法。

因此这些网络我们也可以称之为卷积神经网络(Convolution Neural Network, CNN),除了CNN,还有循环神经网络(Recurrent Neural Network, RNN), 之前写过一篇关于LSTM的文章,学AI,不懂LSTM怎么行?中提到的LSTM就是一种RNN结构,不过这是后话。

回到Resnet50这一卷积神经网络,这一网络由50个卷积层前后连接而成,因此叫Resnet50,除此之外,还有Resnet18,Resnet101等,大致网络结构相似,只是卷积的层数不同。

为什么会有不同的卷积层数呢?神经网络在学习的时候,每一层学习到的特征是不同的,就比如第一层,它的输入只有3个特征,输出有64个特征,至于这64个特征代表的是什么,可能连神经网络自己也说不清,它就只管学习。

一直到最后一层有2048个特征。到了最后一层,可以比较形象的这么比喻:最后一层共2048个特征,实际上已经代表了2048种物体的分类了。

针对一张图片是猫的原始输入,2048个特征中,只有猫这一特征最后的得分最高,因此,网络会把它推理成猫。这就是卷积算法的核心,特征提取。

下一篇,主要以硬核公式为主,继续深入的聊一聊卷积这一算法,敬请期待。

图像识别(五)| 春天花开却不识?打开百度识图,残差和卷积带你识遍路边野花

v v v v v v

本文为作者原创,请勿转载,转载请联系作者。

点击下方卡片,关注我的公众号,有最新的文章和项目动态。

v v v v v v