热门标签

热门文章

- 1ROS2安装ORB—SLAM3并用电脑摄像头运行_orbslam3_ros2一键安装

- 2如何使用Navicat连接宝塔面板上安装的mysql数据库?_navicat连接宝塔mysql

- 3安全技术系列之Java一句话木马_java一句话马

- 4UI基础:UIActionSheet和UIAlterView_swift uialterview

- 5家中的电视 java,家里面的卧室到底适不适合安装电视机?

- 6移动端实时目标检测网络Mobilenet_v2-ssdlite及其keras实现(附代码地址)_ssdlite_mobilenetv2

- 7MathType2024永久激活码(包括免费注册机)_mathtype最新注册码下载

- 8HBase 性能优化:规避热点区间_hbase 性能优化:规避热点区间

- 9Web3Js订阅Log示例_web3js 监听转账事件

- 10ubuntu云服务器配置SFTP服务_ubuntu sftp

当前位置: article > 正文

【大语言模型】Docker部署清华大学ChatGLM3教程_chatglm3 docker

作者:知新_RL | 2024-04-13 20:16:05

赞

踩

chatglm3 docker

官方地址:https://github.com/THUDM/ChatGLM3

1 将代码保存至本地

方法1:

git clone https://github.com/THUDM/ChatGLM3方法2:

https://github.com/THUDM/ChatGLM3/archive/refs/heads/main.zip2 创建Docker文件

注:请先完成Docker安装,安装方式参考:

Docker使用及本地Yolov5打包教程_Father_of_Python的博客-CSDN博客

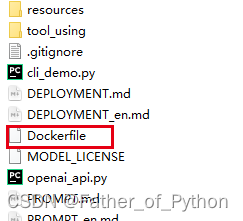

①新建一个Dockerfile

②文件中写入:

- #基于的基础镜像

- FROM python:3.11.6

- #代码添加到code文件夹

- ADD . /usr/src/app/uniform/ChatGLM3

- # 设置code文件夹是工作目录

- WORKDIR /usr/src/app/uniform/ChatGLM3

- # 安装支持

- RUN pip install -i https://pypi.tuna.tsinghua.edu.cn/simple/ -r requirements.txt

3 创建Docker

①运行以下指令:

- docker build -t chatglm3 .

- docker run -it --gpus all --net=host --ipc=host --privileged=true --name test01 --ulimit core=-1 -v F:/ChatGLM3:/usr/src/app/uniform/ChatGLM3 env LANG=C.UTF-8 /bin/bash

注意:请将以上命令的 F:/ChatGLM3 改为你将项目保存至本地的路径。

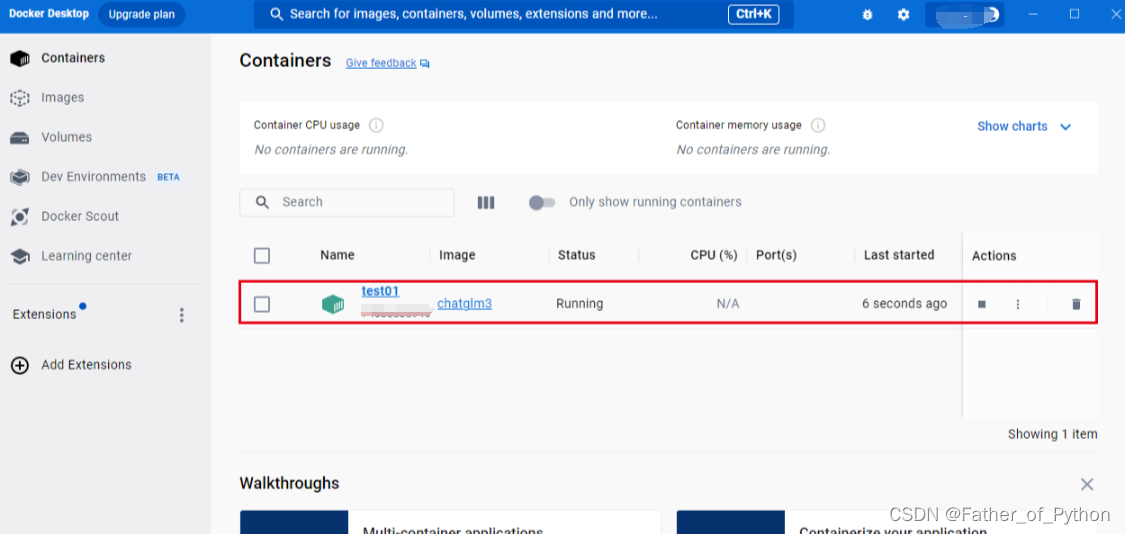

②查看运行情况:

4 进入Docker中执行命令

执行命令:

- cd /usr/src/app/uniform/ChatGLM3/basic_demo

- python web_demo.py

此时会进行权重文件的下载,时间可能比较长。如果有梯子,记得开启全局模式。如果没有梯子,可以手动下载:chatglm3-6b

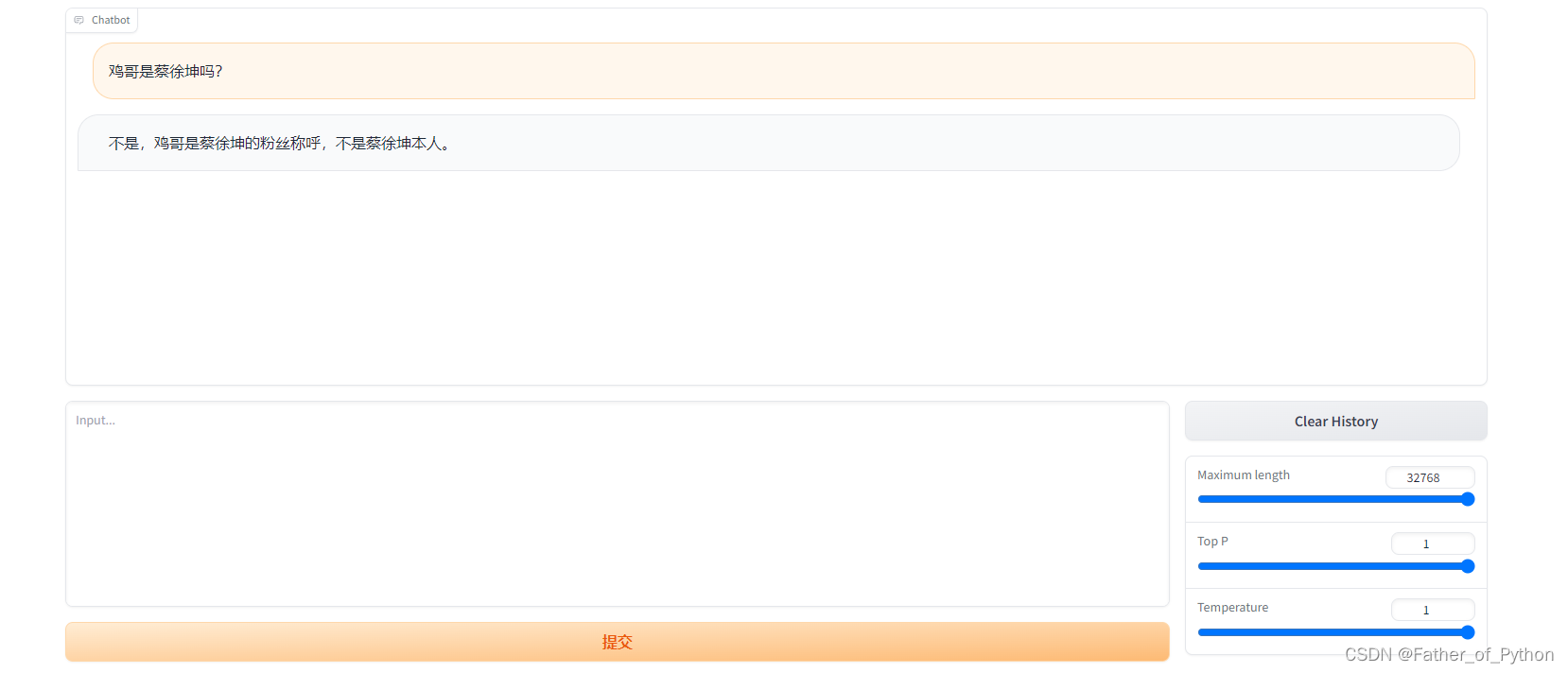

5 完成后测试

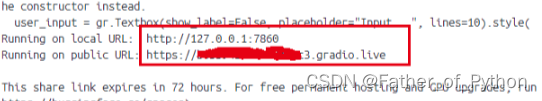

显示成功:

6 composite_demo测试

- cd /usr/src/app/uniform/ChatGLM3/composite_demo

- pip install -r requirements.txt

- streamlit run main.py

运行成功:

推荐阅读

相关标签