热门标签

热门文章

- 1R 包ggClusterNet安装,x86_64-conda-linux-gnu-c++: error: nlopt/lib/libnlopt.a: No such file or directory_ggclusternet安装包

- 2FPGA上基于自适应滤波器的FIR、IIR和分数阶算法:LMS、NLMS、RLS以及FxLMS_fpga 分数阶

- 3人工智能发展方向的思考:简单与复杂的对立与融合

- 4java jar后台启动的三种方式_java -jar 后台启动

- 5服务器安全基线检查(Python)代码执行_windows基线核查脚本

- 6【SpringAI入门】初识SpringAI_spring-ai

- 7c# 连接oracle 及对应获取数据集_c# 访问oracle数据库读出的结果集

- 8Linux下使用git克隆github项目及文件上传

- 9认识链表以及其常见操作Java代码实现_链表怎么输入输出

- 10昇思25天学习打卡营第8天|ShuffleNet图像分类

当前位置: article > 正文

多维时序 | MATLAB实现BiTCN-Multihead-Attention多头注意力机制多变量时间序列预测

作者:知新_RL | 2024-06-11 09:48:50

赞

踩

bitcn

多维时序 | MATLAB实现BiTCN-Multihead-Attention多头注意力机制多变量时间序列预测

预测效果

基本介绍

多维时序 | MATLAB实现BiTCN-Multihead-Attention多头注意力机制多变量时间序列预测。

模型描述

MATLAB实现BiTCN-Multihead-Attention多头注意力机制多变量时间序列预测,用于处理时间序列数据;适用平台:Matlab 2023及以上

1.data为数据集,格式为excel,4个输入特征,1个输出特征,考虑历史特征的影响,多变量时间序列预测;

2.主程序文件,运行即可;

3.命令窗口输出R2、MAE、MAPE、MSE和MBE,可在下载区获取数据和程序内容;

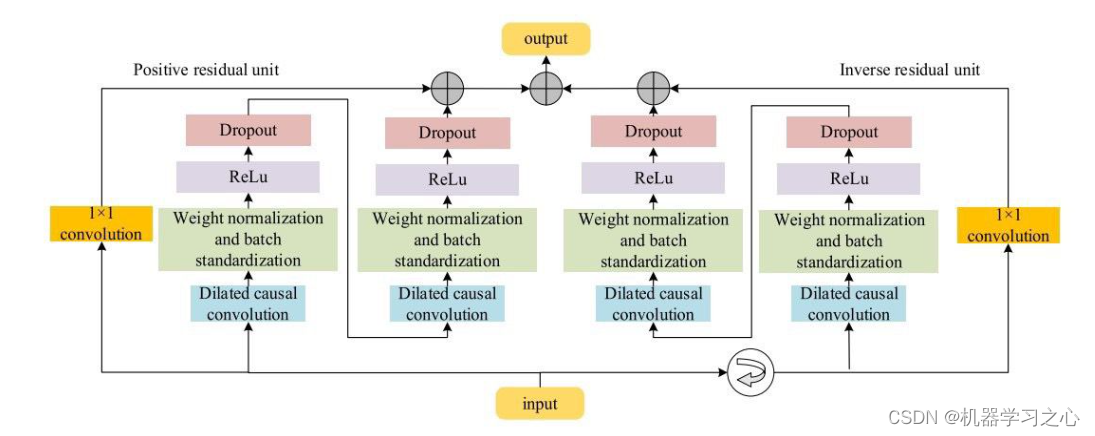

注意程序和数据放在一个文件夹,运行环境为Matlab2023b及以上。BiTCN 引入了双向时间卷积,结合了时间序列数据在过去和未来的信息,使模型能够更好地捕获时间序列中的时序模式。传统的单向卷积只关注局部上下文信息,而双向卷积可以从多个方向捕捉时间序列的重要特征。多头自注意力机制使得模型能够更灵活地对不同时间步的输入信息进行加权。这有助于模型更加集中地关注对预测目标有更大影响的时间点。自注意力机制还有助于处理时间序列中长期依赖关系,提高了模型在预测时对输入序列的全局信息的感知。

程序设计

- 完整程序和数据获取方式1:同等价值程序兑换;

- 完整程序和数据获取方式2:私信博主回复MATLAB实现BiTCN-Multihead-Attention多头注意力机制多变量时间序列预测获取。

%--------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------- %% 数据集分析 outdim = 1; % 最后一列为输出 num_size = 0.7; % 训练集占数据集比例 num_train_s = round(num_size * num_samples); % 训练集样本个数 f_ = size(res, 2) - outdim; % 输入特征维度 %--------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------- %% 划分训练集和测试集 P_train = res(1: num_train_s, 1: f_)'; T_train = res(1: num_train_s, f_ + 1: end)'; M = size(P_train, 2); %--------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------- P_test = res(num_train_s + 1: end, 1: f_)'; T_test = res(num_train_s + 1: end, f_ + 1: end)'; N = size(P_test, 2); ———————————————— 版权声明:本文为CSDN博主「机器学习之心」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。 原文链接:https://blog.csdn.net/kjm13182345320/article/details/130471154

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

参考资料

[1] http://t.csdn.cn/pCWSp

[2] https://download.csdn.net/download/kjm13182345320/87568090?spm=1001.2014.3001.5501

[3] https://blog.csdn.net/kjm13182345320/article/details/129433463?spm=1001.2014.3001.5501

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/知新_RL/article/detail/702632

推荐阅读

相关标签