- 1联邦学习研究综述【联邦学习】_联邦学习通信效率研究综述

- 2玩转Fasttext_fasttext训练的正负样本比例是多少

- 3专门针对浏览器识别undetected_chromedriver了解一下_undetected-chromedriver

- 4根据哈希值或者特征值判断图片是否相同

- 5mysql 主从复制 gtid_MySQL基于GTID的主从复制数据库

- 6杭电oj —— 2057(十六进制A+B)_oj 2057

- 7常用智能小车电机驱动模块选型_ibt4电机驱动模块

- 82024最新最全Vue3零基础入门到精通,编程小白也能听得懂写的出,web前端快速入门教程,uniapp开发小程序学习视频_编程小石头 uniapp

- 9Qt开发-Qt中的事件处理(上)_qt 修改事件

- 10c++ error: 'map' does not name a type_error: ‘map’ does not name a type

在群晖上通过Docker部署DB-GPT_db-gpt部署

赞

踩

最近一直有网友在后台私信,发的内容高度统一,只有后面 8 位数字不一样,都是 #22232 xxxxxxxx,有谁知道是什么意思吗?在我印象中,这是第二次这么大规模的发类似的字符串了

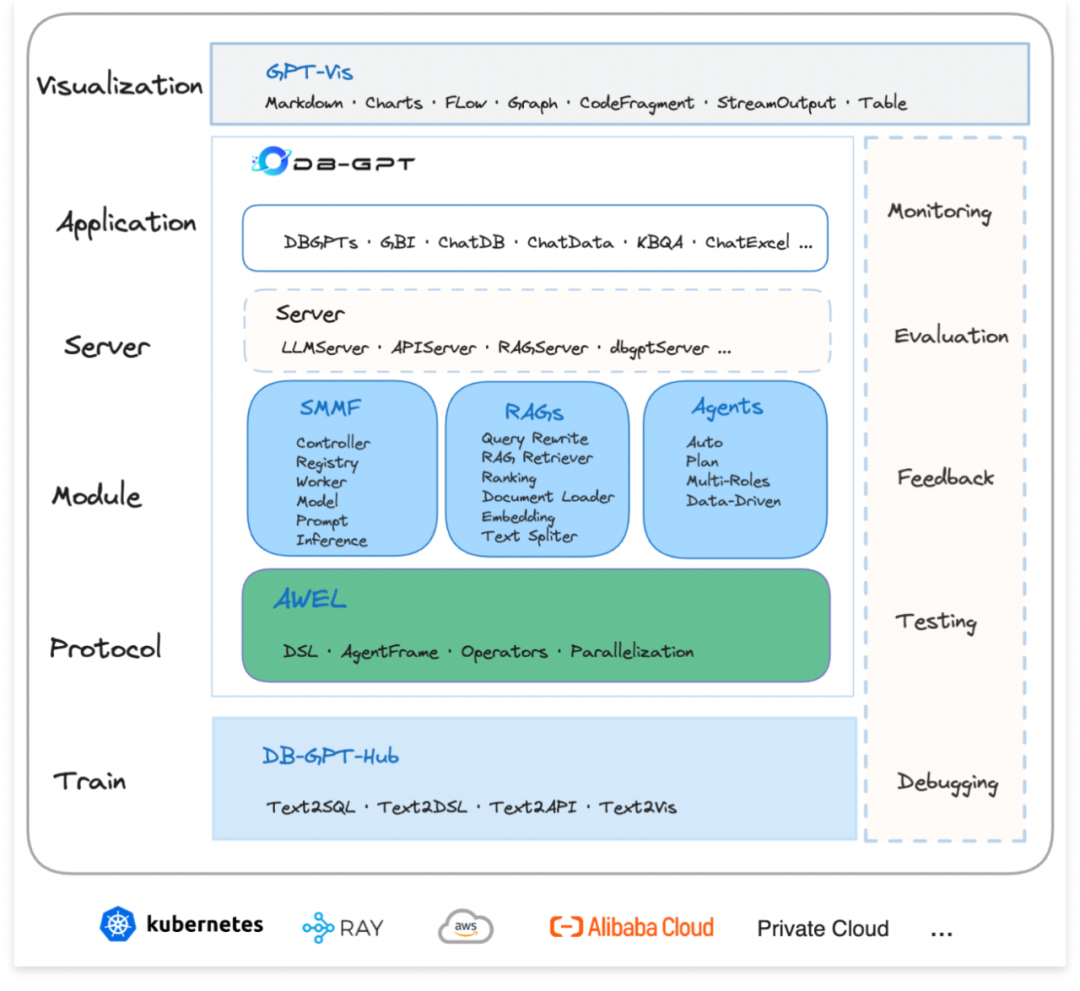

什么是 DB-GPT ?

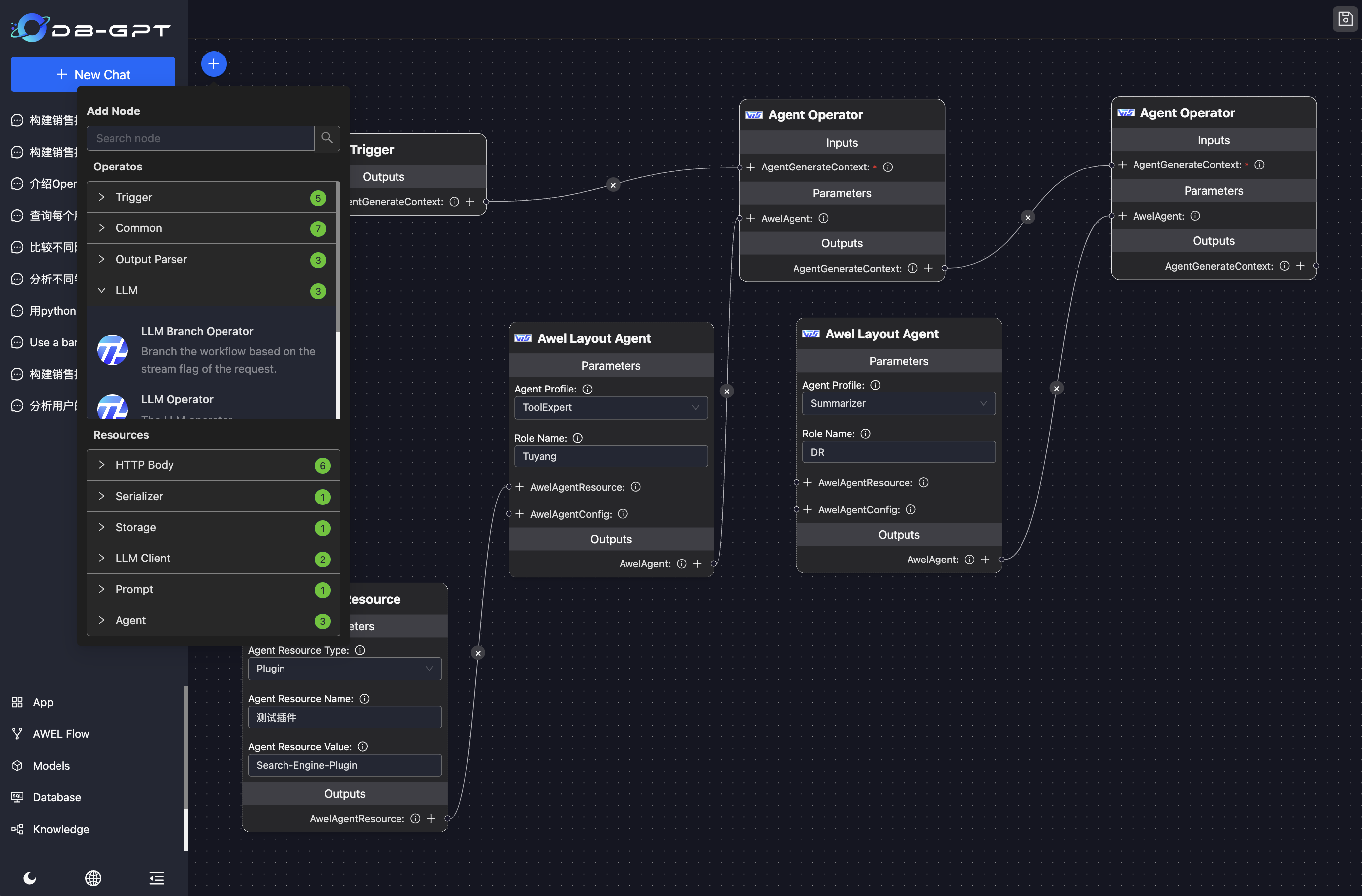

DB-GPT是一个开源的AI原生数据应用开发框架(AI Native Data App Development framework with AWEL(Agentic Workflow Expression Language) and Agents)。目的是构建大模型领域的基础设施,通过开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单,更方便。

DB-GPT 支持原生对话

也支持与数据对话

还能与数据库、Excel 等对话,做数据分析,实现智能体、工作流等等

前言

在开始之前,老苏觉得应该先讲讲可能会遇到的问题。如果你觉得这些问题中存在你无法解决的,建议你看看就行了。如果对你来说这都不算事,那就开始我们今天的折腾之旅吧

- 第一个问题:是网络问题。

如果你没有一个稳定的,科学的上网环境,不建议你继续折腾,因为镜像下载之后有 13G,老苏差不多下载了一整天。有一次都快下载完成了,突然又显示 EOF 错误

如果你平时下载个几百兆的镜像都不顺畅的情况下,就不要浪费时间去尝试了,这种感觉真的很让人抓狂

- 第二个问题:

git-lfs的支持问题。

首先要了解下,什么是 git-lfs

Git LFS (Large File Storage) 是 Git 的扩展,是一个开源的 Git 大文件版本控制的解决方案和工具集。用于管理大文件和二进制文件,将它们存储在单独的 LFS 存储库中, 从而让 Git 存储库保持在一个可管理的规模。

现在很多包含大模型的仓库都必须使用 git-lfs 才能把整个 git 仓库拉下来,老苏的机器是 DSM6.17 的,现在想安装 Git 套件都找不到了,之前下载的版本比较老了,肯定是不支持 git-lfs 的

但 6.2 以上应该是没问题的

在不支持 git-lfs 的情况下,下载的大文件只有很小的尺寸,打开文件内容是下面这样的

version https://git-lfs.github.com/spec/v1

oid sha256:eaf5cb71c0eeab7db3c5171da504e5867b3f67a78e07bdba9b52d334ae35adb3

size 1302138752

- 1

- 2

- 3

关于 Git 套件的安装,可以参考老苏之前写的文章

文章传送门:MediaCMS在群晖中的安装

- 第三个问题:磁盘空间问题。

前面讲了 Docker 镜像就 13G,加上 Embedding 模型差不多 3G,这还是因为老苏的群晖上没有 GPU 资源,使用了代理模型的情况下

老苏的磁盘一下就吃紧了

- 第四个问题:

API服务问题。

因为机器没有 GPU,所以不能在本机上跑满足要求的大模型,最终用的是线上的模型,理论上 proxyllm 除了 openai 外,还支持 Moonshot,但不知道是老苏设置不正确还是 bug ,反正就是不行,所以最终聚焦在了几个常用的 API 服务上

FreeGPT35一直报错

{

"status": false,

"error": {

"message": "Error getting a new session, please try again later, if the issue persists, please open an issue on the GitHub repository.",

"type": "invalid_request_error"

}

}

- 1

- 2

- 3

- 4

- 5

- 6

- 7

FreeDuckDuckGo也一样

{

"error": true,

"message": "empty response from server"

}

- 1

- 2

- 3

- 4

aurora也不行

{

"code": 403,

"message": "failed to get chat requirements",

"param": {},

"type": "InitTurnStile_request_error"

}

- 1

- 2

- 3

- 4

- 5

- 6

后来发现只有 GPT4Free 是 ok 的,当然也不完美,每次回答完成后,会用下面的输出,将之前的回答覆盖掉

LLMServer Generate Error, Please CheckErrorInfo.: RetryProviderError: RetryProvider failed: Cnote: ClientResponseError: 404, message='Not Found', url=URL('https://p1api.xjai.pro/freeapi/chat-process') Feedough: ClientResponseError: 403, message='Forbidden', url=URL('https://www.feedough.com/wp-admin/admin-ajax.php') OpenaiChat: CloudflareError: Response 403: Cloudflare detected ChatgptNext: ClientResponseError: 429, message='Too Many Requests', url=URL('https://chat.fstha.com/api/openai/v1/chat/completions') (error_code: 1)

- 1

文章传送门:在群晖上安装GPT4Free

最终测试发现,还是基于 One API + kimi-free-api 最理想,但需要在原来的渠道中,增加模型的名称为 gpt-3.5-turbo,原因后面再说

文章传送门:大模型接口管理和分发系统One API

聊天内容不会再出被错误覆盖了

准备工作

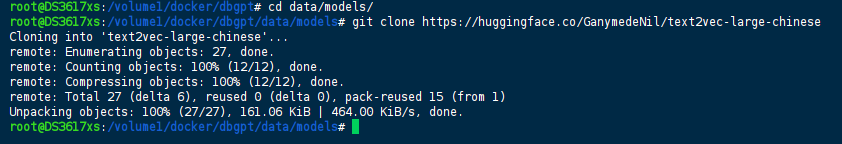

在开始安装之前,我们需要做一些准备工作,比如先下载好镜像,毕竟这是一个 13G 的大家伙,另外 Embedding 模型也需要提前下载

以下全部采用命令行方式,需要用

SSH客户端登录到群晖后执行

# 新建文件夹 dbgpt 和 子目录

mkdir -p /volume1/docker/dbgpt/data/models

# 进入 dbgpt 目录

cd /volume1/docker/dbgpt

# 进入 models 目录

cd data/models/

# 下载 Embedding 模型 (需要git lfs)

git clone https://huggingface.co/GanymedeNil/text2vec-large-chinese

# 下载镜像

docker pull eosphorosai/dbgpt:latest

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

如果不支持 git-lfs 的情况下,大文件只有 135 bytes

实在没招的情况下,一个文件一个文件下载也不是不行

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。