热门标签

热门文章

- 1Vue3项目移动端适配方案_vue3网页版怎么适配手机端

- 2sql查询表时将*直接变成表的全部字段名_dbeaver查询 把*转为字段

- 3知识图谱中的关系推理,究竟是个什么玩意儿?_基于知识图谱的高中数学推理

- 4制作一个Python聊天机器人_python 对话机器人

- 5Windows 下cmd自由方便切换python版本_adb命令切换python版本

- 6网络安全等级保护

- 7vscode使用remote-ssh免密连接服务器_vscode remote ssh

- 8华为2288H V5服务器RAID配置_avago megaraid配置raid

- 9kivy学习之路:kivy开发环境架设--- windows篇

- 10博奥导出工程项目电子表格_博奥造价软件导出excel表格无数据原因-2015年基础教育年报导出的电子表格没有数据,什么原因?...

当前位置: article > 正文

《昇思25天学习打卡营第6天 | 函数式自动微分》

作者:秋刀鱼在做梦 | 2024-07-04 07:20:13

赞

踩

《昇思25天学习打卡营第6天 | 函数式自动微分》

《昇思25天学习打卡营第6天 | 函数式自动微分》

函数式自动微分

神经网络的训练主要使用反向传播算法,模型预测值(logits)与正确标签(label)送入损失函数(loss function)获得loss,然后进行反向传播计算,求得梯度(gradients),最终更新至模型参数(parameters)。自动微分能够计算可导函数在某点处的导数值,是反向传播算法的一般化。自动微分主要解决的问题是将一个复杂的数学运算分解为一系列简单的基本运算,该功能对用户屏蔽了大量的求导细节和过程,大大降低了框架的使用门槛。

MindSpore使用函数式自动微分的设计理念,提供更接近于数学语义的自动微分接口grad和value_and_grad。

简单的单层线性变换模型

我们通过学习使用一个简单的单层线性变换模型来了解

import numpy as np

import mindspore

from mindspore import nn

from mindspore import ops

from mindspore import Tensor, Parameter

- 1

- 2

- 3

- 4

- 5

函数与计算图

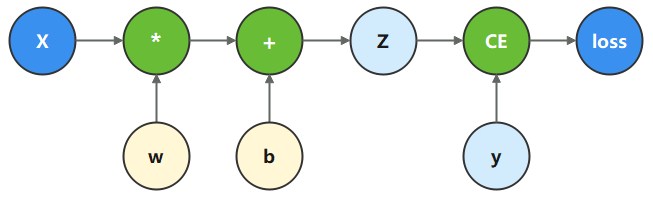

计算图是用图论语言表示数学函数的一种方式,也是深度学习框架表达神经网络模型的统一方法。我们将根据下面的计算图构造计算函数和神经网络。

在这个模型中,

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/秋刀鱼在做梦/article/detail/786094

推荐阅读

相关标签

Copyright © 2003-2013 www.wpsshop.cn 版权所有,并保留所有权利。