热门标签

热门文章

- 122、基于51单片机电压电流功率系统设计(程序+原理图+PCB图+Proteus仿真+答辩技巧+开题报告+参考论文+元器件清单等)_基于51单片机的电压电流的系统设计

- 2centos6 & kylin3.2 安装 Chrome浏览器_kylin chrome

- 3vue.js word文档解析_你知道吗?原来普通的Word文档里的表格也能用Power Query直接读??!!!...

- 4RabbitMQ学习笔记(六)——优化RabbitMQ集群_rabbitmq 集群状态api

- 5原创文章汇总(职场经验分享、自学教程、面试真题解析、技术专题深度解析)

- 6大模型应用之路:从提示词到通用人工智能(AGI)_如何写出有效的prompt提示词

- 7常见黑客渗透测试工具

- 8BGP —— 软收敛_bgp 收敛

- 9oracle集合类型详解_oracle 集合类型

- 10nginx安装及使用(学习笔记)_nginx安装成功

当前位置: article > 正文

python 之softmx 函数_python softmax

作者:空白诗007 | 2024-07-04 01:50:06

赞

踩

python softmax

总的介绍

-

Softmax函数是一个常用的激活函数,通常用于多类别分类问题中。它将一个实数向量转换为概率分布。这个函数的输出是一个概率分布,表示输入样本属于每个可能类别的概率。

-

给定一个具有 (K) 个不同数值的实数向量 z = (z1,z2,···,zn)

,softmax函数将每个元素zi 转换为一个处于0–1之间的概率值。具体计算公式如下: -

-

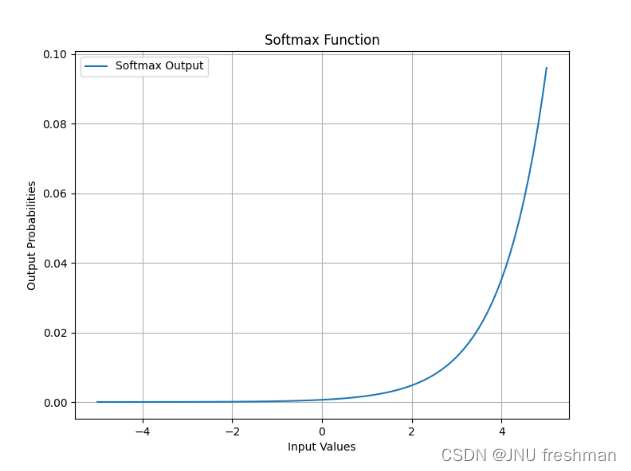

在应用中,softmax函数的主要作用是将向量的原始分数转换为概率分布,使得最大的数值相对更大,最小的数值相对更小,但保持它们的相对顺序。这样可以更好地表示类别间的相对关系,并能够更直观地理解模型对每个类别的预测置信度。

-

在机器学习中,softmax函数通常与交叉熵损失函数一起使用,用于多分类任务的神经网络输出层,以便计算预测结果与实际标签之间的差异,从而进行模型参数的优化。

小应用

当使用Python实现Softmax函数时,可以按照如下方式进行:

import numpy as np def softmax(z): # 计算指数 exp_z = np.exp(z) # 计算softmax softmax_output = exp_z / np.sum(exp_z) return softmax_output # 示例输入向量 input_vector = np.array([2.0, 1.0, 0.1]) # 应用softmax函数 output_probs = softmax(input_vector) print("Softmax输出概率分布:", output_probs)

- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

这段代码中,numpy库用于处理数学运算,首先定义了一个名为softmax的函数来计算Softmax。给定一个输入向量input_vector,它将每个元素应用Softmax函数,并打印出转换后的概率分布。

需要注意的是,Softmax函数的实现涉及指数运算,当输入向量中的元素非常大或者非常小时,可能会导致数值不稳定的情况,这就是常见的数值稳定性问题。在实际应用中,为了避免数值稳定性问题,可能需要对输入向量进行适当的缩放或其他数值处理。

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/空白诗007/article/detail/785231

推荐阅读

相关标签