热门标签

热门文章

- 1【低照度图像增强系列(2)】Retinex(SSR/MSR/MSRCR)算法详解与代码实现_ssr低光增强算法原理

- 2nacos微服务的原理及应用_nacos 核心原理解读+高性能微服务系统实战

- 3python数据爬取案例--地产数据及交通数据_交通数据抓取

- 4git clone时报错 fatal: protocol ‘https‘ is not supported_fatal: unencrypted http is not supported for gitla

- 5Mac上使用phpstudy+vscode配置PHP开发环境_mac os的vs code配置php开发环境

- 6详解git如何回滚提交记录_git 回滚提交

- 7Druid配置错误导致未授权访问漏洞_poc-yaml-druid-monitor-unauth

- 8webSQL_web sql工具 预制sql语句

- 9浅谈全国大学生智能车竞赛-摄像头组图像处理及控制算法_智能汽车竞赛负压镜头组代码

- 10准确!!!Centos8快速安装PG14,并且自定义数据目录和配置修改_centos 8 postgresql 14安装

当前位置: article > 正文

【NLP笔记】大模型微调方法概述

作者:笔触狂放9 | 2024-04-15 08:14:01

赞

踩

【NLP笔记】大模型微调方法概述

对于一些生成式场景而言,没有固定的回答结果,采用AI Agent的增强范式,可以极大地提升模型生成的效果。但是对于有固定格式、输出目标的场景而言,仅从prompt优化的角度出发很难突破瓶颈,需要通过微调来提升效果(如:分类模型);

微调方法汇总

微调的目标是提升在特定任务上的效果,因此需要搜集特定领域样本数据,然后选择合适的方法进行微调。那么选择哪种方式来更新模型参数,也是十分重要的一环,模型参数的更新大致可分为以下几种:

| 微调方法 | 描述 | 特点 | 代表方法 |

|---|---|---|---|

| 全参数调整 | 算不上真正意义上的微调,在预训练模型基础上进行全量参数调整 | 需要有大量的样本和计算资源做支撑,成本较高 | 预训练模型均可进行全量参数优化,无特殊技巧 |

| 引入强化学习 | 引入奖励模型(RM),是用一对(prompt,response)和一个奖励分数来训练一个模型,在给定输入上输出分数是机器学习中一个非常常见的任务,可以将其看作是分类或回归任务。该模型为每一个文本输入到文本输出的结果打分,来评估模型的性能。 | 依赖于奖励模型人工标注的质量,成本较高 | RLHF |

| 部分参数调整 | 大部分是冻结模型前面的参数层,仅调整后面几层的参数 | 保持模型的部分知识(如低级特征提取)不变,基于此进行微调,在大部分任务上效果不如LoRa、Adapter等方式 | BitFit |

| 增加Adapter | 在原始预训练模型基础上,额外增加几层Adapter,对新增的Adapter进行参数调整 | 会增加额外的计算成本和参数量,使得推理时间变长 | Adapter Tuning及其变体 |

| 增加前缀Token | 在模型输入或隐藏层增加可学习的前缀Token,只训练前缀参数,相当于为不同任务训练不同的自适应prompt | 为前缀保留部分序列长度会导致处理下游任务的序列长度减少 | Prefix Tuning、Prompt Tuning、P-Tuning、P-Tuning v2 |

| 重构简化参数 | 通过学习小参数的低秩矩阵近似模拟模型权重矩阵的参数更新,微调时仅训练低秩矩阵的参数 | 思路巧妙,结构简单效果好,适配性强 | LoRA、AdaLoRA、QLoRA |

| 混合调整 | 在Adapter、Prefix Tuning和LoRA等方法间建立联系的联合微调方法 | 结合各种微调提升技术的优点,集成的高效微调方式 | MAM Adapter、UniPELT |

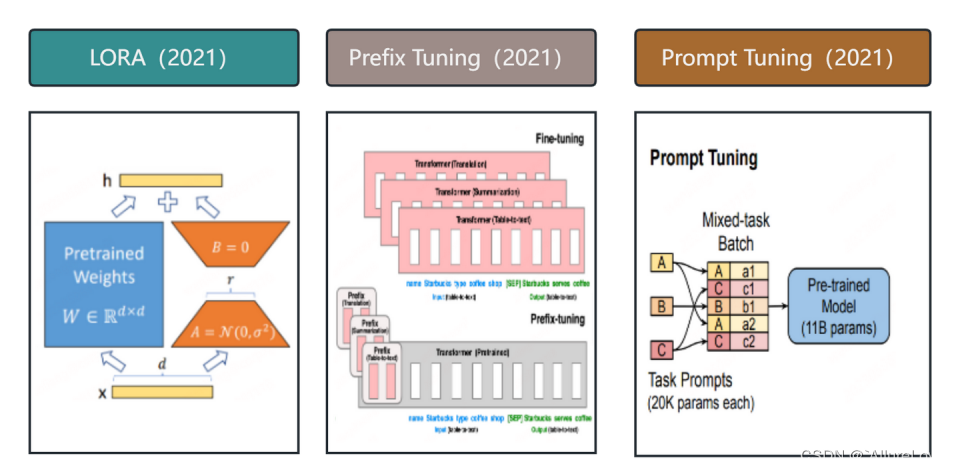

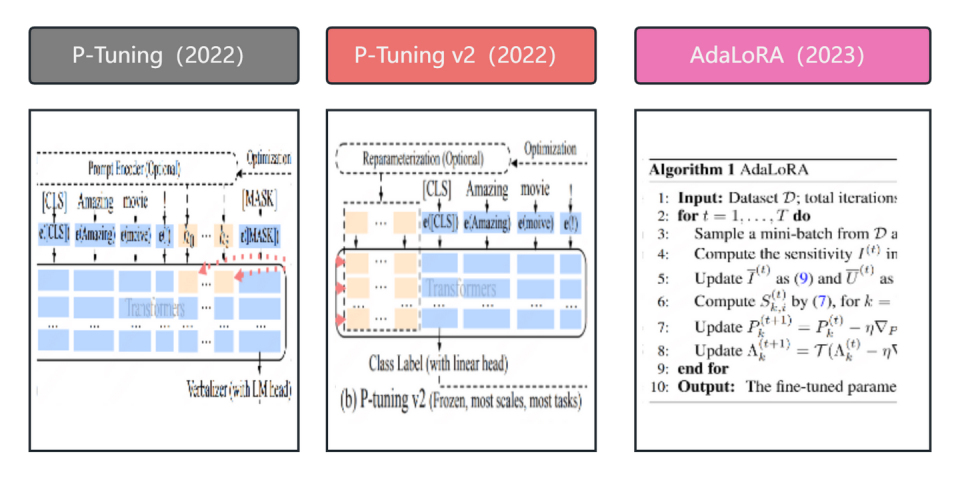

微调主要方法发展进程:

上述微调技术现在已经封装至现有的微调框架,主流的微调框架有:

- DeepSpeed Chat : 微软开源,提供了一键式RLHF训练框架,奖励模型微调和基于人类反馈的强化学习(RLHF),此外还实现了DeepSpeed HE,统一的高效混合引擎,达到训练和推理引擎之间的过渡是无缝的。;

- PEFT:PEFT 是 Huggingface 开源的一个参数高效微调库,它提供了最新的参数高效微调技术,并且可以与 Transformers 和 Accelerate 进行无缝集成;

其中PEFT使用较为广泛,微调优化算法中LoRA的应用较为广泛,因为能在少量(1000左右)数据集的基础上调整少量参数,就能够较好地适配目标场景;

资料汇总

上述方法相关资料汇总,有时间可以学习下原文:

参考:

声明:本文内容由网友自发贡献,不代表【wpsshop博客】立场,版权归原作者所有,本站不承担相应法律责任。如您发现有侵权的内容,请联系我们。转载请注明出处:https://www.wpsshop.cn/w/笔触狂放9/article/detail/426705

推荐阅读

相关标签